Con costos iniciales de sólo 1,3 millones de VND, herramientas falsas como el trasplante de rostro y la imitación de voz están generando advertencias sobre el riesgo de fraude, imágenes personales falsas y consecuencias para la seguridad cibernética.

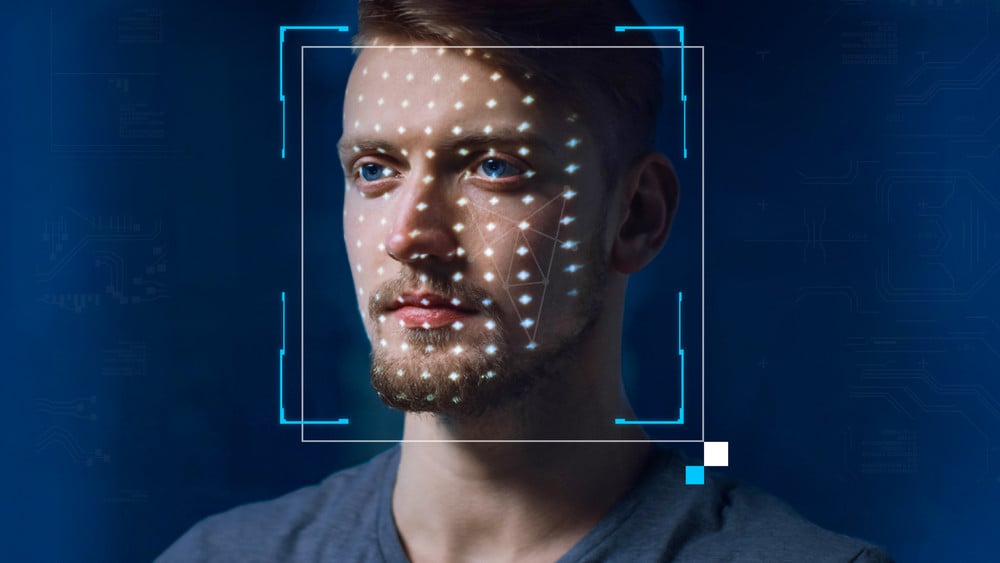

(Ilustración)

Precios baratos en la darknet, gran peligro oculto

El Equipo Global de Investigación y Análisis de Kaspersky (GReAT) acaba de publicar hallazgos que muestran la aparición en los mercados de la darknet de numerosos anuncios que ofrecen servicios para crear vídeos y audio deepfake en tiempo real. Los precios iniciales rondan los 50 USD (unos 1,3 millones de VND) y los 30 USD (unos 800.000 VND) por mensajes de voz falsos, dependiendo de la complejidad y la extensión del contenido.

Anteriormente, los servicios de deepfake “legítimos” costaban entre 300 y 20.000 dólares por minuto.

La fuerte caída del precio –400 veces inferior al nivel popular anterior– hace que el riesgo de ser explotado para realizar malas acciones sea aún mayor.

Características publicitarias y cebo para atraer a los malos

Los anuncios ahora van más allá de los simples videos falsos e incluyen intercambio de rostros en tiempo real durante las videollamadas, falsificación de cámaras de dispositivos o "reemplazo" de rostros para eludir la autenticación. También anuncian la posibilidad de sincronizar expresiones faciales con voces en off e incluso admiten varios idiomas.

Además, también se venden servicios de clonación de voz, que permiten imitar la voz y ajustar el tono para expresar diferentes emociones. Sin embargo, muchos expertos sospechan que se trata, en realidad, de publicidad engañosa : los compradores pueden ser engañados para que transfieran dinero por adelantado, pero no reciban el producto de calidad prometido.

“La necesidad de utilizar esta herramienta también está aumentando”

“No solo hemos visto anuncios que ofrecen deepfake como servicio, sino que también hemos notado un aumento en la demanda de estas herramientas”, dijo Dmitry Galov , jefe del equipo GReAT de Kaspersky (Rusia y CEI).

Los cibercriminales están experimentando con IA e incorporándola a sus estrategias de ataque, dijo, y algunas plataformas incluso están desarrollando sus propios LLM “maliciosos”, separados de los modelos públicos y capaces de ejecutarse directamente en los dispositivos de los malos.

Si bien los deepfakes aún no pueden considerarse una amenaza cibernética completamente nueva, la tecnología podría hacer que los ataques sean más sofisticados y más difíciles de detectar.

Recomendaciones y cómo identificar deepfakes

Kaspersky recomienda que las empresas y organizaciones implementen medidas integrales de ciberseguridad, que no se limiten solo a instalar software de protección, sino que también formen un equipo de expertos en TI con las habilidades para detectar y responder.

Además, el personal de la organización debe estar capacitado para reconocer señales inusuales en videos o audios que puedan ser producto de tecnología deepfake. Estos videos suelen presentar movimientos bruscos y poco naturales, iluminación o tonos de piel inconsistentes entre fotogramas, personajes con una frecuencia de parpadeo inusual o casi nula, y rostros que pueden estar distorsionados o ligeramente deformados.

Además, la calidad de la imagen suele ser deficiente y los fotogramas inestables, especialmente con poca luz, lo que resta realismo al vídeo. Estar alerta ante las amenazas de deepfakes y concienciar sobre ellas se considera un primer paso importante para minimizar los daños causados por estafas sofisticadas en la era de la IA.

Fuente: https://doanhnghiepvn.vn/chuyen-doi-so/rui-ro-tu-deepfake-gia-re-tu-quang-cao-darknet-den-loi-keu-goi-canh-giac/20251016105304840

![[Foto] Ayuda urgente a que las personas tengan pronto un lugar donde vivir y estabilizar sus vidas](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F09%2F1765248230297_c-jpg.webp&w=3840&q=75)

![[Foto] El Secretario General To Lam trabaja con los Subcomités de los Comités Permanentes del XIV Congreso del Partido](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/09/1765265023554_image.jpeg)

Kommentar (0)