هر جا که موجسواری میکنم، طنز بیمعنی از Veo 3 میبینم.

اخیراً، کاربران رسانههای اجتماعی، به ویژه TikTok، دائماً با ویدیوهای «کمدی» ایجاد شده توسط ابزار Veo 3 مواجه شدهاند. اگرچه بیشتر آنها سرگرمکننده هستند، اما بسیاری از محتواها شروع به انحراف از هنجار و ایجاد جنجال کردهاند.

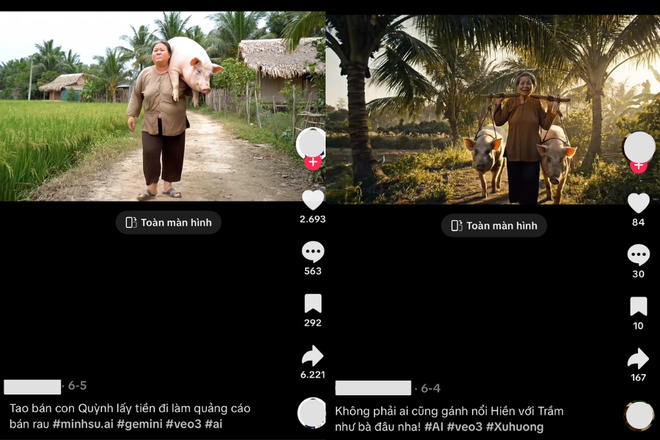

هوین مای (۲۰ ساله) به اشتراک گذاشت: «هر بار که تیکتاک را باز میکنم، ویدیوهای خندهداری با مضامین آشنا میبینم، مانند پیرزنی که به دلیل پرخوری و خواب زیاد، خوکی را برای فروش حمل میکند.»

هوین مای گفت که تیکتاک او پر از ویدیوهای «کمدی» ساخته شده توسط Veo 3 است (عکس: اسکرینشات).

مای اظهار داشت که ویدیوهای مشابه بیشتر و بیشتر ظاهر میشوند و باعث میشوند احساس ناراحتی کند و فکر کند که این ویدیوها فقط برای اهداف «طعمهگذاری برای دیده شدن» هستند و هیچ ارزشی برای بینندگان ندارند.

مای گفت که اغلب در فید خبری خود با ویدیوهای منفی یا توهینآمیز مواجه شده است: «بسیاری از کانالهای تیکتاک ویدیوهایی درباره موقعیتهای تخیلی و داستانهای واقعی میسازند که عناصر زشت، توهینآمیز و اطلاعات نادرست را فقط برای جذب بازدید در خود جای میدهند.»

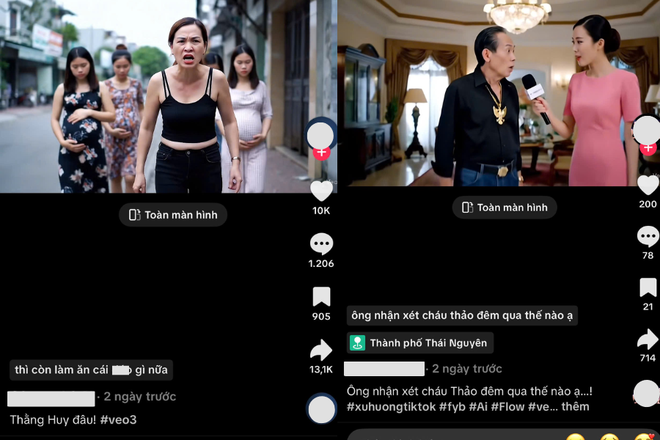

مجموعهای از محتوای توهینآمیز و تکاندهنده با هدف «جذب بازدید» ایجاد شد (عکس: اسکرینشات).

همانند داستان هوین مای، هوانگ آن (۲۰ ساله) نیز اخیراً ناامیدیهای خود را ابراز کرد. او گفت که Veo 3 تصاویر و محتوای بسیار واقعگرایانهای ارائه میدهد و بسیاری از ویدیوها با محتوای جالب و سرگرمکننده ساخته میشوند.

اما پس از مدتی، او متوجه شد که به تدریج، ویدیوهایی با گرایش به «منفی بودن» و «تکان دهنده برای جذب بازدید» به جای تمرکز بر ارزش های مثبت، بیشتر ظاهر می شوند.

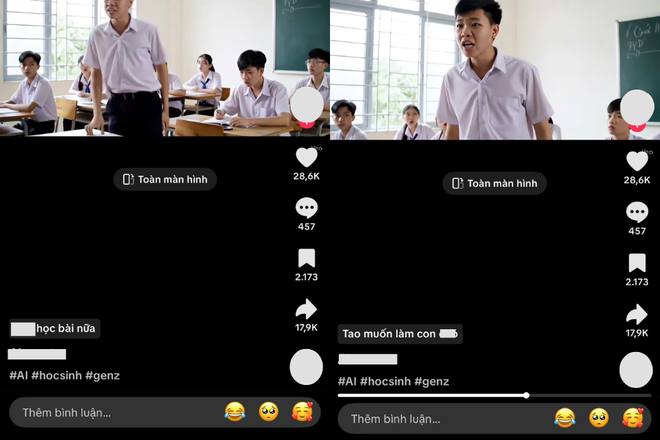

هوانگ آنه به طور محرمانه گفت: «یک دانشآموز بلند شد و فحش داد، این یکی از ویدیوهایی بود که توسط Veo 3 ساخته شده و من اخیراً تماشا کردم. من تعجب کردم که چرا چنین محتوای توهینآمیزی در رسانههای اجتماعی وجود دارد، به خصوص در دوره امتحانات بسیار مهم.»

بسیاری از ویدیوهای تولید شده توسط هوش مصنوعی با زبان و محتوای نامناسب مرتباً در شبکههای اجتماعی ظاهر میشوند (عکس: اسکرینشات).

نگرانکنندهتر اینکه، برخی ویدیوها از تصاویر شخصیتها و صدای کودکان برای بیان جملات حساس و غیراخلاقی استفاده میکنند، اما همچنان هزاران تعامل از جامعه آنلاین را به خود جذب میکنند.

علاوه بر این، بسیاری از کاربران Veo 3 نیز موقعیتهایی را برای ترویج رفتارهای انحرافی تحت پوشش محتوای صرفاً سرگرمکننده ایجاد میکنند.

معمولاً برخی از برنامهها و وبسایتها مانند قمار و شرطبندی، آشکارا ویدیوهای تبلیغاتی برای بینندگان ایجاد میکنند و مخفیانه آنها را آشکارا تحت پوشش «ویدیوهای سرگرمی» پخش میکنند.

دری به سوی بسیاری از پیامدها

غیرقابل انکار است که توسعه ابزارهای هوش مصنوعی تولید ویدیو مانند Veo 3، ضمن اینکه پتانسیل بالایی را برای بخش تولید محتوا در بسیاری از فروشگاهها و مشاغل به ارمغان میآورد، "دری" را نیز به روی پیامدهای مجازی در زندگی واقعی میگشاید.

این موضوع سوالاتی مانند «آیا بزرگسالان یا کودکان میتوانند ویدیوهای تولید شده توسط هوش مصنوعی را تشخیص دهند؟» و «این ویدیوهای توهینآمیز چگونه بر برداشت کودکان تأثیر میگذارند؟» را مطرح میکند.

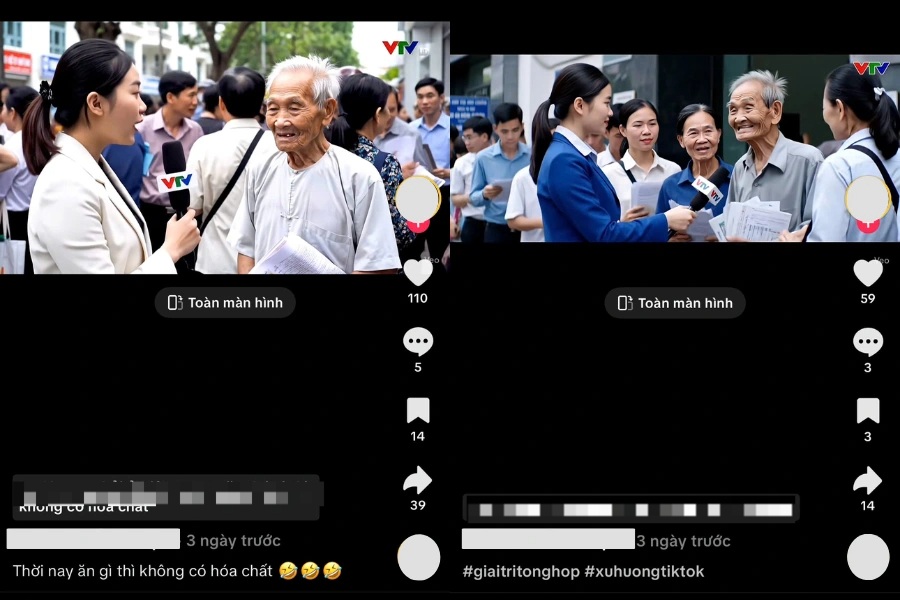

لوگوی تلویزیون ویتنام در محتوای تولید شده توسط هوش مصنوعی درج شده است (عکس: اسکرین شات).

نه تنها برای اهداف سرگرمی، بلکه بسیاری از کارشناسان در مورد خطرات احتمالی محتوای «انحرافی» ایجاد شده توسط هوش مصنوعی هشدار دادهاند. این محصولات، هنگامی که با سرعت سرسامآوری در شبکههای اجتماعی پخش میشوند، میتوانند باعث شوند که سالمندان یا کودکان منفعلانه آن را دریافت کنند و به راحتی در جهت منفی تحت تأثیر قرار گیرند.

پلتفرمهای رسانههای اجتماعی در حال حاضر با چالش بزرگی در سانسور محتوا روبرو هستند، زیرا تنها با چند مرحله ساده، هر کسی میتواند مجموعهای از ویدیوها با محتوای انحرافی ایجاد کند، حتی رفتارهای توهینآمیز، فاسد یا غیرقانونی را ترویج دهد.

این امر نه تنها از نظر محتوا خطرناک است، بلکه دسترسی و استفاده از Veo 3 در ویتنام عواقب زیادی نیز به همراه دارد. از آنجا که گوگل رسماً از این ابزار در بازار داخلی پشتیبانی نکرده است، همراه با هزینههای بالا (20 دلار در ماه برای یک حساب کاربری Pro، 250 دلار در ماه برای یک حساب کاربری Ultra)، بسیاری از علاقهمندان به فناوری راههایی برای «غلبه بر مانع» با استفاده از VPN، خرید حسابهای شناور یا اعلام اطلاعات جعلی پیدا کردهاند.

بسیاری از آنها قربانی ترفندهای "گله کردن مرغ" مانند تبلیغ حسابهای ارزان Veo 3 شدهاند که به آنها اجازه میدهد آزادانه و با ویژگیهای نامحدود استفاده کنند.

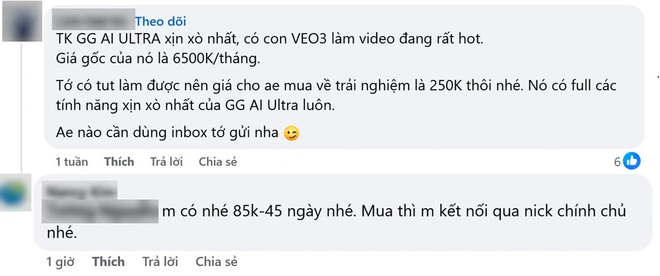

پستهایی که شما را به خرید اکانتهای ارزان Veo 3 دعوت میکنند، شبکههای اجتماعی ویتنامی را پر کردهاند (تصویر).

بسیاری از افراد شرور از نیاز به دسترسی به Veo 3 برای کلاهبرداری سوءاستفاده کردهاند و از خریداران خواستهاند که ابتدا پول را واریز کنند و سپس به سرعت و بدون هیچ ردی ناپدید شوند.

نکته قابل توجه این است که برخی افراد حتی قبول میکنند که حسابهای Veo 3 را با استفاده از آدرس Gmail مشتری با قیمتی "فوقالعاده ترجیحی" ثبت کنند. با این حال، این در واقع سوءاستفاده از یک حفره در سیاست گوگل است که به طور بالقوه خطر قفل شدن دائمی حساب را به همراه دارد، به این معنی که دسترسی به ایمیلها، اسناد و تمام اطلاعات شخصی مرتبط را از دست میدهند.

فناوری نقص ندارد

در واقع، هیچ پلتفرم هوش مصنوعی برای ایجاد محتوای منفی یا ارائه رفتارهای توهینآمیز طراحی نشده است. تمام عواقب ناشی از نحوه استفاده افراد از ابزار است، به این معنی که آگاهی و مسئولیت کاربر عوامل تعیینکننده هستند.

دکتر نگوین ون سون، مدرس دانشکده فناوری اطلاعات، دانشگاه فناوری (دانشگاه ملی ویتنام، هانوی )، اظهار داشت: «من از ارزشهای مثبتی که هوش مصنوعی به ارمغان میآورد، بسیار قدردانی میکنم. اگر به درستی استفاده شود، هوش مصنوعی میتواند کمکهای عملی زیادی به جامعه و اجتماع کند.»

با این حال، به گفته او، مشکلات زمانی بروز میکنند که فناوری به دست افرادی با انگیزههای ناسالم بیفتد. دکتر سان هشدار داد: «در آن زمان، هوش مصنوعی به ابزاری مؤثر برای حمایت از رفتارهای منفی تبدیل میشود و حتی تأثیرات بد بر جامعه را تشدید میکند.»

از آنجا، او از کاربران، به ویژه جوانان، خواست تا هنگام نزدیک شدن و به کارگیری هوش مصنوعی، آگاهی و مسئولیت خود را به طور فعال افزایش دهند و هدفشان ایجاد محتوای باکیفیت و متمدنانه به جای انتشار محصولات بیکیفیت و توهینآمیز باشد.

دکتر نگوین ون سون معتقد است که آموزش ، کلید محدود کردن تخلفات اخلاقی هنگام استفاده از هوش مصنوعی است (عکس: شخصیت ارائه شده).

علاوه بر این، دکتر نگوین ون سون همچنین معتقد است که یکی از استراتژیهای بلندمدت برای محدود کردن تخلفات اخلاقی در استفاده از هوش مصنوعی، رویکرد از منظر آموزشی است. به گفته وی، افزایش آگاهی، کمک به کاربران در درک مسئولیت شخصی و ایجاد یک پایه اخلاقی هنگام استفاده از فناوری، عامل کلیدی است که به تشکیل یک جامعه دیجیتال متمدن کمک میکند.

بسیاری از کارشناسان نه تنها به هشدارها در مورد محتوای «هرزنامه» بسنده نکردهاند، بلکه بارها موضوع خطرات احتمالی ابزارهای تولید شده توسط هوش مصنوعی، به ویژه توانایی ساخت ویدیوها را مطرح کردهاند که میتواند به منبعی برای انتشار گسترده اطلاعات نادرست تبدیل شود.

کانر لیهی، مدیرعامل شرکت کانجکچر، هشدار داد: «صنعت فناوری سالها صرف مقابله با خطرات دیپفیک کرده است. اما ظهور ابزارهای ویدیویی هوش مصنوعی که به طور فزایندهای پیشرفته میشوند، هشداری آشکار است مبنی بر اینکه تنظیم محتوای تولید شده توسط هوش مصنوعی و متعاقباً هوش مصنوعی عمومی (AGI)، تنها دشوارتر خواهد شد.»

خانم نگوین تی ترانگ - مدیرعامل شرکت Pisa Solutions LLC - با همین دیدگاه، بر اهمیت تفکر انتقادی در زمینه هوش مصنوعی که به طور فزایندهای در حال پیشرفت است، تأکید کرد.

خانم ترانگ گفت: «ما نه تنها کاربران هوش مصنوعی هستیم، بلکه دریافتکنندگان طیف گستردهای از محتوای تولید شده توسط هوش مصنوعی نیز هستیم. علاوه بر استفاده اخلاقی از ابزارها، هر فرد باید توانایی درک اطلاعات از دیدگاههای مختلف را تمرین کند، زیرا در حال حاضر ویدیوهای زیادی توسط هوش مصنوعی ساخته شدهاند که به نظر معتبر میرسند اما مخفیانه محتوای نادرست را ترویج میدهند.»

منبع: https://dantri.com.vn/cong-nghe/cu-luot-mang-lai-thay-video-hai-nham-do-ai-tao-ra-20250629181641265.htm

![[عکس] شهر هوشی مین در آستانه اولین کنگره حزب، دوره ۲۰۲۵-۲۰۳۰، با پرچمها و گلها باشکوه است](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/10/1760102923219_ndo_br_thiet-ke-chua-co-ten-43-png.webp)

![[عکس] افتتاحیه جشنواره فرهنگی جهانی در هانوی](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/10/1760113426728_ndo_br_lehoi-khaimac-jpg.webp)

![[عکس] صنایع دستی منحصر به فرد بافت کلاه اسبی در فو گیا](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/10/1760084018320_ndo_br_01-jpg.webp)

نظر (0)