Le bureau du procureur général du New Hampshire a annoncé lundi qu'il enquêtait sur une possible manipulation des électeurs suite à des plaintes concernant une fausse voix, ressemblant trait pour trait à celle du président américain Joe Biden, incitant les électeurs à ne pas voter lors des primaires de l'État.

Les chercheurs ont également mis en garde contre l'utilisation de deepfakes audio pour imiter des hommes politiques et des dirigeants, avec des cas notables survenus en 2023 au Royaume-Uni, en Inde, au Nigeria, au Soudan, en Éthiopie et en Slovaquie.

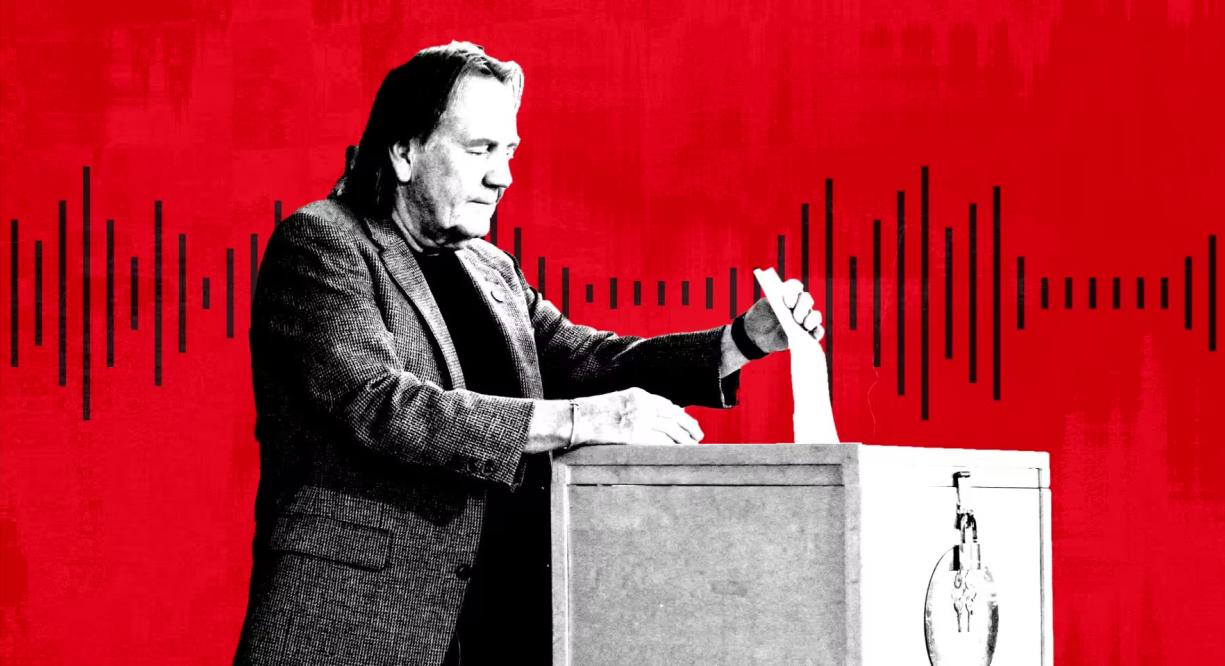

Une personne vote lors des primaires dans le New Hampshire, aux États-Unis. Photo : Getty

Les deepfakes audio sont devenus une forme courante de désinformation en raison de l'émergence, chez les start-ups, d'outils d'IA performants et peu coûteux, selon les experts. Microsoft a également développé un nouveau modèle d'IA capable de copier des voix à partir de seulement trois secondes d'enregistrement.

« En matière de manipulation visuelle, tout le monde connaît Photoshop, ou du moins sait qu'il existe », explique Henry Ajder, expert en IA et deepfake, consultant chez Adobe, Meta et EY. « On ignore presque tout des possibilités de manipulation audio, ce qui nous rend particulièrement vulnérables. »

En septembre, NewsGuard, un système d'évaluation de la qualité et de la fiabilité des sites d'information, a découvert un réseau de comptes TikTok se faisant passer pour des sites d'information légitimes. Ces comptes utilisaient du contenu généré par intelligence artificielle pour diffuser des théories du complot et de la désinformation politique. Des enregistrements truqués, notamment avec la voix de l'ancien président américain Barack Obama, ont cumulé des centaines de millions de vues.

Les fausses voix off semblent avoir été générées par un outil fourni par ElevenLabs, une société soutenue par Andreessen Horowitz, tandis que les clips ont cumulé des centaines de millions de vues, selon NewsGuard.

« Plus de 99 % des utilisateurs de notre plateforme créent du contenu intéressant, créatif et utile, mais nous reconnaissons qu'il existe des cas d'utilisation abusive et nous avons continuellement développé et mis en place des protections pour les limiter », a déclaré ElevenLabs.

ElevenLabs, fondée il y a deux ans par Piotr Dabkowski et Mati Staniszewski, anciens employés de Google et Palantir, propose gratuitement des outils de génération audio par IA basiques, accessibles en un clic. Les abonnements varient de 1 $ à 330 $ par mois, voire plus pour ceux qui recherchent des services plus complexes.

L’année dernière, les agences de renseignement américaines ont averti dans un rapport que « les escroqueries utilisant l’IA personnalisée ont considérablement augmenté en raison de la diffusion de modèles de clonage vocal sophistiqués et bien entraînés par l’IA ».

Outre les escroqueries à motivation financière, les experts politiques tirent désormais la sonnette d'alarme concernant la diffusion virale de faux enregistrements audio (deepfakes) et leur utilisation dans le cadre d'appels automatisés ou de campagnes de désinformation. « Cibler les téléphones permet de mener une campagne de désinformation puissante et de grande envergure », a déclaré AJ Nash, vice-président et expert en renseignement au sein du groupe de cybersécurité ZeroFox.

Certaines de ces entreprises ont pris l'initiative de trouver d'autres moyens de lutter contre la désinformation. Microsoft a publié une déclaration d'éthique, incitant les utilisateurs à signaler tout usage abusif de son outil audio basé sur l'IA. ElevenLabs a développé ses propres outils de détection pour identifier les enregistrements audio créés par son système.

Lors des élections nigérianes de 2023, une vidéo manipulée par intelligence artificielle est devenue virale sur les réseaux sociaux, « laissant entendre qu'un candidat de l'opposition prévoyait de truquer le scrutin », selon l'organisation de défense des droits humains Freedom House.

En Slovaquie, un faux enregistrement audio du candidat de l'opposition Michal Šimečka, apparemment en train de comploter pour truquer l'élection, est devenu viral quelques jours seulement avant l'élection présidentielle du pays en septembre.

« La vidéo truquée du New Hampshire nous rappelle les nombreuses façons dont les deepfakes peuvent induire en erreur et tromper », a déclaré Robert Weissman, président de l’association de défense des consommateurs Public Citizen. « L’ère des deepfakes politiques est arrivée. Les décideurs politiques doivent agir rapidement pour mettre en place des garde-fous, sous peine de voir le chaos électoral s’installer. »

Mai Anh (selon le Financial Times)

Source

![[Photo] Le Premier ministre Pham Minh Chinh reçoit le président de l'Agence de presse latino-américaine de Cuba](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F01%2F1764569497815_dsc-2890-jpg.webp&w=3840&q=75)

Comment (0)