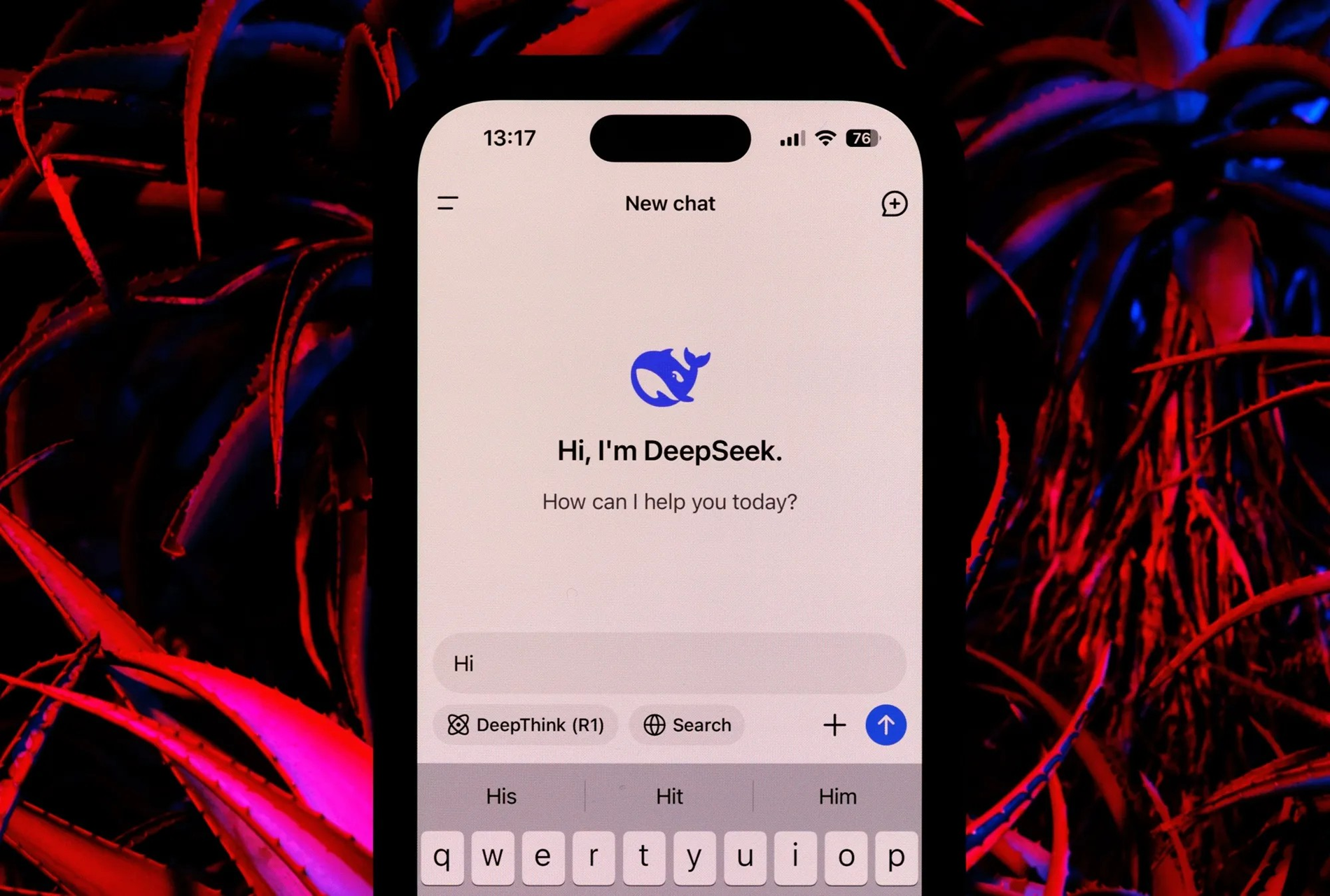

हाल के दिनों में सबसे चर्चित चीनी स्टार्टअप डीपसीक के मात्र 5 मिलियन डॉलर के निवेश से ओपनएआई के समकक्ष एआई बनाने के दावे पर संदेह पैदा हो गया है।

सर्प वर्ष की शुरुआत में डीपसीक ने व्यापक मीडिया कवरेज और सोशल मीडिया कवरेज हासिल की, जिससे वैश्विक शेयर बाजारों में महत्वपूर्ण हलचल मच गई।

हालांकि, वित्तीय परामर्श फर्म बर्नस्टीन की एक हालिया रिपोर्ट चेतावनी देती है कि प्रभावशाली उपलब्धियों के बावजूद, केवल 5 मिलियन डॉलर में ओपनएआई के समकक्ष एआई सिस्टम बनाने का दावा गलत है।

बर्नस्टीन के अनुसार, डीपसीक का बयान भ्रामक है और व्यापक परिदृश्य को प्रतिबिंबित नहीं करता है।

रिपोर्ट में कहा गया है , "हमारा मानना है कि डीपसीक ने 'सिर्फ 5 मिलियन डॉलर से ओपनएआई नहीं बनाया'; मॉडल शानदार हैं लेकिन हमें नहीं लगता कि वे चमत्कार हैं; और सप्ताहांत में फैली घबराहट कुछ ज्यादा ही बढ़ा-चढ़ाकर बताई गई लगती है।"

DeepSeek दो मुख्य AI मॉडल विकसित करता है: DeepSeek-V3 और DeepSeek R1। बड़े पैमाने पर विकसित V3 भाषा मॉडल MOE आर्किटेक्चर का लाभ उठाता है, जो पारंपरिक मॉडलों की तुलना में कम कंप्यूटिंग संसाधनों का उपयोग करते हुए उच्च प्रदर्शन प्राप्त करने के लिए छोटे मॉडलों को संयोजित करता है।

दूसरी ओर, V3 मॉडल में 671 बिलियन पैरामीटर हैं, जिनमें से 37 बिलियन पैरामीटर किसी भी समय सक्रिय रहते हैं, और इसमें मेमोरी के उपयोग को कम करने के लिए MHLA जैसी नवीन तकनीकों को शामिल किया गया है और अधिक दक्षता के लिए FP8 का उपयोग किया गया है।

V3 मॉडल को प्रशिक्षित करने के लिए दो महीने की अवधि में 2,048 Nvidia H800 GPU के क्लस्टर की आवश्यकता थी, जो 5.5 मिलियन GPU घंटों के बराबर है। हालांकि कुछ अनुमानों के अनुसार प्रशिक्षण लागत लगभग 5 मिलियन डॉलर थी, बर्नस्टीन की रिपोर्ट इस बात पर जोर देती है कि यह आंकड़ा केवल कंप्यूटिंग संसाधनों को कवर करता है और इसमें अनुसंधान, परीक्षण और अन्य विकास संबंधी महत्वपूर्ण लागतें शामिल नहीं हैं।

डीपसीक आर1 मॉडल, रीइन्फोर्समेंट लर्निंग (आरएल) और अन्य तकनीकों का उपयोग करके वी3 की नींव पर आधारित है, ताकि अनुमान लगाने की क्षमता सुनिश्चित हो सके।

R1 मॉडल तर्क संबंधी कार्यों में OpenAI मॉडलों के साथ प्रतिस्पर्धा कर सकता है। हालांकि, बर्नस्टीन बताते हैं कि R1 के विकास के लिए महत्वपूर्ण संसाधनों की आवश्यकता होती है, हालांकि डीपसीक रिपोर्ट में इनका विस्तृत विवरण नहीं दिया गया है।

डीपसीक पर टिप्पणी करते हुए, बर्नस्टीन ने मॉडलों की प्रशंसा करते हुए उन्हें प्रभावशाली बताया। उदाहरण के लिए, V3 मॉडल भाषाविज्ञान, प्रोग्रामिंग और गणित में अन्य प्रमुख भाषा मॉडलों के बराबर या उनसे बेहतर प्रदर्शन करता है, जबकि इसके लिए कम संसाधनों की आवश्यकता होती है।

V3 की प्री-ट्रेनिंग प्रक्रिया में केवल 2.7 मिलियन जीपीयू घंटे का काम लगा, जो कुछ अन्य शीर्ष स्तरीय मॉडलों के कंप्यूटिंग संसाधनों का केवल 9% है।

बर्नस्टीन ने निष्कर्ष निकाला कि डीपसीक की प्रगति सराहनीय है, लेकिन अतिरंजित दावों से सावधान रहना चाहिए। मात्र 5 मिलियन डॉलर में ओपनएआई का प्रतिस्पर्धी बनाने का विचार भ्रामक प्रतीत होता है।

(टाइम्स ऑफ इंडिया के अनुसार)

[विज्ञापन_2]

स्रोत: https://vietnamnet.vn/deepseek-khong-the-lam-ai-tuong-duong-openai-voi-5-trieu-usd-2367340.html

![[छवि] केंद्रीय पार्टी कार्यालय ने 2025 के कार्यों का सारांश प्रस्तुत किया](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F18%2F1766065572073_vptw-hoi-nghi-tong-ket-89-1204-jpg.webp&w=3840&q=75)

![[वीडियो] इतिहास और विरासत संरक्षण पर दो पुस्तकों का विमोचन](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/18/1766072185865_2663241292917005256-4230-jpg.webp)

टिप्पणी (0)