|

오픈AI의 챗봇은 새로운 기술을 통해 끊임없이 발전하고 있다. 사진: 뉴욕 타임스 |

2024년 9월, OpenAI는 수학, 과학 , 컴퓨터 프로그래밍 관련 작업에서 추론할 수 있는 o1 모델을 통합한 AI 버전인 ChatGPT를 출시했습니다.

이전 버전의 ChatGPT와 달리, 새로운 기술은 복잡한 문제에 대한 해결책을 제시하기 전에 시간을 두고 "생각"하는 과정을 거칩니다.

오픈아이(OpenAI)에 이어 구글, 앤스로픽, 딥시크 등 여러 경쟁사들도 유사한 추론 모델을 선보였습니다. 완벽하지는 않지만, 이는 여전히 많은 개발자들이 신뢰하는 챗봇 업그레이드 기술입니다.

인공지능은 어떻게 추론하는가

본질적으로 추론 능력은 챗봇이 사용자가 제기하는 문제를 해결하는 데 더 많은 시간을 할애할 수 있음을 의미합니다.

캘리포니아 대학교 컴퓨터 과학 교수인 댄 클라인은 뉴욕 타임스와 의 인터뷰에서 "추론이란 시스템이 질문을 받은 후 추가적인 작업을 수행하는 방식"이라고 말했다.

논리적인 시스템은 문제를 더 작고 개별적인 단계로 나누거나 시행착오를 통해 해결할 수 있습니다.

ChatGPT는 처음 출시되었을 때 정보를 추출하고 종합하여 질문에 즉시 답변할 수 있었습니다. 반면, 추론 시스템은 문제를 해결하고 답변을 제공하는 데 몇 초(또는 몇 분)가 더 걸렸습니다.

|

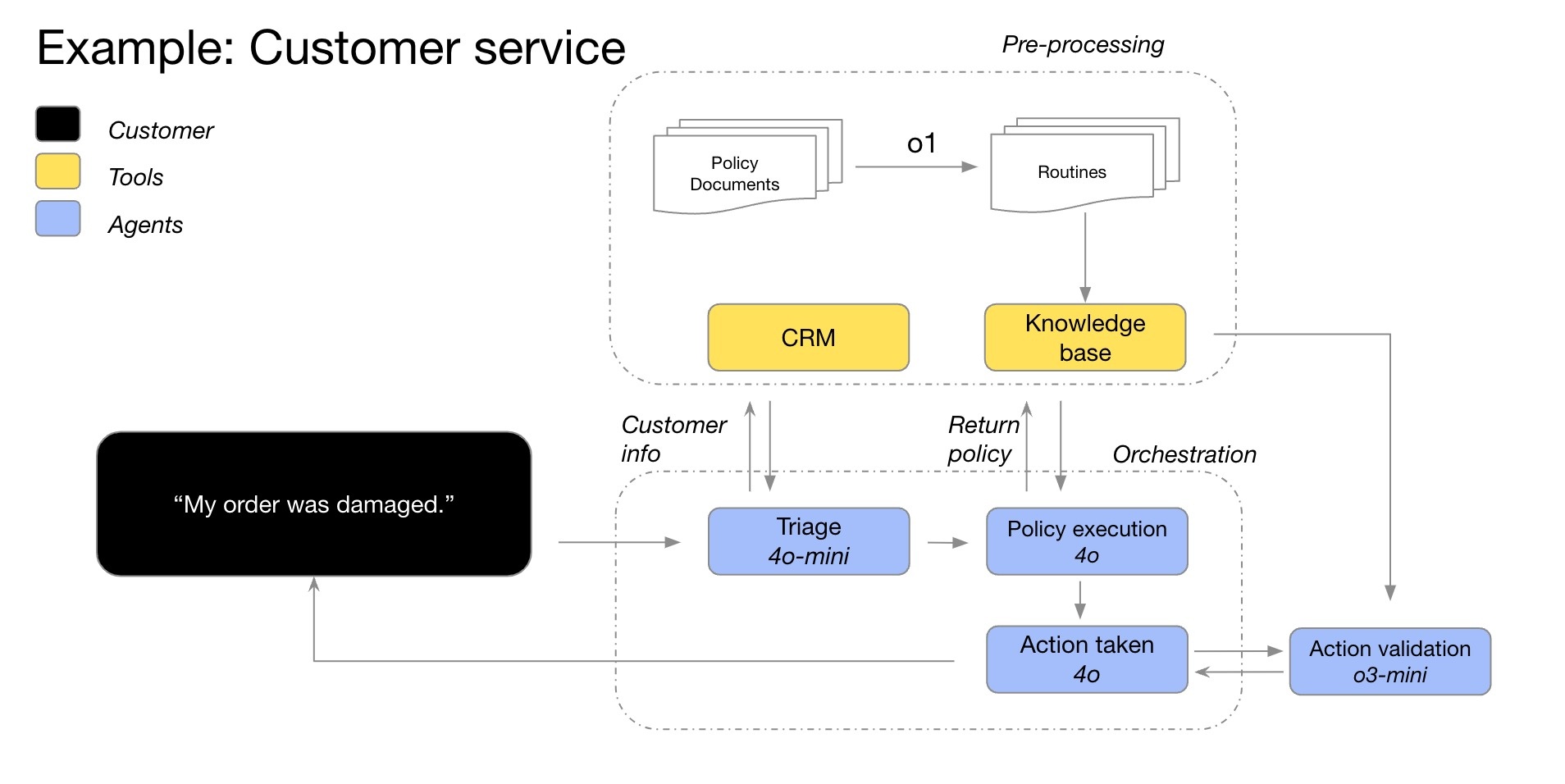

고객 서비스 챗봇에서 O1 모델의 추론 과정을 보여주는 예시 이미지. 이미지 출처: OpenAI |

경우에 따라 추론 시스템은 문제에 대한 접근 방식을 변경하여 솔루션을 지속적으로 개선합니다. 또한 모델은 최적의 선택을 하기 전에 여러 솔루션을 테스트하거나 이전 응답의 정확성을 확인할 수 있습니다.

일반적으로 추론 시스템은 질문에 대한 모든 가능한 답을 고려합니다. 이는 초등학생이 수학 문제를 풀기 전에 여러 가지 선택지를 종이에 적어보고 가장 적절한 답을 고르는 것과 유사합니다.

뉴욕 타임스 에 따르면, 인공지능은 이제 거의 모든 주제에 대해 추론할 수 있습니다. 하지만 수학, 과학, 컴퓨터 프로그래밍 관련 질문에서 가장 효과적인 성능을 발휘할 것입니다.

이론 시스템은 어떻게 훈련되는가?

일반적인 챗봇에서 사용자는 여전히 프로세스에 대한 설명을 요청하거나 응답의 정확성을 확인할 수 있습니다. 실제로 많은 ChatGPT 학습 데이터 세트에는 이미 문제 해결 절차가 포함되어 있습니다.

추론 시스템은 사용자 입력 없이 연산을 수행할 수 있게 되면 더욱 발전된 형태를 갖추게 됩니다. 이러한 과정은 더욱 복잡하고 광범위해집니다. 기업들이 "추론"이라는 용어를 사용하는 이유는 이 시스템이 인간의 사고방식과 유사하게 작동하기 때문입니다.

오픈아이(OpenAI)와 같은 많은 기업들은 추론 시스템이 현재 사용 가능한 챗봇의 성능을 향상시키는 데 가장 적합한 해결책이 될 것이라고 기대하고 있습니다. 수년 동안 이들은 챗봇이 인터넷에서 학습하는 정보가 많을수록 성능이 향상된다고 믿어왔습니다.

2024년까지 AI 시스템은 인터넷에서 이용 가능한 거의 모든 텍스트를 소진할 것입니다. 따라서 기업들은 추론 시스템을 포함하여 챗봇을 업그레이드할 새로운 솔루션을 찾아야 합니다.

|

스타트업 딥시크(DeepSeek)는 한때 오픈아이얼(OpenAI)보다 비용이 낮은 추론 모델로 센세이션을 일으켰다. 사진: 블룸버그 . |

작년부터 OpenAI와 같은 기업들은 강화 학습 기술에 집중해 왔습니다. 이 과정은 일반적으로 몇 달이 걸리며, 이 기간 동안 AI는 시행착오를 통해 행동을 학습합니다.

예를 들어, 수천 개의 문제를 해결함으로써 시스템은 정답에 도달하는 최적의 방법을 찾아낼 수 있습니다. 이를 바탕으로 연구원들은 시스템이 정답과 오답을 구분할 수 있도록 정교한 피드백 메커니즘을 구축합니다.

"개를 훈련시키는 방식과 비슷합니다. 시스템이 잘 작동하면 간식을 주고, 그렇지 않으면 '저 개는 버릇없어'라고 말하죠."라고 오픈AI의 연구원인 제리 트워렉은 설명했습니다.

인공지능이 미래일까요?

뉴욕 타임스 에 따르면, 강화 학습 기법은 수학, 과학, 컴퓨터 프로그래밍 분야의 요구 사항을 다룰 때 효과적입니다. 이러한 분야는 정답과 오답을 명확하게 정의할 수 있는 분야입니다.

반대로, 강화 학습은 글쓰기, 철학, 윤리학처럼 선과 악을 구분하기 어려운 분야에서는 효과적이지 않습니다. 그럼에도 불구하고 연구자들은 이 기술이 비수학적인 문제에서도 인공지능의 성능을 향상시킬 수 있다고 주장합니다.

앤트로픽의 최고과학책임자인 재러드 카플란은 "시스템은 긍정적인 결과와 부정적인 결과로 이어지는 경로를 학습할 것"이라고 말했다.

|

인공지능 모델 클로드를 소유한 스타트업 앤트로픽의 웹사이트. 사진: 블룸버그 . |

강화 학습과 추론 시스템은 서로 다른 개념이라는 점을 유념해야 합니다. 구체적으로 말하자면, 강화 학습은 추론 시스템을 구축하는 방법입니다. 이는 챗봇이 추론할 수 있도록 하는 최종 훈련 단계입니다.

챗봇 추론이나 강화 학습은 아직 비교적 새로운 기술이기 때문에 과학자들은 인공지능이 인간처럼 생각하는 데 도움이 될 수 있는지 확신할 수 없습니다. 또한, 현재의 많은 인공지능 훈련 방식은 초기에는 매우 빠르게 발전하다가 점차 속도가 느려지는 경향이 있다는 점에 유의해야 합니다.

게다가 챗봇의 추론은 여전히 오류를 범할 수 있습니다. 시스템은 확률에 기반하여 인터넷이나 강화 학습을 통해 학습한 데이터와 가장 유사한 프로세스를 선택합니다. 따라서 챗봇은 여전히 잘못되거나 비논리적인 해결책을 선택할 수 있습니다.

출처: https://znews.vn/ai-ly-luan-nhu-the-nao-post1541477.html

댓글 (0)