WSJ 기자 조안나 스턴은 AI를 이용해 가짜 자신을 만들어 가족과 은행 시스템을 속이려고 했습니다.

인공지능을 이용하여 영상 에 얼굴을 삽입하거나 가짜 음성을 삽입하는 딥페이크(deepfake)는 점점 더 보편화되고 위험해지고 있습니다. 이는 인터넷에서 실제로 발생할 수 있는 위험입니다.

민감한 영상뿐만 아니라, 딥페이크는 정치적 목적으로 사용될 경우 심각한 피해를 초래할 수 있습니다. 2018년에 화제가 된 버락 오바마 전 미국 대통령의 얼굴이 변형된 영상은 주요 정치인들 또한 피해자가 될 수 있음을 보여주었습니다.

|

딥페이크 포르노가 전 세계적인 문제가 되고 있다. 사진: Wired. |

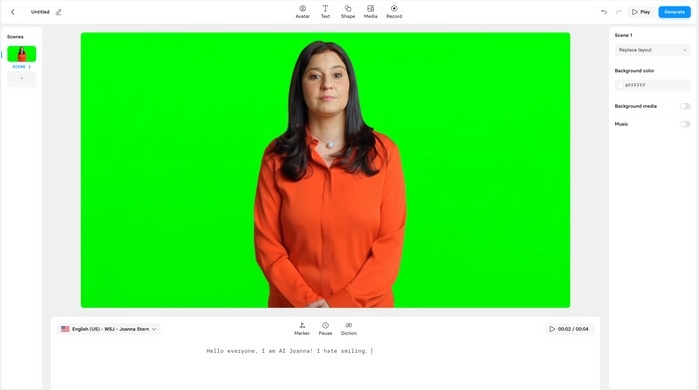

AI의 효과를 시험하기 위해 WSJ 기자 조애나 스턴은 딥페이크 도구인 신테시아(Synthesia)를 사용하여 자신의 모의 버전을 만들었습니다. 그 결과, 복제된 인공지능은 그녀의 가족과 은행 시스템을 모두 속였습니다.

완벽한 사본

스턴은 자신을 복제하는 여정을 회상하며, 수개월 동안 Synthesia를 실험하고 원본 비디오와 오디오 파일을 통해 AI를 훈련시켰다고 말했습니다.

이 도구를 사용하는 방법도 매우 간단합니다. 사용자가 텍스트를 입력하기만 하면 해당 콘텐츠에 대한 음성이 담긴 새로운 비디오를 받게 됩니다.

스턴은 "대사와 화면을 많이 다루는 제 직업의 특성상 AI가 제 효율성을 높이고 힘든 작업 중 일부를 덜어줄 수 있을 거라고 생각했습니다."라고 말했습니다.

|

조안나 스턴이 신테시아의 AI를 훈련하기 위해 자신의 목소리를 녹음하고 있다. 사진: WSJ |

WSJ 기자는 이 도구를 훈련시키기 위해 녹음실에 가서 약 30분 동안 자신의 모습을 촬영하고 두 시간 동안 자신의 목소리를 녹음했습니다. 몇 주 만에 스턴이 '조안나 AI'라고 이름 붙인 가상 버전이 제 역할을 할 준비가 되었습니다.

스턴은 휴가를 이용해 조안나 AI를 활용했습니다. 첫 번째 과제로, WSJ 기자는 ChatGPT를 사용하여 iOS 팁을 소개하는 TikTok 영상의 대본을 작성했습니다.

스턴은 텍스트를 신테시아에 붙여넣었습니다. 초기화 후, 그녀의 목소리가 영상 위로 흘러나왔습니다. "마치 거울에 비친 제 모습을 보는 것 같았어요. 손짓과 표정이 조금 달랐지만요. 정말 설득력 있었어요."라고 기자는 말했습니다.

스턴은 조안나 AI가 짧은 문장에서는 인상적인 모방 능력을 보였지만, 문장이 길어질수록 약점이 드러난다고 말했습니다.

스턴은 이것이 바로 숏폼 비디오 플랫폼이 AI에 가장 적합한 환경인 이유라고 말했습니다. 그녀에 따르면, 사용자들은 틱톡 비디오의 세부 사항에 덜 집중하는 경우가 많아 컴퓨터와 유사한 특징을 놓치기 쉽다고 합니다.

Stern은 전화 통화 시 Synthesia 대신 ElevenLabs라는 또 다른 AI 앱을 사용합니다. 이 AI 음성 소프트웨어는 사용자가 녹음 스튜디오에 갈 필요 없이 오디오 파일을 업로드하기만 하면 된다는 장점이 있습니다.

|

스턴은 조안나 AI가 짧은 문장을 흉내 내는 능력이 뛰어나다고 말했다. 사진: WSJ |

WSJ 기자는 ElevenLabs가 단 2분 만에 자신의 목소리를 복제해 낸 것에 놀랐습니다. 특히 이 애플리케이션의 사용료는 월 5달러 정도에 불과합니다.

스턴은 신테시아와 비교했을 때 일레븐랩스의 복제된 목소리가 더 인간적으로 들리고, 음정과 발음이 좋다고 말했습니다.

기자는 AI의 신뢰성을 시험하기 위해 친척과 직접 대화해 보았습니다. 스턴의 여동생은 AI의 목소리가 자신과 매우 비슷했지만, 숨을 고르기 위해 잠시 멈추지 않았다고 말했습니다.

한편, 스턴이 AI 음성을 사용해 아버지에게 전화해 사회보장번호를 물었을 때, 뭔가 잘못되었다는 것을 바로 깨달았습니다. 마치 녹음된 오디오 파일처럼 들렸기 때문입니다.

은행을 속이다

가장 주목할 만한 점은 AI가 매우 효과적이어서 스턴의 체이스 신용카드에 사용된 음성 생체 인식 시스템을 속일 수 있었다는 것입니다.

WSJ 기자는 먼저 조안나 AI에게 체이스가 물어볼 몇 가지 질문을 던졌습니다. 그런 다음 그녀는 고객 서비스에 전화를 걸어 AI가 대답하도록 했습니다.

|

AI는 스턴의 체이스 신용카드에 사용된 음성 생체 인식 시스템을 속일 만큼 효과적이었다. 사진: WSJ |

생체 인식 단계에서 자동화 시스템이 조안나의 이름과 주소를 묻자 조안나 AI는 공식적으로 응답했습니다. 조안나가 AI의 목소리를 듣자마자 체이스의 시스템은 즉시 스턴이라는 것을 인식하고 은행 담당자에게 연결해 주었습니다.

테스트가 성공적으로 끝난 후, 스턴은 체이스에 직접 연락하여 은행과 아무런 거래도 없다고 말했습니다.

체이스 대변인은 나중에 은행이 발신자를 확인하기 위해 음성 생체 인식과 기타 도구를 사용한다고 밝혔습니다.

체이스는 이 기능이 고객이 신속하고 안전하게 신원을 확인하는 데 도움이 되도록 고안되었지만, 거래 및 기타 금융 요청을 완료하려면 고객이 추가 정보를 제공해야 한다고 덧붙였습니다.

하지만 가장 우려스러운 점은 ElevenLabs와 같은 앱들이 별다른 문제 없이 아주 훌륭한 복제본을 만들어냈다는 것입니다. 사용자는 책임 정책에 동의하기만 하면 오디오 파일을 업로드하고 직접 복제본을 만들 수 있습니다.

WSJ 의 테스트 이후, ElevenLabs는 사기성 또는 불법 콘텐츠를 제작하는 것으로 보이는 계정을 차단할 것이라고 밝혔습니다. 또한, 이 스타트업은 자사 플랫폼에서 제작된 동영상에 AI 라벨링 도구를 개발하고 있습니다.

한편, 신테시아는 사용자가 오디오 및 비디오 파일에 대해 구두로 동의하도록 요구하는데, 이것이 스턴이 회사와 함께 스튜디오에 가서 촬영하고 라이브로 녹음해야 했던 이유입니다.

|

Synthesia의 사용법은 간단합니다. 텍스트를 입력하면 사용자는 해당 콘텐츠에 대한 자신의 음성이 담긴 새로운 비디오를 받게 됩니다. 사진: WSJ. |

연방수사국(FBI) 대변인인 시오반 존슨에 따르면, 미국 가정은 평균적으로 사기 전화 한 통으로 약 11,000달러의 손실을 입습니다.

미국 연방거래위원회(FTC)의 2022년 자료에 따르면 미국인들은 사기 전화로 인해 총 26억 달러 의 피해를 입었습니다.

저렴하고 접근하기 쉬운 AI 프로그램이 개발되면서 사기꾼들은 자유롭게 목소리를 복제하고 원본과 똑같은 대화를 만들어낼 수 있게 되었습니다.

"이 위협은 단순한 가정이 아닙니다. 사기꾼들이 이러한 도구를 무기화하고 있습니다. 1분도 채 안 되는 짧은 음성으로도 비교적 정확한 음성 복제본을 만들 수 있습니다. 어떤 사람들에게는 몇 초면 충분합니다."라고 캘리포니아 대학교 버클리 캠퍼스 컴퓨터 과학과 교수인 하니 파리드는 말했습니다.

[광고_2]

소스 링크

댓글 (0)