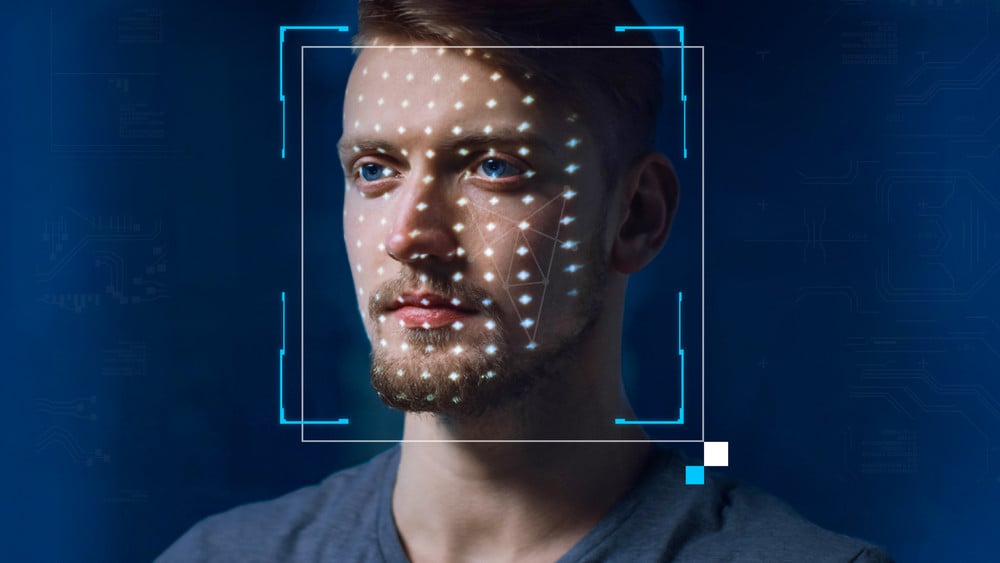

ດ້ວຍຕົ້ນທຶນພຽງແຕ່ປະມານ 1,3 ລ້ານດົ່ງ, ເຄື່ອງມືປອມເຊັ່ນ: ການປ່ຽນໃບໜ້າ ແລະ ການປອມແປງດ້ວຍສຽງ ແມ່ນການເຕືອນໄພກ່ຽວກັບຄວາມສ່ຽງຂອງການສໍ້ໂກງ, ຮູບພາບສ່ວນຕົວປອມ ແລະ ຜົນສະທ້ອນດ້ານຄວາມປອດໄພທາງອິນເຕີເນັດ.

(ຮູບປະກອບ)

ລາຄາລາຄາຖືກໃນ darknet, ອັນຕະລາຍທີ່ຍິ່ງໃຫຍ່ທີ່ເຊື່ອງໄວ້

ທີມວິໄຈ ແລະວິເຄາະທົ່ວໂລກຂອງ Kaspersky (GReAT) ໄດ້ເຜີຍແຜ່ຜົນການຄົ້ນພົບທີ່ສະແດງໃຫ້ເຫັນວ່າມີການໂຄສະນາຫຼາຍອັນທີ່ໃຫ້ບໍລິການເພື່ອສ້າງ ວິດີໂອ ແລະສຽງທີ່ປອມຕົວແບບເລິກເຊິ່ງໃນເວລາຈິງໄດ້ປາກົດຢູ່ໃນຕະຫຼາດມືດ. ລາຄາເລີ່ມຕົ້ນຖືກບັນທຶກຢູ່ທີ່ປະມານ 50 USD (ປະມານ 1,3 ລ້ານດົ່ງ) ແລະ 30 USD (ປະມານ 800,000 ດົ່ງ) ສໍາລັບຂໍ້ຄວາມສຽງປອມ, ຂຶ້ນກັບຄວາມສັບສົນ ແລະຄວາມຍາວຂອງເນື້ອໃນ.

ກ່ອນຫນ້ານີ້, ການບໍລິການປອມແປງ "ທີ່ຖືກຕ້ອງຕາມກົດຫມາຍ" ມີມູນຄ່າລະຫວ່າງ $ 300 ຫາ $ 20,000 ຕໍ່ນາທີ.

ການຫຼຸດລົງຂອງລາຄາ - 400 ເທົ່າຕ່ໍາກວ່າລະດັບທີ່ນິຍົມທີ່ຜ່ານມາ - ເຮັດໃຫ້ຄວາມສ່ຽງຕໍ່ການຖືກຂູດຮີດສໍາລັບການກະທໍາທີ່ບໍ່ດີກໍ່ສູງຂຶ້ນ.

ລັກສະນະການໂຄສະນາແລະ "bait" ຂອງຄົນບໍ່ດີ

ດຽວນີ້ໂຄສະນາໄປເໜືອກວ່າວິດີໂອປອມແບບງ່າຍໆເພື່ອລວມເອົາການປ່ຽນໃບໜ້າໃນເວລາຈິງໃນລະຫວ່າງການໂທວິດີໂອ, ກ້ອງອຸປະກອນປອມ ຫຼື “ປ່ຽນ” ໃບໜ້າເພື່ອຂ້າມຜ່ານການກວດສອບ. ພວກເຂົາຍັງໂຄສະນາຄວາມສາມາດໃນການຊິງຄ໌ການສະແດງອອກທາງຫນ້າດ້ວຍການເວົ້າສຽງ, ແລະແມ້ກະທັ້ງສະຫນັບສະຫນູນຫຼາຍພາສາ.

ນອກຈາກນັ້ນ, ການບໍລິການ "ໂຄນສຽງ" ຍັງຖືກຂາຍ, ອະນຸຍາດໃຫ້ເຮັດຕາມສຽງທີ່ມີຄວາມສາມາດໃນການປັບສຽງແລະສຽງເພື່ອສະແດງຄວາມຮູ້ສຶກທີ່ແຕກຕ່າງກັນ. ຢ່າງໃດກໍຕາມ, ຜູ້ຊ່ຽວຊານຫຼາຍຄົນສົງໃສວ່ານີ້ແມ່ນການໂຄສະນາ "ລູກຄ້າລ້າໆ" - ຜູ້ຊື້ອາດຈະຖືກຫລອກລວງໃຫ້ໂອນເງິນລ່ວງຫນ້າ, ແຕ່ບໍ່ໄດ້ຮັບສິນຄ້າທີ່ມີຄຸນນະພາບຕາມສັນຍາ.

"ຄວາມຕ້ອງການທີ່ຈະນໍາໃຊ້ເຄື່ອງມືນີ້ຍັງເພີ່ມຂຶ້ນ"

Dmitry Galov , ຫົວຫນ້າທີມ GReAT ຂອງ Kaspersky (ລັດເຊຍແລະ CIS) .

cybercriminals ກໍາລັງທົດລອງແລະລວມເອົາ AI ເຂົ້າໃນຍຸດທະສາດການໂຈມຕີຂອງພວກເຂົາ, ທ່ານກ່າວວ່າ, ດ້ວຍບາງເວທີກໍ່ພັດທະນາ LLMs "ອັນຕະລາຍ" ຂອງຕົນເອງ, ແຍກຕ່າງຫາກຈາກຕົວແບບສາທາລະນະແລະສາມາດດໍາເນີນການໂດຍກົງໃນອຸປະກອນຂອງຄົນບໍ່ດີ.

ໃນຂະນະທີ່ deepfakes ຍັງບໍ່ສາມາດຖືກພິຈາລະນາວ່າເປັນໄພຂົ່ມຂູ່ທາງອິນເຕີເນັດໃຫມ່ຢ່າງສົມບູນ, ເຕັກໂນໂລຢີສາມາດເຮັດໃຫ້ການໂຈມຕີມີຄວາມຊັບຊ້ອນຫຼາຍແລະຍາກທີ່ຈະກວດພົບ.

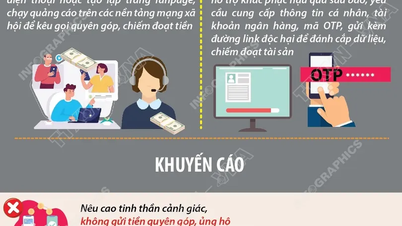

ຄໍາແນະນໍາແລະວິທີການກໍານົດ deepfake

Kaspersky ແນະນໍາວ່າທຸລະກິດແລະອົງການຈັດຕັ້ງຈໍາເປັນຕ້ອງໄດ້ນໍາໃຊ້ມາດຕະການຄວາມປອດໄພ cyber ທີ່ສົມບູນແບບ, ບໍ່ພຽງແຕ່ຢຸດເຊົາການຕິດຕັ້ງຊອບແວປ້ອງກັນ, ແຕ່ຍັງສ້າງທີມງານຜູ້ຊ່ຽວຊານດ້ານໄອທີທີ່ມີທັກສະໃນການກວດສອບແລະຕອບສະຫນອງ.

ນອກຈາກນັ້ນ, ພະນັກງານພາຍໃນອົງການຄວນໄດ້ຮັບການຝຶກອົບຮົມເພື່ອຮັບຮູ້ສັນຍານທີ່ຜິດປົກກະຕິໃນວິດີໂອຫຼືສຽງທີ່ອາດຈະເປັນຜະລິດຕະພັນຂອງເຕັກໂນໂລຊີ deepfake. ວິດີໂອເຫຼົ່ານີ້ມັກຈະມີການເຄື່ອນໄຫວທີ່ກະພິບ ແລະຜິດປົກກະຕິ, ແສງບໍ່ສອດຄ່ອງ ຫຼືສີຜິວລະຫວ່າງກອບ, ຕົວອັກສອນທີ່ປາກົດດ້ວຍຄວາມຖີ່ຂອງການກະພິບຕາທີ່ຜິດປົກກະຕິ ຫຼືເກືອບບໍ່ມີການກະພິບ, ແລະໃບຫນ້າທີ່ອາດຈະບິດເບືອນ ຫຼືຜິດປົກກະຕິເລັກນ້ອຍ.

ນອກຈາກນັ້ນ, ຄຸນນະພາບຮູບພາບມັກຈະບໍ່ດີ ແລະເຟຣມບໍ່ຄົງທີ່, ໂດຍສະເພາະໃນບ່ອນທີ່ມີແສງໜ້ອຍ, ເຮັດໃຫ້ວິດີໂອໂດຍລວມເບິ່ງບໍ່ສົມຈິງ. ການລະມັດລະວັງກ່ຽວກັບການຂົ່ມຂູ່ຂອງປອມເລິກແລະການສ້າງຄວາມຮັບຮູ້ແມ່ນເຫັນວ່າເປັນບາດກ້າວທໍາອິດທີ່ສໍາຄັນເພື່ອຫຼຸດຜ່ອນຄວາມເສຍຫາຍຈາກການຫລອກລວງທີ່ສັບສົນໃນຍຸກ AI.

ທີ່ມາ: https://doanhnghiepvn.vn/chuyen-doi-so/rui-ro-tu-deepfake-gia-re-tu-quang-cao-darknet-den-loi-keu-goi-canh-giac/20251016105304840

![[ຮູບພາບ] ໜັງສືພິມ Nhan Dan ເປີດຕົວ “ບັນດາປະເທດໃນໃຈ: ຟິມຄອນເສີດ”](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/16/1760622132545_thiet-ke-chua-co-ten-36-png.webp)

(0)