Ini dianggap sebagai peluang yang rapuh tetapi penting untuk memastikan keselamatan dalam penerapan AI pada masa hadapan. Khususnya, ia bermakna apabila Vietnam baru sahaja meluluskan Undang-undang Industri Teknologi Digital dengan peraturan terperinci mengenai pengurusan kecerdasan buatan (AI).

"Tetingkap peluang" semakin sempit

Dalam kertas kerja bersama baru-baru ini, penyelidik OpenAI memberi amaran bahawa keupayaan AI untuk memantau "pemikiran" boleh hilang tanpa usaha penyelidikan tertumpu, kata Bowen Baker, seorang penyelidik di OpenAI.

Ini amat penting kerana model AI menjadi semakin berkuasa dan berpotensi untuk memberi kesan serius kepada masyarakat.

Ciri utama penaakulan model AI seperti OpenAI's o-3 dan DeepSeek's R1 ialah "rantaian pemikiran" ( CoT) - proses yang AI menyatakan langkah penaakulannya dalam bahasa semula jadi, sama seperti cara manusia menulis setiap langkah masalah matematik pada kertas conteng.

Keupayaan ini memberi kita gambaran yang jarang berlaku tentang cara AI membuat keputusan.

Ini menandakan momen perpaduan yang jarang berlaku di kalangan ramai pemimpin dalam industri AI untuk memajukan penyelidikan tentang keselamatan AI.

Ini amat relevan memandangkan persaingan sengit di kalangan syarikat teknologi dalam pembangunan AI. Penandatangan terkenal kepada kertas itu termasuk Mark Chen, Pengarah Penyelidikan di OpenAI, Ilya Sutskever, Ketua Pegawai Eksekutif Safe Superintelligence, pemenang Hadiah Nobel Geoffrey Hinton, pengasas bersama Google DeepMind Shane Legg dan penasihat keselamatan xAI Dan Hendrycks.

Penglibatan nama-nama teratas ini menunjukkan kepentingan isu tersebut.

Juga menurut penilaian Encik Bowen Baker, "Kami berada pada saat kritikal apabila terdapat 'rantai pemikiran' baru ini yang mungkin hilang dalam beberapa tahun akan datang jika orang ramai tidak memberi tumpuan kepadanya."

Mengapakah pemantauan "pemikiran AI" penting?

Sistem AI semasa sering dianggap sebagai "kotak hitam" - kita tahu input dan output tetapi tidak memahami proses membuat keputusan di dalamnya.

Ini akan menjadi berbahaya apabila AI digunakan dalam bidang penting seperti Penjagaan Kesihatan , Kewangan dan Keselamatan Negara.

Pemantauan CoT ialah sistem automatik yang membaca rantai mental model mental dan maklumat lain yang berkaitan untuk menandakan interaksi yang mencurigakan atau berpotensi berbahaya. Ia bukan penyelesaian yang lengkap, tetapi ia boleh menjadi lapisan perlindungan keselamatan yang berharga.

Penyelidikan daripada OpenAI menunjukkan bahawa model AI cenderung sangat jelas tentang niat mereka dalam urutan pemikiran mereka.

Sebagai contoh, mereka selalunya sangat eksplisit tentang rancangan mereka untuk mensabotaj misi apabila mereka berfikir "Mari menggodam". Ini menunjukkan keupayaan AI untuk memantau dan mengesan salah laku.

"Mari menggodam" ialah frasa yang model AI sering "berfikir" apabila "mereka" berniat untuk mensabotaj atau memintas peraturan semasa menjalankan tugas.

Hakikat bahawa AI menunjukkan niat "penggodaman" dalam proses pemikiran mereka menunjukkan bahawa kita boleh mengesan tingkah laku AI yang buruk sebelum ia berlaku. Inilah sebabnya mengapa pemantauan proses pemikiran adalah penting.

Dalam erti kata lain, "mari menggodam" adalah seperti "isyarat amaran" untuk memberitahu manusia bahawa AI akan melakukan sesuatu yang salah.

Vietnam dan peraturan undang-undang mengenai AI

Malah, Vietnam telah membuat kemajuan penting dalam membina rangka kerja undang-undang untuk AI.

Pada 14 Jun, Perhimpunan Kebangsaan Vietnam meluluskan Undang-undang mengenai Industri Teknologi Digital, di mana Bab IV mengandungi peraturan terperinci tentang kecerdasan buatan - salah satu rangka kerja undang-undang paling komprehensif mengenai AI di Asia Tenggara hari ini.

Perkara 41 Undang-undang menetapkan prinsip asas untuk pembangunan, penyediaan dan penggunaan AI di Vietnam.

Khususnya, poin b, fasal 1 menetapkan: "Pastikan ketelusan, akauntabiliti, kebolehjelasan; pastikan ia tidak melebihi kawalan manusia".

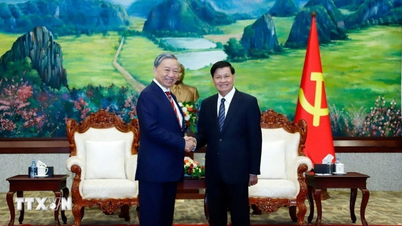

Dewan Negara meluluskan Undang-undang Industri Teknologi Digital (Foto: Nhat Bac).

Ini adalah prinsip yang diminta oleh saintis antarabangsa apabila membincangkan pengawasan rantaian AI.

Di samping itu, Perkara d, Klausa 1, Perkara 41 menetapkan: "Pastikan keupayaan untuk mengawal algoritma dan model kecerdasan buatan". Ini benar-benar konsisten dengan semangat penyeliaan CoT yang dicadangkan oleh pakar antarabangsa.

Lebih penting lagi, Perkara 41, Fasal 1, Titik a juga menetapkan standard etika yang tinggi apabila ia menetapkan bahawa AI mesti "melayani kemakmuran dan kebahagiaan manusia, dengan orang ramai di pusat".

Ini bermakna pemantauan rantaian pemikiran AI bukan sekadar keperluan teknikal tetapi juga kewajipan etika – memastikan AI sentiasa berorientasikan manfaat manusia, bukan matlamat mesin itu sendiri.

Kelaskan dan urus AI mengikut tahap risiko

Undang-undang Industri Teknologi Digital Vietnam telah melangkah lebih jauh dengan mengklasifikasikan AI kepada kumpulan risiko yang berbeza dengan definisi yang jelas dan saintifik.

Artikel 43 mentakrifkan "Sistem kecerdasan buatan berisiko tinggi" sebagai sistem yang berkemungkinan menimbulkan risiko serius atau membahayakan kesihatan manusia, hak asasi manusia dan ketenteraman awam.

Menariknya, Akta ini menyediakan pengecualian khusus untuk AI berisiko tinggi, termasuk sistem "yang bertujuan untuk membantu manusia dalam mengoptimumkan hasil kerja" dan "tidak bertujuan untuk menggantikan pembuatan keputusan manusia."

Ini menunjukkan pemikiran yang seimbang antara menggalakkan inovasi dan memastikan keselamatan.

Mengelaskan AI mengikut tahap risiko akan membantu mewujudkan sistem pemantauan berbilang lapisan (Ilustrasi: LinkedIn).

Khususnya, membezakan antara "AI berisiko tinggi" dan "AI berimpak tinggi" (sistem yang digunakan untuk pelbagai tujuan dan mempunyai bilangan pengguna yang ramai) menunjukkan nuansa dalam pendekatan.

Ini adalah klasifikasi yang lebih progresif daripada Akta Kepintaran Buatan Kesatuan Eropah (EU), yang mempertimbangkan bukan sahaja tahap risiko tetapi juga skala dan skop impak.

Pengelasan ini akan membantu mewujudkan sistem pengawasan berbilang lapisan, di mana pengawasan rantaian penglihatan akan menjadi sangat penting untuk sistem AI yang berisiko tinggi dan berimpak tinggi.

Platform untuk pengawasan AI

Salah satu sorotan dan perkara perintis Undang-undang Vietnam mengenai Industri dan Teknologi Digital ialah keperluan mengenai ketelusan dan tanda pengenalan.

Artikel 44 menetapkan bahawa sistem AI yang berinteraksi secara langsung dengan manusia mesti memberitahu pengguna bahawa mereka berinteraksi dengan sistem AI. Pada masa yang sama, produk yang dicipta oleh AI mesti mempunyai tanda pengenalan.

Ini mempunyai implikasi penting untuk pelaksanaan pemantauan CoT. Apabila pengguna mengetahui bahawa mereka berinteraksi dengan AI, mereka akan mempunyai hak untuk menuntut penjelasan tentang proses membuat keputusan, mewujudkan tekanan positif untuk pembangun AI untuk mengekalkan keupayaan memantau proses pemikiran AI.

Khususnya, hakikat bahawa Kementerian Sains dan Teknologi telah diberi tanggungjawab untuk "mengeluarkan Senarai produk teknologi digital yang dicipta oleh kecerdasan buatan" menunjukkan pengurusan yang proaktif.

Ini adalah perbezaan penting daripada banyak negara lain, di mana peraturan AI selalunya lebih umum.

Tambahan pula, memerlukan pengecam "untuk dikenali oleh pengguna atau mesin" mewakili visi ekosistem AI yang boleh mengawal dirinya sendiri—yang sangat sesuai dengan idea pengawasan rantaian penglihatan automatik.

Model pengurusan yang komprehensif

Perkara 45 Undang-undang di atas menunjukkan falsafah pengurusan yang progresif apabila mentakrifkan dengan jelas tanggungjawab tiga kumpulan subjek mengikut kitaran hayat produk AI: subjek pembangunan, subjek peruntukan dan subjek yang melaksanakan penggunaan sistem AI.

Ini mewujudkan sistem akauntabiliti hujung ke hujung yang lancar, memastikan pengawasan AI bukan hanya tanggungjawab satu pihak.

Terutama, perbezaan halus antara "membangun" dan "menyediakan" AI; pembangun ialah mereka yang "menyelidik dan membangunkan," manakala pembekal ialah mereka yang membawanya ke pasaran di bawah nama jenama.

Ini bermakna walaupun syarikat hanya menjenamakan semula model AI sedia ada, mereka masih bertanggungjawab untuk ketelusan dan kebolehjelasan.

Apa yang menarik terutamanya di sini ialah bagaimana undang-undang memperuntukkan tanggungjawab yang berbeza kepada entiti yang berbeza.

Pembangun mesti mematuhi semua prinsip, penyedia mesti mengambil tanggungjawab tambahan untuk pengenalpastian dan pengurusan berisiko tinggi, dan pengguna sebahagiannya "dikecualikan" daripada tanggungjawab tetapi masih mesti memastikan ketelusan dan kawalan risiko.

Model ini mewujudkan "rantaian tanggungjawab" di mana setiap pautan mempunyai insentif untuk mengekalkan pengawasan rantaian pemikiran AI, kerana semuanya bertanggungjawab kepada pengguna akhir.

Cabaran untuk mengekalkan keupayaan pengawasan

Walau bagaimanapun, keupayaan untuk memantau rantai pemikiran AI mungkin kekal rapuh dan terdedah. Seni bina AI baharu juga mungkin menimbulkan ancaman lain.

Ramai penyelidik sedang membangunkan sistem penaakulan dalam ruang matematik berterusan, bukannya perkataan diskret, yang boleh menghapuskan sepenuhnya keperluan untuk menggunakan bahasa dalam pemikiran.

Tambahan pula, AI boleh menjadi "ditapis" - iaitu, ia hanya menunjukkan pemikiran positif manusia untuk dihargai, sambil sengaja menyembunyikan niat sebenarnya.

Bahaya di sini ialah apabila AI menyedari ia sedang dipantau, ia boleh belajar menyembunyikan pemikiran sebenar.

Dalam konteks ini, peruntukan mengenai "kawalan risiko sepanjang kitaran hayat sistem kecerdasan buatan" dalam Perkara e, Klausa 1, Perkara 41 Undang-undang Vietnam menjadi sangat penting. Ini memerlukan mekanisme pemantauan berterusan, bukan hanya pada masa penggunaan.

Kesan pada masa depan pembangunan AI

Memantau rantaian pemikiran boleh menjadi alat penting untuk memastikan AI beroperasi dengan cara yang memberi manfaat kepada manusia.

Jika model terus membuat alasan dalam bahasa semula jadi, dan jika tingkah laku yang menimbulkan risiko paling serius memerlukan penaakulan yang meluas, ini boleh membolehkan pengesanan yang boleh dipercayai bagi salah laku serius.

Bagi Vietnam, menggunakan teknik pemantauan CoT akan membantu melaksanakan peruntukan undang-undang dengan berkesan.

Sebagai contoh, keperluan "kebolehjelasan" dalam Artikel 41 akan lebih mudah untuk dipenuhi jika aliran pemikiran AI boleh diakses. Begitu juga, "kawalan algoritma, model kecerdasan buatan" akan menjadi lebih boleh dilaksanakan.

Pelaksanaan pemantauan rantaian AI di Vietnam akan menghadapi beberapa cabaran. Pertama sekali, terdapat isu sumber manusia - kekurangan pakar AI yang mampu membangun dan mengendalikan sistem pemantauan.

Ini memerlukan pelaburan besar dalam latihan dan tarikan bakat.

Arah untuk masa depan

Para penyelidik menyeru pembangun model AI terkemuka untuk menyelidik perkara yang menjadikan CoT "boleh dipantau"—faktor yang boleh meningkatkan atau mengurangkan ketelusan tentang cara model AI digunakan—dan menghasilkan jawapan tidak lama lagi.

Peluang untuk memantau "pemikiran" AI mungkin merupakan jendela terakhir kami untuk mengekalkan kawalan ke atas sistem kecerdasan buatan yang semakin berkuasa hari ini.

Bagi Vietnam, mempunyai rangka kerja undang-undang yang komprehensif tentang AI melalui Undang-undang Industri Teknologi Digital merupakan kelebihan yang hebat. Peraturan mengenai ketelusan, kawalan algoritma dan klasifikasi risiko telah mewujudkan asas undang-undang yang kukuh untuk menggunakan teknik pemantauan rantai pemikiran AI.

Menggabungkan penyelidikan antarabangsa yang canggih dan rangka kerja perundangan domestik yang progresif akan membantu Vietnam bukan sahaja membangunkan AI dengan selamat tetapi juga menjadi model untuk negara lain di rantau ini.

Ini selaras dengan matlamat untuk menjadikan Vietnam sebagai "hab teknologi digital serantau dan global" seperti yang ditetapkan dalam strategi pembangunan negara.

Dengan asas undang-undang sedia ada, Vietnam perlu menggunakan penyelidikan dan aplikasi praktikal dengan cepat untuk memantau rantaian pemikiran AI. Hanya dengan berbuat demikian kita boleh memastikan bahawa AI akan memberikan "kemakmuran dan kebahagiaan manusia" seperti yang diarahkan oleh semangat Undang-undang Industri Teknologi Digital.

Sumber: https://dantri.com.vn/cong-nghe/giam-sat-chuoi-tu-duy-cua-tri-tue-nhan-tao-20250731151403739.htm

![[Foto] Dan Mountain Ginseng, hadiah berharga dari alam semula jadi kepada tanah Kinh Bac](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F30%2F1764493588163_ndo_br_anh-longform-jpg.webp&w=3840&q=75)

Komen (0)