|

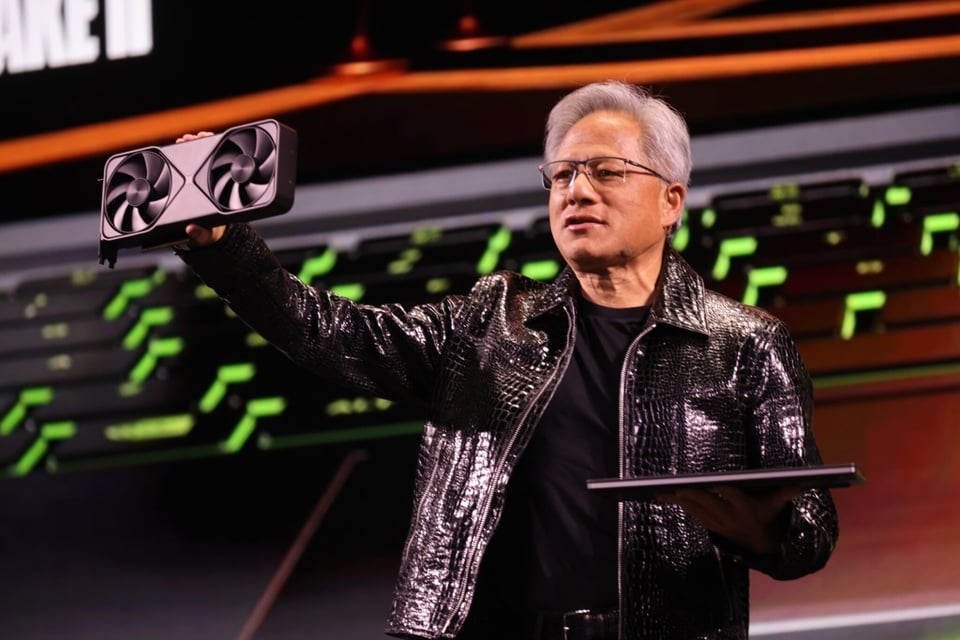

Firmy takie jak Nvidia Jensena Huanga intensywnie inwestują w superkomputery, aby wspierać przyszłą sztuczną inteligencję. Zdjęcie: Nvidia Blog . |

Nowe badanie opublikowane przez Epoch AI – instytut badawczy z siedzibą w San Francisco – pokazuje, że zapotrzebowanie superkomputerów na energię rośnie w zawrotnym tempie, równolegle z rozwojem sztucznej inteligencji.

Według Epoch AI, jeśli coroczne podwojenie zapotrzebowania na energię elektryczną utrzyma się do końca dekady, wiodące superkomputery świata w 2030 r. będą potrzebowały aż 9 gigawatów (GW) – co odpowiada zapotrzebowaniu na energię elektryczną dla 7–9 milionów gospodarstw domowych.

Obecnie najpotężniejszy superkomputer świata zużywa około 300 megawatów (MW), co odpowiada ilości energii elektrycznej zużywanej przez 250 000 gospodarstw domowych. W porównaniu z tą wartością, prognozowane przyszłe zużycie energii jest „ogromne”, jak twierdzi zespół badawczy.

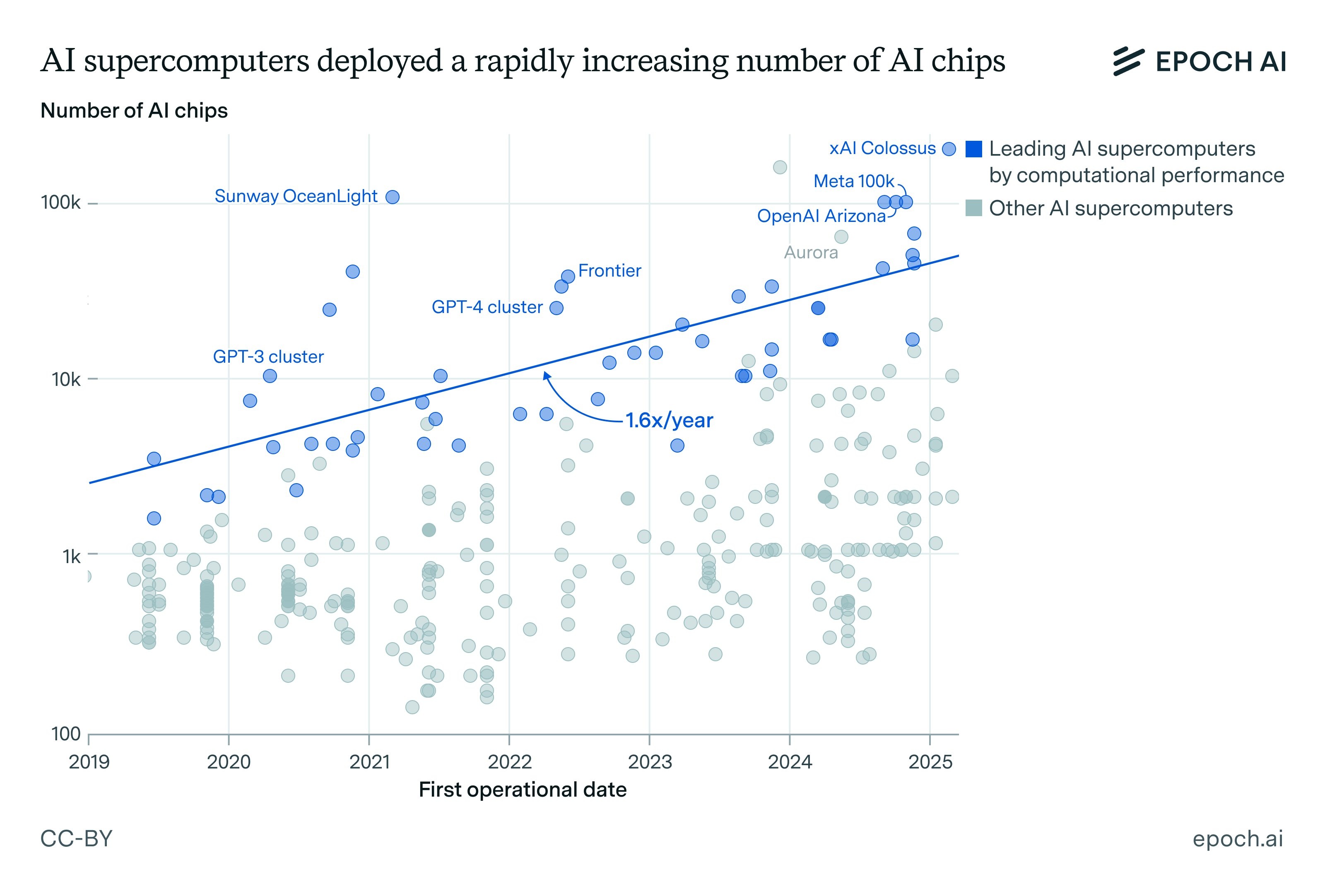

Jednym z głównych powodów, dla których superkomputery AI będą coraz bardziej energochłonne, jest ich stale rosnąca skala. Epoch AI szacuje, że jeśli trend wzrostowy się utrzyma, najnowocześniejszy superkomputer AI do 2030 roku może wymagać nawet 2 milionów chipów AI, a koszty jego budowy sięgną 200 miliardów dolarów .

|

Liczba operacji na sekundę (FLOP/s) w wiodących systemach podwaja się co 9 miesięcy. Źródło: Epoch AI |

Dla porównania, system Colossus – superkomputer zbudowany przez xAI Elona Muska w 214 dni – jest obecnie jednym z największych systemów na świecie, składającym się z 200 000 chipów i obejmującym łączną inwestycję wynoszącą około 7 miliardów dolarów .

Duże firmy technologiczne przyspieszają wyścig w budowaniu infrastruktury obliczeniowej obsługującej coraz bardziej zaawansowane modele sztucznej inteligencji. Na początku tego roku OpenAI ogłosiło projekt Stargate, wart ponad 500 miliardów dolarów w ciągu najbliższych czterech lat, którego celem jest stworzenie kluczowego superkomputera AI.

Według Epoch AI, superkomputery nie są już tylko narzędziami badawczymi, jak kiedyś. Stały się „maszynami przemysłowymi” – dostarczającymi realną wartość ekonomiczną i stanowiącymi kluczową infrastrukturę ery sztucznej inteligencji.

W sprawę zaangażowała się nawet polityka . Na początku tego miesiąca prezydent Donald Trump opublikował na portalu społecznościowym Truth Social wpis, w którym pochwalił inwestycję firmy Nvidia o wartości 500 miliardów dolarów w superkomputery AI w USA. Nazwał to „wielką i ekscytującą wiadomością”, podkreślając, że jest to zobowiązanie do „Złotej Ery Ameryki”.

Badania Epoch AI opierają się na danych obejmujących około 10% światowej produkcji układów scalonych AI w latach 2023–2024, a także 15% zapasów układów scalonych największych firm na początku 2025 r. Zespół ekspertów twierdzi, że chociaż efektywność energetyczna poprawia się, obecny wzrost jest nadal niewystarczający, aby zrównoważyć ogólne tempo wzrostu zapotrzebowania na energię elektryczną.

Dlatego też wielu gigantów technologicznych, takich jak Microsoft i Google, a także operatorów centrów danych, rozważa alternatywy, takie jak energia jądrowa, aby zapewnić stabilne, długoterminowe źródło energii.

Jeśli obecne trendy się utrzymają, nie tylko sztuczna inteligencja będzie się rozwijać szybciej, ale skala, koszty i zapotrzebowanie na energię systemów superkomputerowych również wzrosną wykładniczo.

Źródło: https://znews.vn/chi-phi-khong-lo-cua-ai-post1548789.html

![[Zdjęcie] Sekretarz generalny i prezes To Lam przewodniczy spotkaniu, na którym zatwierdzany jest projekt raportu dotyczącego wyników drugiej kontroli przeprowadzonej przez Biuro Polityczne Stałego Komitetu Partii Miasta Hanoi.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/26/1779789811432_a2-bnd-4430-9620-jpg.webp)

Komentarz (0)