A seguir, apresentamos as opiniões de dois especialistas da Universidade RMIT sobre o impacto prejudicial dos deepfakes e as soluções propostas para esse problema:

|

| Dr. Jonathan Crellin (à esquerda) e Dr. Nguyen Van Thang Long (à direita). (Fonte: Universidade RMIT) |

Os cibercriminosos exploram as novas tecnologias de maneiras imprevisíveis.

Dr. Jonathan Crellin, Chefe do Departamento de Segurança da Informação, Faculdade de Ciências , Engenharia e Tecnologia, Universidade RMIT :

Deepfakes são imagens geradas por máquina que podem combinar imagens ou vídeos de várias fontes para criar imagens, vídeos ou até mesmo áudio extremamente realistas.

Os deepfakes são baseados em uma técnica de IA chamada aprendizado de máquina, que pode substituir e integrar elementos como o rosto de uma pessoa em outras imagens ou vídeos.

Um exemplo de uso de deepfake é a combinação de conteúdo pornográfico com fotos de Taylor Swift para criar imagens falsas.

Para alcançar esse objetivo, o mentor precisava de várias imagens para que o software pudesse aprender sobre as expressões faciais da cantora e, em seguida, combiná-las com conteúdo pornográfico para criar imagens obscenas, manchando a imagem da cantora.

Na verdade, há rumores de que essas imagens foram divulgadas por um grupo no Telegram e criadas usando o Microsoft Designer, uma ferramenta com suporte integrado de IA.

Qualquer pessoa pode se tornar vítima, pois o criminoso precisa apenas de imagens, vídeos ou gravações de áudio da pessoa cuja identidade está sendo imitada.

É provável que atividades fraudulentas de diversas formas sejam usadas para criar desinformação, e é seguro dizer que a próxima eleição presidencial dos EUA estará repleta de notícias falsas desse tipo.

Atualmente, legisladores de todo o mundo estão buscando aprovar leis contra esse tipo de imagem.

Nos Estados Unidos, diversas abordagens estão começando a ser adotadas na elaboração de leis, como o recurso a ações judiciais cíveis ou leis para lidar com a "divulgação de imagens pornográficas geradas por IA de uma pessoa sem o seu consentimento".

A China também introduziu novas regulamentações que permitem o processo judicial de indivíduos que divulgam imagens criadas por IA.

O Reino Unido considera o compartilhamento de conteúdo deepfake ilegal de acordo com sua legislação de segurança online.

Como podemos detectar ou prevenir isso?

A primeira abordagem é reduzir o número de imagens, vídeos ou gravações de áudio que você compartilha online. Certifique-se de compartilhá-los apenas com pessoas que você conhece e não os publique amplamente na internet. Uma vez que o conteúdo é carregado na internet, é quase impossível excluí-lo.

Uma segunda opção é combinar um código secreto com os membros da família para autenticar as chamadas, reduzindo o risco de ser vítima de falsificação de chamadas.

Imagens, especialmente vídeos, podem apresentar falhas estranhas (parecem encenadas), e se você notar essas falhas, é muito provável que a imagem ou o som tenham sido falsificados.

Outra técnica que pode ser usada é pesquisar por "imagens invertidas" no Google ou em outros mecanismos de busca para identificar a fonte da imagem original.

A lição final é: não confie cegamente no que vê; câmeras (ou IA) podem mentir!

Os deepfakes representam uma ameaça significativa para celebridades e políticos.

Dr. Nguyen Van Thang Long, Professor Sênior do Departamento de Comunicação e Design da Universidade RMIT :

Com a proliferação de notícias falsas provenientes de deepfakes, as equipes de mídia de celebridades e políticos precisam ter recursos para monitorar e responder prontamente às notícias falsas ou corrigir continuamente a desinformação.

Se os deepfakes forem sistematicamente combinados com formas organizadas de "relações públicas sujas", essa tarefa se torna ainda mais difícil devido à proliferação de informações conflitantes, e as notícias falsas e negativas sempre serão compartilhadas mais do que as notícias positivas.

Normalmente, quando as pessoas veem notícias compartilhadas nas redes sociais, tendem a verificar as informações por meio de canais de notícias oficiais.

Com a proliferação de deepfakes nas redes sociais, verificar a veracidade das notícias tradicionais está se tornando cada vez mais difícil e demorado, exigindo pesquisa aprofundada e técnicas de verificação específicas.

Quanto maior a demora na verificação de notícias e fontes, mais disseminadas se tornam a desinformação, as invenções ou as informações enganosas, devido à velocidade vertiginosa de compartilhamento e comentários nas redes sociais.

Isso agrava o problema fundamental e pode levar a distúrbios sociais, especialmente se o conteúdo estiver relacionado a discursos políticos, religião, gênero, estratégia empresarial ou questões macroeconômicas.

No contexto da disseminação de deepfakes, a estratégia de gestão de riscos mais eficaz continua sendo a manutenção de canais de comunicação consistentes, por meio de plataformas populares de mídias sociais, sites ou reuniões presenciais, entre empresas, celebridades, políticos e principais partes interessadas, como fãs, imprensa, comunidade e funcionários.

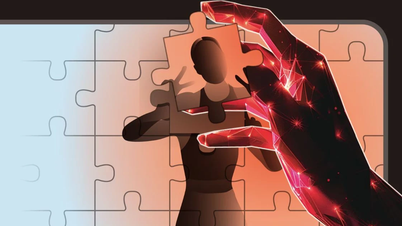

|

O uso crescente da IA traz benefícios, mas também novos problemas inesperados. (Imagem ilustrativa. Fonte: Freepik) |

Ao manter esses canais de comunicação, as informações relacionadas a deepfakes são recebidas mais rapidamente, permitindo a correção oportuna e eficaz de boatos e a exposição de informações falsas desde o início.

No entanto, empresas, celebridades e políticos precisam desenvolver planos de gerenciamento de crises específicos para deepfakes. Por exemplo, precisam determinar quem anunciará o incidente, por meio de quais canais de mídia, os critérios para verificar as informações usando evidências e fontes confiáveis, estabelecer um cronograma para lidar com o boato e delinear uma estratégia para restaurar a credibilidade.

Com uma estratégia bem planejada e preparada, lidar com uma crise de deepfake torna-se mais viável, minimizando as potenciais consequências negativas.

Fonte

![[Foto] O primeiro-ministro Pham Minh Chinh conversa por telefone com o CEO da corporação russa Rosatom.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

Comentário (0)