Nos últimos meses, especialistas em segurança infantil e pesquisadores têm alertado que a inteligência artificial criativa pode exacerbar o abuso online.

Mark Zuckerberg, CEO da Meta, discursa em uma audiência do Comitê Judiciário do Senado dos EUA em 31 de janeiro de 2024, diante de uma plateia de pessoas carregando imagens geradas por inteligência artificial. Foto: Reuters

O NCMEC ainda não divulgou o número total de denúncias de conteúdo de abuso infantil recebidas em 2023, considerando todas as fontes. No entanto, em 2022, recebeu cerca de 88,3 milhões de denúncias sobre o problema.

“Estamos recebendo relatos das próprias empresas inovadoras de IA, de plataformas (online) e de membros do público”, disse John Shehan, vice-presidente do NCMEC.

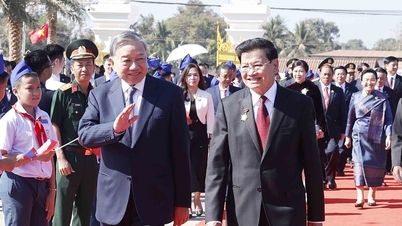

Os CEOs da Meta, X, TikTok, Snap e Discord prestaram depoimento em uma audiência no Senado dos EUA sobre segurança infantil em plataformas online na quarta-feira (31 de janeiro). Os legisladores americanos questionaram as empresas de mídia social sobre seus esforços para proteger crianças de "predadores online".

A inteligência artificial generativa pode ser usada por pessoas mal-intencionadas para prejudicar repetidamente crianças reais, criando imagens falsas delas, disseram pesquisadores do Observatório de Internet de Stanford em um relatório divulgado em junho passado.

Fallon McNulty, diretora da CyberTipline do NCMEC, que recebe denúncias de exploração infantil online, afirmou que o conteúdo gerado por IA está se tornando "cada vez mais fotorrealista", dificultando a identificação de vítimas reais.

McNulty afirmou que a OpenAI, empresa criadora do ChatGPT, estabeleceu um processo para o envio de relatórios ao NCMEC, e que a organização está em negociações com outras empresas de IA.

Hoang Hai (de acordo com a Reuters e o Financial Times)

Fonte

![[Foto] Desfile para celebrar o 50º aniversário do Dia Nacional do Laos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[Foto] Adorando a estátua de Tuyet Son - um tesouro de quase 400 anos no Pagode Keo](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

Comentário (0)