Чтобы ИИ действительно стал движущей силой национальной конкурентоспособности, необходимо разработать правовую базу, которая позволит как контролировать риски, так и стимулировать инновации.

Необходимость в структуре управления для ИИ

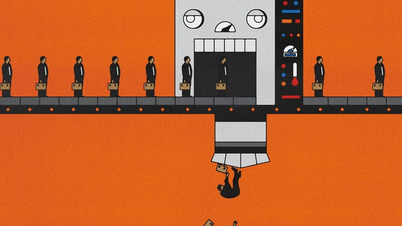

С появлением искусственного интеллекта (ИИ) граница между человеческим творчеством и ИИ становится всё более размытой, что превращает вопрос авторских прав и прав интеллектуальной собственности в новую юридическую проблему. Кроме того, создание механизма управления рисками при создании и эксплуатации продуктов, созданных с помощью ИИ, также стало актуальным, чтобы гарантировать, что технологии служат правильным целям и интересам человека.

Данные для обучения ИИ и проблема авторских прав

Одним из важных вопросов, требующих законодательного регулирования, является использование данных для обучения искусственного интеллекта. Это основа для обучения систем искусственного интеллекта, обработки информации и создания новых продуктов, но также является источником многочисленных споров, когда данные для обучения включают литературные произведения, музыку , изображения, прессу или продукты творческой деятельности, принадлежащие отдельным лицам и организациям. Без чёткого регулирования эта деятельность может легко привести к нарушению авторских прав, прав создателей и повлечь за собой юридические и этические последствия.

Юрист Нгуен Тхи Тху Хиен из BIHACO Trading and Media Services Joint Stock Company, специализирующийся на защите авторских прав, отметил, что в настоящее время многие системы искусственного интеллекта обучаются путём автоматического сканирования и копирования данных в интернете, собирая миллионы работ без разрешения и выплаты вознаграждения авторам. Было возбуждено несколько международных судебных исков, в которых компании, занимающиеся разработкой ИИ, обвинялись в незаконном использовании данных авторов для обучения моделей ИИ. Во Вьетнаме, несмотря на отсутствие судебных исков, нарушения широко распространены.

Многие стартапы без разрешения собирают контент из статей, блогов, электронных книг и создают вьетнамских чат-ботов, нарушая права авторов.

Многие стартапы без разрешения собирают содержание статей, блогов, электронных книг и создают вьетнамских чат-ботов, нарушая права авторов. Типичным примером являются чат-боты, способные обобщать и воспроизводить содержание произведений... поэтому пользователям не нужно покупать книги и газеты, что приводит к потере дохода авторов и бесконтрольной эксплуатации произведений. Песня может быть использована для обучения ИИ сочинению музыки, на основе которой ИИ создаёт бесплатную фоновую музыку, конкурирующую с музыкой, защищённой авторским правом. По словам юриста Нгуен Тхи Тху Хьен, действующий Закон об интеллектуальной собственности несовместим с требованиями ИИ в вопросах авторского права на ИИ. Риск возникновения споров очень высок, поэтому необходимы правила для защиты авторских прав, а также для продвижения этой новой технологии.

Магистр Выонг Тует Линь из Университета банковского дела города Хошимин также отметил, что взрывной рост числа сложных произведений, создаваемых с помощью искусственного интеллекта, представляет собой серьёзную проблему для правовой базы авторского права. Поэтому для устранения правового пробела и обеспечения гармонии между технологиями и правом необходим глубокий академический подход к этому вопросу.

В процессе разработки Закона о внесении изменений и дополнений в Закон «Об интеллектуальной собственности» высказывались мнения о том, что использование данных, защищенных авторским правом и смежными правами, для обучения искусственного интеллекта должно быть разрешено без разрешения, и этот случай подпадает под действие закона об ограничении и исключении прав. Также высказывались мнения о необходимости получения разрешения и оплаты использования данных, защищенных авторским правом, для обучения искусственного интеллекта. Однако в случае его реализации возникнет проблема: кто должен платить соответствующую плату: разработчик модели искусственного интеллекта, поставщик приложения или конечный пользователь? Это сложная проблема, требующая координации и уточнения механизма рассмотрения компетентными органами.

ИИ расширяет творческие возможности человека

Важнейшей частью жизненного цикла ИИ является то, как он используется для служения людям. Поэтому необходим правовой коридор, регулирующий управление и ответственное развитие ИИ.

По мнению экспертов, риски систем искусственного интеллекта обусловлены не только техническими ошибками, но и неконтролируемым использованием и управлением. Модель искусственного интеллекта может создавать ошибки в данных, алгоритмические ошибки и принимать автоматизированные решения, влияющие на здоровье, занятость или конфиденциальность людей. При интеграции в такие области, как финансы, здравоохранение, образование или СМИ, эти риски могут многократно возрасти, если их не отслеживать на ранней стадии. Поэтому необходимо создать механизм оценки, классификации и контроля рисков на протяжении всего жизненного цикла искусственного интеллекта для обеспечения социальной безопасности и доверия пользователей.

Фактически, скорость применения ИИ во Вьетнаме происходит очень быстро, что показывает острую необходимость в четком направлении и структуре управления. В 2024 году около 47 000 вьетнамских предприятий начнут применять ИИ, что эквивалентно более чем 5 предприятиям в час, в результате чего общее число предприятий, применяющих ИИ, достигнет почти 170 000, что составляет около 18% от общего числа предприятий в стране. В то же время вьетнамский рынок чат-ботов также демонстрирует потенциал и сильный рост. В 2024 году стоимость рынка чат-ботов достигла около 31,2 млн долларов США и, по прогнозам, увеличится до 207,1 млн долларов США к 2033 году со совокупным темпом роста (CAGR) 18,5%. Когда предприятия впервые выходят на рынок ИИ, они часто начинают с чат-ботов или интеллектуальных интерактивных инструментов.

Фактически, темпы внедрения ИИ во Вьетнаме растут очень быстро, что свидетельствует о срочной необходимости четкого направления и структуры управления.

Поэтому, по словам г-жи Тран Ву Ха Минь (компания FPT Software), государство должно в ближайшее время выпустить конкретные руководящие принципы по внедрению чат-ботов и базовых инструментов искусственного интеллекта для соблюдения требований прозрачности, защиты данных и подотчётности. Для высокорисковых или ключевых проектов должны быть разработаны подробные политики и стандарты, чтобы компании могли уверенно внедрять их, не беспокоясь о юридических или технических барьерах.

Законопроект об искусственном интеллекте устанавливает ряд обязательств для сторон, предоставляющих и внедряющих высокорисковые системы искусственного интеллекта, таких как поддержание системы управления рисками на протяжении всего жизненного цикла системы, непрерывный мониторинг и переоценка уровня риска системы, а также наличие технического механизма для автоматической регистрации журналов активности. При возникновении инцидента компетентный орган требует от поставщика или внедрителя предоставить журналы активности для установления причины, определения ответственности и использования их в качестве основы для возмещения ущерба.

По мнению юриста Нгуена Туана Линя из юридической фирмы BMVN International, необходимо классифицировать риски по цели использования, а не по технологии, лежащей в их основе. Оценка рисков должна основываться на чётких, объективных критериях и соответствовать международным стандартам; слишком общие определения при классификации рисков могут затруднить разработку технологий искусственного интеллекта, которые, скорее всего, не причинят вреда.

(Продолжение следует)

Источник: https://nhandan.vn/bao-ve-ban-quyen-trong-ky-nguyen-ai-bai-1-post921923.html

![[Фото] Премьер-министр Фам Минь Чинь посещает ежегодный Вьетнамский бизнес-форум](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/10/1762780307172_dsc-1710-jpg.webp)

![[Фото] Премьер-министр Фам Минь Чинь принимает участие в Конгрессе патриотического соревнования Министерства иностранных дел на период 2025–2030 годов.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/10/1762762603245_dsc-1428-jpg.webp)

![Переход Донгнай OCOP: [Статья 3] Связь туризма с потреблением продукции OCOP](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

Комментарий (0)