Дипфейки — это видео и изображения, созданные или измененные с помощью цифрового искусственного интеллекта (ИИ) или машинного обучения (МО). Порнография, созданная с помощью этих технологий, впервые появилась в интернете несколько лет назад, когда пользователь Reddit опубликовал поддельные порноролики с лицами знаменитостей.

Фото: GI

Жертвой может стать кто угодно.

С тех пор создатели дипфейков продолжают публиковать похожие видео и изображения, нацеленные на влиятельных интернет-блогеров, журналистов и других пользователей с публичными профилями. Тысячи таких видео можно найти на многочисленных сайтах.

Поскольку технологии искусственного интеллекта становятся все более доступными, пользователи могут превращать любого человека в «порнозвезду» без его согласия или, что еще опаснее, использовать эту технологию для дискредитации или шантажа других людей.

Эксперты утверждают, что проблема может усугубиться с развитием инструментов генеративного ИИ, которые обучаются на миллиардах изображений из интернета и генерируют новый контент, используя существующие данные.

«Реальность такова, что технологии будут продолжать распространяться, развиваться и становиться всё более доступными», — сказал Адам Додж, основатель EndTAB, группы, которая проводит обучение по борьбе со злоупотреблениями технологиями. «И пока это продолжается, люди, несомненно… будут продолжать злоупотреблять этими технологиями, чтобы причинить вред другим, в первую очередь посредством сексуального насилия в интернете, фейковой порнографии и поддельных обнажённых изображений».

Ноэль Мартин из Перта, Австралия, столкнулась с этим. 28-летняя девушка обнаружила поддельное порно со своим изображением 10 лет назад, когда из любопытства однажды загуглила своё изображение. Мартин до сих пор говорит, что понятия не имеет, кто создал эти фейковые порнографические изображения или видео. Она подозревает, что кто-то использовал её фотографии из социальных сетей для создания порнороликов.

Мартин пыталась связаться с сайтами, чтобы удалить видео, но её усилия были тщетны. Некоторые не ответили. Другие удалили их, но тут же опубликовали снова. «Вы не победите», — сказала мисс Мартин. «Это останется в интернете навсегда и может разрушить вашу жизнь».

Усилия технологических компаний по решению проблемы

Некоторые модели ИИ утверждают, что у них ограничен доступ к порнографическим изображениям.

Компания OpenAI заявила, что удалила порнографический контент из данных, используемых для обучения генератора изображений DALL-E, что должно снизить вероятность его несанкционированного использования. Компания также фильтрует запросы и блокирует создание пользователями изображений знаменитостей и известных политиков с помощью ИИ. Другая модель, Midjourney, также блокирует использование определённых ключевых слов и предлагает пользователям сообщать модераторам о проблемных изображениях.

Тем временем, Stability AI также выпустила обновление, запрещающее пользователям создавать откровенные изображения. Эти изменения были внесены после сообщений о том, что некоторые пользователи использовали технологию для создания обнажённых фотографий, вдохновлённых знаменитостями.

Представитель Stability AI Мотез Бишара сообщил, что фильтр использует комбинацию ключевых слов и других методов, таких как распознавание изображений, для обнаружения наготы. Но пользователи могут настраивать программу и создавать что угодно, поскольку компания опубликовала открытый исходный код приложения.

Некоторые компании, работающие в социальных сетях, также ужесточили правила, чтобы лучше защитить свои платформы от вредоносных материалов.

В прошлом месяце TikTok заявил, что весь фейковый или сфальсифицированный контент должен быть помечен, чтобы указать, что он является фейковым или каким-либо образом измененным.

Игровая платформа Twitch также недавно обновила свою политику в отношении фейковых изображений после того, как популярный стример под ником Atrioc был пойман за открытием сайта с фейковым порно в своем браузере во время прямой трансляции в конце января.

Apple и Google заявили, что недавно удалили из своих магазинов приложений приложение, публиковавшее фейковые видеоролики сексуального характера для рекламы своей продукции.

От западной певицы до идола K-pop.

Исследования в области deepfake-порнографики редки, но отчет 2019 года компании DeepTrace Labs, занимающейся разработкой искусственного интеллекта, показал, что почти все ее проявления направлены против женщин, причем чаще всего жертвами становятся западные актрисы, а за ними следуют исполнители K-pop.

Представитель Meta Дэни Левер заявил в своем заявлении, что политика компании ограничивает контент для взрослых, созданный как с помощью искусственного интеллекта, так и без него, а также запрещает размещать рекламу на своей платформе на странице приложения, создающего дипфейки.

В феврале Meta, а также сайты для взрослых, такие как Only**** и Porn***, начали участвовать в онлайн-инструменте Take It Down, который позволяет подросткам сообщать о своих сексуально откровенных изображениях и видеороликах в интернете. Сайт поддерживает как скрытно снятые видео, так и видео, созданные искусственным интеллектом.

Хоанг Тон (по данным AP)

Источник

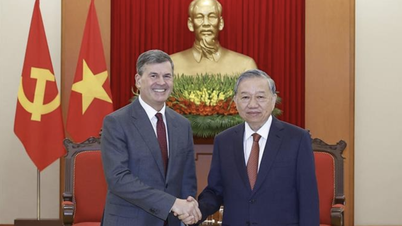

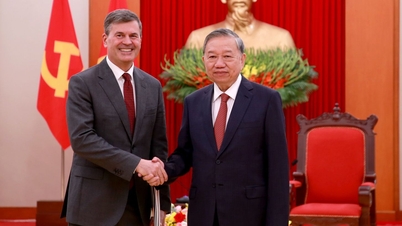

![[Фото] Генеральный секретарь То Лам принимает директора Академии государственной службы и народного хозяйства при Президенте Российской Федерации](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F08%2F1765200203892_a1-bnd-0933-4198-jpg.webp&w=3840&q=75)

Комментарий (0)