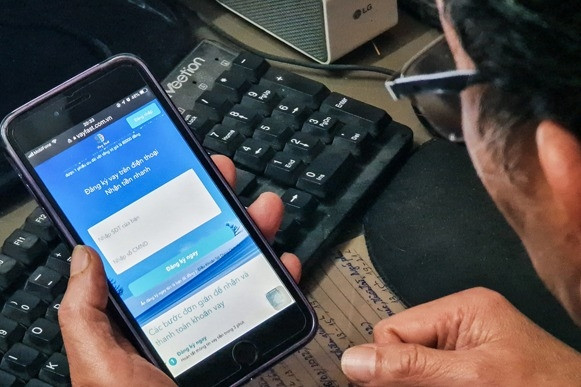

Хоанг Оань (имя персонажа изменено) — офисный работник в Ханое . Во время общения с другом в Facebook Messenger друг Оань попрощался и завершил разговор, но внезапно вернулся к текстовому сообщению, попросив денег в долг и предложив перевести их на банковский счёт.

Хотя имя счёта совпадало с именем её подруги, Хоанг Оань всё ещё немного подозревала, поэтому запросила видеозвонок для подтверждения. Подруга сразу согласилась, но звонок длился всего несколько секунд из-за «перебоев с сетью», как она объяснила. Увидев лицо подруги в видеозвонке и её голос, Хоанг Оань больше не сомневалась и перевела деньги. Однако только после успешного перевода пользовательница поняла, что попалась в ловушку хакера.

Случай пользователя Хоанга Оаня — лишь один из многих случаев, когда жертвы «попали в ловушку» мошеннических групп, использующих технологию искусственного интеллекта для создания изображений и голосов друзей и родственников жертв, чтобы обманом заставить их присвоить их имущество.

Эксперты Bkav заявили, что во второй половине 2023 года, и особенно во время празднования Лунного Нового года 2024, эта компания информационной безопасности постоянно получала сообщения и просьбы о помощи от жертв о случаях мошенничества, аналогичных описанным выше.

Согласно анализу экспертов компании, в случае с пользователем Хоангом Оанем злоумышленники взяли под контроль аккаунт Facebook, но не сделали это сразу полностью, а вместо этого тайно следили за ним и ждали удобного случая, чтобы выдать себя за жертву и попросить денег в долг у его друзей и родственников.

Мошенники используют искусственный интеллект для создания поддельного видео с лицом и голосом владельца аккаунта Facebook (Deepfake). Когда их просят совершить видеозвонок для подтверждения личности, они соглашаются, но затем быстро отключаются, чтобы избежать обнаружения.

Г-н Нгуен Тиен Дат, генеральный директор Центра исследования вредоносных программ Bkav, подчеркнул, что даже когда пользователи во время видеозвонка видят лица родственников или друзей и слышат их голоса, это не обязательно означает, что они действительно разговаривают с этим человеком. В последнее время многие стали жертвами финансовых мошенничеств с использованием Deepfake и технологий искусственного интеллекта.

«Возможность сбора и анализа пользовательских данных с помощью ИИ позволяет создавать сложные стратегии мошенничества. Это также означает, что сложность сценариев мошенничества при сочетании Deepfake и GPT возрастёт, что значительно затруднит обнаружение мошенничества», — заявил г-н Нгуен Тиен Дат.

Эксперты Bkav рекомендуют пользователям быть особенно бдительными, не предоставлять личную информацию (удостоверение личности, банковский счёт, одноразовый код и т.д.). Не переводить деньги незнакомцам по телефону, через социальные сети, сайты, имеющие признаки мошенничества. При запросе займа/перевода денег на счёт через социальные сети следует использовать другие способы аутентификации, например, позвонить или использовать другие каналы связи для повторного подтверждения.

Прогнозируя тенденции кибератак в 2024 году, эксперты сходятся во мнении, что стремительное развитие ИИ не только приносит очевидные преимущества, но и создает значительные риски для кибербезопасности.

Самая большая проблема для компаний и организаций, сталкивающихся с технологиями искусственного интеллекта, сегодня — это мошенничество и продвинутые постоянные угрозы (APT). Сценарии мошенничества становятся всё сложнее, особенно при сочетании дипфейков и GPT. Возможность сбора и анализа пользовательских данных с помощью искусственного интеллекта позволяет создавать сложные стратегии мошенничества, затрудняя пользователям выявление мошенничества.

Повышение безопасности ИИ — несомненная тенденция будущего. Международному сообществу необходимо тесно сотрудничать для разработки новых мер безопасности, а также для повышения уровня знаний и осведомлённости пользователей о потенциальных рисках, связанных с ИИ.

Остерегайтесь мошенников, распространяющих поддельные сообщения о брендах

Предупреждение о 5 видах онлайн-мошенничества во время Лунного Нового года 2024 года

На долю выдачи себя за представителей власти приходится 9% всех фишинговых атак во Вьетнаме

Источник

![[Фото] Состоялась подготовительная сессия I съезда делегатов центральных партийных органов 2025-2030 гг.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/23/e3a8d2fea79943178d836016d81b4981)

![[Фото] Генеральный секретарь То Лам встречается с избирателями в Ханое](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/23/d3d496df306d42528b1efa01c19b9c1f)

Комментарий (0)