Репортер WSJ Джоанна Стерн попыталась с помощью искусственного интеллекта создать поддельную версию себя, чтобы обмануть и свою семью, и банковскую систему.

Использование искусственного интеллекта для вставки лиц в видео или поддельных голосов, обычно называемых deepfakes, становится все более распространенным и более опасным. Это реальная опасность в Интернете.

Помимо чувствительных видео, deepfakes также могут нанести серьезный вред, если используются в политических целях. Видео с морфингом лица бывшего президента США Барака Обамы, которое стало вирусным в 2018 году, показало, что жертвами могут стать и ведущие политические деятели.

|

Глубокое фейковое порно становится глобальной проблемой. Фото: Wired. |

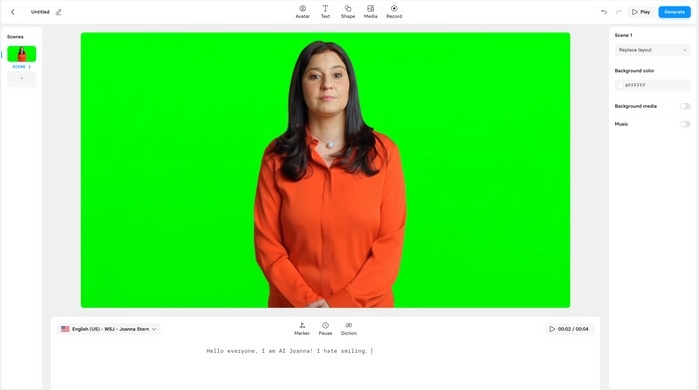

Чтобы проверить эффективность ИИ, репортер WSJ Джоанна Стерн использовала Synthesia, инструмент для создания deepfake, чтобы создать симулированную версию себя. В результате клон обманул и ее семью, и банковскую систему.

Идеальная копия

Рассказывая о своем пути к клонированию, Стерн сказала, что она провела месяцы, экспериментируя с Synthesia и обучая ИИ с помощью своих оригинальных видео и аудиофайлов.

Использовать этот инструмент также очень просто: пользователям нужно просто ввести любой текст и получить новое видео, в котором их голос рассказывает об этом контенте.

«Из-за специфики моей работы, которая требует много работы с диалогами и на экране, я подумал, что ИИ может помочь мне быть более эффективным и взять на себя часть тяжелой работы», — сказал Стерн.

|

Джоанна Стерн записывает свой голос для обучения искусственного интеллекта Synthesia. Фото: WSJ. |

Чтобы обучить инструмент, репортер WSJ отправился в студию звукозаписи и провел около 30 минут, снимая себя, и два часа, записывая свой голос. Через несколько недель виртуальная версия Стерн, которую она окрестила Joanna AI, была готова выполнять свою работу.

Стерн использовал свой выходной, чтобы заставить Joanna AI работать. Для своего первого задания репортер WSJ использовал ChatGPT, чтобы написать сценарий для видео TikTok о советах по iOS.

Затем Стерн вставила текст в Synthesia. После инициализации ее голос был слышен поверх видео. «Это было похоже на то, как если бы я смотрела на свое отражение в зеркале, хотя жесты рук и выражения лица были немного другими. Это было очень убедительно», — прокомментировал репортер.

Стерн отметил, что у Joanna AI впечатляющие способности к имитации коротких предложений, но его недостатки становятся очевидными по мере того, как предложения становятся длиннее.

Вот почему платформы коротких видео являются наиболее подходящими средами для ИИ, сказала Стерн. По ее словам, пользователи часто уделяют меньше внимания деталям в видео TikTok, из-за чего компьютерные функции легко упустить.

Для телефонных звонков Стерн использует другое приложение AI под названием ElevenLabs вместо Synthesia. Это голосовое программное обеспечение AI имеет преимущество в том, что пользователи просто загружают свои аудиофайлы в инструмент, не посещая студию звукозаписи.

|

Стерн сказал, что у Joanna AI впечатляющие способности к мимикрии коротких предложений. Фото: WSJ. |

Репортер WSJ была удивлена, когда ElevenLabs удалось клонировать ее голос всего за две минуты. Примечательно, что плата за использование этого приложения составляет всего около 5 долларов в месяц.

Стерн отметил, что по сравнению с Synthesia его клонированный голос на ElevenLabs звучал более человечно, с хорошей интонацией и произношением.

Чтобы проверить его достоверность, репортер попытался использовать голос, чтобы поговорить с родственником. Сестра Стерна сказала, что голос ИИ был очень похож на ее, за исключением того, что он не останавливался, чтобы перевести дыхание.

Между тем, когда Стерн использовал голос искусственного интеллекта, чтобы позвонить своему отцу и спросить его номер социального страхования, он сразу понял, что что-то не так, потому что голос был похож на записанный аудиофайл.

Обмануть банк

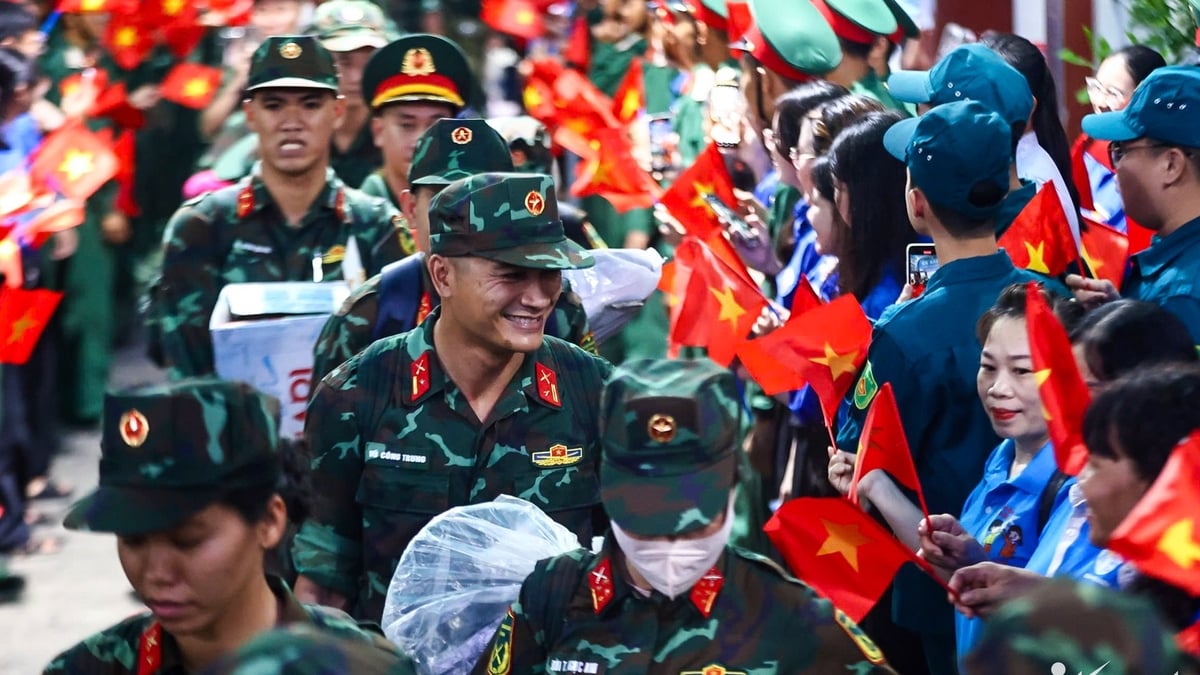

В частности, ИИ оказался настолько эффективным, что обманул голосовую биометрическую систему на кредитной карте Chase, принадлежавшей Стерну.

Репортер WSJ сначала задала Джоанне AI несколько вопросов, которые задаст Чейз. Затем она позвонила в службу поддержки клиентов и дала AI ответить.

|

ИИ был настолько эффективен, что обманул голосовую биометрическую систему на кредитной карте Chase Стерна. Фото: WSJ. |

На биометрическом этапе, когда автоматизированная система запросила ее имя и адрес, Джоанна ИИ ответила официально. Как только она услышала голос ИИ, система Чейза сразу распознала его как Стерн и соединила ее с представителем банка.

После успешного теста Стерн напрямую связался с Чейзом и сообщил, что не имеет никаких дел с банком.

Представитель Chase позже заявил, что банк использует голосовую биометрию, а также другие инструменты для проверки личности звонящих.

Чейз добавил, что эта функция призвана помочь клиентам быстро и безопасно идентифицировать себя, но для завершения транзакций и других финансовых запросов клиентам потребуется предоставить дополнительную информацию.

Но больше всего беспокоит то, что такие приложения, как ElevenLabs, сделали очень хорошую копию без особых проблем. Пользователи просто соглашаются с политикой ответственности и могут загружать аудиофайлы и делать собственные копии.

После тестирования WSJ ElevenLabs заявила, что будет блокировать аккаунты, которые, по всей видимости, создают мошеннический или незаконный контент. Стартап также работает над инструментом маркировки ИИ для видео, созданных на его платформе.

Между тем, Synthesia требует от пользователей устного согласия на использование аудио- и видеофайлов, поэтому Стерну пришлось пойти в студию, чтобы снимать и записывать прямой эфир с компанией.

|

Использовать Synthesia просто: при вводе любого текста пользователь получит новое видео, в котором его голос рассказывает об этом контенте. Фото: WSJ. |

По словам Шивон Джонсон, пресс-секретаря Федерального бюро расследований (ФБР), в среднем семьи в США теряют около 11 000 долларов из-за каждого мошеннического звонка.

По данным Федеральной торговой комиссии США (FTC), в 2022 году американцы потеряли в общей сложности 2,6 млрд долларов из-за мошеннических звонков.

Разработка недорогих и доступных программ искусственного интеллекта позволила мошенникам свободно клонировать голоса и создавать разговоры, которые звучат в точности как оригинал.

«Эта угроза не просто гипотетическая. Мы видим, как мошенники превращают эти инструменты в оружие. Они могут создать относительно хороший голосовой клон, используя менее чем минуту аудио. Для некоторых людей достаточно даже нескольких секунд», — сказал Хани Фарид, профессор компьютерных наук в Калифорнийском университете в Беркли.

Ссылка на источник

Комментарий (0)