В частности, Alphabet, материнская компания Google, рекомендовала сотрудникам не вводить конфиденциальные документы в чат-боты на базе искусственного интеллекта. Согласно источникам в самой Alphabet, полученным агентством Reuters, компания также предупредила своих инженеров о необходимости избегать прямого использования компьютерного кода, генерируемого чат-ботами.

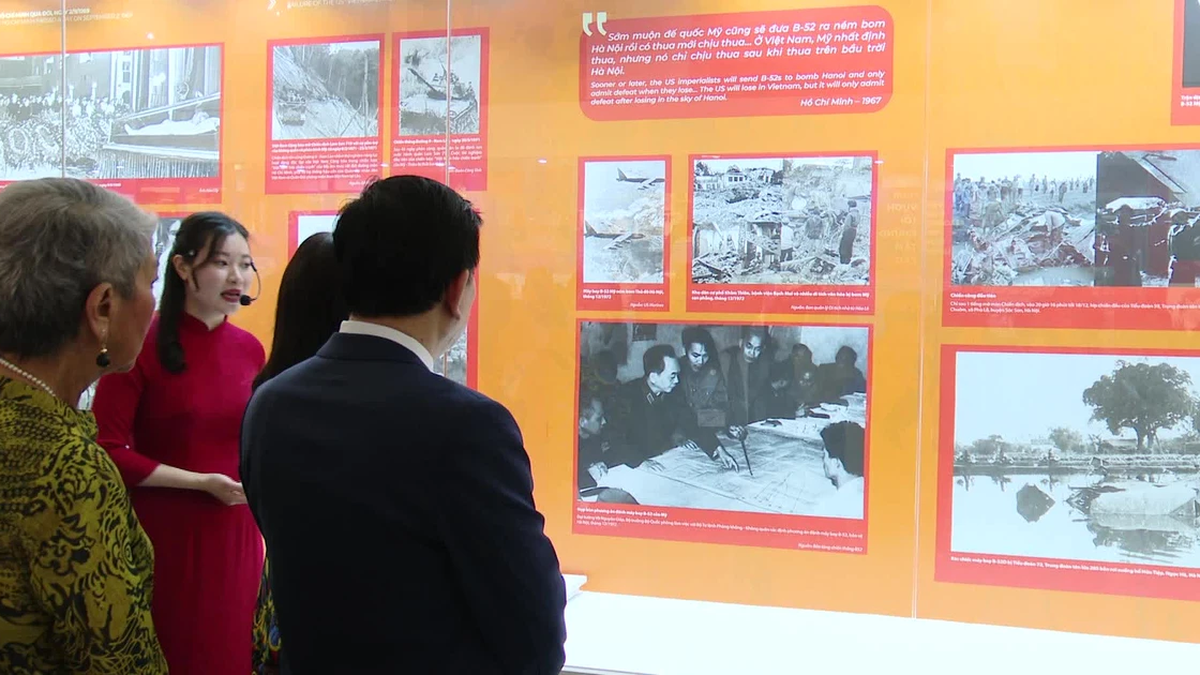

Технологический гигант Google также обеспокоен утечками информации через свой собственный чат-бот на базе искусственного интеллекта. Фото: Reuters

Чат-боты, включая Bard и ChatGPT, — это программы, использующие так называемый общий искусственный интеллект для ведения диалогов с пользователями, подобных человеческим. Эксперты утверждают, что чат-боты могут копировать данные, которые они получают в процессе ответа, что создаёт риск утечки информации о пользователях.

Эти опасения отражают стремление Google избежать ущерба для бизнеса от программного обеспечения, которое она выпускает для конкуренции с ChatGPT. Осторожность Google также отражает растущую глобальную тенденцию к страху, в том числе предостерегая компании от раскрытия информации о чат-ботах.

Все больше компаний по всему миру внедряют меры защиты в отношении чат-ботов на базе искусственного интеллекта, среди которых Samsung, Amazon и Deutsche Bank.

По данным опроса, проведенного американским сайтом Fishbowl среди почти 12 000 человек, по состоянию на январь около 43% технических специалистов использовали ChatGPT или другие инструменты искусственного интеллекта, часто не сообщая об этом своему руководству.

Как сообщает Insider, к февралю Google запретила своим сотрудникам, использующим чат-бот Bard, разглашать внутреннюю информацию. Сейчас Google внедряет Bard более чем в 180 странах на 40 языках.

Технологии искусственного интеллекта Google применяются в инструментах для автоматического составления электронных писем, документов и даже создания программного обеспечения. Однако эти задачи могут содержать ложную информацию и создавать риск утечки информации.

Буй Хуй (по данным Reuters, Insider)

Источник

Комментарий (0)