По данным VNA , Япония создаст новое агентство, которому будет поручена разработка стандартов безопасности для искусственного интеллекта (ИИ) с целью реагирования на такие риски, как неправомерное использование ИИ для создания фейкового контента и распространения ложной информации, которые становятся все более распространенными.

Вышеуказанная информация была озвучена премьер-министром Фумио Кисидой на заседании Стратегического совета по ИИ, состоявшемся 21 декабря в Токио.

Ожидается, что новая организация будет создана в январе 2024 года под названием «Институт безопасности ИИ» (AISI) при Агентстве по содействию информационным технологиям (IPA) Министерства экономики , торговли и промышленности Японии (METI).

В состав AISI войдут эксперты в области искусственного интеллекта и кибербезопасности, отвечающие за установление стандартов оценки безопасности для компаний, разрабатывающих искусственный интеллект, и проверку риска неправомерного использования искусственного интеллекта.

Также на встрече совет по ИИ обсудил «Руководящие принципы по ИИ», включающие 10 принципов, призывающих отечественные компании ставить людей в центр внимания при разработке или использовании ИИ.

Планируется, что «Руководство по ИИ» будет официально утверждено в марте 2024 года и будет распространяться на разработчиков, поставщиков услуг ИИ и пользователей.

Принципы, изложенные в «Руководящих принципах по ИИ», основаны на «Хиросимском процессе ИИ» Группы семи (G7) по разработке международных правил.

В соответствии с принципом антропоцентричности, руководящие принципы призывают компании уважать права человека и многообразие, принимать меры по борьбе с дезинформацией и полностью воздерживаться от разработки, предоставления и использования сервисов на основе искусственного интеллекта, которые негативно влияют на принятие решений и эмоции человека. Кроме того, руководящие принципы включают в себя другие принципы, такие как защита конфиденциальности, обеспечение справедливости, безопасности и прозрачности.

Ранее в октябре премьер-министр Великобритании Риши Сунак объявил о создании в стране первого в мире Института безопасности искусственного интеллекта (ИИ) для тестирования, оценки и проверки новых форм ИИ. Там регулирующие органы смогут оценить возможности каждой новой модели, выявляя все риски: от социального вреда, такого как предвзятость и дезинформация, до самых высоких.

Вскоре после этого министр торговли США Джина Раймондо объявила, что США создадут Институт безопасности ИИ на основе сотрудничества с Национальным институтом стандартов и технологий для обеспечения безопасности и надежности искусственного интеллекта.

В последнее время инструменты искусственного интеллекта стали новым прорывом в волне инвестиций в технологии. Однако эксперты в области технологий отмечают, что искусственный интеллект сопряжен со множеством рисков и проблем, связанных с уровнем доверия к данным, алгоритмам и приложениям.

Поэтому, чтобы максимально использовать преимущества искусственного интеллекта, важно дать общественности уверенность в том, что эта технология разрабатывается и используется ответственно.

Недавно 18 стран, включая США, Великобританию, Германию, Италию, Чехию, Польшу, Австралию, Чили, Сингапур... подписали соглашение, призванное стимулировать компании к созданию систем искусственного интеллекта, которые являются безопасными уже на стадии проектирования, чтобы избежать риска злоупотреблений.

Это рассматривается как последняя из серии инициатив правительств по всему миру, направленных на формирование развития искусственного интеллекта, который оказывает все большее влияние на промышленность и общество в целом.

Минь Хоа (т/ч)

Источник

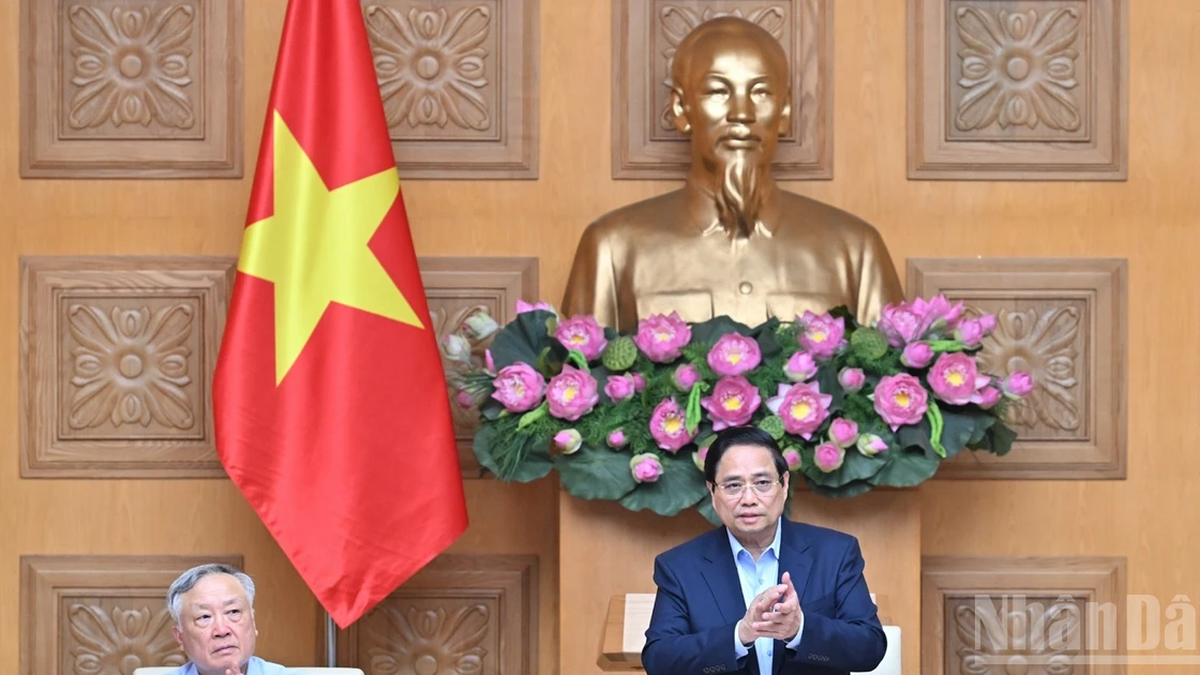

![[Фото] Председатель Национальной ассамблеи посещает семинар «Создание и функционирование международного финансового центра и рекомендации для Вьетнама»](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/7/28/76393436936e457db31ec84433289f72)

Комментарий (0)