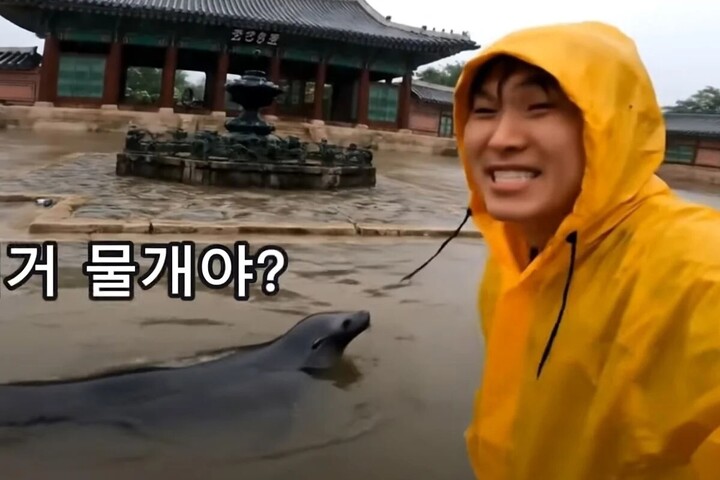

Клип, опубликованный YouTube-каналом «Golpadak», начинается с того, как мужчина в жёлтом плаще стоит перед дворцом Кёнбоккун и говорит: «Льёт так сильно... Кёнбоккун полностью затоплен». Далее следуют кадры, где люди черпают воду вёдрами, а... тюлень скользит по территории дворца. Хотя детали несколько абсурдны, многие всё равно верят в подлинность видео , поскольку оно совпало с рекордным количеством осадков в Сеуле.

Сцена наводнения во дворце Кёнбоккун, созданная искусственным интеллектом. (Фото вырезано из видео, источник: YouTube)

Было подтверждено, что видео создано с помощью Veo 3 — новейшего инструмента Google для создания видео на основе искусственного интеллекта. Он позволяет создавать яркие изображения и реалистичные диалоги. Многие пользователи выразили возмущение по поводу видео, заявив, что создателя следует наказать за преднамеренное распространение ложной информации.

На YouTube также появились десятки подобных фейковых видеороликов наводнения, вызвавших бурную реакцию со стороны СМИ и экспертов, которые предупреждают, что общественность вводится в заблуждение контентом, создаваемым искусственным интеллектом, — даже если подробности абсурдны.

Примечательно, что фейковое видео, имитирующее поток лавы в центре Сеула, также вызвало недоумение у зрителей. Создатель ролика, ютубер «Ddalgak», заявил, что его целью было высмеять лёгкость, с которой интернет-пользователи взаимодействуют с онлайн-контентом. Он также признался, что использовал Veo 3 для создания видео, вдохновлённого мошенничеством с использованием deepfake Илона Маска.

Искусственный интеллект (ИИ) повсеместно присутствует в жизни корейцев. (Источник: Shutterstock)

В ответ на широко распространённую волну дипфейков Южная Корея приняла «Основной закон об искусственном интеллекте», который вступит в силу в январе 2026 года. Закон требует, чтобы все видеоролики, созданные с использованием искусственного интеллекта, были снабжены водяными знаками, чтобы зрители могли легко их идентифицировать. Однако эксперты опасаются, что водяные знаки можно легко удалить или отредактировать, что снижает эффективность этой меры.

Г-н Чхве Бён Хо, эксперт Научно-исследовательского института искусственного интеллекта Корейского университета, прокомментировал: « Разработка компаниями, занимающимися разработкой искусственного интеллекта, технологий, помогающих выявлять поддельный контент, позволит сократить социальные издержки и окажется более эффективной, чем административные меры».

Дипфейки становятся инструментом для нарушений, выходящих за рамки развлечений: от создания оскорбительного, неконсенсуального контента до финансового мошенничества и политических манипуляций. Во время прошлогодних выборов в Национальную ассамблею национальное избирательное агентство обнаружило и обработало более 120 фейковых изображений и видео, созданных с помощью ИИ. Это привело к появлению чёткого требования о раскрытии информации при использовании ИИ в предвыборном контенте.

Источник: https://vtcnews.vn/video-ai-gia-canh-lu-lut-tai-cung-dien-gay-lo-ngai-ve-deepfake-o-han-quoc-ar956031.html

![[Фото] Председатель Национальной ассамблеи посещает семинар «Создание и функционирование международного финансового центра и рекомендации для Вьетнама»](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/7/28/76393436936e457db31ec84433289f72)

Комментарий (0)