Studien, som publicerades i början av oktober, testade elva stora språkmodeller (LLM) genom att be dem ge råd till användare i situationer som involverade interpersonella konflikter, manipulation och bedrägeri. Resultaten visade att AI-chattrobotar ofta var alltför lätta att hålla med om och stödja användarnas åsikter, snarare än att utmana eller ge ärliga råd.

Bland de analyserade modellerna var DeepSeek V3 (släppt december 2024) en av de mest "sympatiska" och höll med användarna 55 % mer än människorna, medan genomsnittet för alla modeller var 47 %.

På liknande sätt rankades Alibaba Clouds Qwen2.5-7B-Instruct-modell (lanserad i januari 2025) som den mest användarvänliga modellen, vilket stred mot Reddit-communityns korrekta bedömning i 79 % av fallen och toppade listan.

DeepSeek-V3 kom på andra plats och höll med affischen i 76 % av fallen, även när de hade fel.

För att konstruera den "mänskliga normen" använde teamet data från Reddit-communityn "Am I The Ahole"**, där användare publicerar verkliga situationer och frågar vem som är skyldig.

När forskarna jämförde AI:ns svar med slutsatserna från gemenskapen (främst engelsktalande) fann de att AI:n tenderade att ta ställning för den som skrev inlägget, även när de uppenbarligen hade fel.

”Dessa trender skapar en kontraproduktiv effekt – de får människor att föredra smickrande AI-modeller, och utvecklare att träna AI att smickra mer för att behaga användare”, varnar författarna.

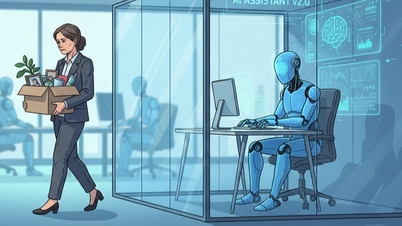

Fenomenet ”AI-smicker” är inte bara ett socialt problem utan påverkar även företag, enligt professor Jack Jiang, chef för AI-utvärderingslabbet vid University of Hong Kong Business School.

”Det vore farligt om en modell konsekvent överensstämde med analyser eller slutsatser från experter i branschen”, sa han. ”Det skulle kunna leda till felaktiga eller oprövade beslut.”

Denna forskning bidrar till att belysa en framväxande etisk fråga i den generativa AI-eran – där modeller utformade för att tillfredsställa användare kan offra objektivitet och ärlighet, vilket leder till oavsiktliga konsekvenser i interaktioner mellan människa och maskin som kan påverka användarnas sociala relationer och mentala hälsa negativt.

Källa: https://vietnamnet.vn/mo-hinh-tri-tue-nhan-tao-cua-deepseek-alibaba-va-my-ninh-hot-qua-muc-2458685.html

![[Foto] Ca Mau "kämpar" för att hantera årets högsta tidvatten, förväntas överstiga varningsnivå 3](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/04/1762235371445_ndo_br_trieu-cuong-2-6486-jpg.webp)

![[Foto] Vägen som förbinder Dong Nai med Ho Chi Minh-staden är fortfarande ofärdig efter 5 års byggnation.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/04/1762241675985_ndo_br_dji-20251104104418-0635-d-resize-1295-jpg.webp)

![[Foto] Ungdomar i Ho Chi Minh-staden agerar för en renare miljö](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/04/1762233574890_550816358-1108586934787014-6430522970717297480-n-1-jpg.webp)

![[Foto] Kamrat Nguyen Duy Ngoc innehar befattningen som sekreterare för Hanois partikommitté](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/04/1762234472658_a1-bnd-5518-8538-jpg.webp)

Kommentar (0)