Det taiwanesiska företaget Foxconn meddelade idag (10 mars) att de har utvecklat sin första storskaliga språkmodell och planerar att använda tekniken för att förbättra tillverkning och leveranskedjehantering.

Modellen – kallad ”FoxBrain” – tränades med hjälp av 120 av Nvidias H100-grafikprocessorer och färdigställdes på cirka fyra veckor, hävdar världens största kontraktschiptillverkare.

Foxconn lanserar sin första stora språkmodell, mycket nära världsledande standarder.

Företaget, som monterar iPhones åt Apple och även tillverkar Nvidias artificiella intelligens-servrar, sa att modellen är baserad på Metas Llama 3.1-arkitektur.

Detta är Taiwans första stora språkmodell med inferensfunktioner, optimerad för traditionell kinesiska och taiwanesiska språkstilar.

Foxconn sa att även om det finns ett litet prestandaskillnad jämfört med DeepSeeks destillerade modell från Kina, så ligger FoxBrains totala prestanda mycket nära världsledande standarder.

FoxBrain, som ursprungligen var utformat för interna applikationer, inkluderar dataanalys, beslutsstöd, dokumentsamarbete, matematik, resonemang och problemlösning samt generering av programmeringskod.

Foxconn planerar att samarbeta med teknikpartners för att utöka modellens tillämpningar, dela information med öppen källkod och utnyttja artificiell intelligens inom tillverkning, leveranskedjehantering och smart beslutsfattande.

Enligt Foxconn gav Nvidia support genom superdatorn "Taipei-1" som finns i Taiwan och bidrog med teknisk rådgivning under modellträningen.

Taipei-1, den största superdatorn i Taiwan, ägs och drivs av Nvidia i Kaohsiung, en stad på södra delen av ön.

Foxconn förväntas tillkännage mer detaljer om modellen på Nvidias GTC-utvecklarkonferens i mitten av mars.

(Källa: Reuters)

[annons_2]

Källa: https://www.baogiaothong.vn/foxconn-ra-mat-mo-hinh-ngon-ngu-lon-dau-tien-192250310181358802.htm

![[Foto] Njut av Liuyang fyrverkerifestival i Hunan, Kina](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761463428882_ndo_br_02-1-my-1-jpg.webp)

![[Foto] Generalsekreterare To Lam tog emot delegationen som deltog i den internationella konferensen om Vietnamstudier](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761456527874_a1-bnd-5260-7947-jpg.webp)

![[Foto] Tidningen Nhan Dan visar och ber om kommentarer på utkast till dokument från den 14:e nationella partikongressen.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761470328996_ndo_br_bao-long-171-8916-jpg.webp)

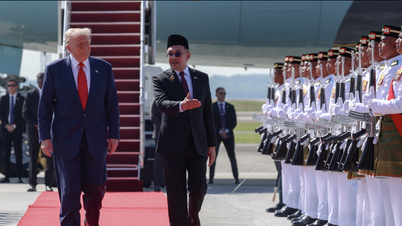

![[Foto] Premiärminister Pham Minh Chinh deltar i öppnandet av det 47:e ASEAN-toppmötet](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761452925332_c2a-jpg.webp)

Kommentar (0)