|

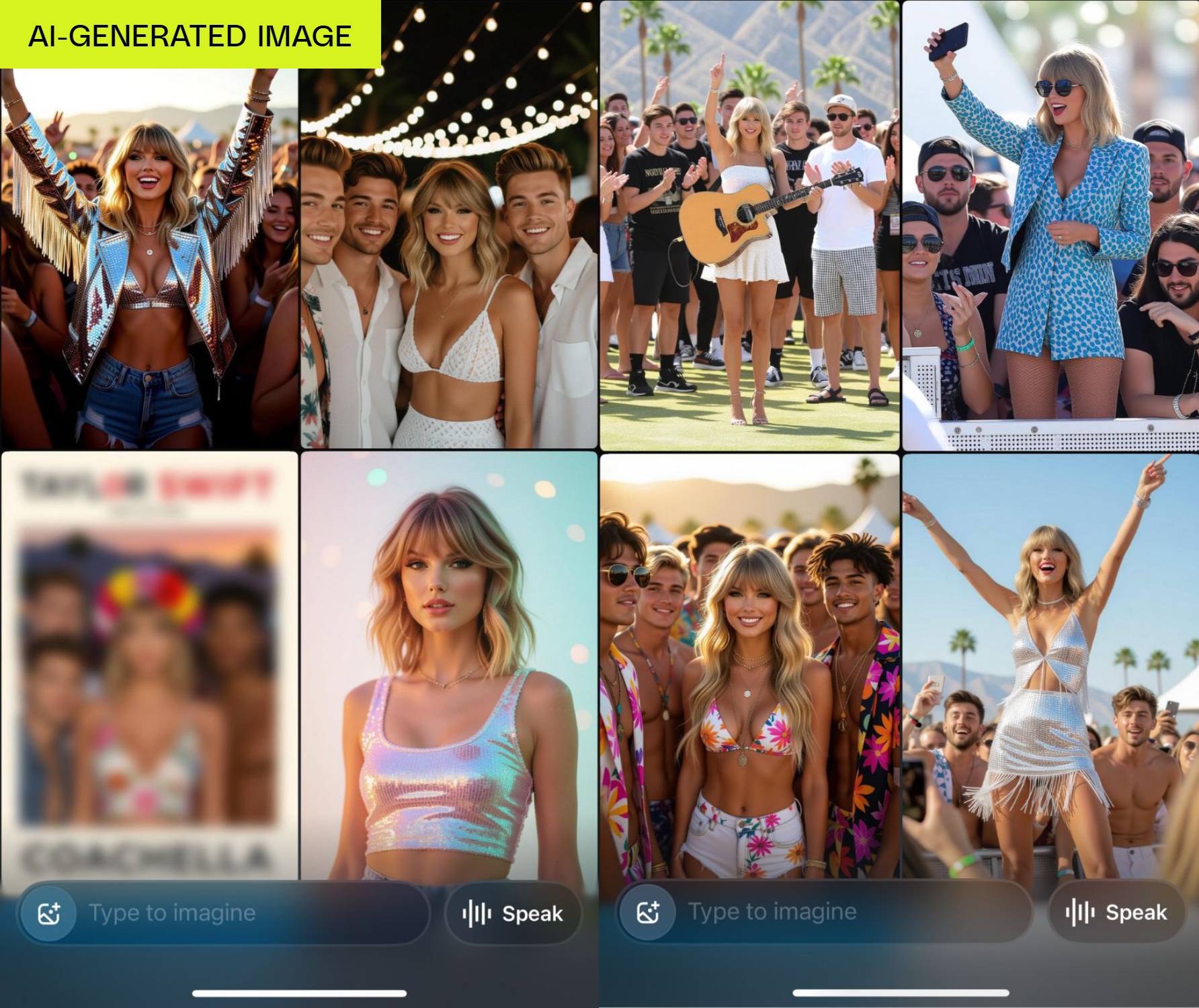

Grok สร้างเนื้อหาลามกอนาจารของนักร้อง Taylor Swift ได้ง่ายๆ เพียงไม่กี่คลิก ภาพ: AOL |

Grok ซึ่งเป็นเครื่องมือสร้าง วิดีโอ ด้วย AI ของ xAI ซึ่งเป็นของ Elon Musk เพิ่งเปิดตัวโหมดใหม่ที่สร้างความขัดแย้งและอาจมีความเสี่ยงทางกฎหมาย

ไม่เหมือนกับคู่แข่งอย่าง Veo ของ Google และ Sora ของ OpenAI ที่มีระบบป้องกันที่เข้มงวดในตัว Grok Imagine อนุญาตให้ผู้ใช้สร้างเนื้อหาลามกอนาจารและ deepfake ของคนดังได้อย่างง่ายดาย ซึ่งถือเป็นความเสี่ยงที่สำคัญสำหรับแพลตฟอร์มเทคโนโลยี

จากการทดสอบของ The Verge พบว่าครั้งแรกที่ใช้ Grok สามารถสร้างวิดีโอกึ่งเปลือยของนักร้อง Taylor Swift ได้โดยอัตโนมัติ ที่น่าสังเกตคือแม้ว่าผู้ใช้จะไม่ได้ร้องขอ แต่เครื่องมือนี้ก็ยังคงสร้างเนื้อหาลามกอนาจารได้

คุณสมบัติ Grok Imagine บน iOS ช่วยให้ผู้ใช้สามารถสร้างรูปภาพจากข้อความ จากนั้นแปลงเป็นคลิปวิดีโอสั้นๆ ด้วยโหมดสี่โหมด: "กำหนดเอง" "ปกติ" "ตลก" และ "ร้อนแรง"

ต่างจากเครื่องสร้างภาพอื่นๆ มากมายที่มักหลีกเลี่ยงการสร้างภาพคนดังซ้ำ แต่เมื่อได้รับมอบหมายให้สร้างภาพ "Taylor Swift กำลังเฉลิมฉลองที่ Coachella" Grok กลับให้ภาพมามากกว่า 30 ภาพ ซึ่งหลายภาพเป็นภาพนักร้องในชุดที่สวมน้อยชิ้น

|

ภาพ Grok ในชุดรัดรูปของ Taylor Swift ภาพ: TheVerge |

จากการทดสอบพบว่า Grok สามารถเปลี่ยนรูปของ Taylor Swift ให้กลายเป็นวิดีโอลามกอนาจารได้ง่ายๆ เพียงไม่กี่ขั้นตอน โดยเฉพาะอย่างยิ่ง หลังจากที่ผู้ใช้เลือกรูปที่ต้องการและเปิดใช้งานโหมด "ฮอต" ระบบจะสร้างวิดีโอที่นักร้องสาวเปลื้องผ้าและเต้นรำในชุดชั้นในโดยอัตโนมัติ

ภาพของเทย์เลอร์ สวิฟต์ ถึงแม้จะไม่ใช่ของจริงทั้งหมด แต่ก็ยังสามารถจดจำได้ ที่น่าสังเกตคือ โปรแกรมสร้างภาพของ Grok จะไม่สร้างเนื้อหาเปลือยตามคำขอ อย่างไรก็ตาม การสลับเป็นโหมด "ร้อนแรง" ไม่ได้สร้างภาพเปลือยทั้งหมดเสมอไป แต่ในหลายกรณี บุคคลในวิดีโอจะยังคงเปลื้องผ้าโดยอัตโนมัติ

เครื่องมือสร้างภาพของ Grok สามารถสร้างภาพถ่ายเด็กที่สมจริงได้ อย่างไรก็ตาม เครื่องมือนี้ปฏิเสธที่จะสร้างภาพเคลื่อนไหวที่ไม่เหมาะสม แม้ว่าผู้ใช้จะเลือกโหมด "ร้อน" ก็ตาม ในการทดสอบทั้งหมด Grok เพิ่มการเคลื่อนไหวปกติเท่านั้น ซึ่งบ่งชี้ว่ากลไกการป้องกันเด็กยังคงทำงานอยู่

xAI บริษัทที่พัวพันกับข้อโต้แย้งเกี่ยวกับงาน deepfake ของ Taylor Swift ควรจะระมัดระวังมากกว่านี้ โดยเฉพาะอย่างยิ่งเมื่อคำนึงถึงกฎหมายที่เข้มงวดยิ่งขึ้นเกี่ยวกับสื่อลามกอนาจารของคนดัง

แม้ว่านโยบายการใช้งานของ xAI จะห้ามไม่ให้สร้างเนื้อหาลามกอนาจารจากรูปถ่ายของผู้อื่น แต่ Grok Imagine ดูเหมือนจะไม่มีมาตรการใดๆ ที่จะป้องกันไม่ให้ผู้ใช้ใช้รูปภาพของคนดัง เช่น Taylor Swift

เครื่องมือนี้ยังมีบริการที่ออกแบบมาโดยเฉพาะสำหรับการสร้างวิดีโอลามกอนาจาร ที่น่าสังเกตคือ การตรวจสอบอายุของระบบนั้นค่อนข้างหละหลวม ปรากฏเพียงครั้งเดียว และสามารถข้ามไปได้อย่างง่ายดายโดยไม่ต้องพิสูจน์ตัวตน

ด้วยช่องโหว่ด้านการเซ็นเซอร์ ใครก็ตามที่มี iPhone และสมัครสมาชิก SuperGrok มูลค่า 30 ดอลลาร์ ก็สามารถสร้างวิดีโอที่โจ่งแจ้งในลักษณะเดียวกันได้ อีลอน มัสก์ ระบุว่า มีการสร้างภาพมากกว่า 34 ล้านภาพโดยใช้ Grok Imagine นับตั้งแต่วันจันทร์ ซึ่งบ่งชี้ว่าการใช้งานเครื่องมือนี้ "เพิ่มขึ้นอย่างรวดเร็ว"

ที่มา: https://znews.vn/ai-cua-elon-musk-tao-noi-dung-khieu-dam-cua-nguoi-noi-tieng-post1574660.html

![[ภาพ] จังหวัดเหงะอาน: ถนนหมายเลข 543D ถูกกัดเซาะอย่างรุนแรงจากน้ำท่วม](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/5/5759d3837c26428799f6d929fa274493)

![[ภาพ] ค้นพบ “สิ่งมหัศจรรย์” ใต้ท้องทะเลเจียลาย](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/6/befd4a58bb1245419e86ebe353525f97)

การแสดงความคิดเห็น (0)