เจฟฟรีย์ แมคเกรเกอร์ ซีอีโอของ Truepic กล่าวว่าเหตุการณ์นี้เป็นเพียงส่วนเล็ก ๆ ของปัญหาเท่านั้น แมคเกรเกอร์กล่าวว่าจะมีคอนเทนต์ที่สร้างโดย AI มากขึ้นบนโซเชียลมีเดีย และเรายังไม่พร้อมสำหรับเรื่องนี้

CNN รายงานว่า Truepic ต้องการแก้ปัญหานี้ด้วยการนำเสนอเทคโนโลยีที่อ้างว่าสามารถยืนยันตัวตนของสื่อได้ ณ ขณะสร้างภาพผ่าน Truepic Lens แอปเก็บข้อมูลนี้จะแจ้งวันที่ เวลา สถานที่ และอุปกรณ์ที่ใช้สร้างภาพให้ผู้ใช้ทราบ และจะใส่ลายเซ็นดิจิทัลเพื่อยืนยันว่าภาพดังกล่าวเป็นภาพธรรมชาติหรือภาพที่สร้างโดย AI

ภาพปลอมระเบิดเพนตากอนแพร่ระบาดบนทวิตเตอร์

Truepic บริษัทที่ได้รับการสนับสนุนจาก Microsoft ซึ่งก่อตั้งในปี 2015 กล่าวว่าบริษัทได้รับความสนใจจาก องค์กรพัฒนาเอกชน (NGO) ไปจนถึงบริษัทสื่อ รวมถึงบริษัทประกันภัยที่ต้องการยืนยันว่าการเรียกร้องค่าสินไหมทดแทนนั้นถูกต้องตามกฎหมาย

แม็คเกรเกอร์กล่าวว่าเมื่อทุกสิ่งสามารถปลอมแปลงได้ เมื่อปัญญาประดิษฐ์ไปถึงจุดสูงสุดในด้านคุณภาพและการเข้าถึง เราจะไม่รู้ว่าความเป็นจริงบนอินเทอร์เน็ตคืออะไรอีกต่อไป

บริษัทเทคโนโลยีอย่าง Truepic ได้พยายามต่อสู้กับข้อมูลเท็จทางออนไลน์มาหลายปีแล้ว แต่การเกิดขึ้นของเครื่องมือ AI สายพันธุ์ใหม่ที่สามารถสร้างภาพและข้อความได้ตามคำสั่งของผู้ใช้ ยิ่งเพิ่มความเร่งด่วนเข้าไปอีก เมื่อต้นปีที่ผ่านมา ภาพปลอมของสมเด็จพระสันตะปาปาฟรานซิสในเสื้อแจ็คเก็ตดาวน์ของแบรนด์ Balenciaga และอดีตประธานาธิบดีโดนัลด์ ทรัมป์ ถูกจับกุม ถูกแชร์กันอย่างแพร่หลาย เหตุการณ์ทั้งสองนี้ทำให้ผู้คนหลายล้านคนสับสนเกี่ยวกับอันตรายที่อาจเกิดขึ้นจาก AI

ขณะนี้ สมาชิกรัฐสภาบางคนกำลังเรียกร้องให้บริษัทเทคโนโลยีแก้ไขปัญหานี้โดยการติดป้ายกำกับเนื้อหาที่สร้างโดย AI เวรา จูโรวา รองประธานคณะกรรมาธิการยุโรป (EC) กล่าวว่า บริษัทต่างๆ ซึ่งรวมถึง Google, Meta, Microsoft และ TikTok ได้เข้าร่วมจรรยาบรรณโดยสมัครใจของสหภาพยุโรป (EU) ว่าด้วยการต่อต้านข้อมูลบิดเบือน

บริษัทสตาร์ทอัพและยักษ์ใหญ่ด้านเทคโนโลยีจำนวนเพิ่มมากขึ้น รวมถึงบางรายที่นำ AI เชิงสร้างสรรค์มาใช้กับผลิตภัณฑ์ของตน กำลังพยายามนำมาตรฐานและโซลูชันมาใช้เพื่อช่วยให้ผู้คนระบุได้ว่ารูปภาพหรือ วิดีโอ นั้นถูกสร้างขึ้นด้วย AI หรือไม่

แต่เนื่องจากเทคโนโลยี AI ก้าวหน้าเร็วกว่าที่มนุษย์จะตามทัน จึงไม่แน่ชัดว่าโซลูชันเหล่านี้จะสามารถแก้ปัญหาได้อย่างสมบูรณ์หรือไม่ แม้แต่ OpenAI บริษัทที่อยู่เบื้องหลัง Dall-E และ ChatGPT ก็ยังยอมรับว่าความพยายามของตนเองในการช่วยตรวจจับการเขียนที่สร้างโดย AI นั้นยังไม่สมบูรณ์แบบ

บริษัทต่างๆ ที่พัฒนาโซลูชันกำลังใช้สองแนวทางในการแก้ไขปัญหานี้ แนวทางแรกอาศัยการพัฒนาโปรแกรมเพื่อระบุภาพที่สร้างโดย AI หลังจากที่ภาพเหล่านั้นถูกสร้างและเผยแพร่ทางออนไลน์แล้ว อีกแนวทางหนึ่งมุ่งเน้นไปที่การทำเครื่องหมายภาพว่าเป็นภาพจริงหรือภาพที่สร้างโดย AI ด้วยลายเซ็นดิจิทัล

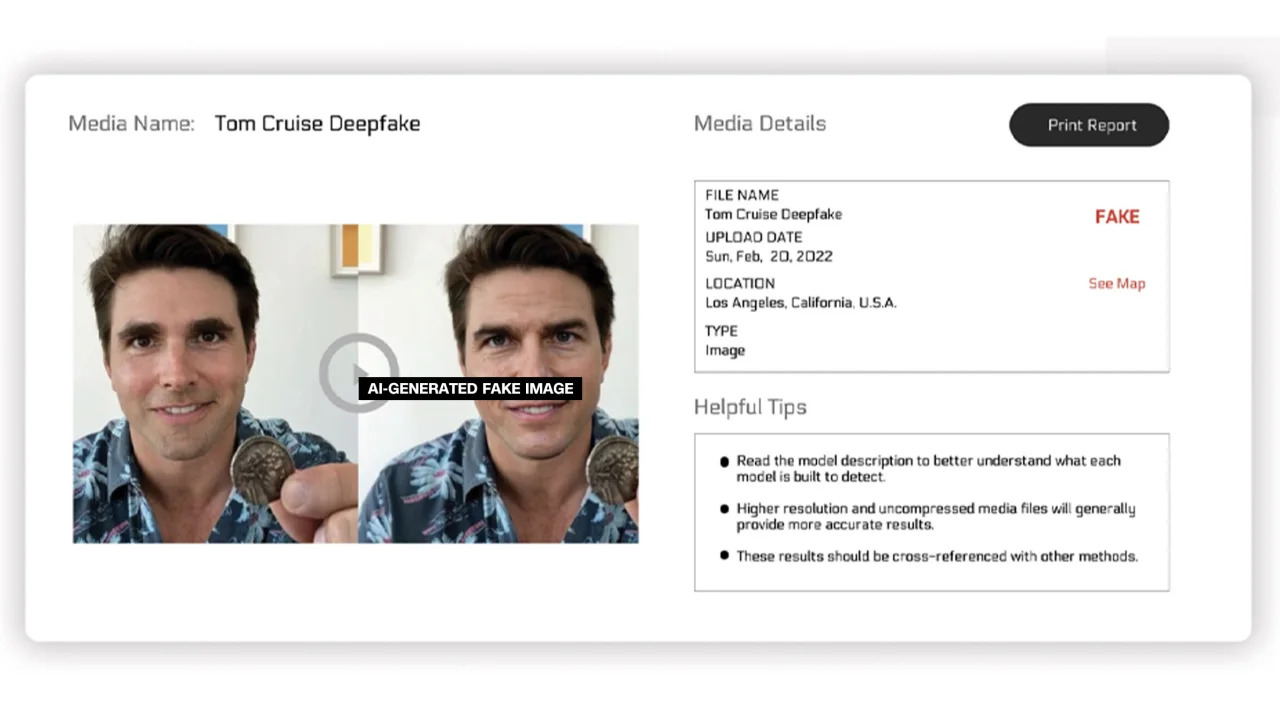

Reality Defender และ Hive Moderation กำลังพัฒนาส่วนแรก แพลตฟอร์มของพวกเขาช่วยให้ผู้ใช้สามารถอัปโหลดรูปภาพเพื่อสแกน จากนั้นจะได้รับรายละเอียดที่แสดงให้เห็นว่ารูปภาพนั้นเป็นของจริงหรือสร้างขึ้นโดย AI

Reality Defender ระบุว่าบริษัทใช้เทคโนโลยี Deepfake และ Generative Content Fingerprinting ที่เป็นกรรมสิทธิ์ของบริษัท เพื่อตรวจจับวิดีโอ เสียง และภาพที่สร้างโดย AI ตัวอย่างที่บริษัทนำเสนอคือ Reality Defender ที่แสดงภาพ Deepfake ของทอม ครูซ ซึ่งมีความ “น่าสงสัย” ถึง 53% เนื่องจากบุคคลในภาพมีใบหน้าที่บิดเบี้ยว ซึ่งมักพบเห็นได้ในภาพถ่ายที่ถูกแต่งเติม

รูปภาพที่มีป้ายกำกับที่สร้างโดย AI

บริการเหล่านี้มีทั้งแบบฟรีและแบบเสียเงิน Hive Moderation ระบุว่าคิดค่าบริการ 1.50 ดอลลาร์ต่อ 1,000 ภาพ Realty Defender ระบุว่าราคาอาจแตกต่างกันไปตามปัจจัยหลายประการ ในกรณีที่ลูกค้าต้องการความเชี่ยวชาญและการสนับสนุนจากบริษัท Ben Colman ซีอีโอของ Reality Defender กล่าวว่าความเสี่ยงเพิ่มขึ้นเป็นสองเท่าทุกเดือน เพราะใครๆ ก็สามารถสร้างภาพปลอมโดยใช้เครื่องมือ AI ได้

บริษัทอื่นๆ อีกหลายแห่งกำลังพัฒนาการเพิ่มป้ายกำกับลงบนรูปภาพเพื่อรับรองว่าเป็นของจริงหรือสร้างขึ้นโดย AI จนถึงปัจจุบัน ความพยายามนี้ส่วนใหญ่ได้รับแรงผลักดันจากพันธมิตรด้านความถูกต้องของเนื้อหาและแหล่งกำเนิด (Content Authenticity and Origination Alliance: C2PA)

C2PA ก่อตั้งขึ้นในปี พ.ศ. 2564 เพื่อสร้างมาตรฐานทางเทคนิคสำหรับการรับรองแหล่งที่มาและประวัติของสื่อดิจิทัล โดยผสานรวมโครงการ Content Authentication Initiative (CAI) ของ Adobe และ Project Origin ซึ่งนำโดย Microsoft และ BBC เข้าด้วยกัน โดยมุ่งเน้นที่การต่อสู้กับข้อมูลที่ผิดในข่าวดิจิทัล บริษัทอื่นๆ ที่มีส่วนเกี่ยวข้องกับ C2PA ได้แก่ Truepic, Intel และ Sony

โดยยึดตามหลักการของ C2PA ทาง CAI จะเผยแพร่เครื่องมือโอเพนซอร์สสำหรับบริษัทต่างๆ เพื่อสร้างข้อมูลประจำตัวของเนื้อหา หรือเมตาดาต้า ซึ่งประกอบด้วยข้อมูลเกี่ยวกับรูปภาพ เว็บไซต์ของ CAI ระบุว่า วิธีนี้ช่วยให้ผู้สร้างสามารถแบ่งปันรายละเอียดเกี่ยวกับวิธีการสร้างรูปภาพได้อย่างโปร่งใส วิธีนี้ช่วยให้ผู้ใช้สามารถเข้าถึงบริบทเกี่ยวกับใคร สิ่งใด และวิธีแก้ไขรูปภาพ จากนั้นจึงสามารถประเมินได้ด้วยตนเองว่ารูปภาพนั้นมีความสมจริงมากน้อยเพียงใด

หลายบริษัทได้ผสานรวมมาตรฐาน C2PA และเครื่องมือ CAI เข้ากับแอปพลิเคชันของตนแล้ว Firefly ของ Adobe ซึ่งเป็นเครื่องมือสร้างภาพ AI ตัวใหม่ที่เพิ่มเข้ามาใน Photoshop ได้ปฏิบัติตามมาตรฐาน C2PA ผ่านฟีเจอร์ Content Credentials นอกจากนี้ Microsoft ยังประกาศว่ารูปภาพและวิดีโอที่สร้างด้วย Bing Image Creator และ Microsoft Designer จะมีลายเซ็นเข้ารหัสในอีกไม่กี่เดือนข้างหน้า

ในเดือนพฤษภาคม Google ได้ประกาศฟีเจอร์ "เกี่ยวกับรูปภาพนี้" ซึ่งช่วยให้ผู้ใช้ทราบว่ารูปภาพปรากฏบน Google ครั้งแรกเมื่อใด และสามารถดูได้จากที่ใด นอกจากนี้ Google ยังประกาศว่ารูปภาพทุกรูปที่ Google สร้างด้วย AI จะมีมาร์กอัปในไฟล์ต้นฉบับเพื่อ "เพิ่มบริบท" หากพบรูปภาพดังกล่าวบนเว็บไซต์หรือแพลตฟอร์มอื่น

ในขณะที่บริษัทเทคโนโลยีกำลังพยายามแก้ไขข้อกังวลเกี่ยวกับภาพที่สร้างโดย AI และความถูกต้องของสื่อดิจิทัล ผู้เชี่ยวชาญในสาขานี้ย้ำว่าธุรกิจต่างๆ จะต้องทำงานร่วมกันและร่วมมือกับรัฐบาลเพื่อแก้ไขปัญหานี้ อย่างไรก็ตาม บริษัทเทคโนโลยีกำลังเร่งพัฒนา AI แม้จะมีความเสี่ยงอยู่ก็ตาม

ลิงค์ที่มา

![[ภาพ] โสมแดนภูเขา ของขวัญล้ำค่าจากธรรมชาติสู่ดินแดนกิญบั๊ก](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F30%2F1764493588163_ndo_br_anh-longform-jpg.webp&w=3840&q=75)

การแสดงความคิดเห็น (0)