Стрімкий розвиток штучного інтелекту (ШІ) викликав занепокоєння, що він розвивається швидше, ніж люди можуть усвідомити його вплив.

Фото: СТ

Використання загального штучного інтелекту значно зросло після появи таких інструментів, як ChatGPT. Хоча ці інструменти мають багато переваг, їх також можна неправильно використовувати у шкідливий спосіб.

Щоб керувати цим ризиком, США та кілька інших країн уклали угоди з сімома компаніями, включаючи Amazon, Anthropic, Google, Inflection, Meta, Microsoft та OpenAI, про зобов'язання дотримуватися безпечних практик у розробці технологій штучного інтелекту.

Заява Білого дому супроводжується власною термінологією, яка може бути незнайомою пересічній людині, зокрема такими термінами, як «червоне об’єднання» та «водяний знак». Ось сім термінів, пов’язаних зі штучним інтелектом, на які варто звернути увагу.

Машинне навчання

Ця галузь штучного інтелекту має на меті навчити машини точно виконувати певне завдання, визначаючи закономірності. Потім машина може робити прогнози на основі цих даних.

Глибоке навчання

Креативні завдання зі штучним інтелектом часто спираються на глибоке навчання – метод, який передбачає навчання комп’ютерів за допомогою нейронних мереж, набору алгоритмів, розроблених для імітації нейронів людського мозку, для створення складних зв’язків між шаблонами для генерації тексту, зображень чи іншого контенту.

Оскільки моделі глибокого навчання мають кілька шарів нейронів, вони можуть вивчати складніші закономірності, ніж традиційне машинне навчання.

Модель великої мови

Модель великої мови, або LLM, навчається на величезних обсягах даних і має на меті моделювати мову або передбачати наступне слово в послідовності. Моделі великої мови, такі як ChatGPT та Google Bard, можна використовувати для таких завдань, як підсумовування, переклад та розмова.

Алгоритм

Набір інструкцій або правил, що дозволяють машинам робити прогнози, вирішувати проблеми або виконувати завдання. Алгоритми можуть надавати рекомендації щодо покупок, допомагати у виявленні шахрайства та використовувати функції чату служби підтримки клієнтів.

Упередженість

Оскільки ШІ навчається з використанням великих наборів даних, він може включати в них шкідливу інформацію, таку як мова ворожнечі. Расизм і сексизм також можуть з'являтися в наборах даних, що використовуються для навчання ШІ, що призводить до появи оманливого контенту.

Компанії, що займаються штучним інтелектом, погодилися глибше дослідити, як уникнути шкідливої упередженості та дискримінації в системах штучного інтелекту.

Червоні об'єднання

Одне з зобов'язань, які компанії взяли на себе перед Білим домом, полягає в проведенні «червоної команди» як внутрішнього, так і зовнішнього рівня щодо моделей та систем штучного інтелекту.

«Червона команда» передбачає тестування моделі для виявлення потенційних вразливостей. Термін походить від військової практики, де команда імітує дії нападника, щоб розробити стратегії.

Цей метод широко використовується для перевірки вразливостей безпеки в таких системах, як платформи хмарних обчислень від таких компаній, як Microsoft та Google.

Водяний знак

Водяний знак – це спосіб визначити, чи звук чи зображення було створено штучним інтелектом. Факти, що перевіряються для підтвердження, можуть включати інформацію про те, хто його створив, а також як і коли його було створено або відредаговано.

Наприклад, Microsoft зобов’язалася наносити водяні знаки на зображення, створені за допомогою її інструментів штучного інтелекту. Компанії також зобов’язалися перед Білим домом наносити водяні знаки на зображення або записувати їхнє походження, щоб ідентифікувати їх як створені штучним інтелектом.

Водяні знаки також часто використовуються для відстеження порушень прав інтелектуальної власності. Водяні знаки для зображень, створених штучним інтелектом, можуть виглядати як непомітний шум, наприклад, незначна зміна кожного сьомого пікселя.

Однак, додавання водяних знаків до тексту, згенерованого штучним інтелектом, може бути складнішим і може включати налаштування шаблону слова, щоб його можна було ідентифікувати як контент, згенерований штучним інтелектом.

Хоангтон (за словами Пойнтера)

Джерело

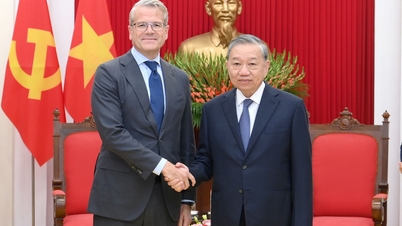

![[Фото] Генеральний секретар То Лам приймає віце-прем'єр-міністра та міністра оборони Словаччини Роберта Калінака](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/18/1763467091441_a1-bnd-8261-6981-jpg.webp)

Коментар (0)