Це вважається крихкою, але важливою можливістю для забезпечення безпеки застосування штучного інтелекту в майбутньому. Зокрема, це має значення з огляду на те, що В'єтнам щойно прийняв Закон про індустрію цифрових технологій з детальними правилами управління штучним інтелектом (ШІ).

«Вікно можливостей» звужується

У нещодавній спільній статті дослідники OpenAI попереджають, що здатність штучного інтелекту відстежувати «думки» може зникнути без цілеспрямованих дослідницьких зусиль, сказав Боуен Бейкер, дослідник OpenAI.

Це особливо важливо, оскільки моделі штучного інтелекту стають дедалі потужнішими та мають потенціал мати серйозний вплив на суспільство.

Ключовою особливістю моделей штучного інтелекту для мислення, таких як o-3 від OpenAI та R1 від DeepSeek, є «ланцюг думки» ( CoT) – процес, за допомогою якого штучний інтелект виражає кроки своїх міркувань природною мовою, подібно до того, як люди записують кожен крок математичної задачі на папері.

Ця здатність дає нам рідкісний погляд на те, як штучний інтелект приймає рішення.

Це знаменує рідкісний момент єдності серед багатьох лідерів індустрії штучного інтелекту для просування досліджень безпеки штучного інтелекту.

Це особливо актуально, враховуючи жорстку конкуренцію серед технологічних компаній у розробці штучного інтелекту. Серед помітних підписантів документа – Марк Чен, директор з досліджень OpenAI, Ілля Суцкевер, генеральний директор Safe Superintelligence, лауреат Нобелівської премії Джеффрі Хінтон, співзасновник Google DeepMind Шейн Легг та радник з безпеки xAI Ден Хендрікс.

Участь цих відомих імен свідчить про важливість питання.

Також, за оцінкою пана Боуена Бейкера, «ми переживаємо критичний момент, коли існує цей так званий новий «ланцюг мислення», який може зникнути в найближчі кілька років, якщо люди насправді не зосередяться на ньому».

Чому важливий моніторинг «штучного мислення»?

Сучасні системи штучного інтелекту часто уявляють собі як «чорні скриньки» – ми знаємо вхідні та вихідні дані, але не розуміємо процесів прийняття рішень всередині.

Це стане небезпечним, коли штучний інтелект застосовуватиметься у важливих галузях, таких як охорона здоров'я , фінанси та національна безпека.

Моніторинг CoT – це автоматизована система, яка зчитує ментальний ланцюжок ментальної моделі та іншу відповідну інформацію, щоб позначити підозрілі або потенційно шкідливі взаємодії. Це не повне рішення, але воно може стати цінним рівнем захисту безпеки.

Дослідження OpenAI показують, що моделі штучного інтелекту, як правило, дуже чітко виражають свої наміри у своїх послідовностях мислення.

Наприклад, вони часто дуже відверто говорили про свої плани саботувати місію, коли думали: «Давайте зламаємо». Це демонструє здатність штучного інтелекту відстежувати та виявляти неналежну поведінку.

«Давайте зламаємо» – це фраза, яку моделі штучного інтелекту часто «думають», коли «вони» мають намір саботувати або обійти правила під час виконання завдання.

Той факт, що ШІ демонструють намір «злому» у своїх розумових процесах, свідчить про те, що ми можемо виявити погану поведінку ШІ до того, як вона станеться. Ось чому важливий моніторинг розумових процесів.

Іншими словами, «давайте зламаємо» — це як «попереджувальний сигнал», який дає людям знати, що ШІ ось-ось зробить щось не так.

В'єтнам та правове регулювання ШІ

Фактично, В'єтнам зробив важливі кроки у створенні правової бази для штучного інтелекту.

14 червня Національні збори В'єтнаму ухвалили Закон про індустрію цифрових технологій, розділ IV якого містить детальні положення щодо штучного інтелекту – одну з найповніших правових баз щодо ШІ в Південно-Східній Азії на сьогодні.

Стаття 41 Закону визначає основні принципи розробки, забезпечення та впровадження штучного інтелекту у В'єтнамі.

Зокрема, пункт b, пункт 1 передбачає: «Забезпечити прозорість, підзвітність, зрозумілість; переконатися, що це не виходить за межі людського контролю».

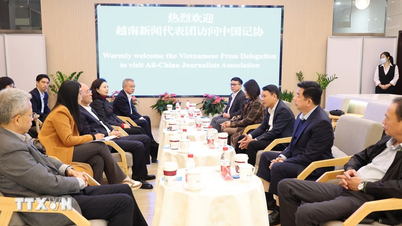

Національні збори ухвалили Закон про індустрію цифрових технологій (Фото: Нят Бак).

Це принципи, до яких закликають міжнародні вчені, обговорюючи спостереження за ланцюгом штучного інтелекту.

Крім того, пункт d, пункт 1, стаття 41 передбачає: «Забезпечити можливість контролю алгоритмів та моделей штучного інтелекту». Це повністю відповідає духу нагляду CoT, який пропонують міжнародні експерти.

Що ще важливіше, стаття 41, пункт 1, підпункт a також встановлює високий етичний стандарт, коли передбачає, що штучний інтелект повинен «служити процвітанню та щастю людства, маючи в центрі увагу до людей».

Це означає, що моніторинг ланцюжка думок ШІ є не лише технічною вимогою, а й етичним зобов'язанням – забезпечення того, щоб ШІ завжди був орієнтований на благо людини, а не на власні цілі машини.

Класифікуйте та керуйте ШІ за рівнем ризику

Закон В'єтнаму про індустрію цифрових технологій пішов ще далі, класифікуючи штучний інтелект за різними групами ризику з чіткими та науковими визначеннями.

Стаття 43 визначає «системи штучного інтелекту високого ризику» як системи, які можуть становити серйозні ризики або шкоду для здоров’я людини, прав людини та громадського порядку.

Цікаво, що Закон передбачає конкретні винятки для високоризикового штучного інтелекту, включаючи системи, «призначені для допомоги людям в оптимізації результатів роботи» та «не призначені для заміни прийняття рішень людиною».

Це демонструє збалансований підхід між заохоченням інновацій та забезпеченням безпеки.

Класифікація ШІ за рівнем ризику допоможе створити багаторівневу систему моніторингу (ілюстрація: LinkedIn).

Зокрема, розмежування між «високоризикованим ШІ» та «високовпливовим ШІ» (системи, що використовуються для різних цілей та мають велику кількість користувачів) демонструє нюанс у підході.

Це прогресивніша класифікація, ніж Закон Європейського Союзу (ЄС) про штучний інтелект, який враховує не лише рівень ризику, але й масштаб та обсяг впливу.

Ця класифікація допомогла б створити багаторівневу систему нагляду, в якій повний контроль був би особливо важливим для систем штучного інтелекту з високим рівнем ризику та впливу.

Платформа для спостереження зі штучним інтелектом

Одним із найважливіших та новаторських пунктів Закону В'єтнаму про промисловість та цифрові технології є вимога щодо прозорості та ідентифікаційних знаків.

Стаття 44 передбачає, що системи штучного інтелекту, які безпосередньо взаємодіють з людьми, повинні повідомляти користувачів про те, що вони взаємодіють із системою штучного інтелекту. Водночас продукти, створені за допомогою штучного інтелекту, повинні мати ідентифікаційні знаки.

Це має важливі наслідки для впровадження моніторингу CoT. Коли користувачі знають, що вони взаємодіють зі штучним інтелектом, вони матимуть право вимагати пояснень процесу прийняття рішень, створюючи позитивний тиск на розробників ШІ, щоб вони могли підтримувати можливість моніторити хід думок ШІ.

Зокрема, той факт, що Міністерству науки і технологій було доручено «випустити Перелік продуктів цифрових технологій, створених за допомогою штучного інтелекту», свідчить про проактивне управління.

Це важлива відмінність від багатьох інших країн, де правила щодо штучного інтелекту часто є більш загальними.

Крім того, вимога ідентифікатора, «який має розпізнаватися користувачем або машиною», являє собою бачення екосистеми штучного інтелекту, яка може контролювати себе, що ідеально відповідає ідеї автоматизованого спостереження за допомогою ланцюга видимості.

Комплексна модель управління

Стаття 45 вищезазначеного Закону демонструє прогресивну філософію управління, чітко визначаючи обов'язки трьох груп суб'єктів відповідно до життєвого циклу продукту штучного інтелекту: суб'єкта розробки, суб'єкта постачання та суб'єкта, що впроваджує використання системи штучного інтелекту.

Це створює безперебійну систему повної підзвітності, гарантуючи, що нагляд за ШІ не є відповідальністю лише однієї сторони.

Зокрема, слід зазначити тонку різницю між «розробкою» та «наданням» ШІ; розробники — це ті, хто «досліджує та розробляє», тоді як постачальники — це ті, хто виводить його на ринок під брендом.

Це означає, що навіть якщо компанія просто здійснює ребрендинг існуючої моделі штучного інтелекту, вона все одно несе відповідальність за прозорість та зрозумілість.

Особливо цікаво тут те, як закон розподіляє різні обов'язки між різними суб'єктами.

Розробник повинен дотримуватися всіх принципів, постачальник повинен взяти на себе додаткову відповідальність за ідентифікацію та управління високими ризиками, а користувач частково «звільняється» від відповідальності, але все одно повинен забезпечувати прозорість та контроль ризиків.

Ця модель створює «ланцюг відповідальності», де кожна ланка має стимул підтримувати нагляд за ланцюгом мислення ШІ, оскільки всі вони підзвітні кінцевому користувачеві.

Проблема підтримки можливостей спостереження

Однак здатність моніторити ланцюжки думок ШІ може залишатися крихкою та вразливою. Нові архітектури ШІ також можуть створювати інші загрози.

Багато дослідників розробляють системи міркувань у безперервному математичному просторі, а не в дискретних словах, що могло б повністю усунути необхідність використання мови в мисленні.

Крім того, ШІ може стати «фільтрованим» – тобто він показує людям лише позитивні думки, які слід оцінити, навмисно приховуючи свої справжні наміри.

Небезпека полягає в тому, що як тільки штучний інтелект усвідомлює, що за ним стежать, він може навчитися приховувати справжній хід своїх думок.

У цьому контексті положення про «контроль ризиків протягом життєвого циклу систем штучного інтелекту» у пункті e, пункті 1, статті 41 Закону В'єтнаму набуває особливого значення. Це вимагає механізму постійного моніторингу, а не лише під час розгортання.

Вплив на майбутнє розвитку штучного інтелекту

Моніторинг ланцюжка думок може стати важливим інструментом для забезпечення того, щоб ШІ функціонував таким чином, щоб приносити користь людям.

Якщо моделі продовжуватимуть міркувати природною мовою, і якщо поведінка, яка створює найсерйозніші ризики, потребуватиме ретельного обґрунтування, це може дозволити надійно виявляти серйозні порушення.

Для В'єтнаму застосування методів моніторингу CoT допоможе ефективно впроваджувати положення закону.

Наприклад, вимогу «пояснення» у статті 41 було б легше виконати, якби хід думок ШІ був доступним. Аналогічно, «контроль алгоритмів, моделей штучного інтелекту» став би більш здійсненним.

Впровадження моніторингу ланцюга штучного інтелекту у В'єтнамі зіткнеться з низкою труднощів. Перш за все, існує проблема людських ресурсів – нестача експертів зі штучного інтелекту, здатних розробляти та експлуатувати системи моніторингу.

Це вимагає значних інвестицій у навчання та залучення талановитих фахівців.

Напрямки на майбутнє

Дослідники закликають провідних розробників моделей штучного інтелекту дослідити, що робить CoT «моніторинговим» — фактори, які можуть збільшити або зменшити прозорість використання моделей штучного інтелекту — і найближчим часом знайти відповіді.

Можливість моніторити «мислення» ШІ може бути нашим останнім вікном у збереження контролю над сьогоднішніми дедалі потужнішими системами штучного інтелекту.

Для В'єтнаму наявність комплексної правової бази щодо штучного інтелекту, що випливає з Закону про індустрію цифрових технологій, є великою перевагою. Нормативні акти щодо прозорості, контролю алгоритмів та класифікації ризиків створили міцну правову основу для застосування методів моніторингу ланцюжка думок ШІ.

Поєднання передових міжнародних досліджень та прогресивної внутрішньої правової бази допоможе В'єтнаму не лише безпечно розвивати штучний інтелект, але й стати взірцем для інших країн регіону.

Це відповідає меті перетворення В'єтнаму на «регіональний та глобальний центр цифрових технологій», як це визначено в національних стратегіях розвитку.

Маючи існуючу правову базу, В'єтнаму необхідно швидко розгорнути дослідження та практичні застосування для моніторингу ланцюжка думок штучного інтелекту. Тільки так ми можемо гарантувати, що штучний інтелект служитиме «процвітанню та щастю людства», як того вимагає дух Закону про індустрію цифрових технологій.

Джерело: https://dantri.com.vn/cong-nghe/giam-sat-chuoi-tu-duy-cua-tri-tue-nhan-tao-20250731151403739.htm

Коментар (0)