Використання трагедії для залучення переглядів

Перекинутий туристичний човен Blue Bay 58 (QN-7105) у затоці Халонг вдень 19 липня, внаслідок чого загинуло 35 людей, а четверо зникли безвісти, шокував громадську думку.

Поки влада та родина жертви намагаються знайти та подолати наслідки, деякі акаунти та фан-сторінки в соціальних мережах скористалися цією трагедією, щоб «залучити перегляди», що викликало обурення в громаді.

Корабель із Грін-Бей був врятований владою (Фото: Мінх Кхой).

Відразу після аварії в соціальних мережах з'явилося багато постів з висловленням глибоких співчуття. Однак деякі фан-сторінки, як правило, фан-сторінка MCO, скористалися цією подією для створення сенсаційного контенту, що залучило до взаємодії.

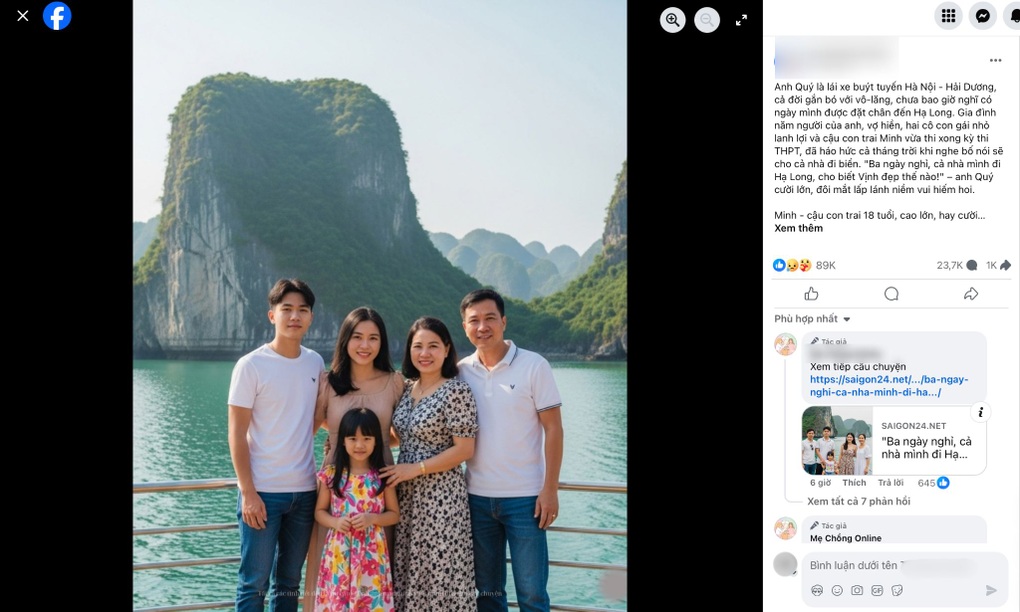

Ця фан-сторінка регулярно використовує технологію штучного інтелекту (ШІ) для створення ілюстрацій до вигаданих, драматичних історій, пов'язаних з корабельною аварією.

Станом на 22:30 20 липня на фан-сторінці MCO було опубліковано понад 10 статей з такими ключовими словами, як «затоплення корабля» та «затока Халонг». Зміст статей розповідав трагічні історії, описуючи в жахливих деталях катастрофу та моменти життя і смерті, що змушувало читачів легко сплутати їх з правдивими подіями.

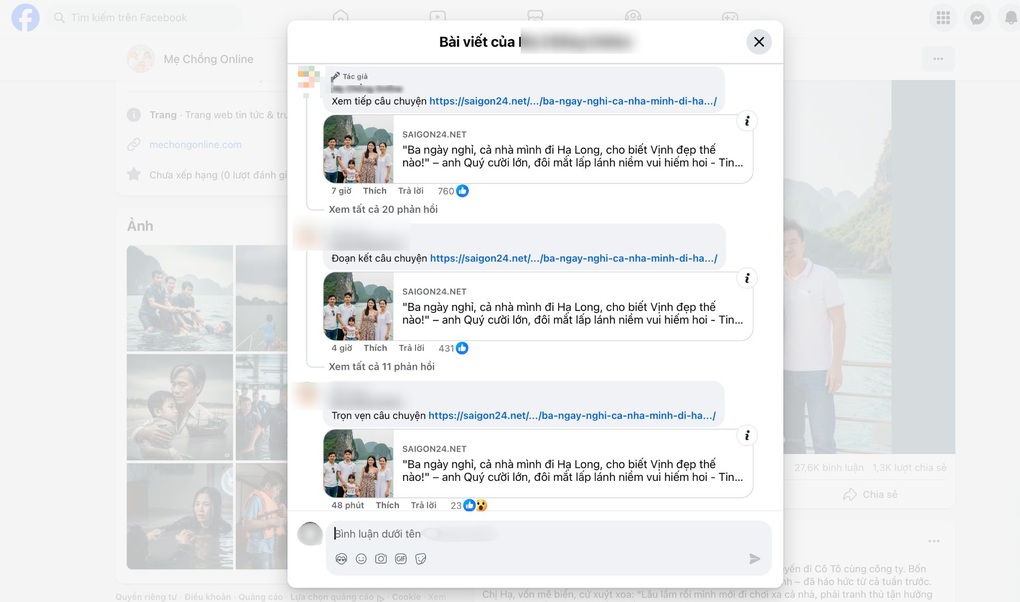

Щоб утримувати увагу читачів, ці статті часто містять розпливчасті наративи та просять глядачів натискати на посилання в розділі коментарів, щоб продовжити читання. Після натискання користувачі перенаправляються на веб-сайт «Добрих новин» із численною рекламою, що займає весь екран.

Серія зображень, створених штучним інтелектом, опублікованих на фан-сторінці MCO, може легко призвести до непорозумінь, пов'язаних з корабельною аварією в Куангніні (Фото: скріншот).

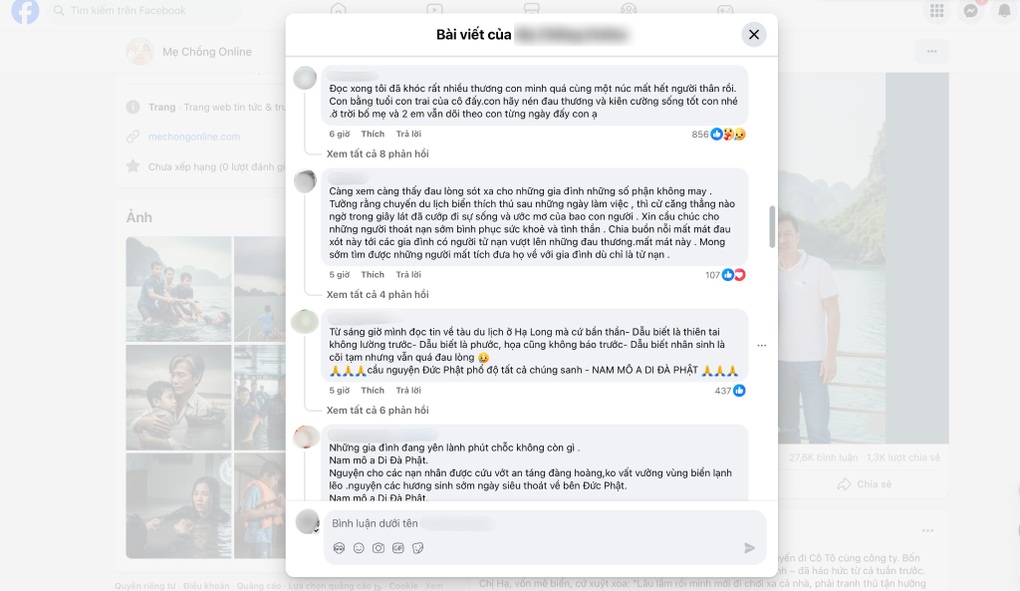

Варто зазначити, що хоча статті містять невеликий текст із написами «Це вигадані деталі» або «Зображення наведено лише для ілюстрації», багато користувачів соціальних мереж досі не можуть відрізнити правду від брехні, залишаючи коментарі, оплакуючи персонажів історії, помилково вважаючи їх жертвами справжньої корабельної аварії.

Стаття привернула величезну кількість взаємодій завдяки фейковій історії з використанням штучного інтелекту для створення ілюстрацій (Фото: Скріншот).

Посилання для продовження читання історії в розділі коментарів можуть потенційно становити багато ризиків для користувачів (Фото: Знімок екрана).

Багато людей залишали коментарі, оплакуючи нещасних жертв, не знаючи, що це вигадана історія, створена штучним інтелектом (Фото: Скріншот).

Обурення через спекуляцію

Багато користувачів соціальних мереж висловили свій гнів і розчарування через наживу на чужому болю. Вони вважають, що створення порожнього контенту та привернення уваги на основі трагедії є неприйнятним вчинком.

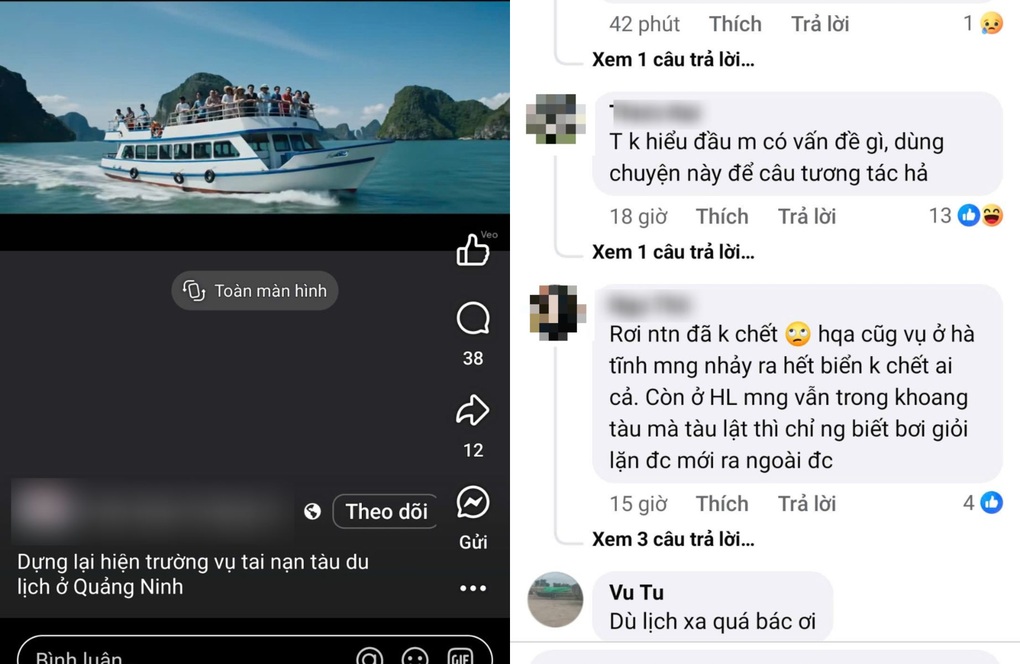

Деякі особисті акаунти навіть публікували відео , створені за допомогою штучного інтелекту, що імітують сцену потопаючого корабля та падіння жертв у море, з підписом «Реконструкція місця аварії туристичного човна в Куангніні», що викликало велике непорозуміння та обурення.

Багато людей обурені контентом штучного інтелекту про перекидання корабля в Халонзі (Фото: Скріншот).

Цей інцидент вкотре викликає тривогу щодо поширення фейкових новин та контенту, створеного штучним інтелектом, у соціальних мережах.

Зі швидким розвитком інструментів штучного інтелекту, підроблені зображення та відео стають дедалі реалістичнішими, що ускладнює для користувачів розрізнення справжніх та підроблених.

Щоб уникнути допомоги зловмисникам у використанні довіри для особистої вигоди, користувачам соціальних мереж необхідно озброїтися ефективними «інформаційними фільтрами».

Завжди будьте обережні, перевіряйте джерело та достовірність контенту, перш ніж довіряти йому чи поширювати його. Підвищення обізнаності вкрай необхідне в нинішньому хаотичному інформаційному середовищі.

Джерело: https://dantri.com.vn/cong-nghe/phan-no-hanh-vi-su-dung-ai-cau-tuong-tac-tu-vu-lat-tau-o-quang-ninh-20250721071757153.htm

Коментар (0)