جعلی AI تصاویر کیسے کام کرتی ہیں؟

AI ان دنوں ہر جگہ ہے - یہاں تک کہ جنگ میں بھی۔ اس سال مصنوعی ذہانت کی ایپلی کیشنز میں اس قدر بہتری آئی ہے کہ تقریباً کوئی بھی AI جنریٹرز کو استعمال کر کے ایسی تصاویر بنا سکتا ہے جو کم از کم پہلی نظر میں حقیقت پسندانہ نظر آئیں۔

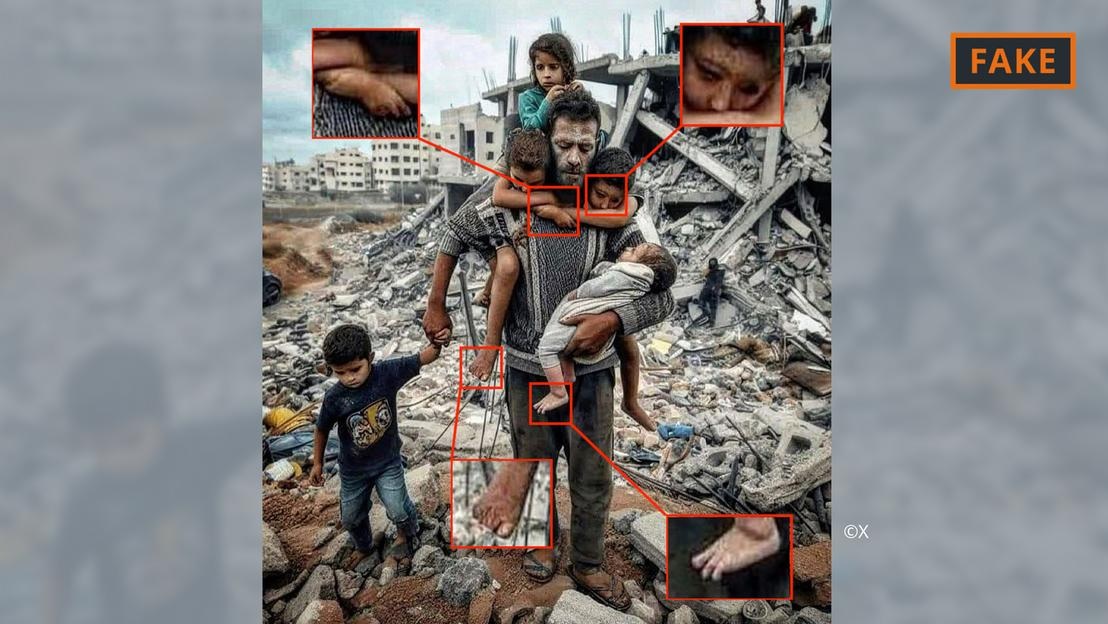

غزہ میں جنگ کی AI سے تیار کردہ جعلی تصویر۔

ایسا کرنے کے لیے صارفین محض چند اشارے کے ساتھ مڈجرنی یا ڈیل-ای جیسے ٹولز فراہم کرتے ہیں، بشمول وضاحتیں اور معلومات۔ AI ٹولز پھر متن، یا آواز کو بھی امیجز میں تبدیل کر دیتے ہیں۔

تصویر بنانے کا یہ عمل اس پر مبنی ہے جسے مشین لرننگ کہا جاتا ہے۔ مثال کے طور پر، اگر کوئی تخلیق کار ایک 70 سالہ شخص کو سائیکل چلاتے ہوئے دکھانے کے لیے کہتا ہے، تو وہ اپنے ڈیٹا بیس کو تلاش کریں گے تاکہ اصطلاحات کو تصاویر سے ملایا جا سکے۔

دستیاب معلومات کی بنیاد پر، AI الگورتھم بوڑھے سائیکل سوار کی تصویر تیار کرے گا۔ زیادہ سے زیادہ ان پٹ اور تکنیکی اپ ڈیٹس کے ساتھ، یہ ٹولز بہت بہتر ہوئے ہیں اور مسلسل سیکھ رہے ہیں۔

اس سب کا اطلاق مشرق وسطیٰ کے تنازع سے متعلق تصاویر پر کیا جا رہا ہے۔ اے آئی کے ماہر ہانی فرید کا کہنا ہے کہ ایک تنازعہ میں جہاں "جذبات بہت زیادہ ہیں"، غلط معلومات، بشمول AI امیجز کے ذریعے پھیلنا، بہت زیادہ اثر انداز ہوتی ہے۔

برکلے کی یونیورسٹی آف کیلیفورنیا میں ڈیجیٹل تجزیات کے پروفیسر فرید نے کہا کہ شدید لڑائیاں جعلی مواد بنانے اور پھیلانے کے ساتھ ساتھ جذبات کو بھڑکانے کا بہترین ذریعہ ہیں۔

اسرائیل حماس جنگ کی AI تصاویر کی اقسام

مصنوعی ذہانت کی مدد سے بنائی گئی تصاویر اور ویڈیوز نے یوکرین کی جنگ سے متعلق غلط معلومات کو ہوا دی ہے، اور یہ اسرائیل اور حماس کی جنگ میں جاری ہے۔

ماہرین کے مطابق جنگ کے بارے میں سوشل میڈیا پر گردش کرنے والی AI تصاویر اکثر دو کیٹیگریز میں آتی ہیں۔ ایک لوگوں کے دکھوں پر توجہ مرکوز کرتا ہے اور ہمدردی کو جنم دیتا ہے۔ دوسرا جعلی AI ہے جو واقعات کو بڑھا چڑھا کر پیش کرتا ہے، اس طرح تنازعات کو ہوا دیتا ہے اور تشدد کو بڑھاتا ہے۔

غزہ میں ملبے میں باپ اور بچے کی AI سے تیار کردہ جعلی تصویر۔

مثال کے طور پر، پہلی قسم میں ملبے کے ڈھیر کے سامنے ایک باپ اور اس کے پانچ بچوں کی اوپر کی تصویر شامل ہے۔ اسے X (سابقہ ٹویٹر) اور انسٹاگرام پر متعدد بار شیئر کیا گیا، اور لاکھوں بار دیکھا گیا۔

اس تصویر کو کمیونٹی نے، کم از کم X پر، جعلی کے طور پر جھنڈا لگایا ہے۔ اسے مختلف غلطیوں اور AI امیجز میں عام متضادات سے پہچانا جا سکتا ہے (اوپر تصویر دیکھیں)۔

اسی طرح کی بے ضابطگیوں کو ذیل میں X پر وائرل ہونے والی جعلی AI تصویر میں بھی دیکھا جا سکتا ہے، جس میں ایک فلسطینی خاندان کو کھنڈرات پر اکٹھے کھانا کھاتے ہوئے دکھایا گیا ہے۔

فلسطینی جماعت کی AI سے تیار کردہ جعلی تصویر۔

دریں اثنا، ایک اور تصویر جس میں فوجیوں کو اسرائیلی جھنڈے لہراتے ہوئے دکھایا گیا ہے جب وہ بمباری سے متاثرہ گھروں سے بھری بستی سے گزر رہے ہیں، دوسری قسم میں آتی ہے، جو نفرت اور تشدد کو ہوا دینے کے لیے بنائی گئی ہے۔

ایسی AI تصاویر کہاں سے آتی ہیں؟

تنازعات کی زیادہ تر AI سے تیار کردہ تصاویر سوشل میڈیا پلیٹ فارمز پر پوسٹ کی جاتی ہیں، لیکن وہ کئی دوسرے پلیٹ فارمز اور تنظیموں، اور یہاں تک کہ کچھ نیوز سائٹس پر بھی دستیاب ہیں۔

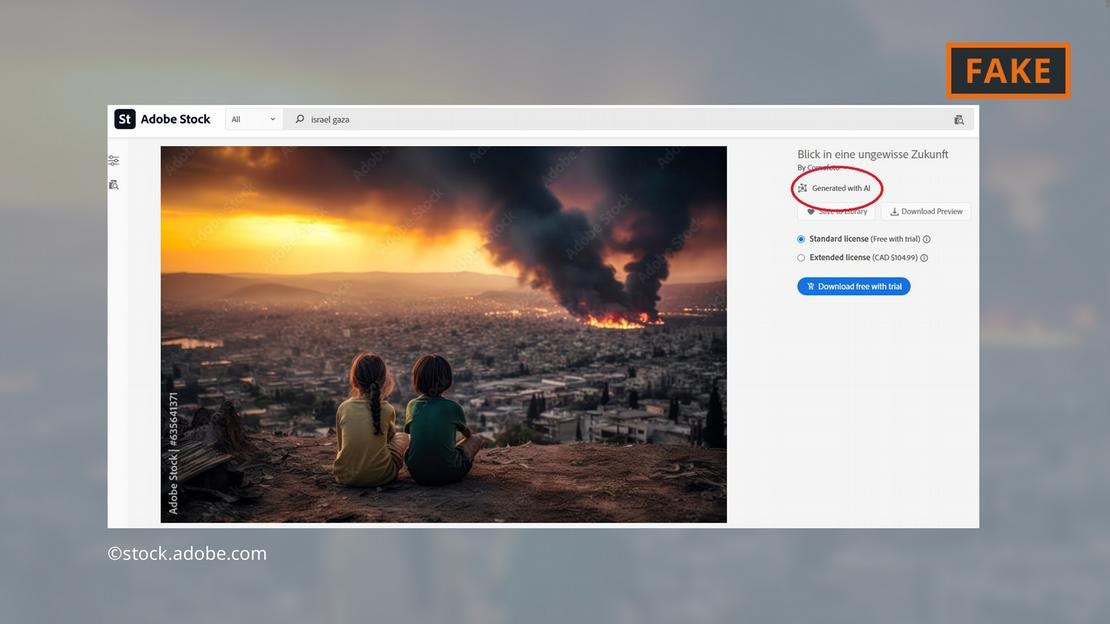

سافٹ ویئر کمپنی Adobe نے 2022 کے آخر تک اپنی سٹاک فوٹو رینج میں AI سے تیار کردہ تصاویر کو شامل کر کے سرخیوں میں جگہ بنائی ہے۔ ڈیٹا بیس میں ان کے مطابق لیبل لگا دیا جائے گا۔

Adobe اب مشرق وسطیٰ کی جنگ کی AI تصاویر بھی فروخت کے لیے پیش کر رہا ہے - جیسے دھماکے، لوگ احتجاج، یا مسجد اقصیٰ کے پیچھے دھوئیں کے بادل۔

Adobe غزہ میں لڑائی کی AI سے تیار کردہ تصاویر پیش کر رہا ہے۔

ناقدین نے اس کو پریشان کن پایا، کیونکہ کچھ سائٹس نے تصاویر کو AI سے تیار کردہ کے طور پر لیبل لگائے بغیر استعمال کرنا جاری رکھا ہے۔ زیر بحث تصویر، مثال کے طور پر، "نیوز بریک" صفحہ پر بغیر کسی اشارے کے ظاہر ہوئی کہ یہ AI سے تیار کی گئی تھی۔

یہاں تک کہ یورپی پارلیمانی ریسرچ سروس، جو یورپی پارلیمنٹ کی سائنسی شاخ ہے، نے مشرق وسطیٰ کے تنازعات کے بارے میں ایک آن لائن متن کو ایڈوب ڈیٹا بیس سے ایک AI امیج کے ساتھ پیش کیا — بغیر اسے AI سے تیار کردہ کا لیبل لگائے۔

یوروپی ڈیجیٹل میڈیا آبزرویٹری صحافیوں اور میڈیا کے پیشہ ور افراد پر زور دے رہی ہے کہ وہ AI تصاویر کا استعمال کرتے وقت انتہائی محتاط رہیں، ان کے استعمال کے خلاف مشورہ دیتے ہوئے، خاص طور پر جب حقیقی زندگی کے واقعات جیسے کہ غزہ میں جنگ کا احاطہ کریں۔

AI تصاویر کتنی خطرناک ہیں؟

وائرل AI مواد اور امیجری صارفین کو ہر اس چیز کے بارے میں بے چینی محسوس کرنے کا پابند ہے جس کا وہ آن لائن سامنا کرتے ہیں۔ UC برکلے کے محقق فرید بتاتے ہیں، "اگر ہم اس دنیا میں داخل ہو جائیں جہاں تصاویر، آڈیو اور ویڈیو سے ہیرا پھیری کی جا سکتی ہے ، تو ہر چیز مشکوک ہو جاتی ہے۔" "لہذا آپ سچائی سمیت ہر چیز پر اعتماد کھو دیتے ہیں۔"

مندرجہ ذیل معاملے میں بالکل ایسا ہی ہوا: ایک اسرائیلی بچے کی جلی ہوئی لاش کی تصویر اسرائیلی وزیر اعظم بینجمن نیتن یاہو اور کئی دوسرے سیاستدانوں نے سوشل میڈیا پر شیئر کی تھی۔

ایک اسرائیل مخالف اثر و رسوخ رکھنے والے جیکسن ہنکل نے بعد میں دعویٰ کیا کہ یہ تصویر مصنوعی ذہانت کا استعمال کرتے ہوئے بنائی گئی تھی۔ ہنکل کے بیان کو سوشل میڈیا پر 20 ملین سے زیادہ بار دیکھا گیا اور پلیٹ فارم پر گرما گرم بحث ہوئی۔

بالآخر، متعدد تنظیموں اور تصدیقی آلات نے اعلان کیا کہ تصویر اصلی تھی اور ہنکل کا دعویٰ غلط تھا۔ تاہم، یہ واضح ہے کہ کوئی بھی ٹول صارفین کو آسانی سے اپنا کھویا ہوا اعتماد دوبارہ حاصل کرنے میں مدد نہیں کر سکتا!

ہوانگ ہائی (ڈی ڈبلیو کے مطابق)

ماخذ

تبصرہ (0)