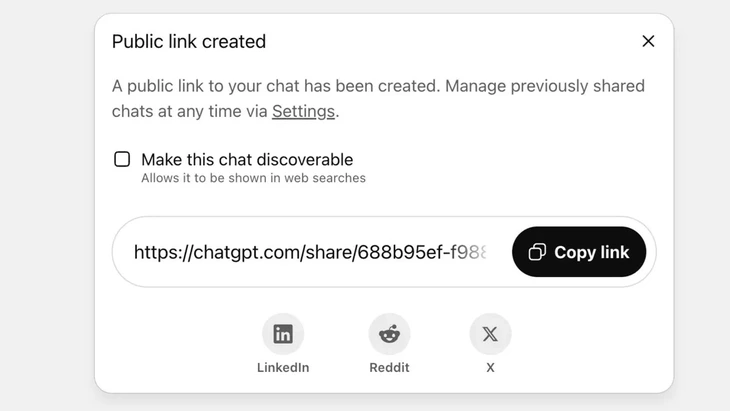

چیٹ جی پی ٹی پر عوامی لنک کے ذریعے چیٹس شیئر کرنے کی خصوصیت - تصویر: ٹیکراڈر

چیٹ جی پی ٹی اب ہر روز عالمی صارفین کے 2.5 بلین سوالات تک پہنچتا ہے، جو اس چیٹ بوٹ کی بڑھتی ہوئی مقبولیت کو ظاہر کرتا ہے۔

تاہم، اس ٹول کو صارفین کی جانب سے شدید ردعمل کا سامنا ہے، کیونکہ "شیئرنگ" فیچر کی وجہ سے ہزاروں مکالمات گوگل اور انٹرنیٹ پر کچھ سرچ انجنوں کو حساس معلومات لیک کرنے کا سبب بن چکے ہیں۔

ہائی سیکیورٹی رسک

مسٹر Vu Ngoc Son - نیشنل سائبر سیکیورٹی ایسوسی ایشن (NCA) کے ٹیکنالوجی ڈیپارٹمنٹ کے سربراہ - نے اندازہ لگایا کہ مذکورہ واقعہ ChatGPT صارفین کے لیے اعلیٰ سطح کے سیکیورٹی رسک کو ظاہر کرتا ہے۔

"مذکورہ واقعہ ضروری نہیں کہ کوئی تکنیکی خرابی ہو کیونکہ شیئر بٹن پر کلک کرنے میں صارف کا ایک خاص اقدام ہے۔ تاہم، یہ کہا جا سکتا ہے کہ مسئلہ AI چیٹ بوٹ پروڈکٹ کے ڈیزائن میں ہے، جب اس نے صارفین کو الجھن میں ڈال دیا ہے اور اگر صارفین شیئر کرتے ہیں تو ذاتی ڈیٹا کے لیک ہونے کے خطرے کے بارے میں کافی سخت انتباہی اقدامات نہیں ہیں،" مسٹر وو نگوک سون نے تجزیہ کیا۔

چیٹ جی پی ٹی پر، یہ فیچر اس وقت لاگو ہوتا ہے جب صارف عوامی لنک کے ذریعے چیٹ کو شیئر کرنے کا انتخاب کرتا ہے، مواد کو اوپن اے آئی کے سرور پر ایک عوامی ویب سائٹ (chatgpt.com/share/...) کے طور پر اسٹور کیا جائے گا، رسائی کے لیے کسی لاگ ان یا پاس ورڈ کی ضرورت نہیں ہوگی۔

گوگل کے کرالر خود بخود ان صفحات کو اسکین اور انڈیکس کرتے ہیں، جس سے وہ تلاش کے نتائج میں ظاہر ہوتے ہیں، بشمول حساس متن، تصاویر، یا چیٹ ڈیٹا۔

بہت سے صارفین خطرے سے ناواقف تھے، یہ سوچ کر کہ وہ دوستوں یا رابطوں کے ساتھ چیٹ کا اشتراک کر رہے ہیں۔ اس کی وجہ سے ہزاروں مکالمات سامنے آئے، کچھ معاملات میں حساس ذاتی معلومات پر مشتمل تھیں۔

اگرچہ OpenAI نے کمیونٹی کے ردعمل کے بعد جولائی 2025 کے آخر میں اس خصوصیت کو فوری طور پر ہٹا دیا، لیکن پھر بھی پرانے اشاریہ جات کو ہٹانے کے لیے گوگل کے ساتھ ہم آہنگی کرنے میں وقت لگا۔ خاص طور پر پیچیدہ اسٹوریج سسٹم کے ساتھ، جس میں گوگل کے کیش سرورز شامل ہیں، یہ جلدی نہیں کیا جا سکتا۔

AI چیٹ بوٹس کو "سیفٹی بلیک باکس" نہ سمجھیں۔

ڈیٹا سیکورٹی ماہر Vu Ngoc Son - نیشنل سائبر سیکورٹی ایسوسی ایشن (NCA) میں ٹیکنالوجی کے سربراہ - تصویر: CHI HIEU

ہزاروں چیٹ لاگز کا لیک ہونا صارفین کے لیے خطرات کا باعث بن سکتا ہے جیسے کہ ذاتی اور کاروباری راز افشا کرنا؛ گھر کے پتے ظاہر کرنے کی وجہ سے ساکھ کو پہنچنے والے نقصان، مالیاتی خطرات یا حفاظتی خطرات بھی۔

"AI سے چلنے والے چیٹ بوٹس کارآمد ہیں لیکن 'بلیک باکس' نہیں، کیونکہ مشترکہ ڈیٹا ویب پر ہمیشہ کے لیے موجود رہ سکتا ہے اگر ان کو چیک نہ کیا جائے۔

مندرجہ بالا واقعہ یقینی طور پر فراہم کنندگان اور صارفین دونوں کے لیے ایک سبق ہے۔ دیگر AI سروس فراہم کرنے والے اس تجربے سے سیکھ سکتے ہیں اور واضح اور شفاف انتباہات کے ساتھ ڈیزائن کی خصوصیات حاصل کر سکتے ہیں۔

ایک ہی وقت میں، صارفین کو AI پلیٹ فارمز پر شناخت یا ذاتی معلومات کی بے قابو پوسٹنگ کو بھی فعال طور پر محدود کرنے کی ضرورت ہے،" سیکیورٹی ماہر Vu Ngoc Son نے تجویز کیا۔

ڈیٹا سیکیورٹی ماہرین کے مطابق، مذکورہ واقعہ AI کے لیے قانونی راہداریوں اور سائبر سیکیورٹی کے معیارات کی ضرورت کو ظاہر کرتا ہے۔ AI فراہم کنندگان اور ڈویلپرز کو بھی ایسے نظاموں کو ڈیزائن کرنے کی ضرورت ہے جو سیکورٹی کو یقینی بنائیں، ڈیٹا کے رساو کے خطرے سے بچتے ہوئے جیسے کہ: خراب خطرات سے لیکیج؛ سافٹ ویئر کی کمزوریاں جو ڈیٹا بیس کے حملوں کا باعث بنتی ہیں۔ ناقص کنٹرول زہر دینے کا باعث بنتا ہے، غلط اور مسخ شدہ سوالات کے جوابات دینے کے لیے غلط استعمال۔

صارفین کو AI کے ساتھ ذاتی معلومات کے اشتراک کو بھی کنٹرول کرنے کی ضرورت ہے، نہ کہ حساس معلومات کا اشتراک۔ حقیقی ضرورت کی صورت میں، یہ مشورہ دیا جاتا ہے کہ گمنام موڈ استعمال کریں یا ڈیٹا کو مخصوص افراد سے براہ راست منسلک ہونے سے بچنے کے لیے معلومات کو فعال طور پر خفیہ کریں۔

ماخذ: https://tuoitre.vn/hang-ngan-cuoc-tro-chuyen-voi-chatgpt-bi-lo-tren-google-nguoi-dung-luu-y-gi-20250805152646255.htm

![[تصویر] کیٹ با - گرین جزیرے کی جنت](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F04%2F1764821844074_ndo_br_1-dcbthienduongxanh638-jpg.webp&w=3840&q=75)

![[VIMC بجلی کی رفتار کے 40 دن] دا نانگ پورٹ: اتحاد - بجلی کی رفتار - ختم لائن تک پیش رفت](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/04/1764833540882_cdn_4-12-25.jpeg)

تبصرہ (0)