پینل ڈسکشن "AI for humanity: AI اخلاقیات اور نئے دور میں حفاظت" ، VinFuture 2025 سائنس اور ٹیکنالوجی ویک کے فریم ورک کے اندر، سائنس دانوں ، سیاست دانوں اور موجدوں کو ایک ساتھ لاتی ہے تاکہ AI کی ذمہ دارانہ ترقی، انسانی اقدار کی طرف تبادلہ خیال کیا جا سکے۔

فوری طور پر سوچیں کہ AI کے ساتھ کیسے رہنا ہے - ایک ایسی ہستی جو آپ سے زیادہ ہوشیار ہو۔

سیمینار میں شریک ہوتے ہوئے، پروفیسر ٹوبی والش، یونیورسٹی آف نیو ساؤتھ ویلز، آسٹریلیا، امریکن کمپیوٹر ایسوسی ایشن کے ماہر تعلیم نے تصدیق کی: "میں پختہ یقین رکھتا ہوں کہ AI کا ذمہ دارانہ استعمال لازمی ہونا چاہیے۔ آج بہت سی ٹیڑھی ترغیبات ہیں، جن میں AI کی بدولت بھاری رقم کمائی جا رہی ہے، اور یہ یقینی بنانے کا واحد طریقہ یہ ہے کہ مناسب عوامی مفادات کے ساتھ توازن برقرار رکھا جائے تاکہ تجارتی رویے کا اطلاق ہو،

انہوں نے ریاستہائے متحدہ میں فیصلہ اور سزا جیسے اہم فیصلوں کی ایک عام مثال کا حوالہ دیا، جہاں ایک AI نظام کو کسی شخص کی قید کی سزا اور دوبارہ جرم کرنے کے امکان پر سفارشات کرنے کے لیے استعمال کیا جاتا تھا۔ بدقسمتی سے، یہ نظام تاریخی اعداد و شمار پر تربیت یافتہ تھا، اور غیر ارادی طور پر ماضی کے نسلی تعصبات کی عکاسی کرتا تھا، جس کے نتیجے میں سیاہ فام لوگوں کے خلاف امتیازی سلوک ہوتا ہے۔

پروفیسر ٹوبی والش، نیو ساؤتھ ویلز یونیورسٹی، آسٹریلیا، امریکی کمپیوٹر سوسائٹی کے فیلو۔

لہٰذا، وہ کمپنیاں جو AI سسٹمز کو تعینات اور چلاتی ہیں ان نتائج کے لیے ذمہ دار ٹھہرائی جائیں جو یہ "مشینیں" پیدا کرتی ہیں۔

پروفیسر جیفری ہنٹن - VF 2024 کے مرکزی انعام کے فاتح، کو تشویش ہے کہ AI خطرناک وائرس، سائبر حملوں، انتخابات میں خلل ڈالنے کے لیے جعلی ویڈیوز بنانے میں بتدریج بہتر ہوتا جا رہا ہے۔ اگلے 20 سالوں میں، AI ہم سے زیادہ ہوشیار ہو جائے گا اور ہم نہیں جان پائیں گے کہ اسے انسانوں سے کنٹرول لینے سے کیسے روکا جائے۔

لہذا، اس پروفیسر نے زور دیا: "ہمیں فوری طور پر اس بارے میں سوچنے کی ضرورت ہے کہ اپنے سے زیادہ ہوشیار اداروں کے ساتھ کیسے رہنا ہے۔ یہ ایک ایسی صورتحال ہے جس کا انسانیت کو پہلے کبھی سامنا نہیں کرنا پڑا، یہ نئی ہے اور ہمیں اس سے پہلے بہت زیادہ تحقیقی کوششیں کرنے کی ضرورت ہے۔"

AI خطرات کو محدود کرنے کے لیے بین الاقوامی تعاون کو بڑھانے کی ضرورت ہے۔

اس تشویش کا اظہار کرتے ہوئے، پروفیسر یوشوا بینجیو - VinFuture 2024 کے مرکزی انعام کے فاتح نے کہا کہ AI ماڈلز، ان کی صلاحیتیں اور خود مختاری کی سطحیں اب بھی تیز اور مستحکم رفتار سے ترقی کر رہی ہیں۔ اگر یہ رجحان جاری رہتا ہے تو، خود مختار AI نظام صرف 5-10 سالوں میں، زیادہ تر علمی کاموں میں انسانوں کو پیچھے چھوڑ سکتے ہیں۔

یہ ایک تاریخی موڑ ہوگا جو ہمارے معیار زندگی کو ڈرامائی طور پر بہتر کر سکتا ہے۔ لیکن اگر احتیاط سے کام نہ لیا گیا تو یہ جمہوریت، جغرافیائی سیاسی استحکام اور انسانیت کے مستقبل کے لیے بھی بڑے خطرات کا باعث بن سکتا ہے۔

انہوں نے کہا کہ "ہمیں جدید AI کے لیے صرف اسے مضبوط بنانے پر توجہ دینے کی بجائے حفاظت کو بڑھانا چاہیے۔ حفاظت اور اعتماد ثانوی عوامل نہیں ہیں بلکہ انسانیت کے فائدے کے لیے ترقی کے عمل میں ضروری ہیں۔ ہمیں پالیسی اور سائنسی دونوں سطحوں پر مل کر کام کرنے کی ضرورت ہے۔"

پروفیسر یوشوا بینجیو - VinFuture 2024 کے مرکزی انعام کے فاتح۔

یہ سائنسدان تجویز کرتا ہے کہ پالیسی کے لحاظ سے دنیا کو بین الاقوامی تعاون کی ضرورت ہے۔ سائنس کے لحاظ سے، یہ بہتر طور پر سمجھنے کی ضرورت ہے کہ AI کو کس طرح ڈیزائن کیا جائے جو قابلیت میں اعلیٰ اور انسانوں کے لیے بے ضرر ہو، AI کو کنٹرول کرنے کی صلاحیت کو برقرار رکھے تاکہ جب انسان اسے غلط کرنے کے لیے کہے تب بھی یہ محفوظ طریقے سے برتاؤ کرے، اور اس بات کو یقینی بنانے کے لیے تکنیکی اور سماجی رکاوٹیں کھڑی کریں کہ AI انسانی اصولوں، ارادوں، اقدار اور مفادات کے مطابق ہو۔

ڈاکٹر ونٹن گرے سرٹ (نائب صدر اور گوگل میں انٹرنیٹ ایوینجیلزم کے ڈائریکٹر - VF 2022 گرینڈ پرائز ونر) اس بات سے متفق ہیں: ہمیں AI کو جوابدہ رکھنے کی ضرورت ہے، یہ جاننے کے لیے کہ وہ کیا کرتے ہیں، کب، خاص طور پر جب کچھ غلط ہو جاتا ہے، ایک سلسلہ بندی قائم کرنے کی ضرورت ہے۔ بہت سے اصول جو انسانوں پر لاگو ہوتے ہیں آن لائن ماحول میں AI ایجنٹوں پر بھی لاگو ہوں گے۔

"ہمیں بیک وقت نئے اصول قائم کرنے کی ضرورت ہے، جہاں مضبوط شناخت کا استعمال، معلومات کو محفوظ بنانے کے لیے خفیہ نگاری، جوابدہی کو یقینی بنانے کے لیے میکانزم کا اطلاق کرنا اور شناخت کو دوسروں کے ذریعے ہائی جیک کیے جانے سے بچانا - ایک باقاعدہ عادت بن جاتی ہے۔ ہمیں شروع سے ہی خطرات کو محدود کرنے کے لیے ٹیکنالوجی کا استعمال کرنا چاہیے اور یہ واضح ہونا چاہیے کہ جو بھی کمیونٹی اور معاشرے کے لیے نقصان دہ پایا جاتا ہے اسے بین الاقوامی رویے کا سامنا کرنا پڑتا ہے،" انھوں نے کہا۔

ویتنام کو AI ڈیٹا بنانے میں اپنا راستہ اختیار کرنے کی ضرورت ہے۔

ایسوسی ایٹ پروفیسر Luu Anh Tuan، Nanyang Technological University (Singapur)، VinUni University (Vienum) نے کہا کہ دوسرے ممالک کے پاس تقریباً 10 سال کے ڈیٹا سیٹ ہیں، لیکن ویتنام صفر سے شروع ہو رہا ہے۔ لہذا، ہم شروع سے ہی پائیدار ڈیٹا تیار کر سکتے ہیں، شروع سے ہی صاف، اخلاقی، اور ثقافتی طور پر مناسب ڈیٹا فراہم کر سکتے ہیں۔

تاہم، ویتنام کے لیے سب سے بڑا چیلنج ویتنامی زبان کی مخصوصیت ہے۔ ہمارے پاس متنوع بولی کا نظام، بھرپور علاقائی ثقافت اور پتے کی انتہائی پیچیدہ شکلیں ہیں۔ بڑے ماڈل جیسے ChatGPT یا Gemini ویتنامی زبان کی حمایت کرتے ہیں لیکن معیار گہرا نہیں ہے کیونکہ وہ ویتنامی بولی، رسم و رواج یا تاریخ کو نہیں سمجھتے۔

ویتنام کو اپنا ویتنامی ماڈل بنانے کی ضرورت ہے۔ اس کے علاوہ، ہمیں ایک اوپن سورس ماڈل تیار کرنا چاہیے تاکہ چھوٹے کاروبار استعمال کر سکیں اور اپنا حصہ ڈال سکیں۔ انہوں نے کہا کہ اگر ہم صرف 'بلیک باکسز' کی شکل میں غیر ملکی ماڈلز پر انحصار کرتے ہیں تو ہم صرف AI صارفین ہوں گے نہ کہ AI ڈویلپرز۔

فی الحال، ایسوسی ایٹ پروفیسر Luu Anh Tuan اور ان کے ساتھی ویتنامی AI ڈیٹا بنا رہے ہیں۔ بولی، تاریخ اور ثقافت جیسے عوامل کو فوکس کے طور پر سمجھا جانا چاہیے۔

انہوں نے یہ بھی کہا کہ بیرونی ممالک میں طلباء کو اے آئی کے بارے میں بہت جلد تعلیم دی جاتی ہے۔ ویتنام ابھی یہ شروع کر رہا ہے، لیکن ہم اس کے مطابق سیکھنے اور ایڈجسٹ کر کے تیز کر سکتے ہیں۔

"نوجوان ویت نامی لوگ بہت متحرک ہیں؛ انہیں صرف ڈیجیٹل ذمہ داری کے بارے میں مکمل طور پر تعلیم یافتہ ہونے کی ضرورت ہے۔ ڈیٹا کے معیار اور اخلاقی معیارات کی تصدیق اور معیاری بنانے کے لیے ہمارے پاس ایک متحد ادارہ ہونا چاہیے۔ VinUni اخلاقی معیارات کا نظام بنانے کے لیے کونسل میں بھی حصہ لے رہا ہے اور اس عمل میں اپنا تعاون جاری رکھے گا،" انہوں نے کہا۔

ایسوسی ایٹ پروفیسر Luu Anh Tuan، نانیانگ ٹیکنالوجیکل یونیورسٹی (سنگاپور)، VinUni یونیورسٹی (ویتنام)۔

ایف ڈی آئی کی حکمت عملی کے جواب میں جس کا مقصد ویتنام کو 2030 تک AI میں خطے کی قیادت کرنا ہے، ایسوسی ایٹ پروفیسر توان کا خیال ہے کہ ویتنام کے پاس اعلیٰ معیار کے انسانی وسائل ہیں - جس کا مظاہرہ ریاضی، طبیعیات اور کیمسٹری میں بین الاقوامی کامیابیوں کے ذریعے کیا گیا ہے۔ اگر ہم جانتے ہیں کہ افواج کو کیسے اکٹھا کرنا ہے اور مضبوط پالیسیاں ہیں تو 2030 کا ہدف مکمل طور پر حاصل کیا جا سکتا ہے۔

پروفیسر ٹوبی والش تجویز کرتے ہیں کہ ویتنام کو لوگوں میں سرمایہ کاری کرنی چاہیے اور لوگوں کی مہارتوں کو فعال طور پر بہتر بنانا چاہیے، اس بات کو یقینی بنانا چاہیے کہ وہ AI کو سمجھتے ہیں۔ AI کاروباری اداروں، کاروباروں اور یونیورسٹیوں کی مدد کریں۔ دوسرے ممالک کا ٹیکنالوجی کی منتقلی یا ہماری رہنمائی کا انتظار کرنے کے بجائے، ہمیں فعال ہونا چاہیے اور ٹیکنالوجی میں مہارت حاصل کرنی چاہیے۔

اس کے علاوہ، ویتنام کو ملکی جمہوریت کو متاثر کیے بغیر، گھریلو صارفین کے لیے محفوظ ماحول پیدا کرنے کے لیے سوشل نیٹ ورکنگ پلیٹ فارمز کو مضبوطی سے متحرک کرنے کی ضرورت ہے۔

تھاو لی تھین لام

![[تصویر] تویت بیٹے کے مجسمے کی پوجا کرتے ہوئے - کیو پگوڈا میں تقریباً 400 سال پرانا خزانہ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

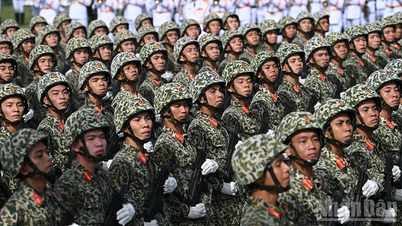

![[تصویر] لاؤس کے قومی دن کی 50 ویں سالگرہ منانے کے لیے پریڈ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[ویڈیو] انتہائی موسمیاتی تبدیلی سے عالمی ثقافتی ورثے کا تحفظ](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/03/1764721929017_dung00-57-35-42982still012-jpg.webp)

تبصرہ (0)