ومن المقرر أن يواصل المشرعون مناقشة اللوائح التفصيلية في الأسابيع المقبلة حتى يمكن استكمال العملية النهائية في أوائل العام المقبل، ومن المتوقع تطبيقها اعتبارًا من عام 2026.

وحتى ذلك الحين، يتم تشجيع الشركات على التوقيع على ميثاق الذكاء الاصطناعي الطوعي لتنفيذ الالتزامات الرئيسية للقواعد.

فيما يلي المحتويات الرئيسية للاتفاقية التي وافق عليها الاتحاد الأوروبي.

نظام عالي المخاطر

وسيتعين على ما يسمى بأنظمة الذكاء الاصطناعي عالية المخاطر - تلك التي يُعتقد أنها من المرجح أن تسبب ضرراً كبيراً للصحة والسلامة والحقوق الأساسية والبيئة والديمقراطية والانتخابات وسيادة القانون - أن تمتثل لمجموعة من المتطلبات، مثل الخضوع لاختبارات لتقييم التأثير على الحقوق الأساسية والتزامات الوصول إلى أسواق الاتحاد الأوروبي.

وفي الوقت نفسه، ستخضع الأنظمة منخفضة المخاطر لالتزامات شفافية أخف، مثل وضع علامات على المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي حتى يتمكن المستخدمون من التفكير في استخدامه.

الذكاء الاصطناعي في إنفاذ القانون

لا يُسمح لوكالات إنفاذ القانون باستخدام أنظمة التعرف البيومترية عن بعد في الوقت الفعلي إلا في الأماكن العامة، لتحديد هوية ضحايا الاختطاف والاتجار بالبشر والاستغلال الجنسي ومنع التهديدات الإرهابية المحددة والوشيكة.

وسيتم السماح للسلطات أيضًا باستخدام تقنية الذكاء الاصطناعي لتتبع المشتبه بهم في الإرهاب، والاتجار بالبشر، والاستغلال الجنسي، والقتل، والاختطاف، والاغتصاب، والسطو المسلح، والمشاركة في منظمة إجرامية، والجرائم البيئية.

أنظمة الذكاء الاصطناعي العامة والمنصية (GPAI)

وسوف تخضع GPAI والنماذج الأساسية لمتطلبات الشفافية مثل إنتاج الوثائق الفنية، والامتثال لقانون حقوق النشر في الاتحاد الأوروبي، ونشر ملخصات مفصلة للمحتوى المستخدم لتدريب الخوارزميات.

سيتعين على نماذج المنصات التي تندرج ضمن فئة المخاطر النظامية المحتملة والتأثيرات العالية GPAI إجراء تقييم عام للنموذج ومراجعة المخاطر والتخفيف منها وإجراء الهندسة العكسية وإخطار المفوضية الأوروبية بالحوادث الخطيرة وضمان الأمن السيبراني وإعداد التقارير عن استهلاك الطاقة.

حتى يتم نشر المعايير الموحدة للاتحاد الأوروبي، فإن هيئات تنظيم الاتصالات العامة معرضة لخطر منهجي يتمثل في الاعتماد على قواعد الممارسة للامتثال للوائح.

تم حظر أنظمة الذكاء الاصطناعي

تشمل السلوكيات والمحتوى المحظور ما يلي: أنظمة التصنيف البيومترية التي تستخدم خصائص حساسة مثل المعتقدات السياسية والدينية والفلسفية والتوجه الجنسي والعرق؛

المسح غير المستهدف لصور الوجه من الإنترنت أو لقطات كاميرات المراقبة لإنشاء قاعدة بيانات للتعرف على الوجه؛

التعرف على المشاعر في مكان العمل والمؤسسات التعليمية ؛

يعتمد التقييم الاجتماعي على السلوك الاجتماعي أو السمات الشخصية؛

تعمل أنظمة الذكاء الاصطناعي على التلاعب بالسلوك البشري لتقويض إرادته الحرة؛

يتم استخدام الذكاء الاصطناعي لاستغلال نقاط الضعف البشرية بسبب سنهم أو إعاقتهم أو ظروفهم الاقتصادية أو الاجتماعية.

العقوبات

وبحسب نوع المخالفة وحجم الشركة المعنية، ستبدأ الغرامات من 7.5 مليون يورو (8 ملايين دولار) أو 1.5% من إجمالي المبيعات السنوية، وتصل إلى 35 مليون يورو أو 7% من إجمالي المبيعات.

(وفقا لرويترز)

الاتحاد الأوروبي يتوصل إلى اتفاق تاريخي لتنظيم الذكاء الاصطناعي

الاتحاد الأوروبي يتوصل إلى اتفاق بشأن قانون حماية الأجهزة الذكية

الاتحاد الأوروبي يتخذ إجراءات صارمة ضد شركات التكنولوجيا العملاقة ويهدد بتفكيك الشركات المخالفة

[إعلان 2]

مصدر

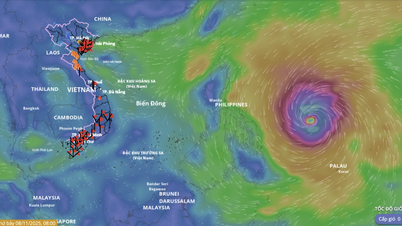

![[صورة] أضرار جسيمة بعد العاصفة رقم 13 في منطقة سونغ كاو بمقاطعة داك لاك](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/08/1762574759594_img-0541-7441-jpg.webp)

![[صورة] "مقبرة السفن" في خليج شوان داي](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/08/1762577162805_ndo_br_tb5-jpg.webp)

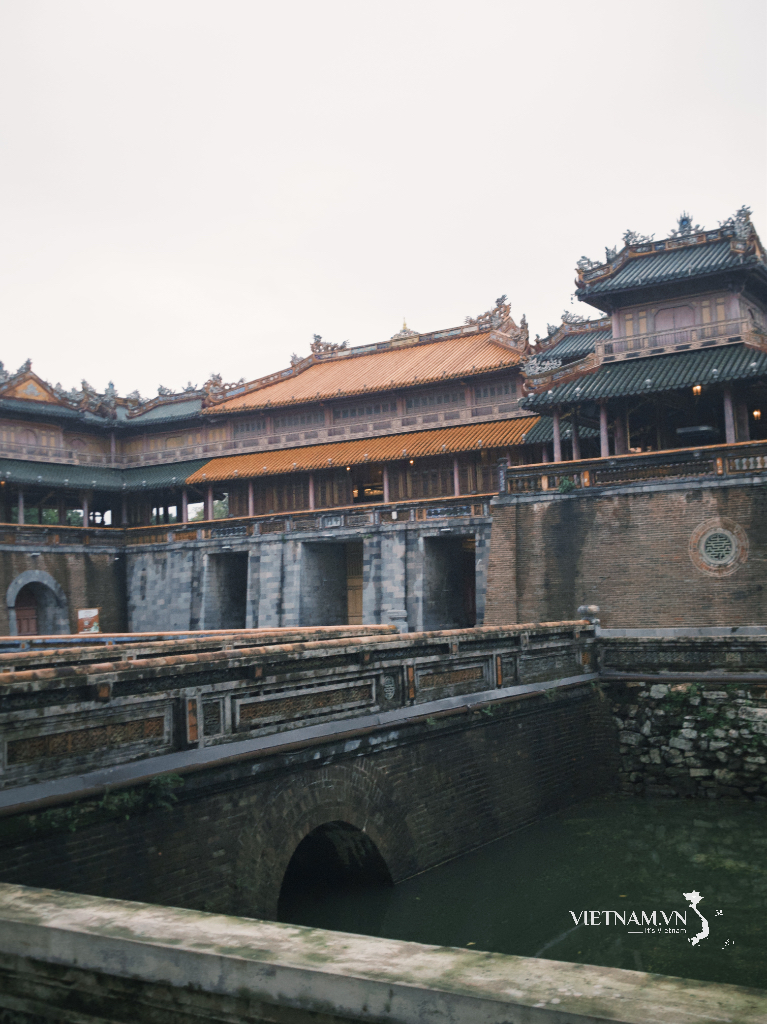

![[فيديو] إعادة فتح آثار هوي لاستقبال الزوار](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

تعليق (0)