Nedávné incidenty týkající se zaujatosti a falšování dokumentů přiměly vědce k přehodnocení vhodné úrovně zapojení umělé inteligence do výzkumu.

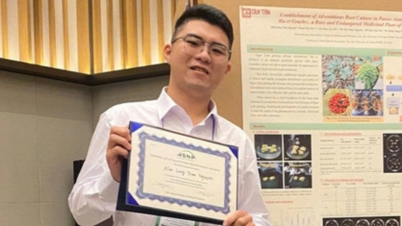

Profesor a doktor lingvistiky Nguyen Van Hiep nedávno na své osobní stránce sdílel příběh, který čtenáře šokoval. Zjistil, že umělá inteligence zfalšovala jeho dokumenty na základě informací zaslaných přítelem. Také náhodou zjistil, že článek docenta a doktora věd Tran Van Coa byl také zfalšován umělou inteligencí.

Umělá inteligence se stala nedílnou součástí lidského života, nicméně odborníci vždy zdůrazňují, že bychom ji měli vnímat pouze jako podpůrný nástroj. Uživatelé umělé inteligence musí být vždy ostražití a informovaní, aby mohli zpracovávat data a vyhodnocovat výsledky získané po „spolupráci“ s umělou inteligencí. Zejména ve vědeckém výzkumu mnoho studií ukázalo, že největším problémem, na který je třeba dávat pozor, je zkreslení dat a modelů. Umělá inteligence může být zkreslující, zkreslovat výsledky analýz, vytvářet předsudky nebo diskriminaci a manipulovat s informacemi, pokud není dobře kontrolována.

Zejména použití umělé inteligence ve výzkumu v oblasti společenských věd vyžaduje mnohem větší opatrnost. Vzhledem k tomu, že obory v oblasti společenských věd, jako je filozofie, lingvistika, etnologie, historie atd., berou lidské chování, kulturu a chování jako objekt výzkumu, jsou data často úzce spjata s vietnamským sociokulturním kontextem, s hloubkou a specifičností. Pokud data z tréninku umělé inteligence odrážejí historické předsudky, hrozí nebezpečí, že umělá inteligence může vyvodit závěry, které zhoršují problémy nerovnosti mezi pohlavími, třídami, rasami nebo geografickými oblastmi. Riziko je ještě větší, když se umělá inteligence používá k analýze lidského chování, k odpovídání na otevřené průzkumy nebo k účasti v mediálním obsahu.

Podle některých odborníků na sociální vědy má umělá inteligence v současné době potíže s přístupem k datům chráněným autorským právem nebo placeným zdrojům dat, což má za následek neúplně aktualizované informace.

Fenomén falšování dokumentů za účelem vytváření věrohodných příběhů se často vyskytuje u méně populárních témat, v jazycích s omezenými zdroji dat, jako je vietnamština, a měl by být varován, aby upozornil uživatele. Systémy umělé inteligence obecně v současnosti velmi omezeně chápou sociální a kulturní kontext, takže jejich pomoc při interpretaci nejednoznačných, metaforami bohatých poznatků ze společenských věd není skutečně spolehlivá.

Přestože umělá inteligence přináší velký potenciál ve vědeckém výzkumu, její aplikace musí být velmi opatrná, má svá omezení a musí vždy jít ruku v ruce se schopností kritického myšlení výzkumníka.

Je zřejmé, že ačkoliv umělá inteligence přináší velký potenciál ve vědeckém výzkumu, její aplikace musí být velmi opatrná, omezená a vždy doprovázená kritickým rozhodováním výzkumníka. Subjekt používající umělou inteligenci musí tato omezení při používání umělé inteligence jasně identifikovat a zajistit, aby umělá inteligence neměnila základní hodnoty vědy. Pro ochranu integrity vědeckého výzkumu je nutné pozvednout roli a odpovědnost vědců na novou úroveň. Kromě toho je nutné navrhnout právně závazný etický rámec pro umělou inteligenci v kontextu vietnamské kultury, tradic a společenských norem.

Ministerstvo vědy a techniky navrhlo systém devíti principů na podporu výzkumu a vývoje bezpečných a odpovědných systémů umělé inteligence, omezení negativních dopadů a kontrolu rizik, které kladou důraz na bezpečnost dat, respekt k lidským právům a důstojnosti a odpovědnost uživatelů umělé inteligence. Zejména v oblasti vědeckého výzkumu vydala Státní rada profesorů v roce 2023 oficiální depeši č. 25/HDGSNN, v níž požaduje, aby rady pro profesury v oboru a zařízení pro posuzování kvality vědeckých prací věnovaly zvláštní pozornost odhalování a hodnocení prací, které využívají technologii umělé inteligence nebo jsou jím podporovány. Cílem těchto požadavků je zajistit, aby výsledky výzkumu využívající umělou inteligenci stále splňovaly vědecké standardy, a zabránit tak zneužívání umělé inteligence ve vědeckém výzkumu a publikacích.

V nadcházející době, až bude vydán zákon o umělé inteligenci s přísnými předpisy týkajícími se etiky a odpovědnosti při používání umělé inteligence, přispěje to k vytvoření zdravého prostředí pro rozvoj umělé inteligence a poskytne aktivnější a odpovědnější podporu vědcům ve výzkumné práci.

Zdroj: https://nhandan.vn/canh-giac-voi-mat-trai-cua-ai-post916545.html

![[Foto] Předseda maďarského parlamentu navštívil mauzoleum prezidenta Ho Či Mina](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760941009023_ndo_br_hungary-jpg.webp)

![[Fotografie] Slavnostní zahájení 10. zasedání 15. Národního shromáždění](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760937111622_ndo_br_1-202-jpg.webp)

![[Fotografie] Řídicí výbor podzimního veletrhu 2025 kontroluje průběh organizace](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760918203241_nam-5371-jpg.webp)

![[Video] Květinový a dárkový trh v Ho Či Minově Městě je u příležitosti 20. října rušný](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/20/1760931107653_720-jpg.webp)

![[Video] Vedoucí představitelé strany a státu a poslanci Národního shromáždění navštívili mauzoleum prezidenta Ho Či Mina](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/20/1760929911350_img-1885-4872-png.webp)

Komentář (0)