|

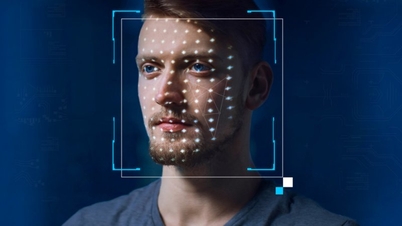

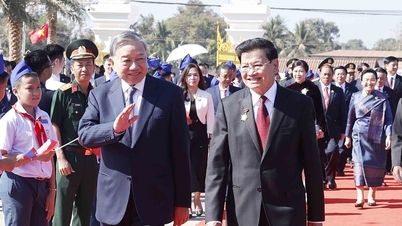

| KI-Tools können problemlos gefälschte Technologieprodukte erstellen. (Illustrationsfoto) |

„Das Zeitalter der Deepfakes“

Andererseits kann KI in den falschen Händen leicht Bilder aus Social-Media-Konten stehlen und sie für unerwünschte Zwecke missbrauchen. So könnten beispielsweise pornografische Webseiten Bilder von Personen ohne deren Einwilligung verwenden.

„Wir leben im Zeitalter der Deepfakes“, sagte Hadi Salman, Forscher am Massachusetts Institute of Technology. „Heute kann jeder Bilder und Videos manipulieren , um Menschen dazu zu bringen, etwas zu tun, was sie nicht getan haben.“

Deepfake ist eine Kombination der Wörter „Deep Learning“ und „Fake“ und bezeichnet eine Methode, bei der KI eingesetzt wird, um gefälschte Technologieprodukte in Form von Audio-, Bild- oder sogar Videodateien zu erstellen.

Innerhalb weniger Sekunden und mit wenigen einfachen Befehlen kann KI jedes beliebige Bild erzeugen, das die „Bösewichte“ wollen. Jemand könnte beispielsweise eine KI beauftragen, ein Foto des Papstes in einem Balenciaga-Mantel zu erstellen und es dann online zu veröffentlichen, bevor sich herausstellt, dass es sich um eine Fälschung handelt.

Die KI-Technologie hat die Nutzer auch mit ihrer Fähigkeit begeistert, Kunstwerke im Stil eines bestimmten Künstlers zu erstellen. So kann man beispielsweise ein Katzenbild anfertigen, das aussieht, als wäre es im Stil des berühmten Malers Vincent van Gogh gemalt worden.

Für bildende Künstler besteht die Gefahr, dass diese Werkzeuge sie arbeitslos machen, da KI-Modelle ihre einzigartigen Stile imitieren und Kunstwerke ohne ihre Zustimmung erstellen.

KI-Unterstützungstools

Eveline Fröhlich, die in Stuttgart lebt, gehört zu einer wachsenden Zahl von Künstlern, die gegen die Übergriffe der KI ankämpfen und nach Wegen suchen, ihre visuellen Werke online vor Manipulation zu schützen.

Kürzlich erfuhr Frau Fröhlich von einem Tool namens Glaze, das von Informatikern der Universität Chicago (USA) entwickelt wurde, um den Missbrauch von KI-Modellen zu verhindern.

Ben Zhao, Professor für Informatik an der Universität von Chicago und einer der Hauptforscher des Projekts Glaze, sagte gegenüber CNN , dass das Tool dazu gedacht sei, die einzigartigen Werke von Künstlern vor KI-Trainingseinheiten zu schützen.

Die Glaze-Software verwendet Algorithmen des maschinellen Lernens, um kleine Änderungen an digitalen Bildern vorzunehmen, die für das bloße Auge unsichtbar sind, aber eine Schutzschicht für das Werk in der Online-Umgebung erzeugen. Dadurch werden KI-Modelle getäuscht und können den Stil des Autors nicht kopieren.

Dank Glaze werden Kunstwerke „in Unsichtbarkeit gehüllt“, wodurch verhindert wird, dass KI das Bild „liest“.

Herr Zhao erklärte beispielsweise, dass ein Künstler ein Bild seines eigenen Ölgemäldes hochladen und es mit Glaze bearbeiten könne. Wenn die KI-Modelle das Gemälde „lesen“, würden sie es als Kohlezeichnung erkennen – während ein Mensch es sofort als Ölgemälde identifizieren würde. Nach der Bearbeitung mit Glaze sähe das Kunstwerk für die KI nun deutlich anders aus.

Zhaos Team veröffentlichte die erste Version von Glaze im vergangenen März und konnte bereits über eine Million Downloads verzeichnen. Erst letzte Woche stellte das Team eine kostenlose Version von Glaze online zur Verfügung.

Das Team hofft, dass das Glaze-Tool dazu beitragen wird, die Urheberrechte der Künstler zu schützen, bis spezifische Regelungen und Gesetze erlassen werden.

Seit der Einführung von Glaze, so Herr Zhao, habe er einen Anstieg von Anfragen seitens Synchronsprechern, Romanautoren, Musikern und Journalisten beobachtet, die sich an sein Team wandten, um nach einer Version von Glaze für ihren jeweiligen Bereich zu fragen.

Der in Kalifornien ansässige bildende Künstler Jon Lam verwendet das Tool Glaze, um seine online verfügbaren Kunstwerke davor zu schützen, zum Trainieren von KI-Modellen missbraucht zu werden, und sagt, er nutze die App mittlerweile für alle Kunstwerke, die er online teilt.

Jahrelang hätten Künstler wie er ihre Werke aus Stolz in voller Auflösung online veröffentlicht, sagte er. „Wir wollen, dass die Leute sehen, wie detailliert und beeindruckend Full-HD-Fotos sind. Doch die Künstler wissen nicht, dass ihre Werke von KI-Modellen ‚aufgefressen‘ werden können, die dann ihren Stil kopieren und sie unfairem Wettbewerb aussetzen.“

„Wir wissen jetzt, dass andere unsere hochauflösenden Daten nehmen und sie in KI-Systeme einspeisen, um mit uns im selben Bereich zu konkurrieren. Deshalb müssen wir vorsichtiger sein und uns Gedanken darüber machen, wie wir uns schützen können“, sagte er.

Salman und sein Team haben soeben ein weiteres Tool zum Schutz von Bildern vor KI veröffentlicht. Die App namens PhotoGuard ermöglicht es Nutzern, eine unsichtbare Schutzschicht über Bilder zu legen, um zu verhindern, dass KI-Modelle die Bilder manipulieren.

Ziel von PhotoGuard ist es, Fotos, die bereits von ihren Urhebern online hochgeladen wurden, vor „böswilliger KI-Manipulation“ zu schützen, sagte Herr Salman.

Die PhotoGuard-App funktioniert, indem sie die Pixel eines Bildes auf eine für das menschliche Auge unsichtbare Weise verändert. Diese Veränderung ist jedoch so wirksam, dass sie jegliche Manipulationsversuche von KI-Modellen zuverlässig umgeht.

Das bedeutet, dass, wenn jemand versucht, ein Foto mithilfe von KI zu bearbeiten, nachdem es mit PhotoGuard geschützt wurde, das resultierende Foto „überhaupt nicht realistisch“ sein wird, erklärte Salman.

Nicht lizenziert

Andererseits gilt auch dann, wenn KI-Tools Bilder aufnehmen und bearbeiten, dass das, was sie erzeugen, nicht als urheberrechtlich geschützt anerkannt wird.

Seit ihrem Aufkommen und ihrem Aufstieg zu großer Bedeutung hat die KI auch eine Debatte ausgelöst: Sind diese Werke urheberrechtlich geschützt? Wenn ja, wem gehören sie?

Das US-amerikanische Urheberrechtsamt (USCO) hat eine offizielle Entscheidung zu diesen Werken getroffen. Laut USCO sind Bilder, die mithilfe von KI auf Basis von Befehlen erstellt werden (wie beispielsweise die Apps Midjourney, Dall-E und Stable Diffusion), in den USA nicht urheberrechtlich geschützt.

Nach US-amerikanischem Recht ist geistiges Eigentum nur dann urheberrechtlich geschützt, wenn es das Ergebnis menschlicher Kreativität ist. Das USCO erkennt derzeit ausschließlich von Menschen geschaffene Werke an. Daher gelten KI-Systeme nicht als Urheber, und die von ihnen erstellten Produkte sind nicht urheberrechtlich geschützt.

„Wenn die traditionellen Elemente des Urheberrechts in einem Werk von einer Maschine geschaffen werden, dann ist das Werk nicht durch einen Menschen urheberrechtlich geschützt, und USCO wird es nicht registrieren“, sagte USCO-Direktorin Shira Perlmutter.

Quelle

![[Foto] Parade zur Feier des 50. Jahrestages des Nationalfeiertags von Laos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[Foto] Verehrung der Tuyet-Son-Statue – ein fast 400 Jahre alter Schatz in der Keo-Pagode](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

Kommentar (0)