Πλατφόρμες όπως το Replika ή το Character.ai προωθούνται στους εφήβους ως παιχνιδιάρικοι, έξυπνοι και ενσυναισθητικοί «φίλοι». Εφαρμογές όπως το CrushOn.AI και το DreamGF (ένα chatbot που παριστάνει τη φίλη μιας τεχνητής νοημοσύνης) υπογραμμίζουν επίσης την ελκυστικότητα του πειραματισμού με ρομαντικές ή σεξουαλικές συνομιλίες.

Σύμφωνα με τον Δρ. Gordon Ingram και τον Δάσκαλο Vu Bich Phuong - λέκτορες Ψυχολογίας στο Πανεπιστήμιο RMIT, η παραγωγική Τεχνητή Νοημοσύνη και οι σύντροφοι της Τεχνητής Νοημοσύνης γίνονται ολοένα και πιο δημοφιλείς μεταξύ των νέων. «Όπως και τα μέσα κοινωνικής δικτύωσης, αυτές οι νέες χρήσεις της Τεχνητής Νοημοσύνης εγείρουν μεγάλα ερωτήματα για τους γονείς σχετικά με την ικανότητά τους να ελέγχουν το περιεχόμενο στο οποίο έχουν πρόσβαση τα παιδιά τους», δήλωσε ο Δρ. Gordon Ingram.

Σύμφωνα με τον Δάσκαλο Vu Bich Phuong, τα μικρά παιδιά μπορεί να αποδίδουν ανθρωποειδή χαρακτηριστικά στα chatbots τεχνητής νοημοσύνης, θεωρώντας τα ως αισθανόμενα ή συναισθηματικά συνειδητά. Αυτό μπορεί να οδηγήσει σε μονόπλευρες κοινωνικές αλληλεπιδράσεις, στις οποίες τα παιδιά σχηματίζουν έναν μονόπλευρο συναισθηματικό δεσμό με την Τεχνητή Νοημοσύνη παρόμοιο με αυτόν που δημιουργούν χαρακτήρες κινουμένων σχεδίων ή διασημότητες, «γεγονός που εγείρει ανησυχίες σχετικά με το εάν τέτοιες αλληλεπιδράσεις μπορούν να αντικαταστήσουν τις πραγματικές αλληλεπιδράσεις με φίλους στην κοινωνική ανάπτυξη των παιδιών;».

Όταν τα παιδιά δεν εκτίθενται σε δύσκολες καταστάσεις με τους συνομηλίκους τους, μπορεί να έχουν χαμηλότερη ανοχή στην ενόχληση, λιγότερη ανθεκτικότητα στην απόρριψη ή ακόμα και περισσότερη παρορμητικότητα, χαρακτηριστικά που συχνά παρατηρούνται στο άγχος και την κοινωνική απομόνωση, λέει η κα Phuong. «Με την έκρηξη των μονόδρομων κοινωνικών αλληλεπιδράσεων μεταξύ παιδιών και εργαλείων τεχνητής νοημοσύνης, αυτό είναι ένα επείγον θέμα που χρειάζεται περαιτέρω έρευνα», λέει.

Σύμφωνα με την κα. Phuong, παρόμοιοι ηλικιακοί περιορισμοί θα πρέπει να εφαρμόζονται στην Τεχνητή Νοημοσύνη. Ο λόγος είναι ότι, σε αντίθεση με τα κοινωνικά δίκτυα, οι σύντροφοι της Τεχνητής Νοημοσύνης προσομοιώνουν ανταλλαγές συζητήσεων και μπορούν να έχουν πιο βαθύ αντίκτυπο στην ψυχολογία των ευάλωτων παιδιών. Χωρίς κανονισμούς, τα παιδιά μπορεί να πιστεύουν λανθασμένα ότι κάθε απάντηση από την Τεχνητή Νοημοσύνη είναι ηθικά ή κοινωνικά κατάλληλη. Επιπλέον, ενώ πλατφόρμες όπως το YouTube ή το Facebook επιτρέπουν την εύκολη αναφορά ακατάλληλου περιεχομένου, οι μηχανισμοί αναφοράς πολλών πλατφορμών γενετικής Τεχνητής Νοημοσύνης δεν είναι διαφανείς για τα παιδιά και τους γονείς.

Οι ακαδημαϊκοί του RMIT συνιστούν στους υπεύθυνους χάραξης πολιτικής να απαιτούν από τις πλατφόρμες τεχνητής νοημοσύνης να σχεδιάζουν εφαρμογές κατάλληλες για την ηλικία, να επαληθεύουν την ηλικία και να επιτρέπουν ρυθμίσεις εποπτείας περιεχομένου για να διασφαλίζουν την ασφάλεια των παιδιών. Οι μηχανισμοί για την αναφορά επιβλαβούς περιεχομένου πρέπει επίσης να είναι άμεσα διαθέσιμοι και προσβάσιμοι. «Καθώς η τεχνητή νοημοσύνη γίνεται μέρος της καθημερινής ζωής των παιδιών στο Βιετνάμ και σε όλο τον κόσμο , πρέπει να προχωρήσουμε με προσοχή. Η τεχνητή νοημοσύνη μπορεί να αποτελέσει ένα ισχυρό βοήθημα μάθησης, αλλά δεν μπορεί να αντικαταστήσει την πλούσια και φυσική ανθρώπινη νοημοσύνη που μας επιτρέπει να ζούμε στον συναισθηματικό κόσμο των ανθρώπινων σχέσεων», τόνισε ο Δρ Ingram.

Ουγιέν Να

Πηγή: https://baophapluat.vn/ai-sang-tao-noi-dung-khi-tre-lam-tuong-ao-that-post550555.html

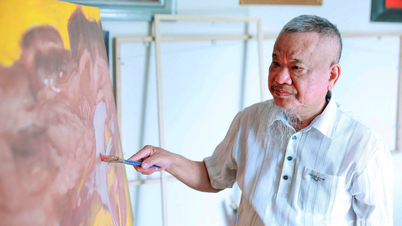

![[Φωτογραφία] 60ή επέτειος από την ίδρυση του Συνδέσμου Φωτογραφικών Καλλιτεχνών του Βιετνάμ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

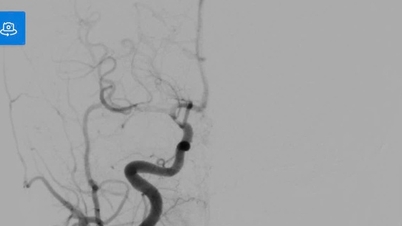

![[Φωτογραφία] Ο Πρόεδρος της Εθνοσυνέλευσης, Tran Thanh Man, παρευρίσκεται στην τελετή απονομής βραβείων VinFuture 2025](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

Σχόλιο (0)