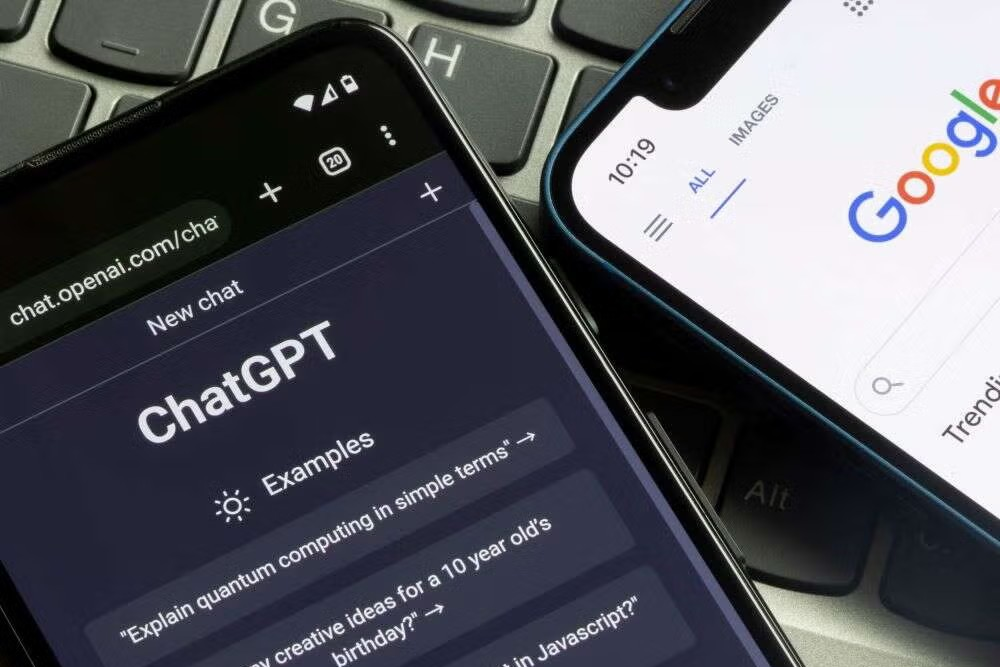

Μια νέα μελέτη που δημοσιεύτηκε στο επιστημονικό περιοδικό Proceedings of the National Academy of Sciences (PNAS) δείχνει ότι ενώ η γενετική Τεχνητή Νοημοσύνη, όπως το ChatGPT, μπορεί να βοηθήσει τους εργαζόμενους να ολοκληρώνουν εργασίες πιο γρήγορα και πιο αποτελεσματικά, έχει κοινωνικό κόστος: είναι πιο πιθανό να θεωρηθούν από τους άλλους ως τεμπέληδες, ανίκανοι ή ανίκανοι.

Η μελέτη, που διεξήχθη από μια ομάδα κοινωνικών επιστημόνων, βασίζεται στη θεωρία της απόδοσης - την ιδέα ότι οι άνθρωποι τείνουν να ερμηνεύουν τις ενέργειες των άλλων με βάση τα εγγενή κίνητρα ή τις ικανότητές τους και όχι τις περιστάσεις. Για παράδειγμα, το αίτημα βοήθειας θεωρείται μερικές φορές ως ένδειξη προσωπικής αδυναμίας. Ομοίως, η χρήση της Τεχνητής Νοημοσύνης μπορεί να θεωρηθεί ως έλλειψη ικανότητας ή προσπάθειας, παρά ως ένα έγκυρο εργαλείο για αποτελεσματικότητα.

Σε τέσσερα πειράματα στα οποία συμμετείχαν περισσότεροι από 4.400 συμμετέχοντες, η ομάδα κατέληξε σε αξιοσημείωτα αποτελέσματα. Στο πρώτο πείραμα, οι συμμετέχοντες φαντάστηκαν να ολοκληρώνουν μια εργασία χρησιμοποιώντας Τεχνητή Νοημοσύνη ή παραδοσιακά εργαλεία και στη συνέχεια προέβλεψαν πώς θα κρίνονταν από τους συναδέλφους και τους διευθυντές τους. Αυτοί οι άνθρωποι ανησυχούσαν μήπως θεωρηθούν τεμπέληδες, αντικαταστάσιμοι και λιγότερο επιμελείς. Είπαν ότι δεν ήθελαν να δημοσιοποιήσουν τη χρήση της Τεχνητής Νοημοσύνης.

Ένα δεύτερο πείραμα έδειξε ότι αυτή η προκατάληψη όντως υπάρχει. Οι συμμετέχοντες κλήθηκαν να αξιολογήσουν έναν υποθετικό υπάλληλο: έναν που χρησιμοποιούσε Τεχνητή Νοημοσύνη, έναν που ζητούσε βοήθεια από έναν συνάδελφο και έναν που το έκανε μόνος του. Οι χρήστες Τεχνητής Νοημοσύνης θεωρήθηκαν πιο τεμπέληδες, λιγότερο ικανοί, λιγότερο επιμελείς και λιγότερο ανεξάρτητοι από τις άλλες δύο ομάδες. Είναι αξιοσημείωτο ότι αυτή η αντίληψη ήταν συνεπής ανεξάρτητα από το φύλο, την ηλικία ή τον κλάδο του απεικονιζόμενου εργαζομένου.

Ένα τρίτο πείραμα εξέτασε κατά πόσον αυτές οι προκαταλήψεις επηρέαζαν τις πραγματικές αποφάσεις. Μια ομάδα συμμετεχόντων ενήργησε ως υπεύθυνοι προσλήψεων, επιλέγοντας υποψηφίους με βάση το αν οι υποψήφιοι χρησιμοποιούσαν ή όχι την Τεχνητή Νοημοσύνη στις εργασίες τους. Η ομάδα των υπεύθυνοι προσλήψεων που δεν ήταν εξοικειωμένοι με την Τεχνητή Νοημοσύνη έτεινε να επιλέγει υποψηφίους που επίσης δεν χρησιμοποιούσαν την Τεχνητή Νοημοσύνη. Αντίθετα, όσοι χρησιμοποιούσαν συχνά την Τεχνητή Νοημοσύνη ένιωθαν πιο άνετα και έτειναν να επιλέγουν υποψηφίους που την χρησιμοποιούσαν. Αυτό υποδηλώνει ότι η προσωπική εμπειρία με την τεχνολογία έχει μεγάλο αντίκτυπο στις στάσεις των αξιολογητών.

Σε ένα τελικό πείραμα, η ομάδα εξέτασε εάν συγκεκριμένες εργασιακές συνθήκες θα άλλαζαν αυτήν την προκατάληψη. Όταν οι υποψήφιοι υπέβαλαν αίτηση για ψηφιακές εργασίες, όπως η σύνταξη email, οι χρήστες τεχνητής νοημοσύνης δεν θεωρούνταν τεμπέληδες και μάλιστα βαθμολογούνταν υψηλότερα. Ωστόσο, όταν οι υποψήφιοι υπέβαλαν αίτηση για χειρωνακτικές εργασίες, όπως η χειροκίνητη λήψη σημειώσεων, οι χρήστες τεχνητής νοημοσύνης εξακολουθούσαν να βαθμολογούνται χαμηλότερα. Τα αποτελέσματα έδειξαν ότι οι ισχυρότερες προκαταλήψεις εμφανίστηκαν όταν οι χρήστες τεχνητής νοημοσύνης εκτελούσαν εργασίες που δεν απαιτούσαν τεχνητή νοημοσύνη.

Είναι ενδιαφέρον ότι οι συμμετέχοντες που παραδέχτηκαν ότι χρησιμοποιούν τακτικά την Τεχνητή Νοημοσύνη ήταν λιγότερο πιθανό να κρίνουν αρνητικά τους άλλους, γεγονός που υποδηλώνει ότι η εξοικείωση και η εμπειρία στον πραγματικό κόσμο μπορούν να μειώσουν το στίγμα. Η επικεφαλής συγγραφέας Jessica Reif, διδακτορική φοιτήτρια στη Σχολή Διοίκησης Επιχειρήσεων Fuqua του Πανεπιστημίου Duke, δήλωσε ότι ξεκίνησε το έργο αφού άκουσε από υπαλλήλους που εξέφρασαν ανησυχίες σχετικά με το ότι κρίνονταν κατά τη χρήση της Τεχνητής Νοημοσύνης, παρόλο που η εργασιακή τους απόδοση δεν είχε μειωθεί.

Αυτή η μελέτη έχει μεθοδολογικά πλεονεκτήματα όπως οι προσεκτικά κατασκευασμένες καταστάσεις ελέγχου. Ωστόσο, ο συγγραφέας αναγνωρίζει επίσης περιορισμούς, όπως το ότι οι καταστάσεις είναι υποθετικές και όχι πραγματικές παρατηρήσεις, και οι αξιολογητές δεν είναι άμεσα εξοικειωμένοι με τα άτομα που αξιολογούνται, κάτι που μπορεί να διαφέρει σε ένα πραγματικό εργασιακό περιβάλλον.

Αυτά τα ευρήματα υπογραμμίζουν ότι, ενώ η Τεχνητή Νοημοσύνη (ΤΝ) γίνεται ένα χρήσιμο εργαλείο για την αύξηση της παραγωγικότητας, η χρήση της ΤΝ πρέπει επίσης να λαμβάνει υπόψη τον τρόπο με τον οποίο επηρεάζει την προσωπική εικόνα και φήμη. Τα αποτελέσματα της έρευνας αποτελούν μια υπενθύμιση: για να γίνει η ΤΝ πραγματικά ένας αποτελεσματικός βοηθός, το ίδιο το εργασιακό περιβάλλον πρέπει να αλλάξει την αντίληψή του, αποφεύγοντας την βιαστική ταμπέλα των χρηστών της ΤΝ ως ανίκανων ή τεμπέληδων. Και οι εργαζόμενοι, εκτός από το να γνωρίζουν πώς να αξιοποιούν την τεχνολογία, θα πρέπει επίσης να διατηρούν τη διαφάνεια, αναπτύσσοντας παράλληλα δεξιότητες και προσωπικά αποτυπώματα, ώστε να μην «διαλυθούν» στην εικόνα που δημιουργείται από την ΤΝ.

(Σύμφωνα με το PsyPost)

Πηγή: https://vietnamnet.vn/su-dung-chatgpt-trong-cong-vic-bi-danh-gia-luoi-bieng-kem-nang-luc-2422059.html

![[Φωτογραφία] Ο Γενικός Γραμματέας Το Λαμ, Γραμματέας της Κεντρικής Στρατιωτικής Επιτροπής, παρευρίσκεται στο 12ο Συνέδριο του Κόμματος του Στρατού](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/9b63aaa37ddb472ead84e3870a8ae825)

![[Φωτογραφία] Το 1ο Συνέδριο της Επαρχιακής Επιτροπής του Κόμματος Φου Το, περίοδος 2025-2030](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/1507da06216649bba8a1ce6251816820)

![[Φωτογραφία] Ο Πρόεδρος Luong Cuong δέχεται τον Πρόεδρο της Κουβανικής Εθνοσυνέλευσης Esteban Lazo Hernandez](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/4d38932911c24f6ea1936252bd5427fa)

![[Φωτογραφία] Επίσημη έναρξη του 12ου Συνεδρίου του Στρατιωτικού Κόμματος για την περίοδο 2025-2030](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/2cd383b3130d41a1a4b5ace0d5eb989d)

![[Φωτογραφία] Πανόραμα της καλωδιωτής γέφυρας, του τελευταίου σημείου συμφόρησης του αυτοκινητόδρομου Ben Luc-Long Thanh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/391fdf21025541d6b2f092e49a17243f)

Σχόλιο (0)