Ανάγκη σχεδιασμού σύγχρονου, σύγχρονου μηχανισμού διακυβέρνησης Τεχνητής Νοημοσύνης

Εκφράζοντας την έγκρισή τους για την προσέγγιση στη σύνταξη αυτού του νόμου ως νόμου-πλαισίου για τη διαχείριση και την προώθηση της έρευνας, της ανάπτυξης, της ανάπτυξης και της χρήσης τεχνητής νοημοσύνης στο Βιετνάμ, οι βουλευτές της Εθνοσυνέλευσης εκτίμησαν ιδιαίτερα την προετοιμασία της κυβέρνησης. Το σχέδιο νόμου καταρτίστηκε με περίτεχνο τρόπο, διασφαλίζοντας τη συμμόρφωση με τους κανονισμούς. Ταυτόχρονα, η πρόταση κατάργησης ορισμένων σχετικών άρθρων και ρητρών του νόμου για τη βιομηχανία ψηφιακής τεχνολογίας είναι απαραίτητη για την αποφυγή επικαλύψεων, δημιουργώντας μια ενιαία νομική βάση για τη διαχείριση και την προώθηση της ανάπτυξης της τεχνητής νοημοσύνης. Ωστόσο, για την ολοκλήρωση αυτού του νομοσχεδίου, οι βουλευτές ζήτησαν από την Επιτροπή Σύνταξης να συνεχίσει την αναθεώρηση και τροποποίηση, συμπλήρωση και κατάργηση ορισμένων άρθρων και ρητρών κατάλληλα.

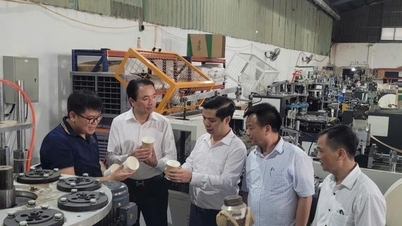

Σκηνή από τη συνάντηση της Ομάδας 6 το πρωί της 21ης Νοεμβρίου. Φωτογραφία: Ho Long

Συγκεκριμένα, όσον αφορά το πεδίο εφαρμογής της ρύθμισης και τα εφαρμοστέα θέματα, ο βουλευτής της Εθνοσυνέλευσης Pham Trong Nghia (Lang Son) δήλωσε ότι είναι απαραίτητο να συνεχιστεί η διευκρίνιση αυτού του ζητήματος. Επειδή, επί του παρόντος, οι διατάξεις που σχετίζονται με τις «ερευνητικές δραστηριότητες» στο προσχέδιο κινδυνεύουν να επικαλυφθούν με το περιεχόμενο που ήδη ρυθμίζεται από τον Νόμο για την Επιστήμη , την Τεχνολογία και την Καινοτομία. Εν τω μεταξύ, το προσχέδιο δεν έχει συγκεκριμένη πολιτική για την προώθηση της έρευνας σε συστήματα τεχνητής νοημοσύνης και δεν έχει ορίσει σαφώς τα υποκείμενα που εκτελούν αυτή τη δραστηριότητα. Ως εκ τούτου, ο εκπρόσωπος πρότεινε να διευκρινιστεί ποιες δραστηριότητες εμπίπτουν στο πεδίο εφαρμογής της ρύθμισης του Νόμου και ποιες δραστηριότητες εμπίπτουν στον ισχύοντα Νόμο, ώστε να διασφαλιστεί η σκοπιμότητα, η συνέπεια και να αποφευχθούν οι επικαλύψεις.

Ο βουλευτής της Εθνοσυνέλευσης Pham Trong Nghia ( Lang Son ) σχολιάζει το σχέδιο νόμου για την Τεχνητή Νοημοσύνη. Φωτογραφία: Ho Long

Όσον αφορά την επεξήγηση των όρων, το μέλος της Εθνοσυνέλευσης Pham Trong Nghia έδωσε ιδιαίτερη προσοχή στην έννοια της «βελτίωσης» στο μοντέλο τεχνητής νοημοσύνης γενικής χρήσης. Ο εκπρόσωπος δήλωσε ότι πρόκειται για έναν εξειδικευμένο όρο, ο οποίος δεν είναι ακόμη δημοφιλής, επομένως το περιεχόμενο πρέπει να οριστεί με σαφήνεια για να διευκολυνθεί η εφαρμογή και η επιβολή του νόμου αργότερα. Το προσχέδιο ορίζει επί του παρόντος μόνο μία πρόταση σχετικά με την Εθνική Επιτροπή Τεχνητής Νοημοσύνης, η οποία δεν δείχνει σαφώς: νομική θέση· λειτουργίες, καθήκοντα, εξουσίες· οργανωτική δομή, μηχανισμός λειτουργίας· σχέση με υπουργεία και παραρτήματα. Συνεπώς, ο εκπρόσωπος πρότεινε να διευκρινιστεί η αναγκαιότητα ίδρυσης αυτού του θεσμού και ταυτόχρονα να αξιολογηθεί η συμμόρφωση με την πολιτική εξορθολογισμού του μηχανισμού σύμφωνα με τους κανονισμούς του Κόμματος. Σε περίπτωση συνέχισης της διατήρησής του, είναι απαραίτητο να συμπληρωθούν οι κανονισμοί ή να ανατεθεί στην κυβέρνηση η λεπτομερής εξειδίκευση των παραπάνω ζητημάτων.

Όσον αφορά τις απαγορευμένες πράξεις, οι αντιπρόσωποι δήλωσαν ότι το σχέδιο νόμου δεν έχει ακόμη ορίσει απαγορευμένες πράξεις, ενώ αυτό αποτελεί σημαντική «νομική ασπίδα» για την προστασία των ανθρωπίνων δικαιωμάτων, τη διασφάλιση του θεμιτού ανταγωνισμού και τη συμμόρφωση με τα διεθνή πρότυπα. Εν τω μεταξύ, ο προηγμένος νόμος για την Τεχνητή Νοημοσύνη (ΤΝ) στον κόσμο ορίζει σαφώς απαγορευμένες πράξεις όπως η κατάχρηση προσωπικών δεδομένων, οι συστηματικές διακρίσεις, η χρήση ΤΝ για επιβλαβείς σκοπούς κ.λπ. Ως εκ τούτου, προτείνεται η προσθήκη ξεχωριστού άρθρου για τις απαγορευμένες πράξεις, με βάση τις αρχές: διαφάνεια, ασφάλεια, λογοδοσία, ανθρώπινη εποπτεία, δικαιοσύνη, μη διάκριση και υποστήριξη της ελεγχόμενης καινοτομίας.

Η εκπρόσωπος της Εθνοσυνέλευσης Nguyen Thi Suu (πόλη Hue) μίλησε στην πρωινή συνεδρίαση συζήτησης της 21ης Νοεμβρίου. Φωτογραφία: Ho Long

Σχόλια επί του σχεδίου νόμου, Βουλευτές της Εθνοσυνέλευσης Η Nguyen Thi Suu (πόλη Hue) επικεντρώθηκε στην ανάλυση των κανονισμών που σχετίζονται με τις υποδομές, τους ανθρώπινους πόρους και το πλαίσιο δεοντολογίας της Τεχνητής Νοημοσύνης - βασικούς πυλώνες που καθορίζουν την αποτελεσματικότητα της εφαρμογής του Νόμου στην πράξη.

Συγκεκριμένα, στο Κεφάλαιο III (Άρθρα 17 και 18) που ρυθμίζει την υποδομή τεχνητής νοημοσύνης, οι αντιπρόσωποι δήλωσαν ότι ο οδικός χάρτης για την εφαρμογή της εθνικής υποδομής τεχνητής νοημοσύνης, οι ρόλοι των υπουργείων, των παραρτημάτων, των τοπικών αρχών, καθώς και των επιχειρήσεων και των ερευνητικών ιδρυμάτων στη διαδικασία κατασκευής και λειτουργίας δεν έχουν καθοριστεί με σαφήνεια. Οι αντιπρόσωποι πρότειναν να συμπληρωθεί ένα συγκεκριμένο σχέδιο εφαρμογής με χρονοδιαγράμματα, αρμοδιότητες κάθε φορέα και μηχανισμό παρακολούθησης, ώστε να διασφαλιστεί η σκοπιμότητα κατά την ψήφιση του Νόμου.

Όσον αφορά την ανάπτυξη ανθρώπινου δυναμικού (Άρθρο 24), η εκπρόσωπος Nguyen Thi Suu δήλωσε ότι το σχέδιο νόμου καθορίζει μόνο τους στόχους, αλλά δεν διαθέτει πραγματικό μηχανισμό υποστήριξης για τα εκπαιδευτικά ιδρύματα και τους εκπαιδευόμενους, όπως χρηματοδότηση, διεθνή πρότυπα κατάρτισης ή κοινά προγράμματα με επιχειρήσεις και ερευνητικά ιδρύματα. Ως εκ τούτου, είναι απαραίτητο να συμπληρωθούν οι πολιτικές υποτροφιών, να υποστηριχθεί η κατάρτιση και να προωθηθούν οι συμπράξεις δημόσιου και ιδιωτικού τομέα.

Όσον αφορά το Εθνικό Πλαίσιο Δεοντολογίας για την Τεχνητή Νοημοσύνη (Άρθρο 27), οι αντιπρόσωποι δήλωσαν ότι οι ισχύοντες κανονισμοί βασίζονται μόνο σε αρχές και δεν διαθέτουν μηχανισμούς για την παρακολούθηση, την αξιολόγηση και τον χειρισμό των παραβιάσεων, γεγονός που καθιστά δύσκολη την εξασφάλιση της δεσμευτικότητάς τους στην πράξη. Ταυτόχρονα, ο όρος «ηθική της Τεχνητής Νοημοσύνης» δεν έχει οριστεί με σαφήνεια και δεν έχει αναθέσει συγκεκριμένες αρμοδιότητες σε οργανισμούς και άτομα κατά την παραβίαση. Ως εκ τούτου, οι αντιπρόσωποι πρότειναν την αλλαγή της φράσης «αναθεώρηση» σε «δημόσια» στους κανονισμούς για την ενημέρωση του πλαισίου δεοντολογίας. Ταυτόχρονα, την προσθήκη διατάξεων για τη σύσταση Εθνικής Αρχής Δεοντολογίας της Τεχνητής Νοημοσύνης υπεύθυνης για την παρακολούθηση, την αξιολόγηση και τον χειρισμό παραβιάσεων. τον καθορισμό υποχρεώσεων συμμόρφωσης για οργανισμούς και άτομα που αναπτύσσουν ή λειτουργούν συστήματα Τεχνητής Νοημοσύνης υψηλού κινδύνου. την επιβεβαίωση της νομικά δεσμευτικής αξίας του Πλαισίου Δεοντολογίας της Τεχνητής Νοημοσύνης, στο οποίο οι παραβιάσεις μπορούν να υπόκεινται σε διοικητικές ή ποινικές κυρώσεις. και την ενθάρρυνση της συμμετοχής κοινωνικών οργανώσεων, ακαδημαϊκών ιδρυμάτων και επιχειρήσεων στις δραστηριότητες οικοδόμησης και αξιολόγησης της ηθικής της Τεχνητής Νοημοσύνης. «Μόνο όταν ολοκληρωθούν οι παραπάνω μηχανισμοί, το Πλαίσιο Δεοντολογίας της Τεχνητής Νοημοσύνης μπορεί να είναι αποτελεσματικό, διασφαλίζοντας ότι η τεχνολογία αναπτύσσεται προς τη σωστή κατεύθυνση, με ασφάλεια και για τους ανθρώπους», τόνισε ο αντιπρόσωπος Nguyen Thi Suu.

Ποια είναι η ευθύνη όταν η Τεχνητή Νοημοσύνη κάνει λάθη;

Συζητώντας το σχέδιο νόμου για την Τεχνητή Νοημοσύνη, ο βουλευτής της Εθνοσυνέλευσης Pham Nhu Hiep (πόλη Χουέ) δήλωσε ότι η τεχνητή νοημοσύνη δημιουργεί βαθιές αλλαγές στον ιατρικό τομέα, από τη χειρουργική επέμβαση, τη διάγνωση έως την επιστημονική έρευνα. Ο εκπρόσωπος ανέφερε ότι η απομακρυσμένη χειρουργική επέμβαση εμφανίζεται εδώ και περισσότερα από 20 χρόνια και μέχρι σήμερα, πολλά ρομποτικά συστήματα είναι ικανά να εκτελούν ενδοσκοπική χειρουργική χωρίς άμεση ανθρώπινη παρέμβαση. Με την ταχεία ανάπτυξη της τεχνολογίας, εάν επιτραπεί, η Τεχνητή Νοημοσύνη μπορεί να αναλάβει πλήρως ορισμένα χειρουργικά βήματα, απειλώντας ακόμη και να αλλάξει τον παραδοσιακό ρόλο των χειρουργών. Στη διάγνωση απεικόνισης, η Τεχνητή Νοημοσύνη έχει εφαρμοστεί ευρέως σε νοσοκομεία, συμπεριλαμβανομένου του Κεντρικού Νοσοκομείου Χουέ, υποστηρίζοντας την ανάγνωση ακτίνων Χ, αξονικών τομογραφιών και ακτινογραφιών εγκεφάλου.

Ο εκπρόσωπος της Εθνοσυνέλευσης Pham Nhu Hiep (πόλη Χουέ) εξέφρασε τις απόψεις του σχετικά με το σχέδιο νόμου για την Τεχνητή Νοημοσύνη στην Ομάδα 6. Φωτογραφία: Ho Long

Ωστόσο, οι σύνεδροι τόνισαν την ανάγκη λογοδοσίας όταν η Τεχνητή Νοημοσύνη κάνει λάθη. Προς το παρόν, όλα τα αποτελέσματα της Τεχνητής Νοημοσύνης πρέπει να ελέγχονται και να επαληθεύονται από κλινικούς ιατρούς και ακτινολόγους. Όταν τα αποτελέσματα δεν αντιστοιχούν στην κλινική πραγματικότητα, ο γιατρός τα επεξεργάζεται και τα ενημερώνει, ώστε η Τεχνητή Νοημοσύνη να μπορεί να συνεχίσει να μαθαίνει. Αυτή η διαδικασία «παθητικής μάθησης» εφαρμόζεται από πολλά νοσοκομεία, αλλά εξακολουθεί να απαιτείται ένα σαφές νομικό πλαίσιο για να διασφαλιστεί η ασφάλεια των ασθενών.

Ο εκπρόσωπος Pham Nhu Hiep εξέφρασε επίσης ανησυχίες σχετικά με τον αντίκτυπο της Τεχνητής Νοημοσύνης στην επιστημονική έρευνα, καθώς το λογισμικό ελέγχου λογοκλοπής έχει γίνει δημοφιλές και ορισμένα εργαλεία Τεχνητής Νοημοσύνης μπορούν πλέον να γράψουν σχεδόν μια ολόκληρη διδακτορική διατριβή σε μία μόνο ημέρα με βάση τα παρεχόμενα δεδομένα. Αυτό αποτελεί σημαντική πρόκληση για την ερευνητική δεοντολογία και την επιστημονική ακεραιότητα και θα πρέπει να εξεταστεί η συμπερίληψή του σε εξειδικευμένους νομικούς κανονισμούς.

Όσον αφορά τη νομική ευθύνη των παρόχων Τεχνητής Νοημοσύνης (Άρθρο 13), οι αντιπρόσωποι πρότειναν να διευκρινιστεί η υπεύθυνη οντότητα όταν τα συστήματα Τεχνητής Νοημοσύνης προκαλούν συμβάντα ή ατυχήματα. Η περίπτωση των αυτόνομων αυτοκινήτων είναι ένα τυπικό παράδειγμα: σε περίπτωση σύγκρουσης, είναι απαραίτητο να προσδιοριστεί η ευθύνη του συστήματος, του κατασκευαστή ή της μονάδας λειτουργικής διαχείρισης. Ο αντιπρόσωπος ανέφερε το αυτοκινητιστικό ατύχημα της Tesla το 2015 που ανάγκασε τον κατασκευαστή να καταβάλει μεγάλη αποζημίωση, επιβεβαιώνοντας ότι η Τεχνητή Νοημοσύνη δεν μπορεί να είναι υπεύθυνη από μόνη της, αλλά η ευθύνη πρέπει να ανήκει στους ανθρώπους - τους οργανισμούς και τα άτομα που σχεδιάζουν, παράγουν και θέτουν σε χρήση το σύστημα.

Αναφερόμενος στην έννοια της ηθικής της Τεχνητής Νοημοσύνης, η οποία εφαρμόζεται από πολλές χώρες για να καθορίσει ποιες ενέργειες της Τεχνητής Νοημοσύνης επιτρέπονται και ποιες όχι, ο εκπρόσωπος Pham Nhu Hiep αναγνώρισε επίσης ότι στο πλαίσιο της ικανότητας των συστημάτων Τεχνητής Νοημοσύνης να αυτοδιδάσκονται, να σκέφτονται μόνοι τους, ακόμη και να υπερβαίνουν τα αρχικά όρια του κατασκευαστή, η ανάπτυξη και η λειτουργία της Τεχνητής Νοημοσύνης πρέπει να εντάσσεται στο νομικό και ηθικό πλαίσιο. Αυτό δεν γίνεται μόνο για να διασφαλιστεί η ασφάλεια της κοινωνίας, αλλά και για να δημιουργηθεί ένα θεμέλιο για την υγιή ανάπτυξη της βιομηχανίας Τεχνητής Νοημοσύνης στο Βιετνάμ.

Για την αποτελεσματική διαχείριση της Τεχνητής Νοημοσύνης, πρέπει να διευκρινιστούν τα δεδομένα εισόδου και η πνευματική ιδιοκτησία.

Συμφωνώντας με τις παραπάνω απόψεις, η βουλευτής της Εθνοσυνέλευσης Trinh Xuan An (Dong Nai) έκανε επίσης μια σειρά από εμπεριστατωμένα σχόλια σχετικά με το σχέδιο νόμου για την Τεχνητή Νοημοσύνη, εστιάζοντας σε κύριες ομάδες θεμάτων: δεδομένα εισόδου, πνευματική ιδιοκτησία, πεδίο εφαρμογής, προσέγγιση διαχείρισης κινδύνου και μοντέλο οργάνωσης εφαρμογής.

Η εκπρόσωπος της Εθνοσυνέλευσης Trinh Xuan An (Dong Nai) μιλά στην Ομάδα 6 το πρωί της 21ης Νοεμβρίου. Φωτογραφία: Ho Long

Όσον αφορά τα δεδομένα εισόδου για την Τεχνητή Νοημοσύνη, οι αντιπρόσωποι δήλωσαν ότι τα δεδομένα αποτελούν το θεμέλιο της τεχνητής νοημοσύνης, αλλά το σχέδιο νόμου δεν έχει διευκρινίσει αυτό το περιεχόμενο. Οι κανονισμοί για τα δεδομένα διέπονται επί του παρόντος από τον Νόμο περί Δεδομένων και τον Νόμο περί Προστασίας Προσωπικών Δεδομένων. Εάν δεν αναφέρεται ρητά σε αυτόν τον νόμο, τουλάχιστον πρέπει να υπάρχει πλήρης αναφορά. Οι αντιπρόσωποι συμφώνησαν με την απαίτηση ότι τα δεδομένα πρέπει να είναι «σωστά - επαρκή - καθαρά - ζωντανά», αλλά τόνισαν την ανάγκη να προστεθεί το κριτήριο ότι τα δεδομένα πρέπει να συστηματοποιούνται και να αναβαθμίζονται συνεχώς, επειδή αυτή είναι προϋπόθεση για την αποτελεσματική και ασφαλή λειτουργία της Τεχνητής Νοημοσύνης.

Όσον αφορά την πνευματική ιδιοκτησία, το μέλος της Εθνοσυνέλευσης Trinh Xuan An σχολίασε ότι το περιεχόμενο του σχεδίου νόμου εξακολουθεί να είναι πολύ ασαφές, ενώ η Τεχνητή Νοημοσύνη είναι ανθρώπινο προϊόν και συνδέεται στενά με ζητήματα πνευματικών δικαιωμάτων, ιδιοκτησίας, νομικής ευθύνης και ηθικής. Εάν η πτυχή της πνευματικής ιδιοκτησίας δεν διευκρινιστεί στον νόμο, η διαχείριση της Τεχνητής Νοημοσύνης θα είναι πολύ δύσκολη. Ως εκ τούτου, ο εκπρόσωπος συνέστησε την τροποποίηση του Νόμου περί Πνευματικής Ιδιοκτησίας και ταυτόχρονα τη ρύθμιση των ζητημάτων ιδιοκτησίας σε αυτόν τον νόμο.

Όσον αφορά το πεδίο εφαρμογής, ο εκπρόσωπος επεσήμανε την παραλογικότητα στο Άρθρο 1, όπου ο νόμος αποκλείει την εφαρμογή της Τεχνητής Νοημοσύνης για την εθνική άμυνα, την ασφάλεια, την κρυπτογραφία και τις πληροφορίες, αλλά οι ακόλουθες ρήτρες ανοίγουν τη δυνατότητα προσαρμογής εάν αυτά τα συστήματα χρησιμοποιούνται για άλλους σκοπούς. Στο ψηφιακό περιβάλλον, είναι δύσκολο να διαχωριστεί η Τεχνητή Νοημοσύνη για σκοπούς ασφάλειας και άμυνας και για πολιτικούς σκοπούς, επειδή η Τεχνητή Νοημοσύνη μπορεί ταυτόχρονα να υποστηρίζει την ιατρική, την αμυντική βιομηχανία ή μη επανδρωμένα συστήματα. Επομένως, ο αποκλεισμός ανά τομέα δεν είναι εφικτός. Ο εκπρόσωπος πρότεινε τη δημιουργία ενός κοινού κανονιστικού πλαισίου, αντί της διαίρεσης ανά σκοπό χρήσης.

Βουλευτές της Εθνοσυνέλευσης της επαρχίας Ντονγκ Νάι στη συνεδρίαση συζήτησης της Ομάδας 6 το πρωί της 21ης Νοεμβρίου. Φωτογραφία: Χο Λονγκ

Όσον αφορά την προσέγγιση στη διαχείριση και την ταξινόμηση κινδύνων, ο εκπρόσωπος δήλωσε ότι το προσχέδιο «εφαρμόζει» το ευρωπαϊκό μοντέλο διαχείρισης, δημιουργώντας περιττά βάρη στο πλαίσιο της ανάγκης του Βιετνάμ να ενθαρρύνει την ανάπτυξη της Τεχνητής Νοημοσύνης. Η ταξινόμηση κινδύνου τεσσάρων επιπέδων όπως στο προσχέδιο είναι περίπλοκη και ασύμβατη με τον Νόμο για την Ποιότητα των Προϊόντων. Ο εκπρόσωπος πρότεινε την ταξινόμηση μόνο δύο ομάδων: επικίνδυνα και μη επικίνδυνα προϊόντα Τεχνητής Νοημοσύνης, και τον συνδυασμό της διαχείρισης κινδύνου με τη διαχείριση με βάση την αποδοτικότητα της παραγωγής και τον οικονομικό αντίκτυπο. Είπε επίσης ότι ο κανονισμός για τις επιχειρήσεις να αυτοαξιολογούν τους κινδύνους και να αναθέτουν στην κυβέρνηση τον καθορισμό κριτηρίων είναι «μισοκλειστός, μισοανοιχτός», δύσκολος στην εφαρμογή του στην πράξη.

Όσον αφορά το μοντέλο οργάνωσης εφαρμογής, το μέλος της Εθνοσυνέλευσης Trinh Xuan An εξέφρασε ανησυχίες σχετικά με την πρόταση για τη σύσταση ενός εκτός προϋπολογισμού χρηματοδοτικού ταμείου και μιας Εθνικής Επιτροπής για την Τεχνητή Νοημοσύνη. Σύμφωνα με τον εκπρόσωπο, είναι απαραίτητο να εξεταστεί προσεκτικά η αναγκαιότητα αυτών των θεσμών, αποφεύγοντας την κατάσταση της «σύστασης ταμείων και επιτροπών για τα πάντα» αλλά με χαμηλή απόδοση. Εάν είναι πραγματικά απαραίτητο, το ταμείο για την Τεχνητή Νοημοσύνη θα πρέπει να ενσωματωθεί στα υπάρχοντα ταμεία, εκτός από ειδικές περιπτώσεις, όπως τα ταμεία που εξυπηρετούν την εθνική άμυνα και ασφάλεια. Ο εκπρόσωπος σημείωσε επίσης ότι η Τεχνητή Νοημοσύνη πρέπει να συνδέεται με τις οικονομικές δραστηριότητες και την πρωτοβουλία των επιχειρήσεων, επομένως το μοντέλο διαχείρισης πρέπει να βελτιστοποιηθεί και να προσανατολιστεί στην πραγματική αποτελεσματικότητα.

Εκπρόσωπος της Εθνοσυνέλευσης Μπούι Σουάν Θονγκ (Ντονγκ Νάι)

Συμφωνώντας με την παραπάνω άποψη, οι βουλευτές της Εθνοσυνέλευσης Nguyen Thi Nhu Y και Bui Xuan Thong (Dong Nai) τόνισαν επίσης το ηθικό πλαίσιο στη χρήση της τεχνητής νοημοσύνης. Σύμφωνα με τον εκπρόσωπο Bui Xuan Thong, εάν ορίζεται ότι οι χρήστες πρέπει να είναι υπεύθυνοι για τις αποφάσεις που λαμβάνονται από την Τεχνητή Νοημοσύνη, τότε στην πραγματικότητα η τελική απόφαση εξακολουθεί να είναι ανθρώπινη. Η Τεχνητή Νοημοσύνη είναι απλώς ένα εργαλείο για την παροχή πληροφοριών αναφοράς. Το άτομο που λαμβάνει την τελική απόφαση είναι υπεύθυνο για αυτήν την απόφαση. Επομένως, το ηθικό πλαίσιο θα πρέπει να επικεντρώνεται στην ανθρώπινη ευθύνη κατά τη χρήση πληροφοριών από την Τεχνητή Νοημοσύνη, όχι στον καθορισμό ότι η Τεχνητή Νοημοσύνη πρέπει να είναι υπεύθυνη.

Όσον αφορά το ζήτημα της αντιμετώπισης παραβάσεων, οι εκπρόσωποι δήλωσαν ότι το προσχέδιο γενικά αναφέρει ότι μπορεί να αντιμετωπιστεί διοικητικά, αστικά ή ποινικά, αλλά δεν είναι σαφές σχετικά με τα όρια της ευθύνης. Ως εκ τούτου, συνιστάται να καθοριστεί με σαφήνεια ποιες συμπεριφορές θα υπόκεινται σε ποινική ευθύνη, ποιες συμπεριφορές θα υπόκεινται σε διοικητική ευθύνη και οι συγκεκριμένες ευθύνες του παρόχου, του προγραμματιστή και του χρήστη. Ταυτόχρονα, είναι επίσης απαραίτητο να συμπληρωθούν οι απαγορευμένες συμπεριφορές και να επανασχεδιαστεί αυτό το πλαίσιο ώστε να είναι σαφές, τόσο για να δημιουργηθούν οι προϋποθέσεις για την ανάπτυξη της Τεχνητής Νοημοσύνης όσο και για να καθοριστούν με σαφήνεια οι ευθύνες των εμπλεκόμενων μερών.

Πηγή: https://daibieunhandan.vn/artificial-intelligence-must-operate-in-the-law-and-moral-system-10396524.html

![[Φωτογραφία] Ο Πρωθυπουργός ολοκληρώνει το ταξίδι του για τη Σύνοδο Κορυφής της G20 στη Νότια Αφρική](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F24%2F1763944494358_vna-potal-thu-tuong-ket-thuc-chuyen-tham-du-hoi-nghi-thuong-dinh-g20-tai-nam-phi-8428321-4810-jpg.webp&w=3840&q=75)

Σχόλιο (0)