Imagen que muestra la tendencia de los vídeos de intercambio de caras.

Desde los videos virales de "morphing" en las redes sociales hasta los comerciales personalizados, la tecnología de intercambio de rostros, comúnmente conocida como "deepfake" o "face swap", se ha convertido en un fenómeno cultural digital.

Tendencia del trasplante de cara

En tan solo unos segundos, los usuarios pueden transformarse en una superestrella de Hollywood, un personaje de dibujos animados o incluso en un personaje famoso del pasado. Pero tras la comodidad y la diversión de esta tendencia se esconde un complejo proceso de digitalización de datos faciales, que plantea numerosas preguntas sobre la privacidad y la seguridad de la información personal.

El atractivo de la tendencia del trasplante de cara proviene de la psicología del gusto por el entretenimiento y el deseo de mantenerse al día con las tendencias en las redes sociales.

Muchas personas, especialmente los jóvenes, se sienten atraídas por la curiosidad y la oportunidad de crear contenido único. Sin embargo, su desconocimiento de la tecnología de IA y la seguridad de los datos les hace pasar por alto fácilmente los riesgos.

La tecnología de trasplante facial utiliza inteligencia artificial (IA), específicamente algoritmos de aprendizaje profundo, para analizar y reconstruir imágenes faciales.

Aplicaciones como FaceApp, Reface o plataformas de edición de vídeo profesional como Adobe After Effects integran IA que puede reconocer rasgos faciales como ojos, nariz, boca, expresiones e iluminación.

Luego, la tecnología mapea el rostro de una persona sobre el rostro del personaje en el video, creando un producto que parece increíblemente realista.

Para ello, se recopilan datos faciales mediante imágenes o vídeos proporcionados por los usuarios. Las aplicaciones suelen requerir que los usuarios suban una o más selfies y luego utilizan modelos de IA para analizar y almacenar información sobre la estructura facial.

Estos datos incluyen puntos de referencia faciales, color de la piel, ángulos faciales e incluso expresiones, que se codifican en vectores digitales para su procesamiento por computadora.

Los riesgos de que los rostros se conviertan en datos biométricos

El rostro es una forma de datos biométricos, altamente personal y no se puede cambiar como una contraseña.

Si estos datos se filtran, los usuarios no podrán "cambiar sus rostros" para protegerse. La tecnología deepfake, con la capacidad de crear videos con voces e imágenes falsas, se está convirtiendo en una gran amenaza.

Muchas aplicaciones, especialmente las de plataformas extranjeras, no cuentan con una representación legal clara en Vietnam, pero aun así se utilizan ampliamente. Además, las políticas de privacidad suelen estar redactadas de forma compleja y confusa, lo que provoca que los usuarios sean negligentes y las acepten fácilmente sin consideración.

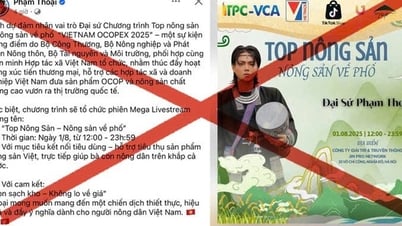

En Vietnam, se han dado casos de uso de vídeos de intercambio de caras para difamar la reputación o cometer fraude financiero, causando graves daños a la reputación personal y la confianza social.

Además, los datos faciales corren el riesgo de ser utilizados para entrenar sistemas de reconocimiento sin consentimiento, con fines que van desde los comerciales hasta la vigilancia, sin el conocimiento de los usuarios.

¿Qué hacer para proteger los datos faciales?

Para participar en la tendencia del trasplante de cara y al mismo tiempo proteger los datos personales, los usuarios deben adquirir los hábitos y conocimientos necesarios.

Primero, siempre verifique el origen de la aplicación antes de subir imágenes. Evite las aplicaciones de origen desconocido o sin información del desarrollador, ya que pueden representar un riesgo de robo de datos.

A continuación, tómate tu tiempo para leer atentamente la política de privacidad de la aplicación, prestando especial atención a cómo se almacenan, utilizan y comparten los datos faciales. Si la política no es clara o solicita acceso innecesario, como a toda tu biblioteca de fotos o ubicación, considera rechazarla.

Elegir plataformas confiables, como las de grandes empresas como Adobe o Reface, que tienen políticas de privacidad transparentes, es una forma efectiva de minimizar el riesgo.

Además, los usuarios deben limitar la carga de fotos de alta resolución o fotos que contengan información confidencial, y solo compartir videos de intercambio de caras en plataformas privadas, evitando publicar públicamente contenido que pueda ser objeto de abuso.

Para aumentar la seguridad, verifique periódicamente los permisos de las aplicaciones en su dispositivo y utilice software antivirus para detectar actividad sospechosa.

En última instancia, aprender sobre la tecnología deepfake y cómo identificar contenido falso ayudará a los usuarios a mantenerse alerta y evitar ser víctimas de estafas o difamación.

Los riesgos de que los rostros se conviertan en "datos biométricos"

Pérdida de privacidad: Los rostros son un tipo de datos biométricos que no se pueden reemplazar, como las contraseñas. Una vez filtrados, los usuarios no pueden cambiar sus rostros, como sí pueden cambiar sus PIN.

El riesgo de ser suplantado por deepfake: los vídeos con voces y rostros falsos son cada vez más populares y provocan confusión, fraude financiero o difamación personal.

Utilizado para entrenar IA sin conocimiento: las fotos de los usuarios se pueden usar para entrenar sistemas de reconocimiento facial, aumentando la precisión de la IA comercial, sin ninguna compensación o aviso.

¿Qué hacer para proteger los datos faciales?

Lea atentamente la política de privacidad: antes de utilizar una aplicación, compruebe cómo gestiona el proveedor sus datos.

Limite el suministro de datos confidenciales: cargue solo las imágenes necesarias y evite usar aplicaciones desconocidas.

Utilice plataformas confiables: priorice aplicaciones de grandes empresas con políticas de privacidad transparentes.

Actualización de ciberseguridad: comprenda los riesgos de la tecnología deepfake y cómo identificar contenido falso.

Fuente: https://tuoitre.vn/trao-luu-ghep-mat-vao-video-du-lieu-khuon-mat-dang-bi-so-hoa-ra-sao-20250529105826111.htm

Kommentar (0)