جفری مکگرگور، مدیرعامل Truepic، گفت که این حادثه تنها نوک کوه یخ است. مکگرگور گفت که محتوای تولید شده توسط هوش مصنوعی بیشتری در رسانههای اجتماعی وجود خواهد داشت و ما برای آن آماده نیستیم.

طبق گزارش CNN، Truepic میخواهد با ارائه فناوریای که ادعا میکند رسانه را در زمان ایجاد از طریق Truepic Lens تأیید میکند، این مشکل را حل کند. این برنامه جمعآوری دادهها، تاریخ، زمان، مکان و دستگاهی را که برای ایجاد تصویر استفاده شده است، به کاربران اطلاع میدهد و یک امضای دیجیتالی را برای تأیید اینکه آیا تصویر طبیعی است یا توسط هوش مصنوعی تولید شده است، اعمال میکند.

عکس جعلی انفجار پنتاگون در توییتر منتشر شد

شرکت Truepic، که در سال ۲۰۱۵ توسط مایکروسافت تأسیس شد و تحت حمایت این شرکت است، اعلام کرد که این شرکت از سازمانهای مردمنهاد گرفته تا شرکتهای رسانهای و حتی شرکتهای بیمه که به دنبال تأیید صحت ادعاها هستند، مورد توجه قرار گرفته است.

مکگرگور میگوید وقتی همه چیز را میتوان جعل کرد، وقتی هوش مصنوعی به اوج کیفیت و دسترسیپذیری خود رسیده است، دیگر نمیدانیم واقعیت آنلاین چیست.

شرکتهای فناوری مانند Truepic سالهاست که برای مبارزه با اطلاعات نادرست آنلاین تلاش میکنند. اما ظهور نسل جدیدی از ابزارهای هوش مصنوعی که میتوانند تصاویر و متن را با دستور کاربر تولید کنند، فوریت بیشتری به این موضوع بخشیده است. در اوایل سال جاری، تصاویر جعلی از پاپ فرانسیس با ژاکت پایین Balenciaga و دونالد ترامپ، رئیس جمهور سابق آمریکا که دستگیر شد، به طور گسترده به اشتراک گذاشته شد. هر دو حادثه میلیونها نفر را در مورد خطرات احتمالی هوش مصنوعی سردرگم کرده است.

برخی از قانونگذاران اکنون از شرکتهای فناوری میخواهند که با برچسبگذاری محتوای تولید شده توسط هوش مصنوعی به این موضوع رسیدگی کنند. ورا جورووا، معاون رئیس کمیسیون اروپا (EC)، گفت که شرکتهایی از جمله گوگل، متا، مایکروسافت و تیکتاک به آییننامه داوطلبانه اتحادیه اروپا (EU) در مورد مبارزه با اطلاعات نادرست پیوستهاند.

تعداد فزایندهای از استارتآپها و غولهای فناوری، از جمله برخی از شرکتهایی که هوش مصنوعی مولد را در محصولات خود پیادهسازی میکنند، در تلاشند تا استانداردها و راهحلهایی را پیادهسازی کنند تا به افراد کمک کنند تشخیص دهند که آیا یک تصویر یا ویدیو با هوش مصنوعی ساخته شده است یا خیر.

اما از آنجایی که فناوری هوش مصنوعی سریعتر از آن چیزی که انسانها بتوانند با آن همگام شوند، پیشرفت میکند، مشخص نیست که آیا این راهحلها میتوانند مشکل را به طور کامل حل کنند یا خیر. حتی OpenAI، شرکت پشت Dall-E و ChatGPT، اعتراف کرده است که تلاشهای خودش برای کمک به تشخیص نوشتههای تولید شده توسط هوش مصنوعی ناقص است.

شرکتهایی که در حال توسعه راهحل هستند، دو رویکرد را برای این مشکل در پیش میگیرند. رویکرد اول مبتنی بر توسعه برنامههایی برای شناسایی تصاویر تولید شده توسط هوش مصنوعی پس از تولید و اشتراکگذاری آنلاین آنهاست. رویکرد دیگر بر علامتگذاری یک تصویر به عنوان واقعی یا تولید شده توسط هوش مصنوعی با نوعی امضای دیجیتال تمرکز دارد.

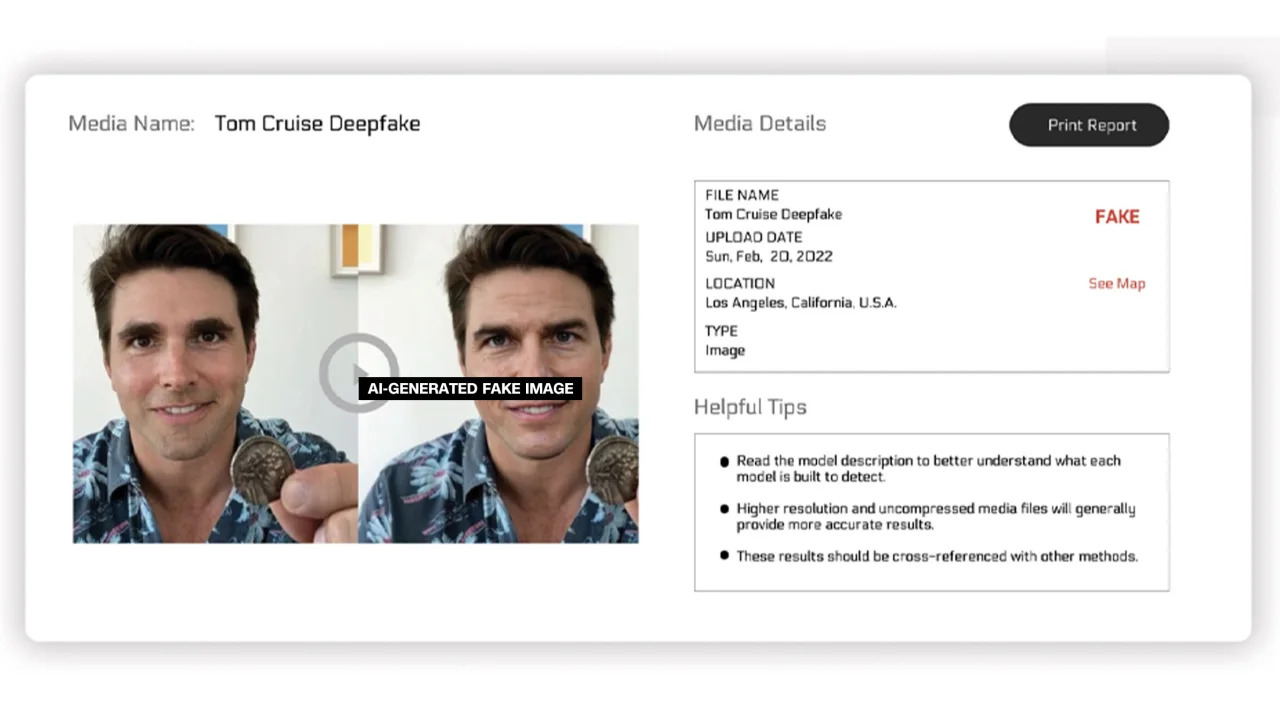

Reality Defender و Hive Moderation روی اولین مورد کار میکنند. با پلتفرم آنها، کاربران میتوانند تصاویر را برای اسکن آپلود کنند و سپس گزارشی دریافت کنند که نشان میدهد عکس واقعی است یا توسط هوش مصنوعی تولید شده است.

شرکت Reality Defender اعلام کرد که از فناوری اختصاصی دیپفیک و انگشتنگاری محتوای مولد برای شناسایی ویدیو، صدا و تصاویر تولید شده توسط هوش مصنوعی استفاده میکند. در مثالی که توسط این شرکت ارائه شده است، Reality Defender تصویری دیپفیک از تام کروز را نشان داد که ۵۳٪ «مشکوک» بود زیرا فرد موجود در تصویر چهرهای تحریفشده داشت که اغلب در عکسهای دستکاریشده دیده میشود.

تصاویر برچسبگذاریشدهی تولیدشده توسط هوش مصنوعی

این سرویسها نسخههای رایگان و پولی ارائه میدهند. Hive Moderation میگوید که برای هر ۱۰۰۰ تصویر ۱.۵۰ دلار هزینه دریافت میکند. Realty Defender میگوید قیمتگذاری آن میتواند بر اساس عوامل مختلفی متفاوت باشد، در مواردی که مشتریان به تخصص و پشتیبانی شرکت نیاز دارند. بن کولمن، مدیرعامل Reality Defender، میگوید خطر هر ماه دو برابر میشود زیرا هر کسی میتواند با استفاده از ابزارهای هوش مصنوعی عکسهای جعلی ایجاد کند.

چندین شرکت دیگر نیز در حال کار بر روی افزودن نوعی برچسب به تصاویر هستند تا تأیید کنند که آیا آنها واقعی هستند یا توسط هوش مصنوعی تولید شدهاند. تاکنون، این تلاش تا حد زیادی توسط اتحاد اصالت و منشأ محتوا (C2PA) هدایت شده است.

C2PA در سال ۲۰۲۱ برای ایجاد یک استاندارد فنی برای تأیید منشأ و تاریخچه رسانههای دیجیتال تأسیس شد که ابتکار تأیید هویت محتوا (CAI) ادوبی و پروژه Origin، به رهبری مایکروسافت و بیبیسی، را با تمرکز بر مبارزه با اطلاعات نادرست در اخبار دیجیتال ترکیب میکند. از دیگر شرکتهای درگیر در C2PA میتوان به Truepic، Intel و Sony اشاره کرد.

بر اساس اصول C2PA، CAI ابزارهای متنبازی را برای شرکتها منتشر خواهد کرد تا اعتبارنامههای محتوا یا فرادادههایی را ایجاد کنند که حاوی اطلاعاتی در مورد تصاویر هستند. طبق وبسایت CAI، این امر به سازندگان اجازه میدهد تا جزئیات مربوط به نحوه ایجاد یک تصویر را به طور شفاف به اشتراک بگذارند. به این ترتیب، کاربران نهایی میتوانند به زمینه مربوط به اینکه چه کسی، چه چیزی و چگونه یک تصویر تغییر داده شده است، دسترسی پیدا کنند و سپس خود قضاوت کنند که تصویر چقدر معتبر است.

بسیاری از شرکتها قبلاً استاندارد C2PA و ابزارهای CAI را در برنامههای خود ادغام کردهاند. Firefly ادوبی، یک ابزار تصویربرداری هوش مصنوعی جدید که به فتوشاپ اضافه شده است، از طریق ویژگی Content Credentials خود با استاندارد C2PA مطابقت دارد. مایکروسافت همچنین اعلام کرد که تصاویر و ویدیوهای ایجاد شده با Bing Image Creator و Microsoft Designer در ماههای آینده دارای امضاهای رمزنگاری خواهند بود.

در ماه مه، گوگل از ویژگی «درباره این تصویر» رونمایی کرد که به کاربران امکان میدهد ببینند یک تصویر اولین بار چه زمانی در گوگل ظاهر شده و در کجا قابل مشاهده است. این غول جستجو همچنین اعلام کرد که هر تصویر تولید شده توسط هوش مصنوعی گوگل، در فایل اصلی خود یک نشانهگذاری خواهد داشت تا در صورت یافتن تصویر در وبسایت یا پلتفرم دیگری، «زمینه را اضافه کند».

در حالی که شرکتهای فناوری در تلاشند تا نگرانیهای مربوط به تصاویر تولید شده توسط هوش مصنوعی و یکپارچگی رسانههای دیجیتال را برطرف کنند، کارشناسان این حوزه تأکید میکنند که کسبوکارها برای رسیدگی به این موضوع باید با یکدیگر و با دولتها همکاری کنند. با این حال، شرکتهای فناوری با وجود خطرات، در حال رقابت برای توسعه هوش مصنوعی هستند.

لینک منبع

![[عکس] جینسینگ کوهی دن، هدیهای گرانبها از طبیعت به سرزمین کین باک](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F30%2F1764493588163_ndo_br_anh-longform-jpg.webp&w=3840&q=75)

نظر (0)