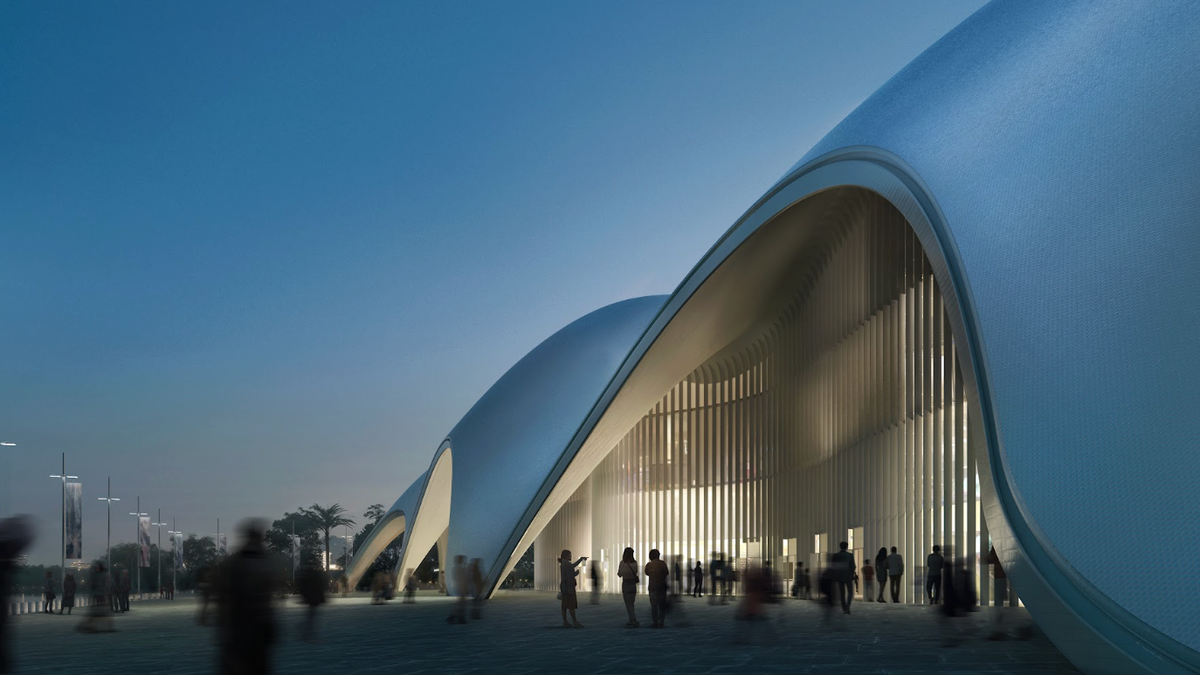

Un défi ambitieux : enseigner à l’IA ce qui est bien et ce qui est mal, et comment faire de la technologie un outil de transparence, de responsabilité et de bien commun.

Quand l'éthique devient le « second cerveau » de l'IA

Alors que l'atmosphère excitante de l'AIWS Angel se répandait encore, le comité d'organisation du concours AIWS 2025 a rapidement annoncé le deuxième thème - AIWS Ethics, marquant la transition de « compagnon IA » à « IA responsable ».

Si, lors du premier sujet, les participants étaient encouragés à créer des « tech angels » pour aider les individus à apprendre, innover et prendre soin de leur santé, AIWS Ethics relève le défi : concevoir et développer des outils permettant d'évaluer les valeurs éthiques liées à la conception et à l'utilisation de l'IA. L'objectif n'est pas seulement de créer des produits utiles, mais aussi d'orienter le développement de l'IA dans la bonne direction : transparente, responsable et pour le bien commun de l'humanité.

Les candidatures peuvent porter sur des idées innovantes et révolutionnaires, ou sur des logiciels, applications ou systèmes d'évaluation simples, accessibles, pédagogiques et évolutifs. C'est un terrain fertile pour l'innovation humaniste, où technologie et éthique vont de pair.

Pourquoi choisir « Éthique » maintenant ?

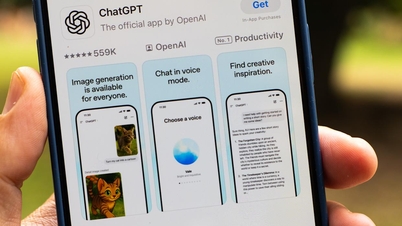

Il n'a jamais été aussi nécessaire pour l'humanité de débattre de l'éthique technologique. Alors que l'intelligence artificielle sort des laboratoires pour s'imposer dans la vie quotidienne, de grandes questions se posent : l'IA peut-elle être biaisée ? Peut-elle porter atteinte à la vie privée ? Peut-elle prendre de mauvaises décisions, voire préjudiciables ?

Une étude de l'Annenberg Media Center (États-Unis) révèle que plus de 70 % des utilisateurs mondiaux s'inquiètent d'une utilisation abusive de l'IA ou d'un manque de contrôle éthique. Selon l'UNESCO, les organisations internationales travaillent à l'élaboration de cadres mondiaux d'évaluation éthique de l'IA, tels que l'« Évaluation de l'impact éthique (EIE) » ou la « Recommandation sur l'éthique de l'IA », afin de mesurer l'impact social et humain des technologies.

Cependant, la plupart de ces outils restent réservés aux grandes entreprises ou aux instituts de recherche. La jeune communauté, les étudiants et les startups – dynamiques, créatifs et proches des utilisateurs – ne disposent pas d'outils suffisamment simples d'utilisation pour évaluer et diffuser les normes éthiques en IA. C'est précisément cette lacune qu'AIWS Ethics entend combler.

De la technologie à la conscience : la différence éthique de l'AIWS

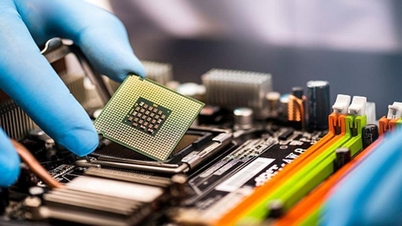

Alors que les précédentes éditions du Concours d'IA se concentraient sur les applications et les avancées techniques, AIWS Éthique invite à scruter en profondeur les rouages de la technologie. La question n'est plus « Que peut faire l'IA ? », mais « Que devrait faire l'IA, et que ne devrait-elle pas faire ? »

Ce sujet exige des participants qu'ils comprennent non seulement la programmation et les algorithmes, mais aussi la capacité à poser des questions éthiques, à critiquer la société et à concevoir des solutions humaines. Un programmeur peut devenir un garant de l'éthique de l'IA ; un enseignant peut créer un outil pour enseigner l'éthique technologique ; une start-up peut développer une application pour évaluer la transparence des chatbots ou des générateurs d'images.

C’est dans ce processus qu’AIWS Ethics ouvre un espace créatif très particulier – où les données rencontrent la philosophie, les algorithmes rencontrent la compassion.

Dans l’esprit du thème, d’innombrables directions créatives peuvent être envisagées : une application qui aide les étudiants à comprendre l’équité dans l’IA ; un site Web communautaire qui permet d’établir des « scores éthiques » d’outils d’IA populaires ; un chatbot qui peut poser des situations éthiques hypothétiques et analyser les décisions des utilisateurs ; ou un logiciel qui teste les modèles d’apprentissage automatique pour détecter les biais dans les données.

Ces innovations ne concernent pas seulement la technologie, mais aussi l'éducation, sensibilisant la communauté à l'éthique de l'IA. Chaque produit est une petite brique qui construit une culture d'« IA responsable ».

Le voyage de « semer des graines de conscience » pour l'intelligence artificielle

Ce dicton est également l’âme du thème de cette année : l’IA n’a pas seulement besoin de big data, mais aussi d’un grand cœur.

Avec AIWS Ethics, le comité d'organisation du Concours d'IA 2025 espère créer une vague d'innovation responsable, où les jeunes souhaitent non seulement renforcer l'IA, mais aussi l'améliorer. Ce thème ne se limite pas aux produits technologiques, mais s'étend à la construction d'une culture : une culture éthique à l'ère de l'apprentissage automatique.

Le concours invite non seulement les programmeurs, mais aussi les éducateurs, les artistes, les chercheurs en sciences sociales, c’est-à-dire toute personne intéressée par la manière dont la technologie façonne le monde humain.

Une invitation du futur

Le Concours d'IA 2025 ouvre un nouveau chapitre : chaque idée est jugée non seulement sur ses performances, mais aussi sur son sens des responsabilités. Le thème « Éthique de l'AIWS » rappelle que si l'intelligence artificielle peut apprendre à penser, les humains doivent lui apprendre à vivre avec bienveillance.

Et qui sait, à partir de ce concours, un groupe d'étudiants vietnamiens pourrait créer le premier outil d'évaluation de l'éthique de l'IA pour la communauté mondiale - un produit « Made in Vietnam » à la fois intelligent et consciencieux.

(Source : VLAB Innovation)

Source : https://vietnamnet.vn/ai-contest-2025-aiws-ethics-hanh-trinh-gioi-hat-luong-tam-cho-ai-2449711.html

Comment (0)