Hoang Oanh (nom du personnage modifié) est un employé de bureau à Hanoï . Alors qu'il discutait avec un ami sur Facebook Messenger, celui-ci lui a dit au revoir et a mis fin à la conversation, mais a soudainement repris son message, lui demandant d'emprunter de l'argent et lui suggérant de le virer sur un compte bancaire.

Bien que le nom du compte corresponde à celui de son amie, Hoang Oanh, encore méfiante, a demandé un appel vidéo pour vérification. Son amie a immédiatement accepté, mais l'appel n'a duré que quelques secondes en raison d'une « connexion intermittente », comme elle l'a expliqué. Voyant le visage de son amie lors de l'appel vidéo et la voix de cette dernière, Hoang Oanh n'a plus douté et a transféré l'argent. Cependant, ce n'est qu'une fois le transfert réussi que l'utilisatrice a compris qu'elle était tombée dans le piège du pirate.

Le cas de l'utilisateur Hoang Oanh n'est qu'une des nombreuses victimes qui sont « tombées dans le piège » de groupes frauduleux utilisant la technologie de l'intelligence artificielle pour créer des images et des voix des amis et des proches des victimes afin de les inciter à s'approprier leurs biens.

Les experts de Bkav ont déclaré qu'au cours du second semestre 2023 et surtout à l'époque du Nouvel An lunaire 2024, cette société de sécurité informatique a continuellement reçu des rapports et des demandes d'aide de victimes concernant des cas de fraude similaires à ceux mentionnés ci-dessus.

Selon l'analyse des experts de l'entreprise, dans le cas de l'utilisateur Hoang Oanh, les méchants ont pris le contrôle du compte Facebook mais ne l'ont pas immédiatement pris complètement, mais ont plutôt suivi secrètement et attendu une opportunité pour se faire passer pour la victime et demander à emprunter de l'argent à leurs amis et à leurs proches.

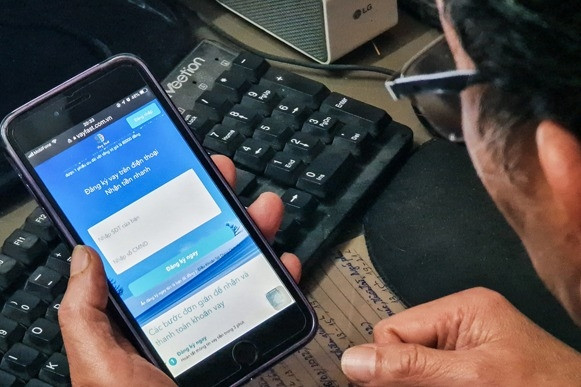

Les escrocs utilisent l'IA pour créer une fausse vidéo du visage et de la voix du propriétaire du compte Facebook (Deepfake). Lorsqu'on leur demande de passer un appel vidéo pour vérification, ils acceptent l'appel, mais se déconnectent rapidement pour éviter d'être détectés.

M. Nguyen Tien Dat, directeur général du Centre de recherche sur les logiciels malveillants de Bkav, a souligné que même lorsqu'un utilisateur passe un appel vidéo et voit le visage de ses proches et entend leur voix, il ne s'agit pas forcément d'une conversation avec cette personne. Récemment, de nombreuses personnes ont été victimes d'escroqueries financières utilisant le deepfake et l'intelligence artificielle.

« La capacité de collecter et d'analyser les données des utilisateurs grâce à l'IA permet de créer des stratégies de fraude sophistiquées. Cela signifie également que la complexité des scénarios de fraude combinés à Deepfake et GPT augmentera, rendant la détection des fraudes beaucoup plus difficile », a déclaré M. Nguyen Tien Dat.

Les experts de Bkav recommandent aux utilisateurs d'être particulièrement vigilants et de ne pas divulguer d'informations personnelles (carte d'identité, numéro de compte bancaire, code OTP, etc.). Ils ne doivent pas transférer d'argent à des inconnus par téléphone, sur les réseaux sociaux ou sur des sites web présentant des signes de fraude. En cas de demande d'emprunt/de transfert d'argent sur un compte via les réseaux sociaux, il est conseillé d'utiliser d'autres méthodes d'authentification, comme un appel ou d'autres moyens de communication, pour confirmer à nouveau.

En prévoyant les tendances en matière de cyberattaques en 2024, les experts s’accordent à dire que le développement rapide de l’IA apporte non seulement des avantages évidents, mais crée également des risques importants pour la cybersécurité.

Le principal défi pour les entreprises et les organisations face à l'IA réside aujourd'hui dans la fraude et les menaces persistantes avancées (APT), compte tenu de la complexité croissante des scénarios de fraude, notamment lorsqu'ils combinent deepfake et GPT. La capacité de collecte et d'analyse des données utilisateur grâce à l'IA permet de créer des stratégies de fraude sophistiquées, rendant ainsi l'identification des fraudes plus difficile pour les utilisateurs.

Le renforcement de la sécurité de l'IA est une tendance indéniable à venir. La communauté internationale devra coopérer étroitement pour développer de nouvelles mesures de sécurité, tout en sensibilisant les utilisateurs aux risques potentiels de l'IA.

Méfiez-vous des arnaques diffusant de faux messages de marque

Avertissement concernant 5 arnaques en ligne pendant le Nouvel An lunaire 2024

L'usurpation d'identité des autorités représente 9 % du total des attaques de phishing au Vietnam

Source

![[Photo] Le Premier ministre Pham Minh Chinh préside la première réunion du Comité central de pilotage sur la politique du logement et le marché immobilier](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/22/c0f42b88c6284975b4bcfcf5b17656e7)

![[Photo] Le secrétaire général To Lam remet la médaille du travail de première classe au groupe national de l'énergie et de l'industrie du Vietnam](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/21/0ad2d50e1c274a55a3736500c5f262e5)

Comment (0)