Le 12 mars, Google a présenté Gemma 3, un modèle d'IA open source de troisième génération qui peut fonctionner à la fois sur les smartphones et les stations de travail hautes performances.

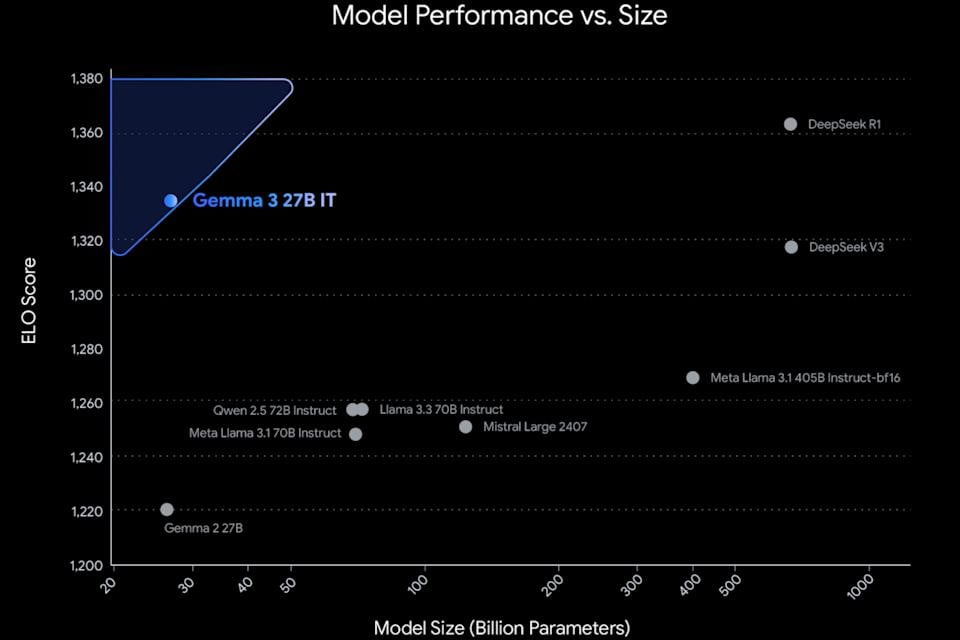

Gemma 3 est disponible en quatre variantes avec 1 milliard, 4 milliards, 12 milliards et 27 milliards de paramètres. Selon Google, il s'agit du meilleur modèle mono-vitesse au monde , capable de fonctionner sur un seul GPU ou TPU au lieu de nécessiter un grand cluster d'ordinateurs.

En théorie, cela permet à Gemma 3 de fonctionner directement sur l'unité de traitement Tensor (TPU) du téléphone Pixel, de la même manière que le modèle Gemini Nano fonctionne localement sur un appareil mobile.

Comparé à la famille de modèles d'IA Gemini, le principal avantage de Gemma 3 réside dans son caractère open source, qui permet aux développeurs de personnaliser, de packager et de déployer facilement à la demande des applications mobiles et des logiciels de bureau. De plus, Gemma prend en charge plus de 140 langues, dont 35 sont déjà disponibles sous forme de modules de formation.

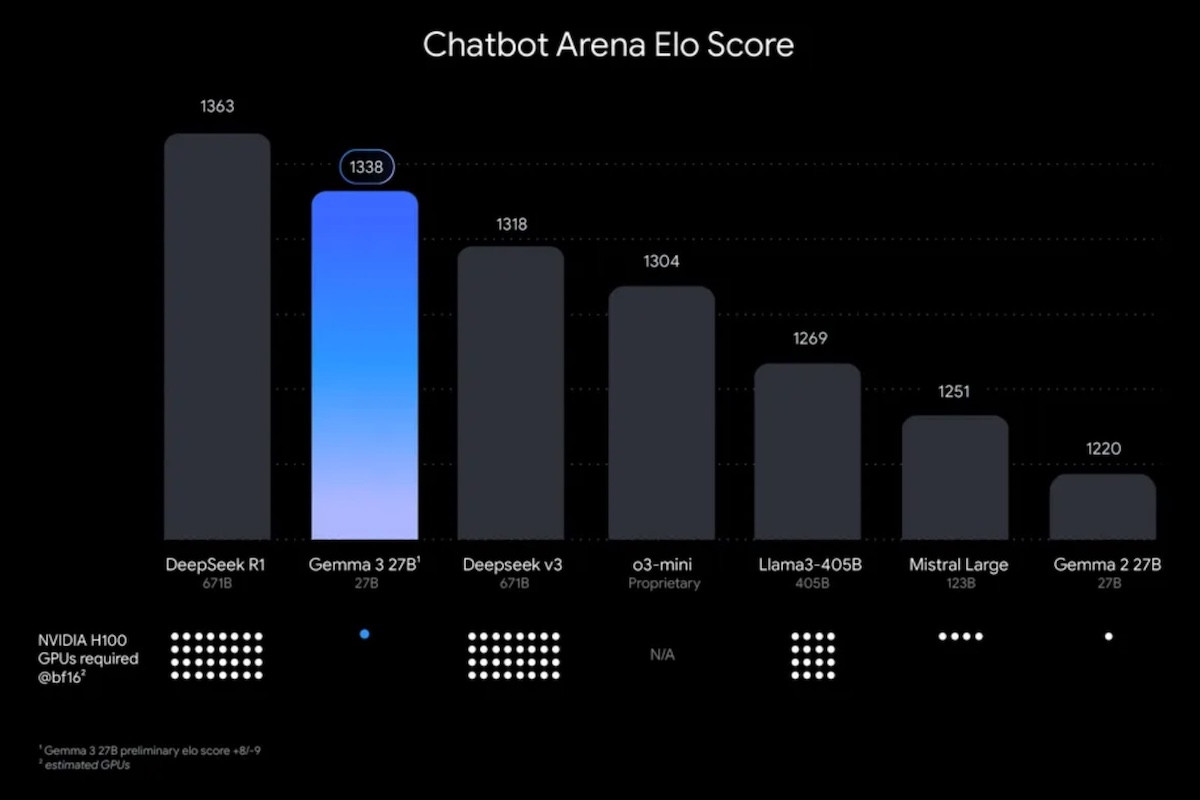

Semblable aux derniers modèles Gemini 2.0, Gemma 3 est capable de traiter du texte, des images et des vidéos . En termes de performances, Gemma 3 est mieux noté que de nombreux autres modèles d'IA open source populaires, notamment DeepSeek V3, OpenAI o3-mini et la variante Llama-405B de Meta.

Contexte équivalent à 200 pages de livre

Gemma 3 prend en charge une fenêtre contextuelle pouvant atteindre 128 000 jetons, soit l'équivalent du volume de données d'un livre de 200 pages. À titre de comparaison, le modèle Gemini 2.0 Flash Lite dispose d'une fenêtre contextuelle pouvant atteindre 1 million de jetons.

Gemma 3 peut interagir avec des ensembles de données externes et agir comme un agent automatisé, de la même manière que Gemini prend en charge de manière transparente le travail sur des plateformes telles que Gmail ou Docs.

Les derniers modèles d'IA open source de Google peuvent être déployés localement ou via les services cloud de l'entreprise, tels que Vertex AI. Gemma 3 est désormais disponible sur Google AI Studio, ainsi que sur des plateformes tierces comme Hugging Face, Ollama et Kaggle.

Le modèle open source de troisième génération de Google s'inscrit dans une tendance du secteur où les entreprises développent en parallèle des modèles de langage de grande taille (LLM) et des modèles de langage de petite taille (SLM). Microsoft, concurrent de Google, poursuit une stratégie similaire avec sa gamme Phi de modèles de langage de petite taille open source.

Les petits modèles de langage comme Gemma et Phi sont très appréciés pour leur efficacité en termes de ressources, ce qui les rend idéaux pour une utilisation sur des appareils comme les smartphones. De plus, leur faible latence les rend particulièrement adaptés aux applications mobiles.

Source : https://vietnamnet.vn/google-ra-mat-gemma-3-mo-hinh-ai-ma-nguon-mo-voi-hieu-suat-vuot-troi-2380097.html

![[Maritime News] Plus de 80 % de la capacité mondiale de transport maritime par conteneurs est entre les mains de MSC et des principales alliances maritimes](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

Comment (0)