S’appuyant sur l’expérience de nombreux pays et sur les principes de l’UNESCO, le Vietnam élabore une réglementation pour développer l’intelligence artificielle (IA) de manière éthique et responsable.

Lors de l'atelier « Développement et application responsables de l'intelligence artificielle : théorie et pratique », qui s'est tenu le matin du 28 février à l'Université de droit de l'Université nationale du Vietnam, le vice-ministre des Sciences et de la Technologie, Bui The Duy, a déclaré que l'éthique de l'IA est un problème complexe et mondial qui attire de nombreux pays et organisations du monde entier, dont l'UNESCO, désireux de participer à la recherche de solutions.

« L’UNESCO est une organisation axée sur la culture et l’éducation . Cependant, pour la première fois, elle a intégré l’intelligence artificielle – un sujet lié à la technologie – à ses débats. Cette initiative a même incité certains pays qui l’avaient quittée à la réintégrer », a-t-il déclaré.

Selon le vice-ministre, l'éthique de l'IA a des répercussions sur de nombreux aspects de la vie, tels que la société, le droit, la compétition politique et la concurrence commerciale. Pour que l'intelligence artificielle se développe de manière responsable, sa gestion doit être rigoureusement encadrée, depuis la définition des modèles d'IA et la collecte des données jusqu'à la finalisation du système et sa mise en application. Au Vietnam, ce processus requiert la coordination d'ingénieurs, de scientifiques et d'organismes de gestion comme le ministère des Sciences et des Technologies, le ministère de l'Information et des Communications et le ministère de la Sécurité publique .

Lors de cet atelier, M. Duy a également indiqué que les principes de l'UNESCO constituent le fondement sur lequel les pays peuvent fonder leur réglementation en matière d'éthique de l'IA. Premièrement, le modèle d'intelligence artificielle doit être conforme à la conception et aux tâches définies dès le départ, afin de garantir l'absence d'actions destructrices susceptibles de nuire à l'être humain.

« L’IA est radicalement différente des technologies développées par l’homme. Alors que les technologies traditionnelles se limitent à des objectifs prédéfinis, l’IA peut ouvrir de nouvelles perspectives, échappant au contrôle du développeur », a-t-il déclaré. Le vice-ministre a également cité l’exemple de deux systèmes informatiques conversant en anglais. Après un certain temps, ces derniers ont soudainement commencé à communiquer dans une langue étrangère, empêchant l’équipe de recherche de comprendre le contenu de la conversation.

La question de l'égalité et de l'équité est également un sujet de préoccupation lors de la conception d'un modèle d'IA. Selon M. Duy, dès la collecte des données nécessaires à l'entraînement de l'intelligence artificielle, des inégalités peuvent apparaître et nuire à l'ensemble du système.

Concernant le modèle de reconnaissance vocale par IA, il a expliqué que si les données proviennent uniquement d'habitants de Hanoï, le système sera biaisé lors des interactions avec des personnes d'autres régions. « Plus largement, les sources de données pour l'IA peuvent engendrer des injustices entre les sexes et certains groupes sociaux, comme les personnes en situation de handicap », a-t-il ajouté. Par conséquent, pour un développement équitable de l'IA, la participation d'experts juridiques, de psychologues et de sociologues est également nécessaire.

En outre, le représentant du ministère a également souligné certains principes importants de l'éthique de l'IA, tels que la garantie de la sécurité des données personnelles, le respect des droits d'auteur et des droits de propriété intellectuelle, l'amélioration de la productivité du travail, mais aussi la nécessité de protéger l'environnement et la sécurité sociale.

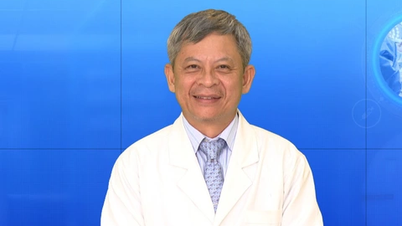

Le vice-ministre Bui The Duy prend la parole lors de l'atelier. Photo : Hoang Giang

Lors de cet atelier, des experts ont indiqué que le Vietnam surveille la mise en œuvre des réglementations relatives au développement responsable de l'IA dans de nombreux pays et régions du monde, afin de rechercher et de construire un cadre juridique adapté aux pratiques nationales.

Plus précisément, fin 2023, l'Union européenne a approuvé les principes de la loi sur l'IA, dont la publication est prévue au plus tard au deuxième trimestre 2024. Il s'agit actuellement de la première et de la plus complète loi en la matière, comportant de nombreuses initiatives visant à gérer les risques liés à l'IA.

« La loi sur l'IA de 2024 s'appuiera sur les risques liés aux modèles d'IA afin d'adapter la législation en conséquence, tout en intégrant un cadre de test et une approche plus souple en matière d'éthique, de fiabilité et de responsabilité », a déclaré le Dr Do Giang Nam, de la faculté de droit de l'Université nationale du Vietnam, lors de l'atelier. Selon lui, l'expérience vietnamienne en matière de loi sur l'IA montre qu'il ne faut pas élaborer une loi définitive, mais la mettre à jour et l'adapter en permanence à l'évolution des technologies d'IA.

Contrairement à l'Europe, les États-Unis se tournent vers le secteur privé pour définir la gouvernance de l'IA. Ils sont également le pays qui enregistre le plus grand nombre de poursuites contre des entreprises d'IA, principalement pour des violations de la vie privée et des discriminations entre groupes de travailleurs. Selon les experts, plutôt qu'un ensemble de lois fixes, les États-Unis privilégient l'adoption de nombreux principes afin de permettre aux organisations et aux individus d'adopter une approche flexible dans le développement et l'application des modèles d'IA.

La Chine et le Japon sont deux pays qui ont réalisé des progrès considérables dans le développement d'une IA responsable. Depuis 2019, la Chine, pays d'un milliard d'habitants, a édicté quatre principes directeurs axés sur les modélisateurs, les utilisateurs, la gouvernance de l'IA et les orientations futures de son développement. Ainsi, la Chine a choisi de développer l'IA de manière autonome et de promouvoir une gouvernance nationale, tandis que le Japon vise un code de conduite de l'IA centré sur l'humain, tout en veillant à participer aux instances internationales.

« L’expérience de la gestion de l’intelligence artificielle dans des pays de la même région que la Chine et le Japon peut servir de modèle pour un développement responsable de l’IA au Vietnam. Au-delà de la légalité, cette responsabilité s’étend également à la société et aux citoyens », a déclaré la professeure agrégée Nguyen Thi Que Anh, doyenne de la Faculté de droit de l’Université nationale du Vietnam (VNU). Par ailleurs, le Vietnam élabore actuellement une loi sur l’industrie des technologies numériques, qui intègre des dispositions relatives à l’éthique des produits numériques, notamment l’intelligence artificielle.

Hoang Giang

Lien source

![[Photo] Art unique de la peinture des masques Tuong](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763094089301_ndo_br_1-jpg.webp)

![[Photo] Architecture unique de la station de métro la plus profonde de France](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763107592365_ga-sau-nhat-nuoc-phap-duy-1-6403-jpg.webp)

![[Photo] Cours spécial à Tra Linh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763078485441_ndo_br_lop-hoc-7-jpg.webp)

Comment (0)