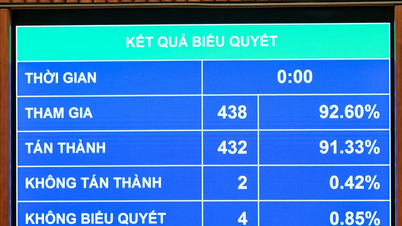

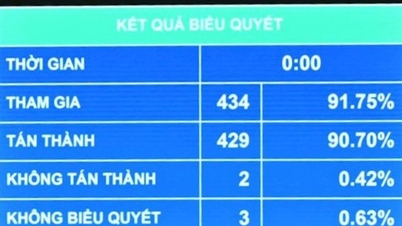

אחר הצהריים של ה-10 בדצמבר, אישרה האסיפה הלאומית את החוק בנושא בינה מלאכותית, כאשר 429 מתוך 434 נציגים שהשתתפו בו הצביעו בעד (שווה ערך ל-90.7% מכלל נציגי האסיפה הלאומית).

חוק הבינה המלאכותית כולל 8 פרקים ו-35 סעיפים, המסדירים את המחקר, הפיתוח, האספקה, הפריסה והשימוש במערכות בינה מלאכותית; את הזכויות והחובות של ארגונים ויחידים רלוונטיים; ואת ניהול פעילויות הבינה המלאכותית בווייטנאם על ידי המדינה. פעילויות בינה מלאכותית המיועדות אך ורק למטרות הגנה, ביטחון וקריפטוגרפיה לאומית אינן מכוסות על ידי חוק זה.

4 עקרונות יסוד בפעולות בינה מלאכותית

על פי החוק שאושר לאחרונה על ידי האסיפה הלאומית, פעילויות בינה מלאכותית חייבות להבטיח עמידה בארבעה עקרונות בסיסיים, ביניהם:

הצבת האדם במרכז, הבטחת זכויות אדם, זכויות פרטיות, אינטרסים לאומיים, אינטרסים ציבוריים וביטחון לאומי; שמירה על החוקה והחוקים.

בינה מלאכותית משרתת את האנושות, לא מחליפה את הסמכות והאחריות האנושית. היא מבטיחה את שמירת השליטה האנושית ואת היכולת להתערב בכל ההחלטות וההתנהגויות של מערכת הבינה המלאכותית; אבטחת המערכת, אבטחת הנתונים וסודיות המידע; ואת היכולת לבדוק ולנטר את התפתחות המערכת ותפעולה.

הבטחת הוגנות, שקיפות, אובייקטיביות, אי אפליה ואי פגיעה ביחידים או בחברה; דבקות בסטנדרטים אתיים וערכים תרבותיים וייטנאמיים; ולקחת אחריות על החלטות המערכת והשלכותיה.

קידום פיתוח של בינה מלאכותית ירוקה, מכילה ובת קיימא; עידוד פיתוח ויישום של טכנולוגיות בינה מלאכותית שהן יעילות באנרגיה, חוסכות משאבים ומפחיתות השפעות שליליות על הסביבה.

סיווג וניהול מערכות בינה מלאכותית על סמך סיכון.

חוק הבינה המלאכותית קובע את סיווג וניהול מערכות בינה מלאכותית לפי שלוש רמות סיכון: גבוהה, בינונית ונמוכה.

מערכות בינה מלאכותית בסיכון גבוה הן מערכות שעלולות לגרום נזק משמעותי לחייהם, לבריאותם, לזכויותיהם ולאינטרסים הלגיטימיים של ארגונים ויחידים, לאינטרסים לאומיים, לאינטרסים הציבוריים ולביטחון הלאומי;

מערכת בינה מלאכותית בסיכון בינוני היא מערכת שיש לה פוטנציאל לבלבל, להשפיע או לתמרן משתמשים משום שהם אינם מסוגלים לזהות שהישות המקיימה אינטראקציה היא מערכת בינה מלאכותית או את התוכן שהיא מייצרת;

מערכות הבינה המלאכותית הנותרות הן אלו בעלות סיכון נמוך.

סיווג הסיכון של מערכות בינה מלאכותית נקבע על סמך קריטריונים כגון רמת ההשפעה על זכויות אדם, בטיחות ואבטחה; תחום השימוש של המערכת, ובמיוחד תחומים חיוניים או כאלה הקשורים ישירות לאינטרס הציבורי; היקף המשתמשים; והיקף השפעת המערכת.

התנהגויות אסורות בפעולות בינה מלאכותית

חוק הבינה המלאכותית קובע גם פעולות אסורות בפעילויות בינה מלאכותית, ובפרט:

ניצול או חטיפה של מערכות בינה מלאכותית לביצוע מעשים בלתי חוקיים ופגיעה בזכויות ובאינטרסים הלגיטימיים של ארגונים ויחידים.

פיתוח, אספקה, פריסה או שימוש במערכות בינה מלאכותית למטרות: ביצוע מעשים האסורים על פי חוק; שימוש באנשים או אירועים אמיתיים מזויפים או מדומים כדי להונות או לתמרן תפיסה והתנהגות אנושית באופן מכוון ושיטתי, תוך גרימת פגיעה חמורה בזכויות אדם ובאינטרסים לגיטימיים; ניצול חולשות של קבוצות פגיעות, כולל ילדים, קשישים, אנשים עם מוגבלויות, מיעוטים אתניים, או אנשים עם יכולת אזרחית לקויה או מוגבלת, או כאלה עם קשיים קוגניטיביים או בעיות שליטה התנהגותית, כדי לפגוע בעצמם או באחרים; יצירה או הפצה של תוכן מזויף העלול לסכן באופן חמור את הביטחון הלאומי, הסדר הציבורי והביטחון החברתי.

איסוף, עיבוד או שימוש בנתונים לפיתוח, אימון, בדיקה או הפעלה של מערכות בינה מלאכותית תוך הפרת חוקים בנושא נתונים, הגנת מידע אישי, קניין רוחני ואבטחת סייבר.

חסימה, השבתה או עיוות של המנגנונים האנושיים לניטור, התערבות ובקרה של מערכות בינה מלאכותית כפי שנקבע בחוק זה.

הסתרת מידע שיש לחשוף, לפרסם או להסביר; מחיקה או זיוף של מידע חובה, תוויות או אזהרות בפעולות בינה מלאכותית.

ניצול פעילויות מחקר, בדיקה, הערכה או אימות הקשורות למערכות בינה מלאכותית לצורך ביצוע פעולות המפרות את החוק.

מקור: https://nhandan.vn/cam-su-dung-he-thong-ai-tao-noi-dung-gia-mao-gay-nguy-hai-an-ninh-quoc-gia-post929261.html

![[תמונה] גלו את ספינת המלחמה USS רוברט סמולס של חיל הים האמריקאי](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F10%2F1765341533272_11212121-8303-jpg.webp&w=3840&q=75)

![[וידאו] תלמידים יקבלו ספרי לימוד בחינם החל משנת 2026](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/10/1765367941271_2-2309-6672-png.webp)

![[וידאו] האסיפה הלאומית אישרה חוק עיתונות מתוקן](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/10/1765367644050_3-5702-2273-png.webp)

![[וידאו] אומנות יצירת ציורי העם דונג הו נכללה על ידי אונסק"ו ברשימת המלאכות הזקוקות להגנה דחופה.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/10/1765350246533_tranh-dong-ho-734-jpg.webp)

תגובה (0)