מדוע שיחות ChatGPT מופיעות בגוגל ובמנועי חיפוש אחרים באינטרנט?

כפי שדיווח דן טרי , סדרת שיחות בין משתמשים לבין ChatGPT הופיעה לפתע בפומבי בתוצאות החיפוש של גוגל ובמנועי חיפוש אחרים באינטרנט.

הסיבה לכך היא של-ChatGPT יש תכונה פחות מוכרת המאפשרת למשתמשים ליצור קישור כדי לשתף את תוכן השיחה שלהם ב-ChatGPT עם אדם אחר או לשתף תוכן זה ברשתות חברתיות.

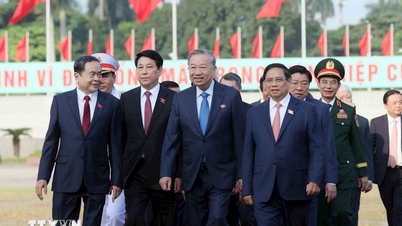

משתמשים יכולים ללחוץ על כפתור "שתף" ב-ChatGPT כדי לשתף את תוכן השיחה (צילום מסך).

אנשים שאיתם משותפים את הנתונים צריכים רק ללחוץ על קישור זה כדי לראות את כל השיחה בין המשתמש ל-ChatGPT, להבין טוב יותר את יכולות ChatGPT, וכן לדעת כיצד ChatGPT מגיב לבעיה מסוימת.

עם זאת, כאשר תלחץ על כפתור השיתוף הזה, גוגל גם תאנדקס את קישור האתר המכיל את תוכן הצ'אט ב-ChatGPT. משמעות הדבר היא שתוכן הצ'אט יהיה ציבורי וניתן לחיפוש בגוגל.

למעשה, אנשים רבים פשוט רוצים לשתף את תוכן השיחות שלהם ואת ChatGPT עם כמה מכרים או לשתף אותו ברשתות חברתיות למטרה כלשהי, אך כמעט ואין להם כוונה לפרסם את תוכן השיחה בגוגל ובמנועי חיפוש מקוונים.

OpenAI עובדת עם גוגל ומנועי חיפוש מקוונים אחרים כדי להסיר את האינדוקס של אלפי שיחות בין משתמשים לבין ChatGPT באינטרנט.

אם מעולם לא יצרת קישור לשיתוף תוכן הצ'אט שלך עם ChatGPT, אל תדאג בקשר לזה.

האם זה מדאיג אם תוכן שיחות ה-ChatGPT שלי מתפרסם באינטרנט?

למרבה המזל, ChatGPT לא מתייג משתמשים ספציפיים בצ'אט, כלומר אם תוכן הצ'אט ידלף, גורמים חיצוניים לא יוכלו לדעת מי מנהל את השיחה הזו עם ChatGPT.

עם זאת, אם משתמשים משתפים מידע פרטי ואישי כגון שם מלא, כתובת מגורים, דוא"ל, פרטי עבודה או אפילו מספר זיהוי אישי, חשבון בנק... אזי מידע זה עלול להשתלט לחלוטין על ידי אנשים רעים.

הסיכונים של הפיכת שיחות ChatGPT לציבוריות

- דליפת מידע אישי: משתמשים רבים משתפים בגלוי את המידע האישי והפרטי שלהם עם ChatGPT, מבלי לדעת שמידע זה עלול לדלוף, מה שמוביל לסיכון של גניבת מידע וניצול על ידי גורמים פושעים.

- נזק למוניטין: מידע אישי ופרטי, הקשור לתוכן השיחה עם ChatGPT, יכול להשפיע על המוניטין של אדם אם השיחה מכילה תוכן פרטי ורגיש.

- דליפת נתונים מקצועיים ונתונים תעסוקתיים: אם ChatGPT משמש להתייעצות בנוגע לעבודה, פרויקטים או קמפיינים מתוכננים והשיחה דולפה, סודות החברה יושפעו.

לעולם אל תשתפו מידע אישי, פרטי וחשוב בצ'אטים עם ChatGPT (איור: Getty).

הערות לשימוש בטוח יותר ב-ChatGPT

בעקבות אירוע זה, נושא אחד שיש להתייחס אליו הוא השימוש הבטוח ב-ChatGPT בפרט ובכלי בינה מלאכותית באופן כללי. מומחים נתנו כמה עצות כיצד לעשות זאת:

- אין לשתף מידע רגיש ופרטי בכל שיחה עם אף כלי בינה מלאכותית, לא רק עם ChatGPT.

- אל תלחץ על הכפתור כדי לשתף את תוכן השיחה עם ChatGPT, אלא אם כן זה הכרחי לחלוטין. אם ברצונך לשתף, אנא בדוק את תוכן השיחה בקפידה כדי לוודא שאין בו מידע אישי ופרטי.

- כשרוצים לשתף את תוכן השיחה, כדאי לצלם רק צילום מסך, במקום ליצור קישור לגישה ישירה לשיחה. כשאתם מצלמים צילום מסך, זכרו לכסות את התוכן והמידע הפרטי בשיחה.

תמיד היו זהירים בעת שימוש בכלי צ'אטבוטים מבוססי בינה מלאכותית (איור: פינטרסט).

התקרית עם ChatGPT נחשבת לאזהרה לקהילת המשתמשים, לא לסמוך יותר מדי על כלי בינה מלאכותית כדי לשתף את כל המידע הפרטי והאישי. גם כשאנו משתמשים יותר ויותר בכלי בינה מלאכותית לעבודה, לימודים או מחקר, עלינו תמיד להיות זהירים וערניים עם כלים אלה.

מקור: https://dantri.com.vn/cong-nghe/noi-dung-tro-chuyen-voi-chatgpt-bi-cong-khai-tren-mang-co-dang-lo-ngai-20250804164714417.htm

![[תמונה] "בית קברות לאוניות" במפרץ שואן דאי](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/08/1762577162805_ndo_br_tb5-jpg.webp)

![[וידאו] אנדרטאות הואה נפתחות מחדש לקבלת מבקרים](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

תגובה (0)