דו"ח אוקטובר של OpenAI מצא כי גורמי סייבר ברחבי העולם משלבים בעיקר בינה מלאכותית (AI) בצינורות תקיפה קיימים כדי לשפר את הביצועים, במקום לפתח כלי או שיטות תקיפה חדשים לחלוטין.

לפי OpenAI, חלק ניכר מהפעילות שזוהתה כלל שימוש בבינה מלאכותית כדי לסייע במשימות מוכרות כמו פיתוח תוכנות זדוניות, בניית תשתית בקרה, יצירת הודעות דוא"ל פישינג מתוחכמות יותר ואיסוף מידע על מטרות.

"הצוותים החסומים שילבו בעיקר בינה מלאכותית בתהליכים קיימים, במקום לבנות תהליכים חדשים המבוססים על בינה מלאכותית", נכתב בדו"ח.

הדו"ח מצא גם כי קבוצות משתמשים רבות מינפו מודלים של שפה גדולה (LLM) כדי לכרות ידע במגוון תחומים טכניים, החל מפיתוח יישומים ועד תצורת מערכות רשת, לעתים קרובות באופן שמייצב כל חשבון למשימה ספציפית.

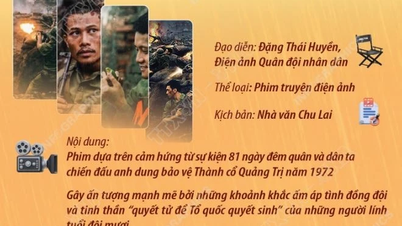

מספר רשתות משתמשים נוספות זוהו כמשתמשות בפלטפורמות בינה מלאכותית כדי ליצור תוכן מקוון, כולל מאמרים, תמונות וסרטונים , כדי לשרת קמפיינים תקשורתיים או לקדם נקודות מבט מסוימות. עם זאת, רוב החשבונות הללו אינם יעילים, עם רמות מעורבות נמוכות מאוד.

בנוסף, OpenAI תיעדה גם את התופעה של מרכזי הונאה ופושעי סייבר המשתמשים ב-ChatGPT כדי לתמוך בפעילויות הונאה מקוונות במיאנמר ובקמבודיה. מקרים מסוימים מראים כי בינה מלאכותית משמשת לא רק לעריכת תוכן, אלא גם לניהול לוחות זמנים של עבודה, משאבי אנוש ופיננסים.

עם זאת, OpenAI מציינת כי בינה מלאכותית נמצאת בשימוש פעיל גם למניעת הונאות. ההערכה היא ש-ChatGPT משמש פי שלושה יותר לזיהוי והימנעות מהונאות מאשר לביצוע הונאה.

רוב הבקשות הזדוניות נדחות על ידי המערכת, אך הדו"ח מציין כי עדיין קיים "תחום אפור" שבו בקשות טכניות או מבוססות מחקר עלולות להיות מנוצלות למטרות לא מכוונות.

עם זאת, OpenAI טוענת שהקוד או התוכן שנוצרו אינם זדוניים עד שהם מנוצלים לרעה מחוץ לפלטפורמה.

(TTXVN/וייטנאם+)

מקור: https://www.vietnamplus.vn/openai-canh-bao-tin-tac-loi-dung-ai-de-hoat-dong-tinh-vi-hon-post1068941.vnp

תגובה (0)