テクノロジー大手は、エネルギー効率の高い最新のAIモデルに注目している

近年、人工知能(AI)業界は「大きいほど良い」という原則、つまりデータ、パラメータ、計算量の増加を優先してきました。しかし、Google、MIT、スタンフォード大学による新たな研究は、全く異なる方向性を示しています。

最新のモデルは、より少ないデータ量で効率的に学習でき、消費電力も抑えながら、高いパフォーマンスを実現できます。これにより、学習コストと時間が削減されるだけでなく、これまで大規模なテクノロジーへのアクセスが困難だった小規模な研究チームや中規模企業にもAIアプリケーションを活用できるようになります。

技術の進歩により、AIは「小型だが強力」になる

Tuoi Tre Online の調査によると、広告処理テストでは、Google はトレーニング データを 10 万サンプルから 500 サンプル未満に削減しながら、専門家との互換性を 65% 向上させました。

同時に、データ効率の高いトレーニングに関する包括的な調査では、単にデータ数を増やすのではなく、「データの品質、スマート サンプリング、および「蒸留」手法がパフォーマンスを決定する」ことが示されています。

理論上は、「スケーリングの法則」により、モデルのパラメータ、データ、コンピューティング能力を増やすことで効果が得られるとされていますが、Meta の AI ディレクターである Yann LeCun 氏のような専門家は、「データとコンピューティング能力を増やすだけでは、AI を自動的に賢くすることはできません」と強調しています。

つまり、研究チームは、数百万から数十億のサンプルを構築してラベル付けする代わりに、データを再利用し、合成データを作成し、より小さなモデルを使用し、エネルギーとデータ効率の高いアルゴリズムに重点を置くことを目指しています。

例えば、「知識蒸留」という手法により、「教師」(大規模な教師モデル)から「生徒」(コンパクトな生徒モデル)へと知識を移転しながらも、多くの機能を維持することができます。スタンフォードHAIの研究者たちは、この傾向は計算コスト効率と環境負荷の両方に優れており、小規模な研究グループや中小企業がAIを効果的に適用する機会を広げると強調しています。

これらの進歩により、AI モデルは、より少ないデータを使用し、より高速に実行し、より少ない電力消費でコストを削減し、持続可能性を高め、リソースが限られた環境にアプリケーションを拡張して、インテリジェントな最適化に移行し、より速く学習し、より少ないリソース消費で、品質を確保できるようになります。

データ効率の高いAIトレーニングの実践的な応用と課題

実際、より少ないデータとパワーでAIを学習させることは、幅広い影響をもたらします。中小企業や発展途上国の研究チームにとって、「数百万のサンプルと巨大なサーバーを使う」ことは現実的ではありません。数千のサンプルと一般的なコンピューターでモデルを学習できるようになれば、AIアプリケーションはエンドユーザーや実環境にさらに近づくでしょう。

たとえば、広告モデレーション ダイアログでは、Google はデータの「価値のある」サンプルを選択する方が、数十万のランダム サンプルを選択するよりも優れていることを実証しています。これにより、必要なデータ量を削減しながら、成果を上げることができます。

しかし、課題は依然として残っています。データが少ない場合、モデルは過剰適合しやすく、汎化が不十分で、環境の変化への対応が困難になります。視覚転移学習に関する研究では、入力データが非常に限られている場合は蒸留法の方が効果的ですが、データが十分に大きい場合は従来の手法が依然として優れていることが示されています。

電力消費とコストの点では、データを削減することは計算、サーバー、電力の削減も意味します。これは、トレーニングごとに数百万ドルのコストがかかる大規模 AI モデル (LLM) のコンテキストでは重要です。

スタンフォードHAIのレポートによると、データとエネルギーを節約するAIのトレンドは、2025年の「大きな変革」として考えられています。

したがって、ジャーナリストや一般読者にとって注目すべきは、AI がもはや「テクノロジーの巨人」だけのものではなく、より少ないデータと低コストで小規模なチームによって作成できるようになると、中小企業の管理、地域医療アプリケーション、パーソナライズされた学習に至るまで、多くの新しいアプリケーションが登場するだろうということです。

しかし、ユーザーは、「データ」モデルは適切に管理されていない場合、精度が低下し、バイアスの影響を受けやすくなることにも注意する必要があります。

出典: https://tuoitre.vn/ai-khong-con-can-du-lieu-khong-lo-cuoc-dua-huan-luyen-ai-tiet-kiem-nang-luong-20251031115025169.htm

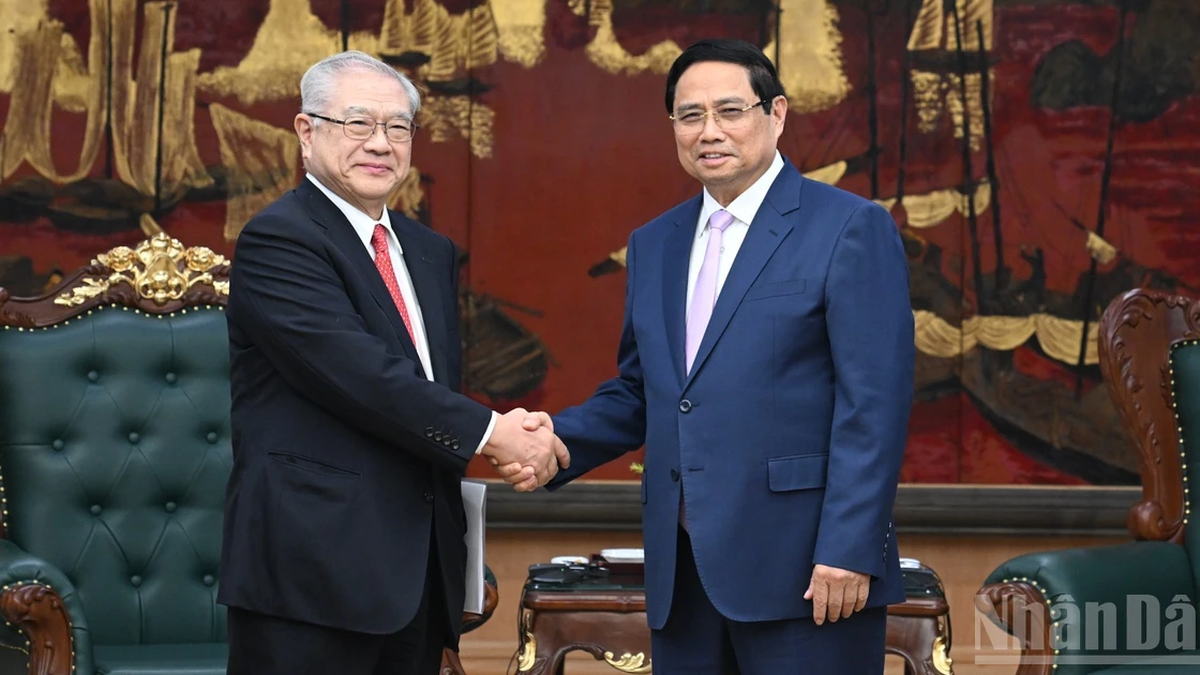

![[写真] ト・ラム事務総長がシンガポールのジャヤ・ラトナム大使を接見](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

コメント (0)