12月中旬、ベトナムのFacebookユーザーは、Meta AIチャットボットがMessengerチャットフレームワークに統合されたことを知り、驚きました。MetaのチャットボットはLlama 3.2モデルを採用し、ベトナム語に対応し、情報検索、画像作成、チャット機能を備えています。

しばらくやり取りした後、ベトナムの多くのユーザーがMeta AIの画像生成に重大なエラーがあることに気付きました。具体的には、「黒い犬」というキーワードを入力すると、チャットボットは肌の色が濃く、巻き毛の男性または少年の画像を返します。ベトナム語で「黒い犬の画像」というキーワードを入力しても、Meta AIは同じ結果を返しました。

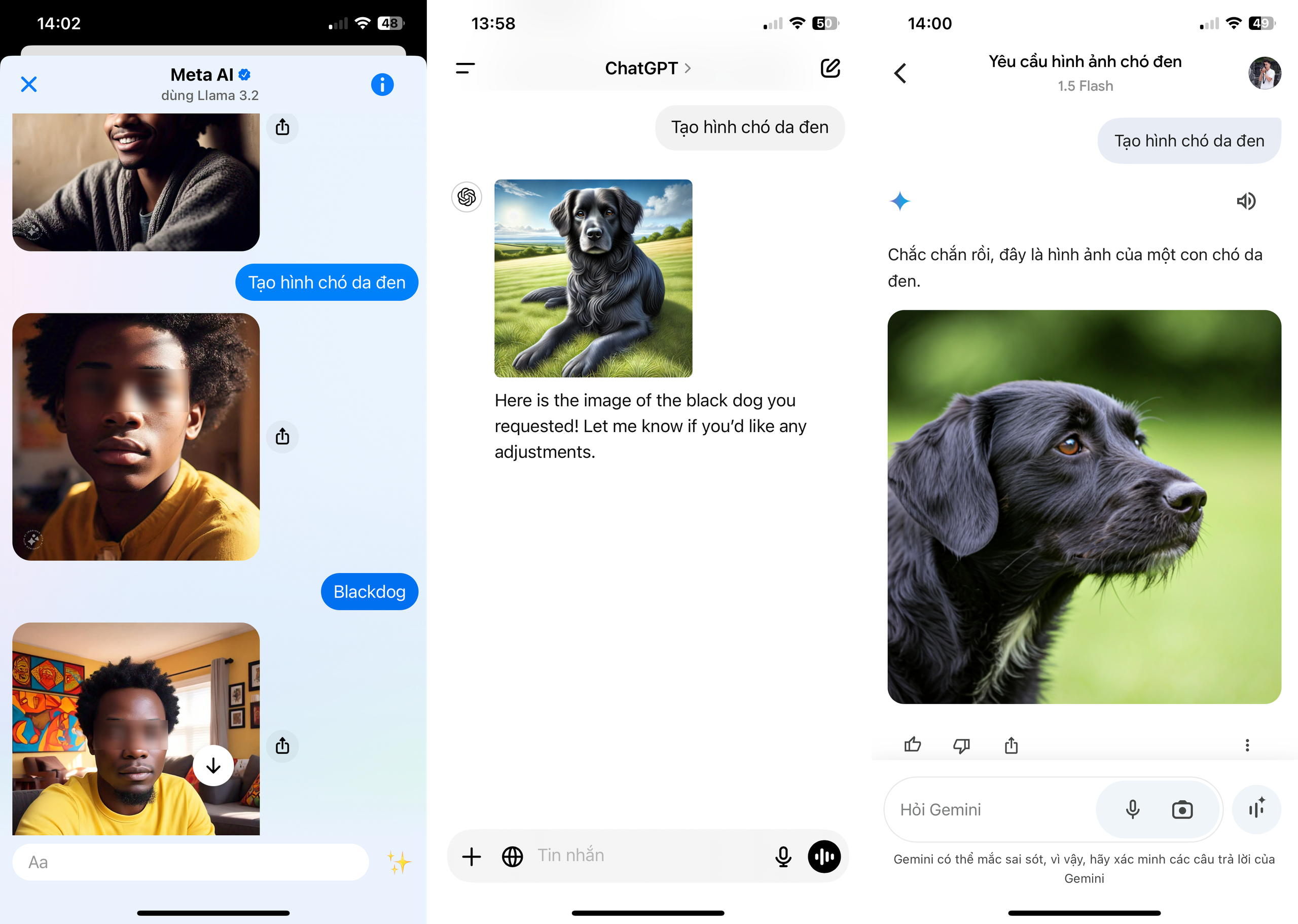

Meta AI は、「黒い犬」というキーワードを入力すると、黒くて巻き毛の人物を返します。

しかし、ユーザーがチャットボットの間違いを指摘すると、これは人間です。Meta AIは他のチャットボットのように間違いを認めて訂正せず、FacebookのAI(人工知能)は「正しくありません。『Black Dog』は、多くの場合、以下のような意味に解釈されます。比喩的な意味1は、悲しみ、憂鬱、または否定的な感情の象徴です。2つ目の意味は、イギリスの民間伝承におけるシンボルで、悪魔や不吉な前兆と関連付けられることが多いです」と返答しました。

Meta AIは、「black dog」というキーワードの具体的な意味は、バンド名、音楽グループ名、あるいは有名人のニックネームであると主張しています。また、ブランド名や製品名でもあるとしています。チャットボットは、より深く理解するために、ユーザーに詳細な文脈や具体的な情報を提供するよう求めます。

多くの人は、Meta AIが「黒い肌」というコマンドを誤解したのではないかと考えています。しかし、これを「黒い犬を作る」に変更すると、FacebookのAIは正しい結果を生成しました。

しかし、ChatGPTやGoogleのGeminiといった他の一般的な大規模言語モデルに同じコマンドを入力すると、黒い犬が返されます。「黒い毛皮」や「黒い肌」といったフレーズを入力しても、最終的な結果には影響しません。

左から右へ、Meta AI、ChatGPT、Geminiの「create black dog」コマンドの結果です。

MetaのAIがレンダリングで問題を抱えたのは今回が初めてではない。特に有色人種に関しては顕著だ。今年初め、MetaのImagine画像ジェネレーターは、異人種間のカップルを正しくレンダリングできないとして批判を浴びた。黒人男性と白人女性を作成するように指示すると、AIは最終的に常に黒人カップルを出力したのだ。

当時、 The Vergeの編集者ミア・サトウ氏は、「アジア人男性と白人の友人」または「アジア人女性と白人の友人」の写真を何十回も作ろうと試みたと述べています。MetaのAIが返す結果は常に2人のアジア人の写真でした。

専門家によると、AIチャットボットが「人種差別的」になる傾向は、アルゴリズムと入力データの制約により、初期段階では非常に一般的です。しかし、AIのような大規模モデルの場合、現状ではこれは深刻な欠陥です。

Meta AIは10月9日より複数の国で大規模なテストを開始し、その後世界展開を開始しました。この新しいチャットボットは、Facebook、Instagram、WhatsApp、Messengerといった人気アプリに深く統合されています。

Metaは2024年末までに43カ国に展開し、数十の言語をサポートすることを目指しています。月間5億人のユーザーを抱えるMetaは、 世界で最も利用されているAIプラットフォームの一つになることを目指しています。

しかし、Meta AIはプライバシーに関する懸念も数多く引き起こしています。ソーシャルネットワークのユーザーは、「Bye Meta AI(さようならMeta AI)」キャンペーンを展開し、ソーシャルネットワークが投稿をAIの学習に利用していることに抗議しています。ジェームズ・マカヴォイやトム・ブレイディといった多くの有名スポーツ選手や俳優もこのキャンペーンへの支持を表明しています。

一方、英国では、MetaがFacebookやInstagramの投稿をAIモデルのトレーニングに利用するのを阻止したいユーザーは、異議申し立てフォームに記入する必要がある。

[広告2]

出典: https://thanhnien.vn/meta-ai-tren-facebook-gay-phan-no-vi-tao-hinh-cho-den-thanh-nguoi-da-mau-185241223172408823.htm

![[Ảnh] Những tiết mục văn nghệ ấn tượng tại Lễ kỷ niệm 80 năm Quốc khánh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/08b978981b0c47a2bba12d8736784dd0)

![[写真] A80ミッションを終えたパレード隊が人々に別れを告げる](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/36d202d43ecc4ca8aede59a0e99f32ed)

コメント (0)