Deepfakes គឺជា វីដេអូ និងរូបភាពដែលត្រូវបានបង្កើត ឬផ្លាស់ប្តូរជាឌីជីថលដោយប្រើបញ្ញាសិប្បនិម្មិត (AI) ឬ machine learning (ML)។ មាតិកាអាសអាភាសដែលបង្កើតឡើងដោយប្រើបច្ចេកវិទ្យានេះដំបូងបានចាប់ផ្តើមចរាចរនៅលើអ៊ីនធឺណិតកាលពីប៉ុន្មានឆ្នាំមុន នៅពេលដែលអ្នកប្រើប្រាស់ Reddit ចែករំលែកឈុតអាសអាភាសក្លែងក្លាយដែលមានមុខតារាល្បីៗ។

រូបថត៖ ជីអាយ

នរណាម្នាក់អាចក្លាយជាជនរងគ្រោះ។

ចាប់តាំងពីពេលនោះមក អ្នកបង្កើត Deepfake បានបន្តបង្ហោះវីដេអូ និងរូបភាពស្រដៀងគ្នាដែលកំណត់គោលដៅលើអ្នកមានឥទ្ធិពលលើអ៊ីនធឺណិត អ្នកកាសែត និងអ្នកផ្សេងទៀតដែលមានប្រវត្តិរូបសាធារណៈ។ វីដេអូបែបនេះរាប់ពាន់មាននៅលើគេហទំព័រជាច្រើន។

ជាមួយនឹងបច្ចេកវិទ្យា AI កាន់តែអាចចូលដំណើរការបាន នេះអនុញ្ញាតឱ្យអ្នកប្រើប្រាស់ប្រែក្លាយនរណាម្នាក់ដែលពួកគេចង់បានទៅជា "តារាភាពយន្តអាសអាភាស" ដោយគ្មានការយល់ព្រមពីពួកគេ ឬកាន់តែគ្រោះថ្នាក់ ប្រើបច្ចេកវិទ្យានេះដើម្បីបង្ខូចកេរ្តិ៍ឈ្មោះ ឬបង្ខូចកេរ្តិ៍អ្នកដទៃ។

អ្នកជំនាញនិយាយថា បញ្ហានេះអាចកាន់តែអាក្រក់ទៅៗជាមួយនឹងការអភិវឌ្ឍន៍ឧបករណ៍ AI ទូទៅដែលត្រូវបានបណ្តុះបណ្តាលលើរូបភាពរាប់ពាន់លានពីអ៊ីនធឺណិត និងបង្កើតមាតិកាថ្មីដោយប្រើទិន្នន័យដែលមានស្រាប់។

លោក Adam Dodge ស្ថាបនិក EndTAB ដែលជាក្រុមដែលផ្តល់ការបណ្តុះបណ្តាលស្តីពីការរំលោភបំពានបច្ចេកវិទ្យាបាននិយាយថា "ការពិតគឺថាបច្ចេកវិទ្យានឹងបន្តរីកដុះដាល នឹងបន្តវិវឌ្ឍ ហើយនឹងបន្តកាន់តែងាយស្រួល និងអាចប្រើប្រាស់បាន"។ «ហើយដរាបណាវានៅតែបន្ត មនុស្សនឹង... បន្តបំពានបច្ចេកវិទ្យានោះ ដើម្បីបង្កគ្រោះថ្នាក់ដល់អ្នកដទៃ ជាចម្បងតាមរយៈអំពើហិង្សាផ្លូវភេទតាមអ៊ីនធឺណិត រូបអាសអាភាសក្លែងក្លាយ និងរូបអាក្រាតក្លែងក្លាយ។

Noelle Martin មកពីទីក្រុង Perth ប្រទេសអូស្ត្រាលី បានទទួលបទពិសោធន៍នេះដោយផ្ទាល់។ នារីអាយុ 28 ឆ្នាំបានរកឃើញរូបភាពអាសអាភាសក្លែងក្លាយរបស់នាងកាលពី 10 ឆ្នាំមុន នៅពេលដែលនាងប្រើ Google ដើម្បីស្វែងរករូបភាពរបស់នាង។ រហូតមកដល់សព្វថ្ងៃនេះ Martin និយាយថា នាងមិនដឹងថានរណាជាអ្នកបង្កើតរូបភាព ឬវីដេអូអាសអាភាសក្លែងក្លាយនេះទេ។ នាងសង្ស័យថាមាននរណាម្នាក់បានប្រើរូបភាពពីបណ្តាញសង្គមរបស់នាងដើម្បីបង្កើតវីដេអូអាសអាភាស។

ទោះបីជាមានការព្យាយាមរបស់ Martin ក្នុងការទាក់ទងគេហទំព័រដើម្បីលុបវីដេអូក៏ដោយ ប៉ុន្តែការប្រឹងប្រែងរបស់នាងគឺឥតប្រយោជន៍ទេ។ អ្នកខ្លះមិនបានឆ្លើយតបទេ។ អ្នកផ្សេងទៀតបានយកវាចុះ ប៉ុន្តែបានបង្ហោះពួកវាឡើងវិញយ៉ាងឆាប់រហ័ស។ Martin បាននិយាយថា "អ្នកមិនអាចឈ្នះបានទេ។ "វានឹងស្ថិតនៅលើអ៊ីនធឺណិតជារៀងរហូត ហើយអាចបំផ្លាញជីវិតរបស់អ្នក"។

កិច្ចខិតខំប្រឹងប្រែងរបស់ក្រុមហ៊ុនបច្ចេកវិទ្យាដើម្បីកែតម្រូវស្ថានភាព។

ម៉ូដែល AI មួយចំនួនបានបង្ហាញថាពួកគេបានរឹតបន្តឹងការចូលប្រើរូបភាពអាសអាភាស។

OpenAI និយាយថា ខ្លួនបានលុបមាតិកាអាសអាភាសចេញពីទិន្នន័យដែលប្រើដើម្បីបណ្តុះបណ្តាលឧបករណ៍បង្កើតរូបភាព DALL-E ដែលនឹងកំណត់សក្តានុពលសម្រាប់ការប្រើប្រាស់ខុស។ ក្រុមហ៊ុនក៏បានត្រងសំណើ និងនិយាយថាខ្លួនរារាំងអ្នកប្រើប្រាស់ពីការបង្កើតរូបភាព AI របស់តារាល្បី និង អ្នកនយោបាយ លេចធ្លោ។ Midjourney ដែលជាគំរូមួយផ្សេងទៀតក៏រារាំងការប្រើប្រាស់ពាក្យគន្លឹះជាក់លាក់ និងលើកទឹកចិត្តអ្នកប្រើប្រាស់ឱ្យដាក់ទង់រូបភាពដែលមានបញ្ហាសម្រាប់អ្នកសម្របសម្រួល។

ទន្ទឹមនឹងនោះ Stability AI ក៏បានបញ្ចេញការអាប់ដេតដើម្បីការពារអ្នកប្រើប្រាស់ពីការបង្កើតរូបភាពរសើប។ ការផ្លាស់ប្តូរទាំងនេះកើតឡើងបន្ទាប់ពីមានរបាយការណ៍ថាអ្នកប្រើប្រាស់មួយចំនួនកំពុងបង្កើតរូបថតអាក្រាតកាយដែលបំផុសគំនិតដោយតារាល្បីដោយប្រើបច្ចេកវិទ្យា។

អ្នកនាំពាក្យស្ថេរភាព AI លោក Motez Bishara បាននិយាយថា តម្រងនេះប្រើការរួមបញ្ចូលគ្នានៃពាក្យគន្លឹះ និងបច្ចេកទេសផ្សេងទៀត ដូចជាការទទួលស្គាល់រូបភាព ដើម្បីរកមើលភាពអាក្រាត។ ប៉ុន្តែអ្នកប្រើប្រាស់ អាចរៀបចំ កម្មវិធី និងបង្កើតអ្វីក៏ដោយដែលពួកគេចង់បាន ដោយសារតែក្រុមហ៊ុនបានបញ្ចេញកូដប្រភពបើកចំហសម្រាប់កម្មវិធី។

ក្រុមហ៊ុនប្រព័ន្ធផ្សព្វផ្សាយសង្គមមួយចំនួនក៏បានរឹតបន្តឹងច្បាប់របស់ពួកគេផងដែរ ដើម្បីការពារវេទិការបស់ពួកគេឱ្យកាន់តែប្រសើរឡើងពីសម្ភារៈដែលបង្កគ្រោះថ្នាក់។

កាលពីខែមុន TikTok បាននិយាយថា រាល់ខ្លឹមសារដែលក្លែងបន្លំ ឬក្លែងបន្លំទាំងអស់ត្រូវតែដាក់ស្លាកដើម្បីបង្ហាញថាវាក្លែងក្លាយ ឬត្រូវបានផ្លាស់ប្តូរតាមមធ្យោបាយណាមួយ។

វេទិកាហ្គេម Twitch ថ្មីៗនេះបានធ្វើបច្ចុប្បន្នភាពគោលការណ៍របស់ខ្លួនលើរូបភាពក្លែងក្លាយ បន្ទាប់ពីអ្នកផ្សាយដ៏ពេញនិយមម្នាក់ឈ្មោះ Atrioc ត្រូវបានគេរកឃើញថាកំពុងចូលប្រើគេហទំព័រអាសអាភាស Deepfake នៅលើកម្មវិធីរុករកតាមអ៊ីនធឺណិតរបស់គាត់ក្នុងអំឡុងពេលផ្សាយផ្ទាល់នៅចុងខែមករា។

Apple និង Google ថ្មីៗនេះបានប្រកាសថាពួកគេបានដកកម្មវិធីមួយចេញពីហាងកម្មវិធីរបស់ពួកគេសម្រាប់ការដំណើរការវីដេអូក្លែងក្លាយដែលបង្ហាញពីការរួមភេទយ៉ាងជ្រៅទៅក្នុងផលិតផលទីផ្សារ។

ពីតារាចម្រៀងលោកខាងលិចទៅជាតារា K-pop ។

ការស្រាវជ្រាវលើការក្លែងបន្លំអាសអាភាសគឺមិនរីករាលដាលទេ ប៉ុន្តែរបាយការណ៍ឆ្នាំ 2019 ដែលត្រូវបានចេញផ្សាយដោយក្រុមហ៊ុន AI DeepTrace Labs បានបង្ហាញថា វាត្រូវបានប្រើប្រាស់អាវុធស្ទើរតែទាំងស្រុងប្រឆាំងនឹងស្ត្រី។ បុគ្គលដែលត្រូវបានគេកំណត់គោលដៅច្រើនបំផុតគឺតារាសម្ដែងលោកខាងលិច បន្ទាប់មកគឺតារាចម្រៀង K-pop។

អ្នកនាំពាក្យ Meta លោក Dani Lever បាននិយាយនៅក្នុងសេចក្តីថ្លែងការណ៍មួយថា គោលការណ៍របស់ក្រុមហ៊ុនដាក់កម្រិតទាំងមាតិកាសម្រាប់មនុស្សពេញវ័យដែលបង្កើតដោយ AI និងមិនមែន AI ហើយក៏កំណត់ទំព័ររបស់កម្មវិធីបង្កើតក្លែងក្លាយពីការផ្សាយពាណិជ្ជកម្មនៅលើវេទិការបស់ខ្លួន។

នៅក្នុងខែកុម្ភៈ Meta រួមជាមួយនឹងគេហទំព័រសម្រាប់មនុស្សពេញវ័យដូចជា Only**** និង Porn*** បានចាប់ផ្តើមចូលរួមក្នុងឧបករណ៍អនឡាញមួយដែលមានឈ្មោះថា Take It Down ដែលអនុញ្ញាតឱ្យក្មេងជំទង់រាយការណ៍រូបភាព និងវីដេអូអាសអាភាសរបស់ពួកគេពីអ៊ីនធឺណិត។ គេហទំព័រនេះគាំទ្រដំណើរការទាំងវីដេអូដែលបានថតដោយសម្ងាត់ និងវីដេអូដែលបង្កើតដោយ AI ។

លោក Hoang Ton (យោងតាម AP)

ប្រភព

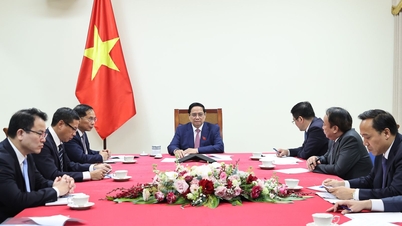

![[រូបថត] នាយករដ្ឋមន្ត្រី Pham Minh Chinh សន្ទនាតាមទូរស័ព្ទជាមួយនាយកប្រតិបត្តិនៃសាជីវកម្ម Rosatom របស់រុស្ស៊ី។](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

![[រូបថត] ពិធីបិទសម័យប្រជុំរដ្ឋសភាលើកទី១០ នីតិកាលទី១៥](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765448959967_image-1437-jpg.webp&w=3840&q=75)

![[ផ្លូវការ] MISA GROUP ប្រកាសពីទីតាំងម៉ាកយីហោត្រួសត្រាយរបស់ខ្លួននៅក្នុងភ្នាក់ងារសាងសង់ AI សម្រាប់អាជីវកម្ម គ្រួសារ និងរដ្ឋាភិបាល](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765444754256_agentic-ai_postfb-scaled.png)

Kommentar (0)