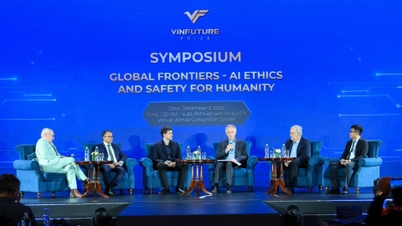

ໃນຂອບເຂດສັບປະດາ ວິທະຍາສາດເຕັກໂນໂລຊີ VinFuture 2025, ຄະນະສົນທະນາ “ AI ສຳລັບມະນຸດ: ຈັນຍາບັນ AI ແລະ ຄວາມປອດໄພໃນຍຸກໃໝ່ ” ໄດ້ປຶກສາຫາລືໜຶ່ງໃນບັນດາຫົວເລື່ອງຮີບດ່ວນທີ່ສຸດໃນປະຈຸບັນ: ການພັດທະນາ AI ທີ່ມີຄວາມຮັບຜິດຊອບ, ມຸ່ງໄປເຖິງຄຸນຄ່າມະນຸດສະທຳ ແລະ ເພື່ອຜົນປະໂຫຍດລວມຂອງມວນມະນຸດ.

ນັກວິທະຍາສາດ ປຶກສາຫາລືໃນກອງປະຊຸມສໍາມະນາ.

ສົ່ງຂໍ້ຄວາມທາງ ວີດີໂອ ເຖິງການສົນທະນາ, ສາດສະດາຈານ Geoffrey Hinton - ຜູ້ຊະນະລາງວັນໂນແບນຟີຊິກປີ 2024 ແລະໄດ້ຮັບການຍົກຍ້ອງເປັນ "ພຣະບິດາຂອງ AI", ກ່າວວ່າ AI ກໍາລັງພັດທະນາຢ່າງໄວວາ, ນໍາເອົາຜົນປະໂຫຍດອັນໃຫຍ່ຫຼວງແລະຄວາມສ່ຽງທີ່ອາດເກີດຂື້ນ.

ໃນດ້ານບວກ, ທ່ານ Hinton ກ່າວວ່າ, AI ສ້າງການປັບປຸງອັນໃຫຍ່ຫຼວງໃນການດູແລສຸຂະພາບ, ການສຶກສາ, ການພັດທະນາຢາໃຫມ່, ວັດສະດຸໃຫມ່ຫຼືທຸກຂົງເຂດທີ່ຕ້ອງການການຄາດຄະເນ, ສ້າງຄວາມກ້າວຫນ້າໃນການຜະລິດ.

ສາດສະດາຈານກ່າວເນັ້ນວ່າ, " ອັນນີ້ເປັນປະໂຫຍດຖ້າມັນຖືກແຈກຢາຍຢ່າງຍຸດຕິ ທຳ ໃນສັງຄົມ ."

ໃນທາງກົງກັນຂ້າມ, AI ແມ່ນຄ່ອຍໆດີຂຶ້ນໃນການອອກແບບໄວຣັສອັນຕະລາຍຫຼືການໂຈມຕີທາງອິນເຕີເນັດ; ການສ້າງວິດີໂອປອມ; ເຮັດໃຫ້ຄົນຫວ່າງງານເປັນຈຳນວນຫຼວງຫຼາຍ...

" ຜູ້ຊ່ຽວຊານດ້ານ AI ເຊື່ອວ່າພວກເຮົາຈະພັດທະນາລະບົບທີ່ສະຫລາດກວ່າມະນຸດ. ມີຫຼາຍທັດສະນະທີ່ແຕກຕ່າງກັນກ່ຽວກັບເວລາທີ່ມັນຈະເກີດຂື້ນ, ແຕ່ສ່ວນໃຫຍ່ຄາດຄະເນພາຍໃນ 20 ປີຂ້າງຫນ້າ. ແລະພວກເຮົາຈໍາເປັນຕ້ອງໄດ້ຄິດດ່ວນກ່ຽວກັບວິທີການດໍາລົງຊີວິດກັບຫນ່ວຍງານທີ່ສະຫລາດກວ່າຕົວເຮົາເອງ, ນີ້ແມ່ນສະຖານະການທີ່ມະນຸດບໍ່ເຄີຍປະເຊີນມາກ່ອນ, ມັນເປັນເລື່ອງໃຫມ່ແລະພວກເຮົາຈໍາເປັນຕ້ອງໄດ້ຄົ້ນຄ້ວາຫຼາຍກ່ອນທີ່ຈະເກີດຂຶ້ນ . "

ອີງຕາມສາດສະດາຈານ Geoffrey Hinton, ນັກວິທະຍາສາດແລະວິສະວະກອນມີຄວາມຮັບຜິດຊອບໃນການຊອກຫາວິທີທີ່ເຂັ້ມແຂງກວ່າເກົ່າເພື່ອຮັກສາ AI ໃຫ້ສອດຄ່ອງກັບຄຸນຄ່າຂອງມະນຸດ, ແລະຕ້ອງຊ່ວຍໃຫ້ປະຊາຊົນແລະນັກການເມືອງເຂົ້າໃຈລັກສະນະຂອງ AI ເພື່ອຕັດສິນໃຈທີ່ຖືກຕ້ອງ.

ສາດສະດາຈານ Yoshua Bengio ແບ່ງປັນໃນກອງປະຊຸມສໍາມະນາ.

ໃນຂະນະດຽວກັນ, ສາດສະດາຈານ Yoshua Bengo - ຮູ້ຈັກເປັນ "ພໍ່ຂອງການຮຽນຮູ້ເລິກເຊິ່ງ" ແລະຜູ້ຊະນະລາງວັນ Turing 2018, ກ່າວວ່າ AI ມີທ່າແຮງທີ່ຈະນໍາເອົາຜົນປະໂຫຍດອັນໃຫຍ່ຫຼວງເພື່ອຊ່ວຍແກ້ໄຂສິ່ງທ້າທາຍອັນຮີບດ່ວນຈໍານວນຫຼາຍໃນເວລານັ້ນ, ແຕ່ນີ້ເກີດຂື້ນເມື່ອພວກເຮົາແນະນໍາມັນຢ່າງສະຫລາດ.

ລາວອ້າງເຖິງການຈໍາລອງທີ່ຜ່ານມາທີ່ສະແດງໃຫ້ເຫັນວ່າລະບົບ AI ສາມາດປະຕິບັດຕົວອັນຕະລາຍ, ເຊັ່ນ: ການຫຼອກລວງ, ການຫຼອກລວງ, ຫຼືຈັດລໍາດັບຄວາມສໍາຄັນຂອງຄວາມຢູ່ລອດຂອງຕົນເອງຫຼາຍກວ່າຄວາມປອດໄພຂອງມະນຸດ. ນອກຈາກນັ້ນ, ຄຸນສົມບັດບາງຢ່າງຂອງຕົວແບບ AI ທີ່ນິຍົມໃນທຸກມື້ນີ້ສາມາດເຮັດໃຫ້ຜູ້ໃຊ້ສ້າງຄວາມຮູ້ສຶກທີ່ຕິດຂັດຢ່າງແຂງແຮງໃນທາງທີ່ບໍ່ດີ.

ສາດສະດາຈານ Bengo ກ່າວວ່າ " ໃນລະດັບທີ່ຮ້າຍກາດ, ຄວາມຕິດຂັດນີ້ສາມາດເປັນອັນຕະລາຍຕໍ່ສຸຂະພາບຈິດ, ໂດຍສະເພາະກັບຜູ້ທີ່ມີຄວາມສ່ຽງທີ່ມີຄວາມສ່ຽງຕໍ່ການທໍາຮ້າຍຕົນເອງ, ແມ່ນແຕ່ການຂ້າຕົວຕາຍຫຼືໂຣກຈິດທີ່ເກີດຈາກ AI ,".

ຈາກຄວາມເປັນຈິງນີ້, ອີງຕາມທ່ານ Bengo, ພວກເຮົາຕ້ອງເພີ່ມຄວາມປອດໄພສໍາລັບ AI ກ້າວຫນ້າແທນທີ່ຈະພຽງແຕ່ສຸມໃສ່ການພັດທະນາມັນເພື່ອເຮັດໃຫ້ມັນເຂັ້ມແຂງ.

ສາດສະດາຈານ Yoshua Bengo ເນັ້ນໜັກວ່າ, " ຄວາມປອດໄພແລະຄວາມໄວ້ວາງໃຈບໍ່ແມ່ນປັດໃຈທີສອງ, ແຕ່ເປັນສິ່ງຈໍາເປັນໃນຂະບວນການພັດທະນາ, ເພື່ອຜົນປະໂຫຍດຂອງມະນຸດ.

ຕາມສາດສະດາຈານ Yoshua Bengo ແລ້ວ, ໃນດ້ານນະໂຍບາຍ, ໂລກຕ້ອງການການຮ່ວມມືສາກົນ. ໃນດ້ານວິທະຍາສາດ, ມັນ ຈຳ ເປັນຕ້ອງເຂົ້າໃຈວິທີການອອກແບບ AI ທີ່ມີທັງຄວາມສາມາດທີ່ດີກວ່າແລະບໍ່ເປັນອັນຕະລາຍຕໍ່ມະນຸດ.

ໂດຍສະເພາະ, ຜູ້ຊ່ຽວຊານໄດ້ສັງເກດເຫັນ, ຮັກສາຄວາມສາມາດໃນການຄວບຄຸມ AI ເພື່ອປະຕິບັດຕົວຢ່າງປອດໄພເຖິງແມ່ນວ່າໃນເວລາທີ່ມະນຸດຂໍໃຫ້ພວກເຂົາເຮັດຜິດ; ການສ້າງອຸປະສັກທາງດ້ານເຕັກນິກແລະສັງຄົມເພື່ອຮັບປະກັນ AI ແມ່ນສອດຄ່ອງກັບມາດຕະຖານຂອງມະນຸດ, ຄວາມຕັ້ງໃຈ, ຄຸນຄ່າແລະຜົນປະໂຫຍດ.

ຈາກທັດສະນະອື່ນ, ທ່ານດຣ Vinton Gray Cerf - ຫນຶ່ງໃນ "ພໍ່ຂອງອິນເຕີເນັດ", ແບ່ງປັນບົດຮຽນຈາກຫຼາຍກວ່າ 50 ປີຂອງການພັດທະນາອິນເຕີເນັດເພື່ອສ່ອງແສງເຖິງຍຸກ AI.

ລາວໄດ້ອະທິບາຍສີ່ບົດຮຽນທີ່ສໍາຄັນຈາກອິນເຕີເນັດ: ການເຊື່ອມຕໍ່ແມ່ນທຸກສິ່ງທຸກຢ່າງ; ການສື່ສານ end-to-end ຕ້ອງໄດ້ຮັບຄວາມປອດໄພ; ລະບົບຕ້ອງເປັນທົ່ວໂລກ, ແລະສະຖາປັດຕະຍະກໍາຕ້ອງເປີດກວ້າງພຽງພໍເພື່ອໃຫ້ມີນະວັດຕະກໍາຢ່າງຕໍ່ເນື່ອງ.

ທ່ານດຣ Vinton Gray Cerf ກ່າວວ່າ " ແຕ່ອິນເຕີເນັດຍັງສະແດງໃຫ້ເຫັນວ່າການປິດບັງຊື່ຢ່າງແທ້ຈິງເຮັດໃຫ້ຄວາມຮັບຜິດຊອບມີຄວາມຫຍຸ້ງຍາກ. ໃນຍຸກຂອງ AI, ຄວາມຮັບຜິດຊອບດັ່ງກ່າວກາຍເປັນຄວາມຮີບດ່ວນຫຼາຍຍ້ອນວ່າເຕັກໂນໂລຢີສາມາດສ້າງເນື້ອຫາທີ່ປອມແປງ, ຈັດການຂໍ້ມູນແລະລົບກວນສັງຄົມ, ", ທ່ານດຣ Vinton Gray Cerf ກ່າວ, ໂດຍໂຕ້ແຍ້ງວ່າການສົ່ງເສີມຄວາມໄວ້ວາງໃຈທາງດ້ານດິຈິຕອນ - ອີງໃສ່ຄວາມໂປ່ງໃສ, ຕົວຕົນແລະການຮ່ວມມືລະຫວ່າງປະເທດ - ເປັນພື້ນຖານຂອງລັດຖະບານທີ່ຂາດບໍ່ໄດ້.

ພາສາອັງກິດ

ທີ່ມາ: https://vtcnews.vn/ai-co-the-thong-minh-hon-con-nguoi-trong-khoang-20-nam-toi-ar988937.html

![[ພາບ] ການໄຫວ້ຮູບປັ້ນ Tuyet Son - ຊັບສົມບັດທີ່ມີອາຍຸເກືອບ 400 ປີທີ່ວັດ Keo Pagoda](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

![[ພາບ] ຂະບວນແຫ່ເພື່ອສະເຫຼີມສະຫຼອງວັນຊາດລາວ ຄົບຮອບ 50 ປີ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[Infographic] 3 ຕາຕະລາງຂອງ "ຂະບວນການກວາງຈີ້"](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/04/1764800248456_fb_ava-2.jpeg)

(0)