ການລະເບີດຂອງປັນຍາປະດິດ (AI) ນໍາເອົາຜົນປະໂຫຍດອັນໃຫຍ່ຫຼວງມາໃຫ້ມະນຸດແຕ່ຍັງເຮັດໃຫ້ເກີດຜົນສະທ້ອນທີ່ນັບບໍ່ຖ້ວນ: ຈາກການລໍາອຽງດ້ານເຊື້ອຊາດ, ການສໍ້ໂກງອອນໄລນ໌ທີ່ສັບສົນໄປສູ່ຄວາມສ່ຽງຂອງບັນດາປະເທດທີ່ກໍາລັງພັດທະນາກາຍເປັນ "ບໍ່ແຮ່ຂໍ້ມູນ" ລາຄາຖືກ.

ຕາມຄວາມເປັນຈິງນັ້ນ, ການໃຊ້ AI ທີ່ມີຄວາມຮັບຜິດຊອບຄວນມີຄວາມສະໝັກໃຈ ຫຼື ບັງຄັບ? ຫວຽດນາມ ຄວນເຮັດແນວໃດເມື່ອສ້າງແລວທາງດ້ານກົດໝາຍໃຫ້ແກ່ຂະແໜງການນີ້?

ຢູ່ນອກງານວາງສະແດງ ວິທະຍາສາດ ແລະ ເຕັກໂນໂລຊີ VinFuture Week, ນັກຂ່າວໄດ້ມີການສົນທະນາກັບສາດສະດາຈານ Toby Walsh - ມະຫາວິທະຍາໄລ New South Wales (ອົດສະຕາລີ), ນັກສຶກສາສະມາຄົມຄອມພິວເຕີອາເມລິກາ.

ອາຈານສະເຫນີຄວາມເຂົ້າໃຈກ່ຽວກັບວິທີທີ່ພວກເຮົາ "ປະຕິບັດ" ກັບ AI, ຈາກການຖື "ເຄື່ອງຈັກ" ຮັບຜິດຊອບຕໍ່ຄໍາແນະນໍາສໍາລັບຄອບຄົວເພື່ອປົກປ້ອງຕົນເອງຈາກຄື້ນຟອງຂອງການຫລອກລວງເຕັກໂນໂລຢີສູງ.

ໃຜຮັບຜິດຊອບ AI?

ສາດສະດາຈານ, ການໃຊ້ AI ທີ່ຮັບຜິດຊອບຄວນມີຄວາມສະໝັກໃຈ ຫຼື ບັງຄັບ? ແລະພວກເຮົາຄວນປະພຶດຕົວແນວໃດຕໍ່ AI?

- ຂ້າພະເຈົ້າເຊື່ອຢ່າງຫນັກແຫນ້ນວ່າການນໍາໃຊ້ທີ່ມີຄວາມຮັບຜິດຊອບຂອງ AI ຄວນຈະເປັນການບັງຄັບ . ມີແຮງຈູງໃຈທີ່ຫຼອກລວງໃນການຫຼີ້ນ , ດ້ວຍເງິນຈໍານວນຫຼວງຫຼາຍທີ່ເຮັດກັບ AI, ແລະວິທີດຽວທີ່ຈະຮັບປະກັນການປະພຶດທີ່ເຫມາະສົມແມ່ນການວາງກົດລະບຽບທີ່ເຂັ້ມງວດ , ດັ່ງນັ້ນຜົນປະໂຫຍດສາທາລະນະສະເຫມີມີຄວາມສົມດູນກັບຜົນປະໂຫຍດທາງການຄ້າ .

ເມື່ອ AI ເຮັດຜິດ, ໃຜຮັບຜິດຊອບ? ໂດຍສະເພາະກັບຕົວແທນ AI, ພວກເຮົາມີຄວາມສາມາດໃນການແກ້ໄຂກົນໄກການດໍາເນີນງານຂອງພວກເຂົາບໍ?

ບັນຫາຫຼັກຂອງ AI ເຮັດຜິດພາດແມ່ນວ່າພວກເຮົາບໍ່ສາມາດຮັບຜິດຊອບ AI ໄດ້. AI ບໍ່ແມ່ນມະນຸດ – ແລະນີ້ແມ່ນຂໍ້ບົກພ່ອງໃນທຸກລະບົບກົດໝາຍໃນ ໂລກ . ມະນຸດເທົ່ານັ້ນທີ່ສາມາດຮັບຜິດຊອບຕໍ່ການຕັດສິນໃຈ ແລະການກະທໍາຂອງເຂົາເຈົ້າ.

ທັນໃດນັ້ນ, ພວກເຮົາມີ “ຕົວແທນ,” AI ໃໝ່, ທີ່ສາມາດ—ຖ້າພວກເຮົາອະນຸຍາດ—ເຮັດການຕັດສິນໃຈ ແລະດຳເນີນການໃນໂລກຂອງພວກເຮົາ, ເຊິ່ງກໍ່ໃຫ້ເກີດສິ່ງທ້າທາຍ: ພວກເຮົາຈະຮັບຜິດຊອບໃຜ?

ຄໍາຕອບແມ່ນ: ບໍລິສັດທີ່ນໍາໃຊ້ແລະປະຕິບັດລະບົບ AI ຕ້ອງຮັບຜິດຊອບຕໍ່ຜົນສະທ້ອນຂອງ "ເຄື່ອງຈັກ" ເຫຼົ່ານີ້.

ບໍລິສັດຈໍານວນຫຼາຍຍັງເວົ້າກ່ຽວກັບ AI ທີ່ມີຄວາມຮັບຜິດຊອບ. ພວກເຮົາສາມາດໄວ້ວາງໃຈພວກເຂົາໄດ້ແນວໃດ? ພວກເຮົາຮູ້ໄດ້ແນວໃດວ່າພວກເຂົາມີຄວາມຈິງຈັງແລະສົມບູນແບບ, ແລະບໍ່ພຽງແຕ່ໃຊ້ "AI ທີ່ມີຄວາມຮັບຜິດຊອບ" ເປັນ gimmick ການຕະຫຼາດ?

- ພວກເຮົາຈໍາເປັນຕ້ອງເພີ່ມຄວາມໂປ່ງໃສ. ມັນເປັນສິ່ງສໍາຄັນທີ່ຈະເຂົ້າໃຈຄວາມສາມາດແລະຂໍ້ຈໍາກັດຂອງລະບົບ AI. ພວກເຮົາຄວນ "ລົງຄະແນນສຽງໂດຍການເຮັດ", ນັ້ນແມ່ນ, ເລືອກທີ່ຈະໃຊ້ບໍລິການຢ່າງມີຄວາມຮັບຜິດຊອບ.

ຂ້າພະເຈົ້າເຊື່ອຢ່າງແທ້ຈິງວ່າວິທີການທີ່ທຸລະກິດໃຊ້ AI ຢ່າງມີຄວາມຮັບຜິດຊອບຈະກາຍເປັນຄວາມແຕກຕ່າງໃນຕະຫຼາດ, ໃຫ້ພວກເຂົາມີປະໂຫຍດທາງດ້ານການຄ້າ.

ຖ້າບໍລິສັດເຄົາລົບຂໍ້ມູນຂອງລູກຄ້າ, ມັນຈະໄດ້ຮັບຜົນປະໂຫຍດແລະດຶງດູດລູກຄ້າ. ທຸລະກິດຈະຮັບຮູ້ວ່າການເຮັດສິ່ງທີ່ຖືກຕ້ອງບໍ່ພຽງແຕ່ມີຈັນຍາບັນ, ແຕ່ຍັງຈະຊ່ວຍໃຫ້ພວກເຂົາປະສົບຜົນສໍາເລັດຫຼາຍຂຶ້ນ. ຂ້າພະເຈົ້າເຫັນວ່ານີ້ເປັນວິທີທີ່ຈະແຍກຄວາມແຕກຕ່າງລະຫວ່າງທຸລະກິດ, ແລະທຸລະກິດທີ່ມີຄວາມຮັບຜິດຊອບແມ່ນວິທີທີ່ພວກເຮົາຮູ້ສຶກສະດວກສະບາຍໃນການເຮັດທຸລະກິດ.

ຫວຽດນາມ ຕ້ອງຕັ້ງໜ້າປົກປັກຮັກສາບັນດາຄຸນຄ່າວັດທະນະທຳ.

ຫວຽດນາມ ແມ່ນໜຶ່ງໃນຈຳນວນບໍ່ເທົ່າໃດປະເທດທີ່ພິຈາລະນາປະກາດໃຊ້ກົດໝາຍວ່າດ້ວຍປັນຍາປະດິດ. ການປະເມີນຜົນຂອງເຈົ້າແມ່ນຫຍັງ? ຕາມຄວາມຄິດເຫັນຂອງທ່ານແລ້ວ, ສຳລັບບັນດາປະເທດພວມພັດທະນາຄື ຫວຽດນາມ, ສິ່ງທ້າທາຍກ່ຽວກັບຈັນຍາບັນ ແລະ ຄວາມປອດໄພໃນການພັດທະນາ AI ແມ່ນຫຍັງ?

- ຂ້າພະເຈົ້າດີໃຈທີ່ຫວຽດນາມແມ່ນຫນຶ່ງໃນບັນດາປະເທດບຸກເບີກທີ່ຈະມີກົດຫມາຍສະເພາະກ່ຽວກັບການປັນຍາທຽມ. ນີ້ແມ່ນສິ່ງສໍາຄັນເພາະວ່າແຕ່ລະປະເທດມີຄຸນຄ່າແລະວັດທະນະທໍາຂອງຕົນເອງ, ແລະຕ້ອງການກົດຫມາຍເພື່ອປົກປ້ອງຄຸນຄ່າເຫຼົ່ານັ້ນ.

ຄຸນຄ່າ ແລະ ວັດທະນະທຳຫວຽດນາມ ແມ່ນແຕກຕ່າງກັບ ອົດສະຕາລີ, ຈີນ ແລະ ອາເມລິກາ. ພວກເຮົາບໍ່ສາມາດຄາດຫວັງໃຫ້ບໍລິສັດເຕັກໂນໂລຊີຈາກຈີນຫຼືສະຫະລັດປົກປັກຮັກສາວັດທະນະທຳແລະພາສາຫວຽດນາມໂດຍອັດຕະໂນມັດ. ຫວຽດນາມ ຕ້ອງມີຂໍ້ລິເລີ່ມເພື່ອປົກປັກຮັກສາສິ່ງດັ່ງກ່າວ.

ຂ້າພະເຈົ້າຈື່ໄດ້ວ່າໃນໄລຍະຜ່ານມາປະເທດພັດທະນາຈໍານວນຫຼາຍໄດ້ຜ່ານໄລຍະຂອງການອານານິຄົມທາງດ້ານຮ່າງກາຍ. ຖ້າພວກເຮົາບໍ່ລະມັດລະວັງ, ພວກເຮົາສາມາດຜ່ານໄລຍະເວລາຂອງ "ອານານິຄົມດິຈິຕອນ". ຂໍ້ມູນຂອງທ່ານຈະຖືກຂູດຮີດແລະທ່ານຈະກາຍເປັນຊັບພະຍາກອນທີ່ມີລາຄາຖືກ.

ນີ້ມີຄວາມສ່ຽງຖ້າປະເທດກໍາລັງພັດທະນາພັດທະນາອຸດສາຫະກໍາ AI ໃນທາງທີ່ພຽງແຕ່ຂຸດຄົ້ນຂໍ້ມູນໂດຍບໍ່ມີການຄວບຄຸມຫຼືປົກປ້ອງຜົນປະໂຫຍດຂອງຕົນເອງ.

ດັ່ງນັ້ນວິທີການເອົາຊະນະສະຖານະການນີ້?

- ມັນງ່າຍດາຍ: ລົງທຶນໃນຄົນ. ຄົນທີ່ມີທັກສະສູງ, ໃຫ້ແນ່ໃຈວ່າພວກເຂົາເຂົ້າໃຈ AI. ສະຫນັບສະຫນູນຜູ້ປະກອບການ, ບໍລິສັດ AI, ສະຫນັບສະຫນູນວິທະຍາໄລ. ມີຄວາມຫ້າວຫັນ. ແທນທີ່ຈະລໍຖ້າໃຫ້ປະເທດອື່ນຖ່າຍທອດເຕັກໂນໂລຊີຫຼືຊີ້ນໍາພວກເຮົາ, ພວກເຮົາຕ້ອງມີຄວາມຕັ້ງຫນ້າແລະເປັນເຈົ້າຂອງເຕັກໂນໂລຊີ.

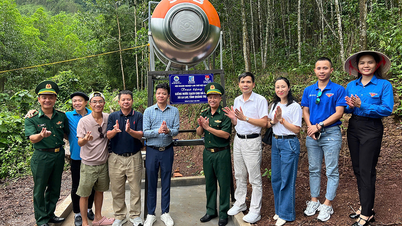

ສາດສະດາຈານ Toby Walsh ແບ່ງປັນໃນອາທິດວິທະຍາສາດ ແລະ ເຕັກໂນໂລຊີ VinFuture (ພາບ: ຄະນະຈັດຕັ້ງ).

ສອງ, ພວກເຮົາຕ້ອງສະໜັບສະໜູນຢ່າງແຮງກ່ຽວກັບບັນດາເວທີສື່ສັງຄົມເພື່ອສ້າງສະພາບແວດລ້ອມທີ່ປອດໄພໃຫ້ຜູ້ໃຊ້ຢູ່ຫວຽດນາມ, ທັງບໍ່ໄດ້ກະທົບເຖິງປະຊາທິປະໄຕຂອງປະເທດ.

ໃນຄວາມເປັນຈິງ, ມີຕົວຢ່າງຈໍານວນຫລາຍກ່ຽວກັບວິທີການສື່ມວນຊົນສັງຄົມມີອິດທິພົນຕໍ່ຜົນການເລືອກຕັ້ງ, ປະເທດທີ່ແບ່ງອອກ, ແລະແມ້ກະທັ້ງການກະຕຸ້ນການກໍ່ການຮ້າຍ.

ຂ້າພະເຈົ້າໄດ້ໃຊ້ເວລາ 40 ປີເຮັດວຽກກ່ຽວກັບປັນຍາປະດິດ. ສໍາລັບ 30 ປີທໍາອິດ, ຂ້ອຍກັງວົນກ່ຽວກັບວິທີເຮັດໃຫ້ AI ມີອໍານາດຫຼາຍຂຶ້ນ. ໃນ 10 ປີທີ່ຜ່ານມາ, ຂ້ອຍມີຄວາມສົນໃຈແລະເວົ້າຫຼາຍຂື້ນກ່ຽວກັບການພັດທະນາ AI ທີ່ມີຄວາມຮັບຜິດຊອບ.

ທ່ານສາມາດໃຫ້ຄຳແນະນຳບາງຢ່າງໄດ້ໃນຂະນະທີ່ ຫວຽດນາມ ພວມດຳເນີນຮ່າງກົດໝາຍວ່າດ້ວຍປັນຍາປະດິດ?

- ມີຫຼາຍກໍລະນີທີ່ກົດໝາຍໃໝ່ບໍ່ຈຳເປັນ. ພວກເຮົາມີກົດໝາຍວ່າດ້ວຍຄວາມເປັນສ່ວນຕົວແລ້ວ, ພວກເຮົາມີກົດໝາຍວ່າດ້ວຍການແຂ່ງຂັນ. ກົດຫມາຍທີ່ມີຢູ່ແລ້ວເຫຼົ່ານີ້ນໍາໃຊ້ກັບພື້ນທີ່ດິຈິຕອນ, ຄືກັນກັບພວກເຂົານໍາໃຊ້ກັບໂລກທາງດ້ານຮ່າງກາຍ.

ມັນເປັນສິ່ງສໍາຄັນທີ່ຈະບັງຄັບໃຊ້ກົດຫມາຍເຫຼົ່ານີ້ຢ່າງເຂັ້ມງວດໃນສະພາບແວດລ້ອມດິຈິຕອນດັ່ງທີ່ພວກເຮົາເຮັດໃນສະພາບແວດລ້ອມທາງດ້ານຮ່າງກາຍ.

ຢ່າງໃດກໍ່ຕາມ, ມີຄວາມສ່ຽງໃຫມ່ບາງຢ່າງທີ່ເກີດຂື້ນແລະພວກເຮົາກໍາລັງເລີ່ມເຫັນວ່າ. ປະຊາຊົນເລີ່ມສ້າງຄວາມສໍາພັນກັບ AI, ໃຊ້ AI ເປັນຜູ້ປິ່ນປົວແລະບາງຄັ້ງມັນກໍ່ເຮັດໃຫ້ເກີດອັນຕະລາຍຕໍ່ຜູ້ໃຊ້, ດັ່ງນັ້ນພວກເຮົາຈໍາເປັນຕ້ອງລະມັດລະວັງ.

ພວກເຮົາສະເຫມີໃຫ້ຜູ້ຜະລິດຮັບຜິດຊອບໃນເວລາທີ່ພວກເຂົາປ່ອຍຜະລິດຕະພັນ. ຕົວຢ່າງ, ຖ້າບໍລິສັດ AI ປ່ອຍຜະລິດຕະພັນ AI ທີ່ເປັນອັນຕະລາຍຕໍ່ມະນຸດ, ພວກເຂົາກໍ່ຄວນຈະຮັບຜິດຊອບເຊັ່ນກັນ.

ດັ່ງນັ້ນພວກເຮົາຈະປ້ອງກັນບໍ່ໃຫ້ AI ເຮັດໃຫ້ເກີດຜົນກະທົບທີ່ເປັນອັນຕະລາຍຕໍ່ເດັກນ້ອຍໄດ້ແນວໃດແລະສ້າງສະພາບແວດລ້ອມທີ່ປອດໄພສໍາລັບເດັກນ້ອຍທຸກຄັ້ງທີ່ AI ປາກົດ, ທ່ານ?

- ຂ້າພະເຈົ້າຄິດວ່າພວກເຮົາບໍ່ໄດ້ຮຽນຮູ້ຫຼາຍບົດຮຽນຈາກສື່ມວນຊົນສັງຄົມ. ປະຈຸບັນຫຼາຍປະເທດເລີ່ມຮັບຮູ້ແລ້ວວ່າສື່ສັງຄົມມີຜົນປະໂຫຍດອັນໃຫຍ່ຫຼວງ ແຕ່ຍັງມີຂໍ້ເສຍຫຼາຍຢ່າງ, ໂດຍສະເພາະແມ່ນຜົນກະທົບຕໍ່ສຸຂະພາບຈິດ, ລະດັບຄວາມວິຕົກກັງວົນ ແລະຮູບພາບຮ່າງກາຍຂອງໄວໜຸ່ມ ໂດຍສະເພາະເດັກຍິງ.

ຫຼາຍປະເທດໄດ້ເລີ່ມປະຕິບັດມາດຕະການແກ້ໄຂບັນຫານີ້ແລ້ວ. ໃນປະເທດອົດສະຕາລີ, ການຈໍາກັດອາຍຸສໍາລັບການນໍາໃຊ້ສື່ມວນຊົນສັງຄົມຈະມີຜົນບັງຄັບໃຊ້ໃນວັນທີ 10 ເດືອນທັນວາ. ຂ້າພະເຈົ້າຄິດວ່າພວກເຮົາຕ້ອງການມາດຕະການທີ່ຄ້າຍຄືກັນສໍາລັບ AI.

ພວກເຮົາກໍາລັງສ້າງເຄື່ອງມືທີ່ສາມາດມີຜົນກະທົບທາງບວກແຕ່ຍັງສາມາດເຮັດໃຫ້ເກີດອັນຕະລາຍ, ແລະພວກເຮົາຈໍາເປັນຕ້ອງປົກປ້ອງຈິດໃຈແລະຫົວໃຈຂອງເດັກນ້ອຍຂອງພວກເຮົາຈາກຜົນກະທົບທາງລົບເຫຼົ່ານີ້.

ນອກຈາກນັ້ນ, ຂ້າພະເຈົ້າຫວັງວ່າປະເທດຕ່າງໆຍັງຈະອອກກົດລະບຽບທີ່ເຂັ້ມງວດໃນການຄຸ້ມຄອງເຄືອຂ່າຍສັງຄົມ, ດັ່ງນັ້ນການສ້າງສະພາບແວດລ້ອມທີ່ປອດໄພແທ້ໆສໍາລັບທຸກຄົນໃນເວລາທີ່ໃຊ້ AI.

ໃນຄວາມເປັນຈິງ, ບໍ່ພຽງແຕ່ເດັກນ້ອຍເທົ່ານັ້ນ, ແຕ່ຜູ້ໃຫຍ່ຍັງປະເຊີນກັບຄວາມສ່ຽງທີ່ເກີດຈາກ AI ເອງ. ດັ່ງນັ້ນປະຊາຊົນຈະໃຊ້ AI ເພື່ອປັບປຸງຊີວິດຂອງເຂົາເຈົ້າແນວໃດແລະບໍ່ເປັນອັນຕະລາຍ?

- AI ຖືກນໍາໃຊ້ໃນຫຼາຍຂົງເຂດ, ຊ່ວຍປັບປຸງຄຸນນະພາບຂອງຊີວິດຂອງພວກເຮົາ. ໃນຢາປົວພະຍາດ, AI ຊ່ວຍໃຫ້ຄົ້ນພົບຢາໃຫມ່. ໃນ ການສຶກສາ , AI ຍັງນໍາເອົາຜົນປະໂຫຍດໃນທາງບວກຫຼາຍຢ່າງ.

ຢ່າງໃດກໍ່ຕາມ, ການເຂົ້າເຖິງ AI ໂດຍບໍ່ມີການປົກປ້ອງທີ່ພຽງພໍແມ່ນມີຄວາມສ່ຽງເກີນໄປ. ພວກເຮົາໄດ້ເຫັນການຟ້ອງຮ້ອງໃນສະຫະລັດທີ່ພໍ່ແມ່ຟ້ອງບໍລິສັດເຕັກໂນໂລຢີທີ່ຂັບລົດລູກຂອງເຂົາເຈົ້າຂ້າຕົວຕາຍຫຼັງຈາກພົວພັນກັບ AI chatbots.

ເຖິງແມ່ນວ່າອັດຕາສ່ວນຂອງຜູ້ໃຊ້ ChatGPT ທີ່ປະສົບບັນຫາສຸຂະພາບຈິດແມ່ນພຽງແຕ່ສອງສາມເປີເຊັນ, ມີຜູ້ໃຊ້ຫຼາຍຮ້ອຍລ້ານຄົນ, ຕົວເລກຕົວຈິງແມ່ນຢູ່ໃນຫຼາຍຮ້ອຍພັນຄົນ.

ຂໍ້ມູນມີຄວາມສໍາຄັນຫຼາຍສໍາລັບການພັດທະນາ AI, ແຕ່ຈາກທັດສະນະຂອງການຄຸ້ມຄອງ, ຖ້າການຈັດການຂໍ້ມູນເຄັ່ງຄັດເກີນໄປ, ມັນຈະຂັດຂວາງການພັດທະນາຂອງ AI. ໃນຄວາມຄິດເຫັນຂອງເຈົ້າ, ອັນຕະລາຍອັນໃດທີ່ສາມາດເຮັດໃຫ້ການຈັດການຂໍ້ມູນວ່າງລົງ? ວິທີການດຸ່ນດ່ຽງການເກັບກໍາຂໍ້ມູນ, ການຄຸ້ມຄອງຂໍ້ມູນທີ່ປອດໄພກັບການສ້າງການພັດທະນາສໍາລັບ AI?

- ຂ້າພະເຈົ້າຕົກລົງເຫັນດີຢ່າງແທ້ຈິງ. ຂໍ້ມູນແມ່ນຈຸດໃຈກາງຂອງຄວາມຄືບໜ້າຂອງ AI , ເພາະວ່າມັນເປັນຂໍ້ມູນທີ່ຂັບເຄື່ອນມັນ. ຖ້າບໍ່ມີຂໍ້ມູນ, ພວກເຮົາຈະບໍ່ມີຄວາມຄືບຫນ້າໃດໆ. ຂໍ້ມູນທີ່ມີຄຸນນະພາບສູງແມ່ນເປັນຫຼັກຂອງທຸກສິ່ງທີ່ພວກເຮົາເຮັດ. ໃນຄວາມເປັນຈິງ, ມູນຄ່າການຄ້າແລະຄວາມໄດ້ປຽບໃນການແຂ່ງຂັນທີ່ບໍລິສັດໄດ້ຮັບມາຈາກຂໍ້ມູນ. ບໍ່ວ່າພວກເຮົາມີຂໍ້ມູນທີ່ມີຄຸນນະພາບຫຼືບໍ່, ນັ້ນແມ່ນບັນຫາສໍາຄັນ.

ມັນເປັນຄວາມໂກດແຄ້ນທີ່ຈະເຫັນຫນັງສືຂອງນັກຂຽນທົ່ວໂລກ - ລວມທັງຂອງຂ້ອຍ - ຖືກໃຊ້ໂດຍບໍ່ມີການອະນຸຍາດແລະບໍ່ມີການຊົດເຊີຍ. ມັນເປັນການລັກເອົາຜົນຂອງແຮງງານຂອງຄົນອື່ນ. ຖ້າສະຖານະການນີ້ຍັງສືບຕໍ່, ຜູ້ຂຽນຈະສູນເສຍແຮງຈູງໃຈໃນການຂຽນຫນັງສື, ແລະພວກເຮົາຈະສູນເສຍຄຸນຄ່າວັດທະນະທໍາທີ່ພວກເຮົາຮັກແພງ.

ພວກເຮົາຈໍາເປັນຕ້ອງຊອກຫາການແກ້ໄຂທີ່ມີຄວາມສະເຫມີພາບຫຼາຍກ່ວາສິ່ງທີ່ພວກເຮົາມີໃນປັດຈຸບັນ.

ໃນປັດຈຸບັນ, "Silicon Valley" ໃຊ້ເວລາເນື້ອຫາແລະຄວາມຄິດສ້າງສັນຈາກຜູ້ຂຽນໂດຍບໍ່ມີການຈ່າຍຄ່າມັນ - ນີ້ແມ່ນບໍ່ຍືນຍົງ. ຂ້າພະເຈົ້າປຽບທຽບສະຖານະການໃນປະຈຸບັນກັບ Napster ແລະຍຸກທໍາອິດຂອງດົນຕີອອນໄລນ໌ໃນຊຸມປີ 2000. ໃນເວລານັ້ນ, ດົນຕີອອນໄລນ໌ທັງຫມົດແມ່ນ "ຖືກລັກ", ແຕ່ວ່າມັນບໍ່ສາມາດຄົງຢູ່ຕະຫຼອດໄປ, ເພາະວ່ານັກດົນຕີຕ້ອງການລາຍໄດ້ເພື່ອສືບຕໍ່ສ້າງ.

ສຸດທ້າຍ, ພວກເຮົາມີລະບົບການຖ່າຍທອດແບບເສຍເງິນ , ເຊັ່ນ Spotify ຫຼື Apple Music, ຫຼືດົນຕີທີ່ມີການໂຄສະນາ, ເຊິ່ງສ່ວນຫນຶ່ງຂອງລາຍຮັບຈະກັບຄືນໄປຫາສິນລະປິນ. ພວກເຮົາຈໍາເປັນຕ້ອງເຮັດເຊັ່ນດຽວກັນກັບປຶ້ມ, ເພື່ອໃຫ້ຜູ້ຂຽນໄດ້ຮັບມູນຄ່າຈາກຂໍ້ມູນຂອງພວກເຂົາ. ຖ້າບໍ່ດັ່ງນັ້ນ, ຈະບໍ່ມີຜູ້ໃດຖືກກະຕຸ້ນໃຫ້ຂຽນປຶ້ມ, ແລະໂລກຈະຮ້າຍແຮງກວ່າຖ້າບໍ່ມີປຶ້ມໃໝ່ຖືກຂຽນ.

ໃນຂອບເຂດສັບປະດາວິທະຍາສາດ ແລະ ເຕັກໂນໂລຢີ VinFuture, ງານວາງສະແດງ “Toa V - ຈຸດສຳພັດວິທະຍາສາດ” ຍັງຈະດຳເນີນຢູ່ສູນສິລະປະຮ່ວມເມືອງ Vincom Royal (ຮູບພາບ: ຄະນະຈັດຕັ້ງ).

AI ມີການພັດທະນາຫຼາຍຢູ່ຫວຽດນາມ. ໃນໄລຍະມໍ່ໆມານີ້, ຫວຽດນາມມີຫຼາຍນະໂຍບາຍຊຸກຍູ້ການພັດທະນາ AI, ແຕ່ຫວຽດນາມຍັງປະສົບກັບບັນຫາ, ແມ່ນການສໍ້ໂກງຍ້ອນ AI. ດັ່ງນັ້ນ, ຕາມທ່ານສາດສະດາຈານແລ້ວ, ຫວຽດນາມ ຄວນຮັບມືກັບສະພາບການນີ້ແນວໃດ? ຄໍາແນະນໍາຂອງອາຈານສໍາລັບຜູ້ທີ່ໃຊ້ AI ໃນມື້ນີ້ເພື່ອຮັບປະກັນຄວາມປອດໄພແລະປົກປ້ອງຂໍ້ມູນຂອງພວກເຂົາແມ່ນຫຍັງ?

- ສໍາລັບແຕ່ລະຄົນ, ຂ້າພະເຈົ້າຄິດວ່າວິທີທີ່ງ່າຍທີ່ສຸດແມ່ນການກວດສອບຂໍ້ມູນ. ຕົວຢ່າງ, ເມື່ອໄດ້ຮັບໂທລະສັບຫຼືອີເມລ໌, ຕົວຢ່າງຈາກທະນາຄານ, ພວກເຮົາຈໍາເປັນຕ້ອງກວດເບິ່ງອີກເທື່ອຫນຶ່ງ: ພວກເຮົາສາມາດໂທຫາເບີຈອງນັ້ນຄືນຫຼືຕິດຕໍ່ທະນາຄານໂດຍກົງເພື່ອກວດສອບຂໍ້ມູນ.

ມີຫຼາຍອີເມວປອມ, ເບີໂທລະສັບປອມ, ແມ່ນແຕ່ການໂທ Zoom ປອມໃນທຸກມື້ນີ້. ການຫລອກລວງເຫຼົ່ານີ້ແມ່ນງ່າຍດາຍ, ລາຄາບໍ່ແພງ, ແລະບໍ່ໃຊ້ເວລາຫຼາຍ.

ໃນຄອບຄົວຂອງຂ້ອຍ, ພວກເຮົາຍັງມີມາດຕະການຄວາມປອດໄພຂອງຕົນເອງ: "ຄໍາຖາມລັບ" ທີ່ມີພຽງແຕ່ສະມາຊິກໃນຄອບຄົວຮູ້, ເຊັ່ນ: ຊື່ຂອງກະຕ່າຍສັດລ້ຽງຂອງພວກເຮົາ. ນີ້ຮັບປະກັນວ່າຂໍ້ມູນທີ່ສໍາຄັນຢູ່ໃນຄອບຄົວແລະຈະບໍ່ຮົ່ວໄຫລອອກ.

ຫວຽດນາມຍັງໄດ້ລວມເອົາການສຶກສາ AI ເຂົ້າໃນການສຶກສາທົ່ວໄປ, ດັ່ງນັ້ນຄວນສັງເກດຫຍັງແດ່ໃນຂະບວນການນັ້ນ?

- AI ປ່ຽນແປງສິ່ງທີ່ສອນແລະວິທີການສອນ. ມັນມີຜົນກະທົບຕໍ່ທັກສະທີ່ສໍາຄັນຂອງອະນາຄົດ, ເຊັ່ນ: ການຄິດທີ່ສໍາຄັນ, ທັກສະການສື່ສານ, ສະຕິປັນຍາທາງສັງຄົມແລະຄວາມສະຫລາດທາງດ້ານຈິດໃຈ. ທັກສະເຫຼົ່ານີ້ຈະກາຍເປັນສິ່ງຈໍາເປັນ.

AI ສາມາດຊ່ວຍເຫຼືອໃນການສອນທັກສະເຫຼົ່ານີ້, ຕົວຢ່າງເຊັ່ນຄູສອນສ່ວນບຸກຄົນ, ຜູ້ຊ່ວຍການສຶກສາສ່ວນບຸກຄົນ, ສະຫນອງເຄື່ອງມືການສຶກສາທີ່ມີປະສິດທິພາບຫຼາຍໂດຍຜ່ານຄໍາຮ້ອງສະຫມັກ AI.

ຂໍຂອບໃຈທ່ານອາຈານສໍາລັບການໃຊ້ເວລາສໍາລັບການສົນທະນາຂອງພວກເຮົາ!

ທີ່ມາ: https://dantri.com.vn/cong-nghe/viet-nam-can-lam-gi-de-tranh-nguy-co-tro-thanh-nguon-luc-re-tien-20251203093314154.htm

![[ພາບ] ການໄຫວ້ຮູບປັ້ນ Tuyet Son - ຊັບສົມບັດທີ່ມີອາຍຸເກືອບ 400 ປີທີ່ວັດ Keo Pagoda](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

![[ພາບ] ຂະບວນແຫ່ເພື່ອສະເຫຼີມສະຫຼອງວັນຊາດລາວ ຄົບຮອບ 50 ປີ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[Infographic] 3 ຕາຕະລາງຂອງ "ຂະບວນການກວາງຈີ້"](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/04/1764800248456_fb_ava-2.jpeg)

(0)