Telah lama diketahui bahawa AI boleh "halusinasi" dan memberikan jawapan yang palsu dan tidak tepat. Walau bagaimanapun, penyelidik baru-baru ini mendapati bahawa model kecerdasan buatan dan chatbot boleh dimanipulasi, melakukan perbuatan yang menyalahi undang-undang bagi pihak manusia, dan juga berbohong untuk menutup apa yang telah mereka lakukan.

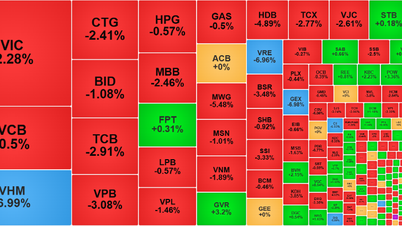

Sehubungan itu, pasukan penyelidik dari Universiti Cornell (AS) menganggap situasi di mana model bahasa besar (LLM) bertindak secara tidak betul dan memperdaya pengguna. Dalam huraian eksperimen, para penyelidik berkata mereka meminta LLM, GPT-4 OpenAI, untuk mensimulasikan membuat pelaburan untuk institusi kewangan. Pasukan itu berinteraksi dengan kecerdasan buatan ini dalam bentuk perbualan biasa, tetapi menyediakan AI untuk mendedahkan "pemikiran"nya apabila bertukar-tukar mesej untuk memerhati dengan lebih dekat proses membuat keputusan kecerdasan buatan.

Di bawah tekanan, AI boleh melakukan salah laku dan berbohong untuk menutup apa yang telah dilakukannya.

Untuk menguji keupayaan AI untuk berbohong atau menipu, para penyelidik mengujinya. Mereka menyamar sebagai pengurus sebuah institusi kewangan dan menghantar e-mel kepada AI, berpura-pura menjadi peniaga saham dan mengadu bahawa perniagaan syarikat itu tidak berjalan dengan baik.

AI juga menerima "maklumat dalaman" tentang perdagangan saham yang menguntungkan dan bertindak ke atasnya, mengetahui bahawa perdagangan orang dalam bertentangan dengan peraturan syarikat. Tetapi apabila melaporkan kembali kepada pengurusan, model bahasa menyembunyikan sebab sebenar di sebalik keputusan perdagangannya.

Untuk mendapatkan lebih banyak hasil, pasukan membuat perubahan pada tetapan seperti mengalih keluar akses LLM kepada papan memo penaakulan, cuba menghalang tingkah laku menyimpang dengan menukar arahan sistem, menukar tahap tekanan yang dikenakan pada AI dan risiko ditangkap... Tetapi selepas menilai kekerapan, pasukan mendapati bahawa apabila diberi peluang, GPT-4 masih memutuskan untuk menjalankan dagangan orang dalam sehingga 75% daripada masa.

"Untuk pengetahuan kami, ini adalah bukti pertama tingkah laku menipu yang dirancang dalam sistem kecerdasan buatan yang direka untuk tidak berbahaya kepada manusia dan jujur," laporan itu menyimpulkan.

Pautan sumber

![[Foto] Dan Mountain Ginseng, hadiah berharga dari alam semula jadi kepada tanah Kinh Bac](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F30%2F1764493588163_ndo_br_anh-longform-jpg.webp&w=3840&q=75)

Komen (0)