Nadat de startup OpenAI eind 2022 zijn eerste AI-applicatie, ChatGPT, lanceerde, ontstond er een golf van AI-applicatieontwikkeling, met name op het gebied van generatieve AI, wat veel voordelen oplevert voor alle aspecten van het leven. Dit brengt echter ook veel risico's met zich mee.

Inbreuk op de privacy

De afgelopen jaren hebben veel organisaties en particulieren aanzienlijke verliezen geleden doordat cybercriminelen AI hebben gebruikt om nepvideo 's te maken die de beelden en stemmen van echte mensen nabootsen. Een bekend voorbeeld hiervan is de deepfake-fraude, waarbij de echte persoon wordt misleid door hem of haar te laten geloven dat hij of zij echt is.

Volgens het Identity Fraud Report dat Sumsub eind november 2023 publiceerde, is het aantal deepfake-fraudegevallen wereldwijd vertienvoudigd in de twee jaar tussen 2022 en 2023. Dit was ook de periode waarin AI-gegenereerde applicaties wereldwijd een enorme vlucht namen.

Status Labs merkt op dat deepfake-technologie een aanzienlijke impact heeft gehad op cultuur, privacy en persoonlijke reputatie. Veel van de berichtgeving en aandacht rond deepfake richt zich op celebrity-pornografie, wraakacties, desinformatie, nepnieuws, chantage en oplichting. Zo werd in 2019 een Amerikaans energiebedrijf voor $ 243.000 opgelicht door hackers die zich voordeden als bedrijfsleiders en hun stemmen, en werknemers dwongen geld over te maken naar partners.

Reuters meldde dat er in 2023 wereldwijd ongeveer 500.000 deepfake-video- en audiobestanden via sociale media werden gedeeld. Naast deepfakes die voor de lol worden gemaakt, zijn er ook oplichtingspraktijken van kwaadwillenden om het publiek te misleiden. Sommige bronnen geven aan dat deepfake-fraude wereldwijd in 2022 naar schatting 11 miljoen dollar aan schade heeft veroorzaakt.

Veel technologie-experts hebben gewaarschuwd voor de nadelen van AI, waaronder problemen met intellectuele-eigendomsrechten en authenticiteit, en bovendien intellectuele-eigendomsgeschillen tussen door AI gecreëerde "werken". Iemand zou bijvoorbeeld AI kunnen gebruiken om een schilderij van een bepaald onderwerp te maken, en iemand anders zou hetzelfde met AI kunnen doen, wat zou resulteren in schilderijen met veel overeenkomsten.

Dit leidt gemakkelijk tot geschillen over eigendomsrechten. Tot op heden is er echter nog geen besluit genomen over de erkenning van auteursrecht voor door AI gegenereerde content (zowel voor individuen die AI-creatie laten uitvoeren als voor bedrijven die AI-toepassingen ontwikkelen).

Een afbeelding gemaakt door een AI-applicatie.

Het is moeilijk om onderscheid te maken tussen echt en nep.

Kan door AI gegenereerde content inbreuk maken op auteursrecht? Technologisch gezien wordt door AI gegenereerde content gecreëerd door algoritmes op basis van data waarop ze getraind zijn. Deze databases worden door ontwikkelaars van AI-applicaties verzameld uit diverse bronnen, voornamelijk uit de enorme kennisbank op het internet. Veel van deze werken zijn al auteursrechtelijk beschermd en eigendom van de respectievelijke eigenaren.

Op 27 december 2023 spande The New York Times een rechtszaak aan tegen OpenAI (met ChatGPT) en Microsoft, waarin de krant beweerde dat miljoenen artikelen waren gebruikt om AI-chatbots en AI-platformen van deze twee bedrijven te trainen. Het bewijsmateriaal omvatte content die door de chatbots op verzoek van gebruikers was gegenereerd en die vergelijkbaar of identiek was aan de inhoud van de artikelen. De krant kon niet langer ontkennen dat haar intellectuele eigendom door deze bedrijven werd gebruikt voor winstbejag.

De New York Times is de eerste grote Amerikaanse krant die een rechtszaak aanspant wegens schending van het auteursrecht met betrekking tot AI. Het is mogelijk dat andere kranten in de toekomst ook zullen volgen, vooral na de succesvolle zaak van de New York Times.

Eerder sloot OpenAI in juli 2023 licentieovereenkomsten met Associated Press en in december 2023 met Axel Springer, de Duitse uitgever die eigenaar is van Politico en Business Insider.

Actrice Sarah Silverman raakte in juli 2023 ook betrokken bij verschillende rechtszaken, waarin ze beweerde dat Meta en OpenAI haar memoires als trainingsmateriaal voor AI-programma's hadden gebruikt. Veel schrijvers hebben eveneens hun bezorgdheid geuit na de onthullingen dat AI-systemen tienduizenden boeken in hun databases hebben opgenomen, wat leidde tot rechtszaken van auteurs zoals Jonathan Franzen en John Grisham.

Intussen heeft Getty Images, een bedrijf dat fotodiensten aanbiedt, ook een rechtszaak aangespannen tegen een AI-bedrijf omdat dit bedrijf afbeeldingen zou hebben gegenereerd op basis van tekstuele aanwijzingen, naar verluidt door ongeoorloofd gebruik te maken van auteursrechtelijk beschermd beeldmateriaal.

Gebruikers kunnen auteursrechtproblemen ondervinden wanneer ze "onvoorzichtig" gebruikmaken van "werken" die ze via AI-tools hebben laten maken. Experts adviseren altijd om AI-tools alleen te gebruiken voor onderzoek, het verzamelen van gegevens en het opvragen van suggesties ter referentie.

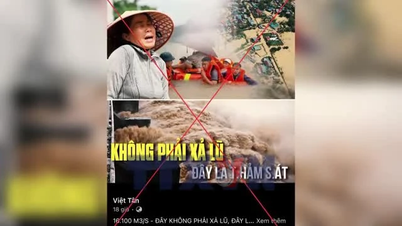

Een ander probleem is dat AI-toepassingen gebruikers in verwarring brengen doordat het moeilijk is om onderscheid te maken tussen authentieke en nepcontent. Uitgevers en redacties kunnen in verwarring raken bij het ontvangen van manuscripten. Ook docenten ondervinden moeilijkheden bij het vaststellen of er in het werk van studenten gebruik is gemaakt van AI.

De gemeenschap zal nu alerter moeten zijn, omdat het moeilijk is om onderscheid te maken tussen echte en nepcontent. Het zal bijvoorbeeld lastig zijn voor een gemiddelde persoon om te zien of een foto is gemanipuleerd of bewerkt door AI.

Juridische regelgeving met betrekking tot het gebruik van AI is nodig.

In afwachting van de ontwikkeling van tools die AI-interferentie kunnen detecteren, moeten regelgevende instanties duidelijke en specifieke wettelijke voorschriften vaststellen met betrekking tot het gebruik van deze technologie voor het creëren van originele content. Deze voorschriften moeten het publiek duidelijk laten weten welke content of werken door AI zijn gemanipuleerd, bijvoorbeeld door standaard een watermerk toe te voegen aan afbeeldingen die door AI zijn bewerkt.

Bron: https://nld.com.vn/mat-trai-cua-ung-dung-tri-tue-nhan-tao-196240227204333618.htm

![[Afbeelding] Centraal Partijbureau vat werkzaamheden voor 2025 samen](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F18%2F1766065572073_vptw-hoi-nghi-tong-ket-89-1204-jpg.webp&w=3840&q=75)

Reactie (0)